- •В.М.Лазебник экономическая кибернетика

- •Содержание

- •Введение

- •Раздел I

- •Структура кибернетики

- •Принципы построения кибернетических систем различных прикладных направлений

- •1.2. Экономическая кибернетика Предмет, цели и задачи курса

- •Структура и состав экономической кибернетики

- •История кибернетики и информационных наук

- •1.3. Кибернетические системы Система и ее основные характеристики

- •Классификация систем

- •Целостность, эмерджентность и синергизм

- •Контрольные вопросы и задания к главе 1 «Кибернетика и кибернетические системы»

- •Глава 2. Моделирование

- •2.1. Модели и моделирование

- •Основные схемы процесса моделирования

- •Классификация моделей

- •История моделирования Появление моделей относится к глубокой древности, и восходит по времени к бронзовому веку (XV-XX в.В. До н. Э.).

- •Совместное использование моделей различных типов

- •2.2. Последовательность разработки и использования математических моделей Процесс моделирования

- •6. Разработка программы, реализующей алгоритм модели на компьютере.

- •Контрольные вопросы и задания к главе 2

- •Реализация управления

- •Разомкнутые системы управления

- •Внешние и внутренние возмущения

- •Анализ свойств разомкнутой системы управления

- •3.2. Замкнутые системы управления

- •Коэффициенты передачи и передаточные функции замкнутой системы управления

- •Анализ свойств замкнутой системы управления

- •Выводы:

- •Типы обратных связей и сферы их применения Обратные связи могут быть:

- •Структурная схема и процессы в системе отрицательной обратной связи показаны на рис.3.6

- •3.3. Классификация систем управления и виды задач управления Классификация систем управления

- •Виды задач управления

- •Понятие гомеостазиса

- •3.4. Закон необходимого разнообразия и его следствия для систем управления Энтропия систем и закон необходимого разнообразия

- •Свойства систем управления, основанные на законе необходимого разнообразия

- •3.5. Управление сложными системами Иерархические системы управления

- •Централизованное и децентрализованное управление сложными системами

- •Анализ децентрализованных систем управления

- •Контрольные вопросы и задания к главе 3 «Управление»

- •Глава 4. Информация

- •4.1. Основные категории информации и ее классификация Определение понятия информации

- •Основные категории информации – данные и знания

- •Основные свойства информации

- •Виды информации

- •Основные требования, предъявляемые к качеству информации

- •Классификация информации

- •4.2. Экономическая информация и экономическая семиотика Экономическая информация

- •Экономическая семиотика

- •Основные элементы системы передачи информации

- •4.3. Измерение количества информации Основные подходы к измерению количества информации

- •Объемный метод измерения количества информации

- •Энтропийный подход к измерению количества информации

- •Вопрос 2: Число х больше шести?

- •Вопрос 3: Число х меньше шести?

- •Количество информации, получаемое от отдельного сообщения

- •Семантический подход к определению количества информации

- •4.4. Ценность информации Определение ценности информации

- •Человек и информация

- •Бытовые – искажение информации в отчетах, в докладах начальству, в отношениях мужчины и женщины, и т.П.

- •4.5. Кодирование информации Кодирование

- •Криптография

- •Десятичное кодирование информации

- •Двоичное кодирование информации

- •Избыточность информации

- •Контрольные вопросы и задания к главе 4 «Информация»

- •Глава 5. Моделирование экономических систем

- •5.1. Системные свойства экономики Основные системные свойства экономики

- •Структуры и модели рыночной экономики

- •5.2. Моделирование и принятие решений Принятие решений

- •Методы обоснования решений

- •Количественные методы позволяют установить насколько один результат лучше другого.

- •5.3. Критерии качества и критерии принятия решений

- •Требования, предъявляемые к критериям качества

- •Классификация и формы критериев качества Классификация критериев качества

- •Математические формы критериев качества

- •Статистические задачи

- •5.4. Примеры математических моделей экономических систем

- •Модель оценки экономической эффективности системы массового обслуживания

- •Часть 1.Модель определения характеристик смо.

- •Часть 2.Модель определения экономической эффективности смо.

- •Модели динамических систем Модель динамического звена первого порядка

- •Модель динамического звена второго порядка

- •Модель экономического роста

- •Модели финансовых операций Первая модель

- •Вторая модель

- •Третья модель

- •Четвертая модель

- •Пятая модель

- •Шестая модель

- •Контрольные вопросы и задания к главе 5 «Моделирование экономических систем»

- •Раздел II

- •Оптимизационные задачи

- •Оптимизация систем массового обслуживания

- •Оптимизация систем управления запасами

- •6.2. Оптимальное распределение ресурсов между несколькими этапами и между несколькими объектами Последовательная (многоэтапная) оптимизация с использованием метода динамического программирования

- •Уравнение оптимальности Беллмана имеет вид

- •Оптимизация маршрута

- •Оптимальное распределение ресурсов между несколькими объектами

- •Приравниваем производные нулю

- •Контрольные вопросы и задания к главе 6 «Оптимизация экономических систем»

- •Глава 7. Наилучшие решения в условиях неопределенности и многокритериальности

- •7.1. Наилучшие решения в условиях частичной и полной неопределенности Игры с «природой»

- •Наилучшие решения в условиях частичной неопределенности

- •Наилучшее решение в условиях полной неопределенности

- •Матрица выигрышей

- •7.2. Наилучшие решения в условиях многокритериальности

- •Контрольные вопросы и задания к главе 7 «Наилучшие решения в условиях неопределенности и многокритериальности»

- •Раздел III искусственный интеллект

- •Глава 8. Системы искусственного интеллекта

- •8.1. Основные положения по построению систем искусственного интеллекта

- •Зависимость типа системы управления от сложности объекта управления и влияния случайных факторов

- •История систем ии

- •Виды неопределенностей

- •8.2. Нечеткие системы

- •Нечеткие системы в управлении

- •Контрольные вопросы и задания к главе 8 «Системы искусственного интеллекта»

- •Глава 9. Нейронные сети, экспертные системы и генетические алгоритмы

- •9.1. Нейронные сети Принципы построения и основные свойства нейронных сетей

- •Представление знаний в нейронных сетях

- •Применение нейронных сетей в экономике

- •Пример решения задачи прогнозирования

- •9.2. Экспертные системы Принципы построения и функционирования экспертных систем

- •Пример применения экспертных систем в экономике и финансах – экспертная система для кредитных операций

- •Представление знаний в экспертных системах

- •9.3. Генетические алгоритмы

- •Контрольные вопросы и задания к главе 9 «Нейронные сети, экспертные системы и генетические алгоритмы»

- •Раздел IV

- •Структурная схема простой смо. Основные обозначения. Характеристики важнейших параметров Структурная схема простой смо

- •Основные обозначения

- •Характеристики важнейших параметров

- •Задачи исследования смо

- •Методология разработки аналитических моделей смо

- •Обозначения моделей смо

- •10.3. Потоки событий Характер величин и процессов в смо

- •Смо с детерминированными потоками

- •Случайные потоки событий

- •10.4. Марковские случайные процессы Графы состояний смо

- •Марковские процессы

- •Стационарный режим динамического процесса

- •Законы распределения, определяющие описание и формирование простейшего потока

- •Закон Пуассона

- •Исходные данные

- •Алгоритм решения задачи

- •Решение

- •Экспоненциальный (показательный) закон распределения

- •Закон равномерной плотности

- •10.5. Уравнения Колмогорова Дифференциальные и алгебраические уравнения Колмогорова

- •Общие формулы решения системы алгебраических уравнений Колмогорова для схемы ''рождения и гибели''

- •10.6. Модель Эрланга Одноканальная смо с отказами

- •Многоканальная смо с отказами

- •10.7. Имитационное моделирование систем массового обслуживания Метод статистических испытаний (метод Монте-Карло)

- •Исследование смо с применением метода статистических испытаний

- •Методика и пример формирования простейшего потока

- •Контрольные вопросы и задания к главе 10 «Модели и методы исследования систем массового обслуживания»

- •Глава 11. Анализ и синтез системы массового обслуживания Характеристика задач анализа и синтеза смо

- •Определение вероятностей отказа и обслуживания Основные формулы для смо Эрланга

- •Пример расчетов по формулам Эрланга

- •Построение графиков вероятности отказа и обслуживания на основе расчетных данных

- •Построение графиков вероятностей отказа и обслуживания на основе табличных данных

- •Графики вероятностей отказа

- •Графики вероятностей обслуживания

- •Определение показателей качества смо с отказами

- •Показатели качества обслуживания заявки

- •Показатели качества обслуживания заявки

- •Пример расчета характеристик смо с ожиданием

- •Расчетные параметры:

- •Показатели качества функционирования

- •Показатели качества обслуживания заявки

- •Компьютерные программы и таблицы вероятностей отказа для смо с ограниченным временем ожидания

- •Сопоставление смо с отказами и смо с ожиданием

- •11.3. Методика оценки экономической эффективности смо Постановка задачи оценки экономической эффективности

- •Уравнения блока оценки экономической эффективности

- •Уравнения полной модели оценки экономической эффективности смо

- •Модель смо

- •Блок оценки экономической эффективности

- •Вариант №2 кафе «десерт»

- •Определение показателей экономической эффективности смо на момент окупаемости Результаты расчетов

- •Составление итоговой таблицы результатов расчетов по оценке экономической эффективности смо

- •Сопоставление вариантов смо по основным экономическим характеристикам

- •11.5. Синтез системы массового обслуживания и принятие решения об инвестировании Составление таблицы результатов расчетов по оценке экономической эффективности смо

- •Ранжирование вариантов и выводы

- •Определение взаимосвязи параметров смо с экономическими параметрами системы

- •Контрольные вопросы и задания к главе 11 «Анализ и синтез системы массового обслуживания »

- •Приложения п.1. Программа курса «Экономическая кибернетика»

- •Раздел IV. Информация

- •Раздел V. Моделирование

- •Раздел VI. Системы массового обслуживания (смо)

- •Раздел VII. Оптимизация и принятие решений

- •Раздел VII. Искусственный интеллект

- •П.2. Задание на подготовку реферата «Замкнутые системы управления»

- •П.3. Задание на подготовку реферата «Системы массового обслуживания»

- •Часть 1. Определение характеристик смо.

- •Вероятность обслуживания

- •Часть 2. Оценка экономической эффективности смо.

- •Результаты расчетов

- •Ранжирование, анализ вариантов и выводы

- •П.4. Равномерно распределенные случайные числа

- •П 5. Вероятности отказа для смо Эрланга

- •П 6. Компьютерные программы для смо Эрланга п 6.1. Программы на языке Паскаль

- •П.6.3. Программа на языке Visual Basic для расчета экономической эффективности смо

- •П 7. Вероятности отказа для смо с ограниченным временем ожидания

- •П 8. Компьютерная программа для смо с ограниченным временем ожидания

- •Литература

Понятие гомеостазиса

Гомеостазис в переводе с греческого означает "постоянное состояние", Homeo – постоянство, Statis – состояние.

Гомеостатика - это научное направление, возникшее на пересечении кибернетики и теории автоматического регулирования. Понятие "гомеостаз" применительно к физиологии было введено американским физиологом У. Шенноном (1871-1945) задолго до появления кибернетики. Позже американский кибернетик У. Эшби создал самоорганизующийся регулятор, способный поддерживать постоянство характеристик управляемой системы при больших изменениях характеристик внешней среды (больших внешних возмущениях). У. Эшби назвал этот прибор гомеостатом.

Основополагающим принципом гомеостатики является принцип управляемого противоречия. В соответствии с этим принципом нормальное состояние системы поддерживается в результате одновременного воздействия на систему двух противоречивых факторов, один из которых стремиться увеличить регулируемую величину, а второй – уменьшить её.

Свойство систем нормально функционировать при условии постоянства их жизненно важных параметров в условиях изменения характеристик внешней среды и называют гомеостазисом. Само постоянство в ряде случаев не является строго неизменным, оно может изменяться, но относительно медленнее, чем процессы в системе.

Все живые организмы могут существовать только при условии постоянства жизненно важных параметров, например, постоянства температуры тела, кровяного давления, состава крови, «густоты» крови, содержания сахара в крови и т.п. Инсулин, уменьшающий содержание сахара в крови, и глюкоза, увеличивающая содержание сахара, определяют энергетический баланс крови.

Многие сложные системы – экономические, социальные в той или иной степени гомеостатичны – у каждой из них есть свои жизненно важные параметры, которые необходимо поддерживать в определенных границах при допустимых изменениях характеристик внешней среды.

В экономике примером может служить система регулирования спроса и предложения. Увеличение спроса приводит к увеличению равновесной цены, а увеличение предложения - к её снижению. Явления управления спросом и предложением и медленного изменения равновесного состояния можно наблюдать на примере изменения курса валют. В технических системах примером гомеостазиса может быть регулирование частоты и активной мощности в энергосистемах с целью поддержания частоты на неизменном уровне 50 Гц. Здесь увеличение энергетической мощности приводит к увеличению частоты, увеличение нагрузки - к снижению частоты,

Явление гомеостазиса наблюдается и в человеческом обществе. Человек вынужден придерживаться некоторых постоянных норм и правил, поскольку находится непрерывно под воздействием посылаемых ему «сигналов» о том, что такое «хорошо» и что такое «плохо».

3.4. Закон необходимого разнообразия и его следствия для систем управления Энтропия систем и закон необходимого разнообразия

Закон необходимого разнообразия был сформулирован американским кибернетиком У.Р. Эшби в его книге «Введение в кибернетику».

Закон устанавливает зависимость между уровнем разнообразия (сложности) объекта управления и уровнем разнообразия (сложностью) управляющей системы (субъекта управления).

В качестве меры неопределенности (иначе уровня разнообразия) дискретной системы применяется специальная характеристика, называемая энтропией.

Энтропия системы определяется, как сумма произведений вероятностей различных состояний системы на логарифмы этих вероятностей, взятая с обратным знаком

Н(х)

=

![]() Рi

∙

log2Pi,

i = l,N (3.1)

Рi

∙

log2Pi,

i = l,N (3.1)

Здесь х - дискретная случайная величина, состояния которой имеют вероятность Рi. Обычно за основание логарифма принимается число 2.

Формула (3.1) называется формулой К.Шеннона.

Энтропия простейшей системы, которая имеет два равновозможных состояния, равна единице.

Действительно, если

|

xi |

x1 |

x2 |

|

Pi |

½ |

½ |

то Н(х) = - (½ log2½ + ½ log2½) = - [½ (-1) + ½ (-1)] = 1

Определённая таким образом единица энтропии называется «двоичной единицей» и обозначается bit (от англ. «binary digit» - двоичный знак). Это энтропия одного разряда двоичного числа, если он с одинаковой вероятностью может быть нулём или единицей.

Для системы, которая имеет N равновероятных состояний

Н(х)

= [N ∙

![]() ∙ log2

∙ log2

![]() ]

= -log2l

+ log2N

= log2N

]

= -log2l

+ log2N

= log2N

где N

- число состояний,

![]() - вероятность состояний

- вероятность состояний

Формула

Н(х) = log2N (3.2)

называется формулой Р. Хартли.

т.е. энтропия системы с равновозможными состояниями равна логарифму числа состояний.

Так для системы с восемью состояниями Н(х) = log 28 = 3.

Рассмотрим в качестве примера анализа неопределенности две системы: монету и авторучку.

Каждая система имеет два состояния. У монеты – это орел и решка (цифра и герб). У авторучки – колпачок надет и колпачок снят. В случае монеты состояния имеют вероятности Р=0,5 и для определения энтропии может быть использована формула Хартли.

Подставляя в формулу N = 2, получаем

H(x) = log 22 = l.

Для авторучки вероятности состояний различны. Авторучка может находиться длительное время (т.е. с большей вероятностью) со снятым колпачком или, наоборот, с большей вероятностью быть с надетым колпачком.

Обозначим одну из этих вероятностей через Р, тогда другая будет 1– Р, т.к. предполагается, что состояния образуют полную группу событий.

Для вычисления энтропии в этом случае необходимо воспользоваться формулой Шеннона.

Для энтропии авторучки, т.е. системы с двумя состояниями и вероятностью одного из них Р, а другого (1–Р), имеем

Н(х) = Р ∙ log2 Р + (1–Р) ∙ log2 (1–P).

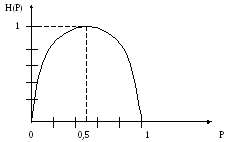

Построим зависимость энтропии от величины вероятности Р.

При Р = 0

H(x) = 0 ∙ log20 + l ∙ log2l.

Первый член равен нулю, поскольку доказывается, что неопределенность

lim P log2P = 0.

p →0

Второй член равен нулю, поскольку log2l = 0.

Т.о. имеем, что при Р = 0 энтропия Н(х) = 0.

При Р

=

![]() = ½, имеем Н(х) = 1.

= ½, имеем Н(х) = 1.

При Р = 1, величина Н(х) снова обращается в ноль.

По результатам расчетов график зависимости Н(Р) имеет вид, представленный на рис.3.2

Рис. 3.2.Зависимость энтропии от вероятности одного из двух состояний

Как следует из рисунка энтропия обладает следующими свойствами:

1. обращается в нуль, когда одно из состояний достоверно, а другие – невозможны;

2. обращается в максимум, когда состояния равновероятны

Зависимость энтропии от числа равновозможных состояний Н от N представлена в табл.3.1.

Таблица 3.1.

|

N |

2 |

4 |

8 |

16 |

32 |

64 |

128 |

|

Н |

1 |

2 |

3 |

4 |

5 |

6 |

7 |

Для системы с непрерывным множеством состояний вводится понятие дифференциальной энтропии, которая определяется количеством параметров, характеризующих состояние объекта и законами их распределения.

Формула для дифференциальной энтропии записывается в виде:

h (ξ) = – ∫ p(x) log p(x) dx (3.3)

Экономика может рассматриваться как пример системы с непрерывным множеством состояний. Так состояние фирмы характеризуется множеством непрерывных показателей: прибыль, доход, оборотные средства, рентабельность и т.д.

Основываясь на понятии энтропии У.Р.Эшби математически доказал, что существует необходимый минимум разнообразия управляющей системы относительно своего объекта, не достигнув которой, она не может успешно выполнять свои функции.

У.Р.Эшби назвал этот предел необходимым разнообразием, и сформулировал закон соответствия разнообразия управляющей системы разнообразию управляемого объекта.

Согласно этому закону разнообразие (неопределённость) в поведении управляемого объекта может быть уменьшена за счёт соответствующего увеличения разнообразия органа управления. Только разнообразие в управляющей системе может уменьшить разнообразие управляемого процесса. В наиболее краткой форме закон формулируется следующим образом: «только разнообразие может уничтожить разнообразие».

Следует отметить, что закон необходимого разнообразия не дает рекомендаций по конкретному построению систем управления, а лишь устанавливает качественные соотношения между объектом и субъектом управления.