- •Е.Л. Кон, м.М. Кулагина надежность и диагностика компонентов инфокоммуникационных и информационно-управляющих систем

- •Оглавление

- •1. Основные теоретические сведения 9

- •2. Надежность аппаратурного обеспечения 31

- •3. Создание надежного программного обеспечения 130

- •4. Диагностика состояния сложных технических систем 205

- •Введение

- •1. Основные теоретические сведения

- •1.1. Информационно-управляющие и инфокоммуникационные системы

- •1.2. Основные определения теории надежности

- •1.2.1. Надежность и ее частные стороны

- •1.2.2. Виды надежности

- •1.2.3. Отказы

- •1.2.4. Эффективность

- •1.2.5. Восстановление

- •1.3. Понятие случайных событий и случайных величин

- •1.3.1. Надежность систем при основном (последовательном) и параллельном соединении элементов

- •1.3.2. Основное соединение элементов

- •1.3.3. Параллельное соединение элементов

- •1.4. Элементы теории нечетких множеств

- •1.4.1. Понятие принадлежности и основные операции для четких подмножеств

- •1.4.2. Понятие принадлежности и основные операции для нечетких подмножеств

- •1.4.3. Отношение доминирования

- •1.4.4. Простейшие операции над нечеткими множествами

- •1.4.5. Расстояние Хэмминга

- •Вопросы и задания

- •Список литературы

- •2. Надежность аппаратурного обеспечения

- •2.1. Надежность невосстанавливаемых систем без резервирования

- •2.1.1. Показатели надежности невосстанавливаемых объектов

- •2.1.2. Законы распределения случайных величин, используемые в теории надежности

- •Показательное (экспоненциальное) распределение

- •Усеченное нормальное распределение

- •Распределение Вейбулла

- •Гамма-распределение

- •Практическая область применения законов распределения времени безотказной работы

- •2.1.3. Использованиеи-характеристик для решения практических задач

- •2.1.4. Особенности расчета надежности при проектировании различных систем

- •2.1.5. Расчет надежности по блок-схеме системы

- •2.1.6. Расчет надежности при подборе элементов системы

- •2.1.7. Расчет надежности системы с учетом режимов работы элементов

- •2.1.8. Учет цикличности работы аппаратуры

- •2.2. Надежность невосстанавливаемых систем с резервированием

- •2.2.1. Пути повышения надежности

- •2.2.2. Методы резервирования

- •2.2.3. Расчет надежности сложных систем при постоянно включенном резерве

- •2.2.4. Расчет надежности системы при резервировании замещением

- •2.2.5. Резервирование замещением в случае нагруженного резерва

- •2.2.6. Резервирование замещением в случае облегченного резерва

- •2.2.7. Резервирование замещением в случае ненагруженного резерва

- •2.2.8. Расчет надежности систем с функциональным резервированием

- •2.3. Расчет надежности восстанавливаемых систем

- •2.3.1. Критерий надежности систем с восстановлением

- •Характеристики потока отказов

- •Характеристики потока восстановления

- •Комплексные характеристики надежности систем с восстановлением

- •2.3.2. Расчет надежности по графу работоспособности объекта

- •2.3.3. Определение среднего времени наработки на отказ системы с восстановлением

- •2.3.4. Расчет надежности систем с восстановлением при основном (последовательном) и параллельном соединении элементов

- •2.3.5. Расчет надежности сложных инфокоммуникационных систем

- •Структура и функции стс

- •Определение надежностных характеристик блоков стс

- •Составление структурно-логической схемы надежности и графа состояний

- •2.3.5.4. Расчет коэффициента готовности стс

- •Определение надежностных характеристик блоков аиис

- •Составление структурно-логической схемы надежности и графа переходов

- •Расчет коэффициента готовности аиис «Алтайэнерго»

- •Расчет коэффициента готовности аиис

- •2.4. Расчет надежности восстанавливаемых систем при наличии системы контроля

- •2.4.1. Система встроенного контроля абсолютно надежна

- •2.4.2. Система встроенного контроля самопроверяемая, и ее отказ обнаруживается сразу же

- •2.4.3. Система встроенного самоконтроля несамопроверяемая

- •2.5. Расчет надежности в условиях нечетко заданных исходных данных

- •2.5.1. Выбор оптимального варианта для невосстанавливаемых систем

- •2.5.2. Выбор оптимального варианта для восстанавливаемых систем

- •2.6. Расчет надежности систем на этапе эксплуатации

- •2.6.1. Планирование и расчет периодов профилактик

- •2.6.2. Планирование и расчет числа запасных изделий

- •Вопросы и задания

- •Список литературы

- •3. Создание надежного программного обеспечения

- •3.1. Надежность программного обеспечения

- •3.1.1. Ошибки в по и их типы

- •Типы ошибок в программном обеспечении

- •3.1.2. Причины появления ошибок в программном обеспечении

- •3.1.3. Отношения с пользователем (заказчиком)

- •3.1.4. Принципы и методы обеспечения надежности

- •3.1.5. Последовательность выполнения процессов разработки программного обеспечения

- •3.1.6. Сравнение надежности аппаратуры и программного обеспечения

- •3.2. Основные этапы проектирования программного обеспечения

- •3.2.1. Правильность проектирования и планирование изменений

- •3.2.2. Требования к по

- •3.2.3. Цели программного обеспечения

- •Цели продукта

- •Цели проекта

- •Общие правила постановки целей

- •Оценка целей

- •3.2.4. Внешнее проектирование

- •Проектирование взаимодействия с пользователем

- •Подготовка внешних спецификаций

- •Проверка правильности внешних спецификаций

- •3.2.5. Проектирование архитектуры программы

- •Независимость модулей

- •Прочность модулей

- •Сцепление модулей

- •3.2.6. Методы непосредственного повышения надежности модулей

- •Пассивное обнаружение ошибок

- •Активное обнаружение ошибок

- •Исправление ошибок и устойчивость к ошибкам

- •Изоляция ошибок

- •Обработка сбоев аппаратуры

- •3.2.7. Проектирование и программирование модуля

- •Внешнее проектирование модуля

- •Проектирование логики модуля

- •Пошаговая детализация

- •3.2.8. Стиль программирования

- •Ясность программирования

- •Использование языка

- •Микроэффективность

- •Комментарии

- •Определения данных

- •Структура модуля

- •3.3. Тестирование и верификация программ

- •3.3.1. Проблемы тестирования программ

- •3.3.2. Технологии тестирования программ

- •3.3.3. Принципы тестирования

- •3.4. Модели надежности по

- •3.4.1. Модель роста надежности

- •3.4.2. Другие вероятностные модели

- •3.4.3. Статистическая модель Миллса

- •3.4.4. Простые интуитивные модели

- •3.4.5. Объединение показателей надежности

- •Вопросы и задания

- •Список литературы

- •4. Диагностика состояния сложных технических систем

- •4.1. Предмет, задачи и модели технической диагностики

- •4.1.1. Предмет технической диагностики

- •4.1.2. Основные аспекты, задачи и модели технической диагностики

- •4.1.3. Классификация диагностических процедур и их краткая характеристика

- •4.2. Построение тестов

- •4.2.1. Построение тестового набора методом активизации существенного пути

- •4.2.2. Алгоритм построения тестового набора для комбинационной схемы методом активизации существенного пути

- •4.2.3. Построение тестов для схем с памятью

- •Комбинационная модель последовательностной схемы

- •Построение тестовой последовательности по комбинационной модели последовательностной схемы

- •4.3. Функциональный контроль и диагностирование сложных технических систем

- •4.3.1. Полностью самопроверяемые цифровые устройства

- •4.3.2. Схемы встроенного контроля

- •4.3.3. Схемы сжатия

- •4.3.4. Микропроцессор как объект функционального контроля

- •4.3.5. Модель мп с точки зрения функционального контроля

- •4.3.6. Диагностическая модель уу мп системы

- •4.3.7. Критерии оценки методов контроля механизмов выборки, хранения и дешифрации команд

- •4.3.8. Встроенный функциональный контроль механизмов хранения и дешифрации команд

- •Методы пошагового контроля правильности хода программ

- •Методы контроля, реализующие раскраску команд

- •Метод контроля, использующий раскраску без учета структуры команд

- •Преобразованная программа приведена ниже:

- •Цвет Четность Цвет гса

- •Метод контроля команд, реализующий раскраску с учетом структуры команды

- •Раскраска без внесения в команду избыточных разрядов

- •Методы контроля механизмов дешифрации и хранения команд с помощью веса перехода

- •Метод контроля с помощью алгебраических кодов

- •Методы блокового контроля правильности хода программ

- •Блоковый контроль программ по методу разбиения программы на фазы (блоки)

- •Блоковый контроль правильности хода программ с помощью сигнатур

- •Метод контроля программ на основе полиноминальной интерпретации схем алгоритмов (программ)

- •Сравнительный анализ свк, реализующих методы блокового и пошагового контроля

- •4.4. Экспертные системы диагностирования сложных технических систем

- •4.4.1. Обучение и его модели. Самообучение

- •4.4.2. Экспертные системы и принципы их построения

- •4.4.3. Проблема разделения в самообучаемых экспертных системах

- •4.4.4. Алгоритмы обучения экспертных систем

- •Частота события находится по следующей формуле:

- •4.4.5. Асу «интеллектуальным зданием»

- •4.4.6. Система, принимающая решения по максимальной вероятности

- •4.4.7. Система, принимающая решения по наименьшему расстоянию

- •4.4.8. Повышение достоверности решений экспертной системы

- •4.4.9. Прогнозирование технического состояния узлов

- •Вопросы и задания

- •Список литературы

- •Приложение Интенсивность отказов компонентов иус

- •Кон Ефим Львович, Кулагина Марина Михайловна надежность и диагностика компонентов инфокоммуникационных и информационно-управляющих систем

Частота события находится по следующей формуле:

. (4.10)

. (4.10)

В качестве точечной оценки для неизвестной вероятности p разумно принимать частоту p*. При этом возникает вопрос о построении доверительного интервала для вероятности p.

Для вероятности p доверительный интервал I = (p1, p2), где – вероятность того, что истинная вероятность попадет в указанный интервал.

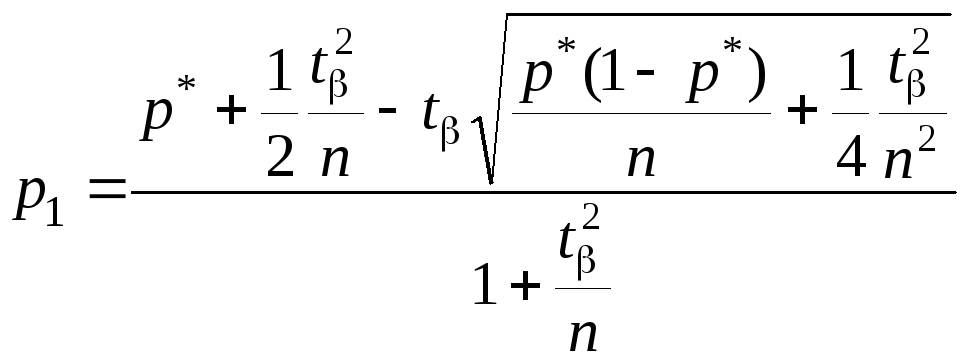

Выбор формулы для подсчета доверительного интервала зависит от n. Если число опытов не превосходит 100, то p1 и p2 находятся по следующим формулам:

; (4.11)

; (4.11)

, (4.12)

, (4.12)

где t – коэффициент Стьюдента, взятый из таблицы для заданного .

Для больших n (порядка сотен) можно пользоваться следующими формулами:

![]() , (4.13)

, (4.13)

![]() . (4.14)

. (4.14)

Приведем значения коэффициентов Стьюдента в зависимости от заданной вероятности (табл. 4.3).

Таблица 4.3

|

|

t |

|

t |

|

t |

|

t |

|

0,80 |

1,282 |

0,86 |

1,475 |

0,91 |

1,694 |

0,97 |

2,169 |

|

0,81 |

1,310 |

0,87 |

1,513 |

0,92 |

1,750 |

0,98 |

2,325 |

|

0,82 |

1,340 |

0,88 |

1,554 |

0,93 |

1,810 |

0,99 |

2,576 |

|

0,83 |

1,371 |

0,89 |

1,597 |

0,94 |

1,880 |

0,9973 |

3,000 |

|

0,84 |

1,404 |

0,90 |

1,643 |

0,95 |

1,960 |

0,999 |

3,290 |

|

0,85 |

1,439 |

|

|

0,96 |

2,053 |

|

|

Из всего вышеприведенного следует общий алгоритм обучения экспертной системы:

1. В качестве исходных данных к проекту задаемся вероятностью правильного ответа экспертной системы и доверительной вероятностью.

2. Определяем набор гипотез и параметров экспертной системы. Если это возможно, строим модель диагностируемой системы.

3. Проводим очередное испытание экспертной системы: предъявляем текущий набор параметров и получаем выбранную экспертной системой гипотезу.

4. В соответствии с методом обучения экспертная система проводит модификацию правил.

5. Увеличивая количество испытаний n на единицу, с учетом общей частоты правильных ответов находим p1 и p2. Если p1 выше заданной вероятности правильного ответа, считаем, что процесс обучения закончен, если нет, переходим к п. 3. Однако возможно возникновение такой ситуации, когда новые примеры перестали влиять на точность классификации. Это значит, что принятый на этапе 2 набор параметров не является удачным. Следует его расширить, а возможно, и ввести в систему новые датчики, т.е. вернуться к п. 2.

Для улучшения набора параметров логично воспользоваться информацией, накопленной экспертной системой в процессе обучения. Фактически экспертная система формирует таблицу функций неисправностей (табл. 4.4).

Таблица 4.4

|

Параметр |

Н1 |

Н2 |

… |

НN |

|

1 |

р11 |

р12 |

|

р1N |

|

2 |

р21 |

р22 |

|

р2N |

|

… |

|

|

|

|

|

М |

рМ1 |

рМ2 |

|

рМN |

В этой таблице рij обозначает значение параметра i при наличии гипотезы Нj. Анализ этой таблицы позволит выявить гипотезы, которые экспертная система не в состоянии различить. Для таких гипотез значения столбцов таблицы функций неисправностей будут совпадать. Следовательно, разумно дополнить экспертную систему новыми параметрами, которые помогут снять это совпадение.

Предположим, что процесс обучения экспертной системы завершился успешно и вероятность правильного ответа превышает заданную. Однако мы уже видели, что вероятность правильного ответа все равно никогда не достигнет единицы. Следовательно, в большинстве случаев будет разумно выдавать не одну подозреваемую неисправность, для которой вероятность возникновения наиболее велика, а несколько подозреваемых неисправностей с наибольшими вероятностями.

Таким образом, мы приходим к нечеткому множеству неисправностей N, характеристическая функция А(х) для которых будет представлять собой вероятность того, что на данный момент времени в системе имеется именно данная неисправность, т.е. в нечеткое множество будут входить принятые гипотезы со своими коэффициентами принадлежности к множеству всех возможных гипотез:

![]() .

.

В соответствии с математическим аппаратом значения рi должны находиться на интервале (0;1). Покажем, как преобразовать значения гипотез в вероятности для обоих методов построения правил экспертной системой:

1. Для экспертной системы, ориентированной на максимальную вероятность, имеем набор значений yk. В случае если среди полученных значений имеются отрицательные, складываем полученные значения с yk min. Затем делим эти коэффициенты на их общую сумму.

2. Для экспертной системы, принимающей решения на основании выбора по наименьшему расстоянию, методика определения коэффициентов характеристической функции будет иная, поскольку, чем меньше подсчитанное значение гипотезы, тем более она вероятна. В соответствии с алгоритмом здесь отрицательные значения yk не могут быть получены.

Далее делим значения для гипотез на сумму значений гипотез:

![]() . (4.15)

. (4.15)

После этого преобразуем полученные значения по формуле

![]() . (4.16)

. (4.16)

Таким образом, нечеткое множество подозреваемых неисправностей может быть сформировано для обоих вариантов построения экспертной системы.

Поскольку имеется два способа построения решающих правил для экспертной системы, невозможно заранее предсказать, какой из них окажется лучшим. Однако если есть возможность довольно точно заранее оценить средние значения параметров, то можно ожидать, что система, обучаемая по средним значениям, станет работоспособной быстрее.

В общем случае целесообразно построить оба варианта системы, а после обучения выбрать ту, которая лучше себя ведет.

Рассмотрим оба принципа обучения на конкретном примере экспертной системы технического диагностирования (ЭСТД) такого сложного объекта, как АСУ ТП «интеллектуального здания», в состав которой входят персональные компьютеры, интеллектуальные датчики, исполнительные устройства автоматики, регуляторы и т.д. Подобная ЭСТД сможет принимать решения об исправности или неисправности тех или иных узлов АСУ ТП.