- •Лекционный материал по курсу

- •1 Измерительные сигналы

- •1.1 Классификация измерительных сигналов и сигналов помех

- •1.2 Математическое описание детерминированных измерительных сигналов. Сигналы и их математические модели

- •1.2.1 Представление произвольного сигнала в виде суммы элементарных колебаний

- •1.2.2 Гармонический анализ периодических сигналов

- •1.2.3 Гармонический анализ непериодических сигналов

- •1.2.3.1 Основные свойства преобразования Фурье

- •1) Сдвиг сигналов во времени

- •3) Смещение спектра сигнала

- •1.2.4 Геометрическое представление сигналов

- •1.3 Корреляционный анализ детерминированных сигналов

- •Соотношение между корреляционной функцией и спектральной характеристикой сигнала

- •1.4 Модулированные сигналы

- •1.4.1 Радиосигналы с амплитудной модуляцией

- •1.4.1.1 Спектр амплитудно-модулированного колебания

- •1.4.2 Угловая модуляция. Фаза и мгновенная частота колебания

- •1.4.2.1 Спектр колебания при гармонической угловой модуляции

- •1.4.3 Огибающая, фаза и частота узкополосного сигнала

- •1.4.4 Аналитический сигнал

- •1.5 Математическое описание случайных измерительных сигналов

- •1.5.1 Основные характеристики случайных сигналов

- •1.5.2 Спектральная плотность мощности случайного процесса

- •1.5.3 Соотношение между спектральной плотностью и ковариационной функцией случайного процесса

- •1.6 Квантование, дискретизация и кодирование сигналов

- •1.6.1 Дискретизация непрерывных сигналов по времени

- •1.6.2 Представление сигналов с ограниченной полосой частот в виде ряда Котельникова

- •1.6.3 Связь между спектром сигнала s(t) и спектром базисной функции φn (t)

- •1.6.4 Восстановление сигналов по их отсчётам

- •Неограниченность спектров реальных сигналов

- •Отклонение фнч от идеальных

- •1.6.5 Задачи теории кодирования

- •1.6.5.1 Корректирующие коды

- •1.6.5.2 Систематические коды

- •Методы образования циклического кода

- •1.6.5.3 Непрерывные коды

- •2 Анализ прохождения измерительных сигналов через

- •2.1 Анализ прохождения измерительных сигналов через линейные цепи

- •2.1.1 Спектральная плотность мощности и корреляционная функция случайного процесса на выходе цепи

- •2.2 Анализ прохождения измерительных сигналов через нелинейные цепи

- •2.2.1 Безынерционные нелинейные преобразования

- •2.2.2 Внешние характеристики безынерционных нелинейных элементов

- •2.2.3 Спектральный состав тока в безынерционном нелинейном элементе при гармоническом внешнем воздействии

- •2.3 Классификация и основные характеристики фильтров

- •2.4 Фильтрация измерительных сигналов

- •2.4.1 Основные задачи при приёме сигналов

- •2.4.2 Согласованный линейный фильтр

- •2.4.3 Оптимальная фильтрация случайных сигналов

- •2.4.4 Дискретные фильтры.Цифровые линейные фильтры (цф). Алгоритм линейной цифровой фильтрации, Методы синтеза цифровых фильтров

- •2.4.4.1 Дискретное преобразование Фурье.

- •2.4.4.2 Теория z-преобразования

- •2.4.4.3 Принцип цифровой обработки сигналов

- •2.4.4.4 Реализация алгоритмов цифровой фильтрации

- •2.5 Принципы адаптивной фильтрации

- •2.5.1 Классификация адаптивных систем

- •2.5.2 Адаптивный линейный сумматор

- •2.5.3. Оптимальный весовой вектор

- •2.5.3.1 Метод градиентного поиска оптимального вектора w

- •2.5.3.2 Метод Ньютона для многомерного пространства

- •3.1 Модуляторы ам-сигналов. Способы осуществления амплитудной модуляции

- •3.1.1 Принцип работы амплитудного модулятора.

- •3.1.2 Получение сигналов с балансной модуляцией.

- •3.2 Методы получения угловой модуляции

- •Структурная схема радиоприемника модулированных сигналов. Элементы схемы. Понятие промежуточной частоты и зеркального канала. Демодуляция (детектирование) ам-сигналов

- •Как выбирается промежуточная частота:

- •3.3.1 Методы реализации преобразований частоты

- •3.3.3 Детектирование модулированных сигналов

- •3.3.4 Синхронный детектор ам-сигналов

- •3.3.5 Квадратичное детектирование

- •3.4 Демодуляция сигналов с угловой модуляцией

- •3.4.1Фазовые детекторы (фд)

- •Детекторы чм- сигналов

- •Список литературы

2.5.3. Оптимальный весовой вектор

Сигнал ошибки запишем как:

![]()

или

![]()

Здесь для удобства

записи опущен индекс kвектораWk.

Найдем![]() :

:

![]() .

.

Будем считать, что

![]() ,dk, иXk–

стационарны в статическом смысле и

найдем средне-квадратическую ошибку:

,dk, иXk–

стационарны в статическом смысле и

найдем средне-квадратическую ошибку:

![]() .

.

Введем обозначения:

![]() - корреляционная

матрица входного сигнала. Элементы по

диагонали равны средне-квадратичным

значениям входных компонентов вектора

Xk.

- корреляционная

матрица входного сигнала. Элементы по

диагонали равны средне-квадратичным

значениям входных компонентов вектора

Xk.

![]() - взаимокорреляционная

функция отсчетов полезного отклика и

отсчетов входного сигнала.

- взаимокорреляционная

функция отсчетов полезного отклика и

отсчетов входного сигнала.

Тогда:

|

|

(2.150) |

Чтобы найти весовой вектор W, при котором средне-квадратичное отклонение имеет минимум, нужно взять производную выражения (2.150) поW, приравнять к нулю и решить уравнение относительноW.

![]() .

.

Откуда находим:

|

|

(2.151) |

При этом

|

|

(2.152) |

Из выражения (2.150) видно, что если отсчеты входного сигнала и полезного отклика – стационарные случайные процессы, то средне-квадратичное отклонение является квадратичной функцией вектора W.

2.5.3.1 Метод градиентного поиска оптимального вектора w

В практических системах поиск Wопт производится не по выражению (2.151), т.к это технически не целесообразно.

Наибольшее применение нашли методы нахождения Wопт, основанные на градиентных методах для определения направления перестройки весовых коэффициентов для достиженияminСКО. Наиболее известны – это метод Ньютона и наискорейшего спуска.

Рассмотрим принцип градиентного поиска для случая системы с одним весовым коэффициентом.

Итеративный процесс градиентного поиска можно представить в виде:

|

|

(2.153) |

где k– номер шага,k– градиент при![]()

Таким образом

![]() - текущее значение,

- текущее значение,![]() - новое значение, µ - константа, определяющая

устойчивость устройства и скорость

сходимости.

- новое значение, µ - константа, определяющая

устойчивость устройства и скорость

сходимости.

При минимальном значении СКО градиент = 0.

Сходимость метода Ньютона зависит от выбора начального значения w0). Для широкого класса функции он обладает быстрой сходимостью.

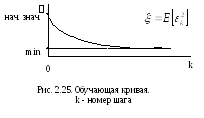

Зависимость СКО

![]() от озменений весового вектора называется

от озменений весового вектора называется

о бучающей

кривой. Общий вид ее показан на рис.

2.25.

бучающей

кривой. Общий вид ее показан на рис.

2.25.

Выражение для

![]() можно записать в виде

можно записать в виде![]() ,

,

где - собственное значениеr00матрицыR.

Тогда

![]() .

.

Для случая с одним весовым коэффициентом получаем:

![]() .

.

Тогда подставляя в (7) получаем

![]()

или

![]() ,

,

где w0– начальное приближение,![]() - называется знаменателем прогрессии.

- называется знаменателем прогрессии.

Алгоритм сходится,

если

![]() <1,

<1,![]() .

.

2.5.3.2 Метод Ньютона для многомерного пространства

Оптимальный вектор весовых коэффициентов вектор градиента определяются соотношениями

|

|

(2.154) |

|

|

(2.155) |

Умножим обе части

второго равенства слева и справа на

![]() и тогда с учетом первого равенства

получим

и тогда с учетом первого равенства

получим

![]() ,

,

или в виде адаптивного алгоритма

|

|

(2.156) |

Равенство (2.156)

описывает метод Ньютона для многих

переменных. Этот алгоритм приводит к

оптимальному решению за один шаг

![]() .

.

Этот метод Ньютона можно обобщить, если ввести константу , определяющую скорость сходимости

|

|

(2.157) |

при

![]() получаем решение за один шаг.

получаем решение за один шаг.

Можно выбрать в пределах области устойчивости![]() .

.

Однако, желательно,

чтобы система имела меньший размер шага

![]() .

.

Вопросы для самопроверки

Классификация адаптивных фильтров.

Нарисуйте схему адаптивной системы и объясните принцип ее работы.

Какие две физические интерпретации существуют относительно входного вектора сигнала.

Что такое векторное представление сигнала.

Что называют обучающей кривой.

Чему равен оптимальный весовой вектор.

Устройства модуляции и демодуляции измерительных

сигналов