- •Лекционный материал по курсу

- •1 Измерительные сигналы

- •1.1 Классификация измерительных сигналов и сигналов помех

- •1.2 Математическое описание детерминированных измерительных сигналов. Сигналы и их математические модели

- •1.2.1 Представление произвольного сигнала в виде суммы элементарных колебаний

- •1.2.2 Гармонический анализ периодических сигналов

- •1.2.3 Гармонический анализ непериодических сигналов

- •1.2.3.1 Основные свойства преобразования Фурье

- •1) Сдвиг сигналов во времени

- •3) Смещение спектра сигнала

- •1.2.4 Геометрическое представление сигналов

- •1.3 Корреляционный анализ детерминированных сигналов

- •Соотношение между корреляционной функцией и спектральной характеристикой сигнала

- •1.4 Модулированные сигналы

- •1.4.1 Радиосигналы с амплитудной модуляцией

- •1.4.1.1 Спектр амплитудно-модулированного колебания

- •1.4.2 Угловая модуляция. Фаза и мгновенная частота колебания

- •1.4.2.1 Спектр колебания при гармонической угловой модуляции

- •1.4.3 Огибающая, фаза и частота узкополосного сигнала

- •1.4.4 Аналитический сигнал

- •1.5 Математическое описание случайных измерительных сигналов

- •1.5.1 Основные характеристики случайных сигналов

- •1.5.2 Спектральная плотность мощности случайного процесса

- •1.5.3 Соотношение между спектральной плотностью и ковариационной функцией случайного процесса

- •1.6 Квантование, дискретизация и кодирование сигналов

- •1.6.1 Дискретизация непрерывных сигналов по времени

- •1.6.2 Представление сигналов с ограниченной полосой частот в виде ряда Котельникова

- •1.6.3 Связь между спектром сигнала s(t) и спектром базисной функции φn (t)

- •1.6.4 Восстановление сигналов по их отсчётам

- •Неограниченность спектров реальных сигналов

- •Отклонение фнч от идеальных

- •1.6.5 Задачи теории кодирования

- •1.6.5.1 Корректирующие коды

- •1.6.5.2 Систематические коды

- •Методы образования циклического кода

- •1.6.5.3 Непрерывные коды

- •2 Анализ прохождения измерительных сигналов через

- •2.1 Анализ прохождения измерительных сигналов через линейные цепи

- •2.1.1 Спектральная плотность мощности и корреляционная функция случайного процесса на выходе цепи

- •2.2 Анализ прохождения измерительных сигналов через нелинейные цепи

- •2.2.1 Безынерционные нелинейные преобразования

- •2.2.2 Внешние характеристики безынерционных нелинейных элементов

- •2.2.3 Спектральный состав тока в безынерционном нелинейном элементе при гармоническом внешнем воздействии

- •2.3 Классификация и основные характеристики фильтров

- •2.4 Фильтрация измерительных сигналов

- •2.4.1 Основные задачи при приёме сигналов

- •2.4.2 Согласованный линейный фильтр

- •2.4.3 Оптимальная фильтрация случайных сигналов

- •2.4.4 Дискретные фильтры.Цифровые линейные фильтры (цф). Алгоритм линейной цифровой фильтрации, Методы синтеза цифровых фильтров

- •2.4.4.1 Дискретное преобразование Фурье.

- •2.4.4.2 Теория z-преобразования

- •2.4.4.3 Принцип цифровой обработки сигналов

- •2.4.4.4 Реализация алгоритмов цифровой фильтрации

- •2.5 Принципы адаптивной фильтрации

- •2.5.1 Классификация адаптивных систем

- •2.5.2 Адаптивный линейный сумматор

- •2.5.3. Оптимальный весовой вектор

- •2.5.3.1 Метод градиентного поиска оптимального вектора w

- •2.5.3.2 Метод Ньютона для многомерного пространства

- •3.1 Модуляторы ам-сигналов. Способы осуществления амплитудной модуляции

- •3.1.1 Принцип работы амплитудного модулятора.

- •3.1.2 Получение сигналов с балансной модуляцией.

- •3.2 Методы получения угловой модуляции

- •Структурная схема радиоприемника модулированных сигналов. Элементы схемы. Понятие промежуточной частоты и зеркального канала. Демодуляция (детектирование) ам-сигналов

- •Как выбирается промежуточная частота:

- •3.3.1 Методы реализации преобразований частоты

- •3.3.3 Детектирование модулированных сигналов

- •3.3.4 Синхронный детектор ам-сигналов

- •3.3.5 Квадратичное детектирование

- •3.4 Демодуляция сигналов с угловой модуляцией

- •3.4.1Фазовые детекторы (фд)

- •Детекторы чм- сигналов

- •Список литературы

1.5 Математическое описание случайных измерительных сигналов

1.5.1 Основные характеристики случайных сигналов

Информация, передаваемая по каналу связи или извлекаемая в результате измерения, заключена в сигнале.

До приема сообщения (до испытания) сигнал следует рассматривать как случайный процесс, представляющий собой совокупность (ансамбль) функций времени, подчиняющихся некоторой общей для них статистической закономерности. Одна из этих функций, ставшая полностью известной после приема сообщения, называется реализацией случайного процесса. Эта реализация является уже не случайной, а детерминированной функцией времени.

Важной, но не исчерпывающей характеристикой случайного процесса является присущий ему одномерный закон распределения вероятностей.

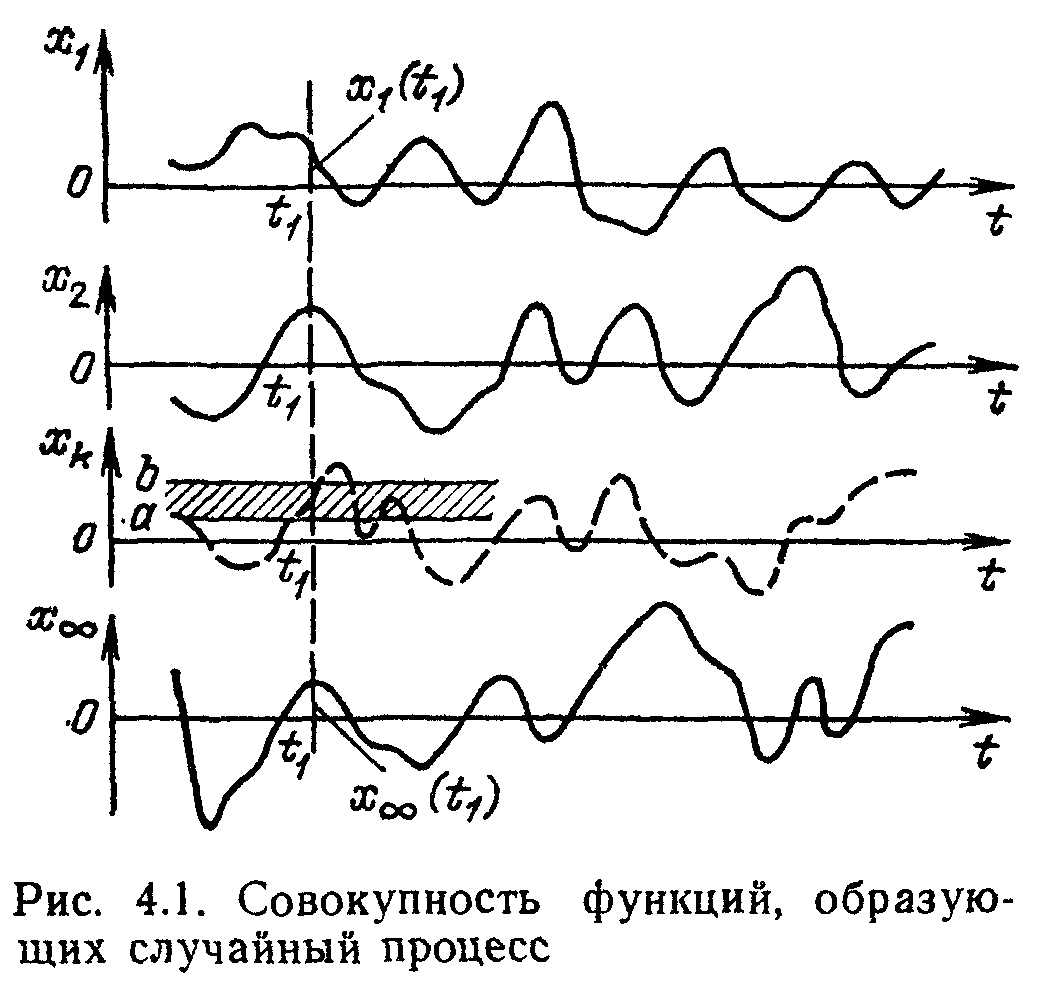

На рис.1.19 изображена совокупность функций х1(t), х2(t), ..., образующих случайный процесс X(t). Значения, которые могут принимать отдельные функции в момент времени t =t1 образуют совокупность случайных величин х1(t), х2(t), ...

Вероятность того, что величина xk(t1)при измерении попадает в какой-либо заданный интервал (а, b) (рис.1.19), определяется выражением

Pt1(а < х![]() b)

b)![]() . (1.132)

. (1.132)

Рис.1.19. Совокупность функций, образующих случайный процесс

Функция р(х; t1) представляет собой дифференциальный закон распределения случайной величины х(t1); р(х; t1) называется одномерной плотностью вероятности, а Pti - интегральной вероятностью.

Ф ункцияр(х;

tt)

имеет смысл для случайных х непрерывного

типа, могущих принимать любое значение

в некотором интервале. При любом характере

функции р(х; t1)

должно выполняться равенство

ункцияр(х;

tt)

имеет смысл для случайных х непрерывного

типа, могущих принимать любое значение

в некотором интервале. При любом характере

функции р(х; t1)

должно выполняться равенство

(1.133)

где xmin и xmах — границы возможных значений х(t1).

Если же х является случайной величиной дискретного типа и может принимать любое из конечного числа дискретных значений, то (1.133) следует заменить суммой

![]()

где Pi — вероятность, соответствующая величине xi.

Задание одномерной плотности вероятности р(х;t1) позволяет произвести статистическое усреднение как самой величины х, так и любой функции f(х). Под статистическим усреднением подразумевается усреднение х по множеству (по ансамблю) в каком-либо «сечении» процесса, т. е. в фиксированный момент времени.

Д ля

практических приложений наибольшее

значение имеют следующие параметры

случайного процесса:

ля

практических приложений наибольшее

значение имеют следующие параметры

случайного процесса:

математическое ожидание , (1.134)

д![]() исперсия ,(1.135)

исперсия ,(1.135)

![]() средне-квадратическое

отклонение

средне-квадратическое

отклонение

. (1.136)

Одномерная плотность вероятности недостаточна для полного описания процесса, так как она дает вероятностное представление о случайном процессе X(t) только в отдельные фиксированные моменты времени. Более полной характеристикой является двумерная плотность вероятности1 р(х1 ,х2; t1 ,t2), позволяющая учитывать связь значений х1 и х2, принимаемых случайной функцией в произвольно выбранные моменты времени t1 и t2.

Исчерпывающей вероятностной характеристикой случайного процесса является п-мерная плотность вероятности при достаточно больших п. Однако большое число задач, связанных с описанием случайных сигналов, удается решать на основе двумерной плотности вероятности.

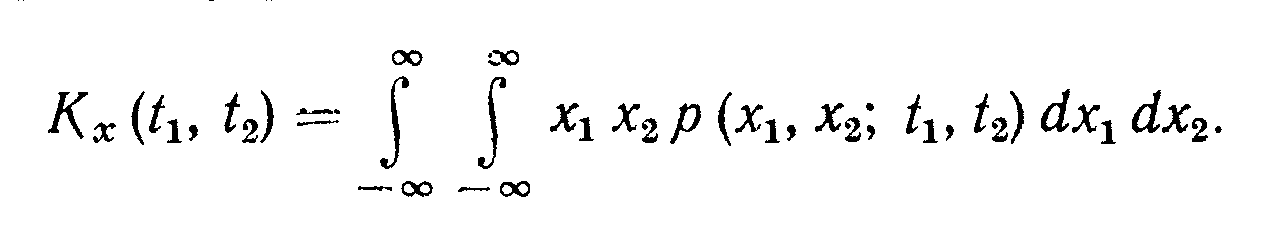

Задание двумерной плотности вероятности р (х1 ,х2;t1, t2) позволяет, в частности, определить важную характеристику случайного процесса — ковариационную функцию

![]() (1.236)

(1.236)

Согласно этому определению ковариационная функция случайного процесса X (t) представляет собой статистически усредненное произведение значений случайной функции X (t) в моменты t1 и t2.

Для каждой реализации случайного процесса произведение х(t1) х(t2) является некоторым числом. Совокупность реализаций образует множество случайных чисел, распределение которых характеризуется двумерной плотностью вероятности р(х1 ,х2; t1 ,t2). При заданной функции р(х1 ,х2; t1, t2) операция усреднения по множеству осуществляется по формуле

(1.137)

(1.137)

П![]() ри

t2

= t1

двумерная случайная величина

х1х2

вырождается в одномерную величину

х12=

х22

.

Можно поэтому написать

ри

t2

= t1

двумерная случайная величина

х1х2

вырождается в одномерную величину

х12=

х22

.

Можно поэтому написать

(1.138)

Таким образом, при нулевом интервале между моментами времени t1 и t2 ковариационная функция определяет величину среднего квадрата случайного процесса в момент t = t1.

П![]() ри

анализе случайных процессов часто

основной интерес представляет его

флуктуационная составляющая. В таких

случаях применяетсякорреляционная

функция.

ри

анализе случайных процессов часто

основной интерес представляет его

флуктуационная составляющая. В таких

случаях применяетсякорреляционная

функция.

(1.139)

Подставляя

в (1.138)

![]() —

тх

—

тх![]() вместо

вместо ![]() и

и ![]() —

тх

(t2)

вместо

х (t2),

можно получить следующее выражение:

—

тх

(t2)

вместо

х (t2),

можно получить следующее выражение:

![]()

(1.140)

П![]() ри

t1

= t2

= t

выражение (1.139) в соответствии с (1.135)

определяет дисперсию случайного

процесса Dx(t).

Следовательно,

ри

t1

= t2

= t

выражение (1.139) в соответствии с (1.135)

определяет дисперсию случайного

процесса Dx(t).

Следовательно,

Исследование случайного процесса, а также воздействия его на радиоцепи существенно упрощается при стационарности процесса.

Случайный процесс называется строго стационарным, если его плотность вероятности

р (х1 ,х2, ..., хп; t1 ,t2, ..., tn) произвольного порядка п зависит только от интервалов t2—t1, t3—t1, ..., tn—t1 и не зависит от положения этих интервалов в области изменения аргумента t.

В радиотехнических приложениях теории случайных процессов условие стационарности обычно ограничивается требованием независимости от времени только одномерной и двумерной плотностей вероятности (случайный процесс, стационарный в широком смысле). Выполнение этого условия позволяет считать, что математическое ожидание, средний квадрат и дисперсия случайного процесса не зависят от времени, а корреляционная функция зависит не от самих моментов времени t1 и t2 , а только от интервала между ними τ = t2 — t1.

Стационарность процесса в широком смысле можно трактовать как стационарность в рамках корреляционной теории (для моментов не выше второго порядка).

Т аким

образом, для случайного процесса,

стационарного в широком смысле,

предыдущие выражения можно записывать

без обозначения фиксированных

моментов времени. В частности,

аким

образом, для случайного процесса,

стационарного в широком смысле,

предыдущие выражения можно записывать

без обозначения фиксированных

моментов времени. В частности,

(1.141)

(![]() 1.142)

1.142)

(![]() 1.143)

1.143)

(![]() 1.144)

1.144)

![]()

(1.145)

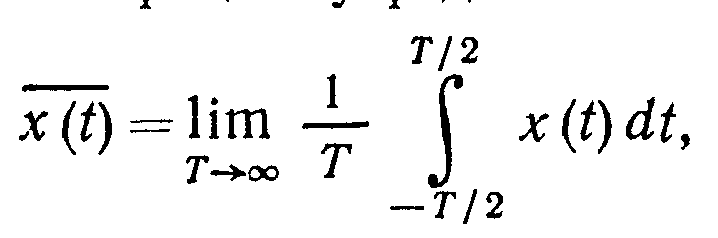

Дальнейшее упрощение анализа случайных процессов достигается при использовании условия эргодичности процесса. Стационарный случайный процесс называется эргодическим, если при определении любых

статистических характеристик усреднение по множеству реализаций эквивалентно усреднению по времени одной теоретически бесконечно длинной реализации.

У словие

эргодичности случайного процесса

включает в себя и условие его

стационарности. В соответствии с

определением эргодического процесса

соотношения (1.142)—(1.145) эквивалентны

следующим выражениям, в которых

операция усреднения по времени обозначена

чертой:

словие

эргодичности случайного процесса

включает в себя и условие его

стационарности. В соответствии с

определением эргодического процесса

соотношения (1.142)—(1.145) эквивалентны

следующим выражениям, в которых

операция усреднения по времени обозначена

чертой:

(1.146)

(1.147)

(![]() 1.148)

1.148)

![]()

(1.149)

![]()

(1.150)

Если

х(t)

представляет собой электрический

сигнал (ток, напряжение), то![]() постоянная составляющая случайного

сигнала,

Rx(0)

=

постоянная составляющая случайного

сигнала,

Rx(0)

=

![]() — средняя

мощность флуктуации сигнала [относительно

постоянной составляющей х(t)].

— средняя

мощность флуктуации сигнала [относительно

постоянной составляющей х(t)].

Выражение (1.147) внешне совпадает с определением корреляционной функции детерминированного сигнала (периодического).

Часто применяется нормированная корреляционная функция

![]() . (1.151)

. (1.151)

Функции Кх(τ), Rx(τ) и rх(τ) характеризуют связь (корреляцию) между значениями х(t), разделенными промежутком τ. Чем медленнее, плавнее изменяется во времени х(t), тем больше промежуток τ, в пределах которого наблюдается статистическая связь между мгновенными значениями случайной функции.

При экспериментальном исследовании случайных процессов используются временные корреляционные характеристики процесса (1.147)—(1.150), поскольку, как правило, экспериментатору доступно наблюдение одной реализации сигнала, а не множества его реализаций. Интегрирование выполняется, естественно, не в бесконечных пределах, а на конечном интервале Т, длина которого должна быть тем больше, чем выше требование к точности результатов измерения.