- •Министерство образования и науки рф

- •1.2.Краткие исторические сведения

- •2.Основные понятия теории вероятностей

- •2.1.Событие. Вероятность события

- •2.2.Непосредственный подсчет вероятностей

- •2.3.Основные формулы комбинаторики

- •2.3.Частота и статистическая вероятность события

- •2.4.Случайная величина

- •3.Основные теоремы теории вероятностей

- •3.1. События как множества и операции над ними

- •3.2.Теорема сложения вероятностей

- •3.3.Теорема умножения вероятностей

- •3.4.Формула полной вероятности.

- •3.5.Формула Бейеса или теорема гипотез.

- •Случайные величины и их законы распределения

- •4.1.Ряд распределения

- •4.2.Функция распределения

- •4.3.Плотность распределения

- •5.Числовые характеристики случайных величин

- •5.1.Характеристики положения

- •5.2.Моменты, дисперсия, квадратичное отклонение

- •5.3.Закон равномерной плотности

- •5.4.Распределение Симпсона

- •5.5.Биномиальное распределение

- •5.6.Распределение Пуассона

- •5.7.Геометрическое распределение

- •5.5.Биномиальное распределение

- •5.6.Распределение Пуассона

- •5.7.Геометрическое распределение

- •5.8.Распределение Паскаля

- •5.9.Гипергеометрическое распределение

- •5.10.Формула Стирлинга

- •6.Непрерывные распределения

- •6.1.Нормальное распределение

- •6.2.Показательное распределение

- •6.3.Логарифмически нормальное распределение

- •7.Статистическая оценка параметров распределения

- •7.1.Статистическая функция распределения

- •7.2.Статистический ряд. Гистограмма

- •7.3.Числовые характеристики распределения

- •7.4.Оценка параметров распределения

- •7.4.1. Метод моментов.

- •8.Метод наибольшего правдоподобия

- •8.1.Случай дискретных распределений

- •8.2.Случай непрерывных распределений

- •8.3.Другие методы оценки параметров

- •9.Проверка статистических гипотез

- •9.1.Вводные замечания

- •9.2.Проверка гипотезы о законе распределения

- •10.Системы случайных величин

- •10.1.Понятие о системе случайных величин

- •10.2.Двумерные случайные величины и их законы распределения

- •10.3.Плотность распределения двумерной случайной величины

- •10.4. Условные законы распределения

- •10.5.Зависимость и независимость случайных величин

- •10.6.Числовые характеристики двумерных случайных величин

- •11.Двумерный нормальный закон распределения

- •12.Числовые характеристики функций случайных величин

- •12.1.Математическое ожидание и дисперсия функции

- •12.2.Теоремы о числовых характеристиках

- •13.Распределение функции случайных аргументов

- •13.1.Распределение функции одного аргумента

- •13.2.Распределение суммы случайных величин

- •13.3.Распределение суммы нормально распределенных случайных величин

- •13.Распределение функции случайных аргументов

- •13.1.Распределение функции одного аргумента

- •13.2.Распределение суммы случайных величин

- •13.3.Распределение суммы нормально распределенных случайных величин

- •14.Предельные теоремы

- •14.1.Понятие о законе больших чисел

- •14.2.Неравенство Чебышева

- •14.3.Закон больших чисел Чебышева

- •14.4.Центральная предельная теорема

8.Метод наибольшего правдоподобия

Рассмотренный выше метод моментов приводит обычно к относительно простым формулам для оценки параметров, однако в ряде случаев эти оценки малоэффективны или вовсе несостоятельны. Например, для применения метода моментов теоретические моменты должны существовать, что не для всех распределений выполняется. Например, у распределения Коши, имеющего плотность

,

,

все моменты бесконечны.

Распределение Фреше

![]()

имеет конечные моменты только порядка n<b,а именно начальные моменты

![]() .

.

Это значит, что методом моментов для оценки параметров а иb можно воспользоваться, еслиb>2. Но так как значение параметраb еще нужно определить, то использования метода моментов становится проблематичным.

Поэтому необходимы и другие методы, лишенные отмеченных недостатков.

Метод наибольшего правдоподобия обладает важным достоинством: он всегда приводит к состоятельным оценкам, имеющим наибольшую точность. Этот метод наилучшим образом использует всю информацию о неизвестных параметрах распределения, имеющуюся в выборке. Однако на практике он часто приводит к необходимости решать весьма сложные системы уравнений.

Метод наибольшего правдоподобия был предложен Р.Фишером, одним из основоположников математической статистики и является наиболее обоснованным и проверенным методом, широко используемом в математической статистике.

8.1.Случай дискретных распределений

Рассмотрим

случай оценки параметра распределения

дискретной случайной величины X,

вероятности значений которой определяются

согласно распределению![]() ,

где

,

где![]() - неизвестный параметр, который нужно

оценить по выборке

- неизвестный параметр, который нужно

оценить по выборке![]() .

.

Функция

![]()

называется функцией

правдоподобия. Если число случаев,

когда случайная величина Xприняла значения![]() равно соответственно

равно соответственно![]() ,

где

,

где![]() -

размер выборки, то функция правдоподобия

-

размер выборки, то функция правдоподобия

![]() .

(8.1.1)

.

(8.1.1)

Согласно

методу наибольшего правдоподобия в

качестве оценки неизвестного параметра

![]() принимается то значение, при котором

функция правдоподобия принимает

наибольшее значение для данной выборки.

То есть в качестве оценки для

принимается то значение, при котором

функция правдоподобия принимает

наибольшее значение для данной выборки.

То есть в качестве оценки для![]() берется наиболее вероятное значение

для данной выборки.

берется наиболее вероятное значение

для данной выборки.

Это значение находится в результате решения уравнения

![]() .

.

Практически удобнее находить максимум функции ln(L), тогда соответствующее уравнение примет вид:

![]() . (8.1.2)

. (8.1.2)

Это уравнение принято называть уравнением правдоподобия.Решение этого уравнения дает максимум функции правдоподобия, если для него выполняется условие

![]() .

.

Если распределение

имеет два пара параметра

![]() и

и![]() ,

то есть имеет вид

,

то есть имеет вид![]() ,

то для оценки этих параметров используются

система из двух уравнений правдоподобия:

,

то для оценки этих параметров используются

система из двух уравнений правдоподобия:

![]() . (8.1.3)

. (8.1.3)

При большем числе параметров число подобных уравнений соответственно увеличивается.

Проиллюстрируем применение метода наибольшего правдоподобия на примерах.

Пример 1. Приn-кратном повторении

опыта событиеАпроявилосьm

раз. Оценим вероятность событияАпо методу наибольшего правдоподобия.

Будем считать, что случайная величинаX принимает значение

1, если произошло событиеАи 0, если

произошло противоположное событие![]() .

.

Согласно (8.1.1) функция правдоподобия в данном случае имеет вид:

![]() ,

,

где

![]() - оцениваемая вероятность.

- оцениваемая вероятность.

После логарифмирования получаем, что

![]() .

.

После дифференцирования

по

![]() получаем следующее уравнение:

получаем следующее уравнение:

![]() ,

,

после решения которого получаем, что

![]() . (8.1.4)

. (8.1.4)

Крышечкой сверху будем отличать оценку параметра от его точного значения.

Формула

(8.1.4) уже известна из предыдущего изложения

- это оценка вероятности как частоты

события A. Эта оценка

состоятельна, то есть при![]() она сходится к вероятности этого события,

то есть

она сходится к вероятности этого события,

то есть

![]() .

Эта оценка также эффективна, то есть не

существует других более эффективных

оценок. Оценка так же несмещенная, то

есть её математическое ожидание равно

точному значению параметра:

.

Эта оценка также эффективна, то есть не

существует других более эффективных

оценок. Оценка так же несмещенная, то

есть её математическое ожидание равно

точному значению параметра:![]() Об этих свойствах оценок подробнее

поговорим позже.

Об этих свойствах оценок подробнее

поговорим позже.

Пример 2. Рассмотрим случай оценки параметра дискретной случайной величиныХ,распределенной по закону Пуассона

![]()

Согласно (8.1.1) функция правдоподобия равна

![]() .

.

После логарифмирования получаем

![]() .

.

После дифференцирования получаем:

![]() ,

,

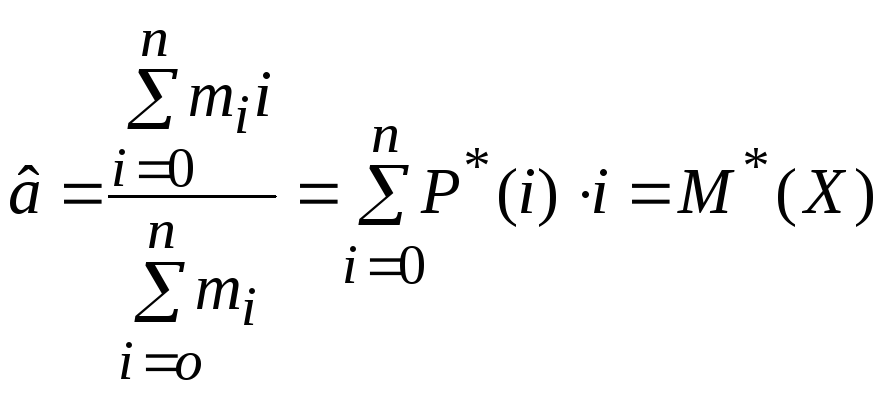

Откуда

,

(8.1.5)

,

(8.1.5)

где

![]() -

статистическая вероятность того, чтоX=i.

-

статистическая вероятность того, чтоX=i.

Таким образом, в качестве оценки параметра араспределения Пуассона следует брать статистическое среднее выборки.

Пример 3.Рассмотрим случай оценки параметра геометрического распределения дискретной случайной величиныX, которое задается законом

![]() .

.

Если значение

![]() в выборке размеромN,встретилосьmiраз, то функция правдоподобия

в выборке размеромN,встретилосьmiраз, то функция правдоподобия

![]() .

.

![]() .

.

После дифференцирования получаем:

![]() .

.

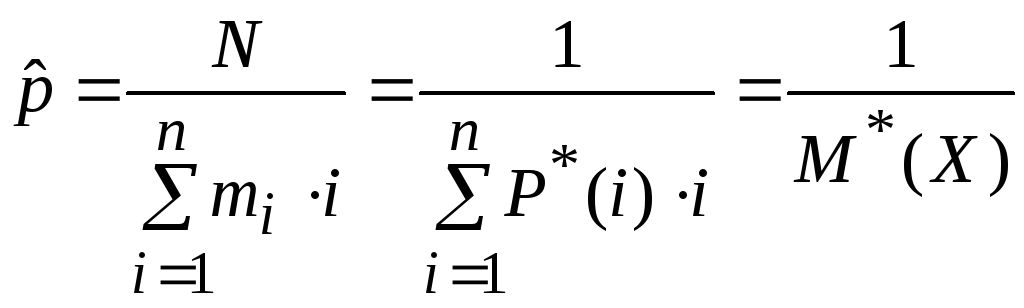

В результате решения этого уравнения получаем оценку для параметра p

. (8.1.6)

. (8.1.6)

Здесь

![]() -

статистическая вероятность того, что

-

статистическая вероятность того, что![]() .

.

Таким образом, оценкой

наибольшего правдоподобия параметра

pгеометрического

распределения является величина,

обратная выборочному среднему![]() .

.