- •Вопросы к экзамену и зачету по курсу

- •“Статистические методы обработки данных в экологии”

- •Сущность и цели обработки данных

- •Основные понятия математической статистики и теории вероятности

- •Качество данных. Этапы обработки данных. Вычислительные аспекты обработки данных

- •Разновидности исследований. Шкалы измерений

- •Описательная статистика: Закон распределения случайной величины

- •Описательная статистика: Числовые характеристики случайной величины

- •Построение гистограммы распределения

- •Проверка соответствия выбранной модели закона распределения исходным данным. Критерий согласия Колмогорова. Критерий согласия ω2 (омега-квадрат)

- •Проверка статистических гипотез. Основные понятия

- •Проверка гипотезы о равенстве двух средних зависимых нормальных выборок

- •Ранги и ранжирование

- •Непараметрический критерий Вилкоксона для проверки однородности двух независимых выборок.

- •Дисперсионный анализ. Цель и задачи дисперсионного анализа.

- •Sслучайные величины, описывающие неопределенные эффекты.

- •Однофакторный дисперсионный анализ

- •Доверительный интервал для среднего

- •Доверительный интервал для разности средних. Оценка эффекта

- •Оценка эффекта

- •Доверительный интервал для разности средних. Проверка статистических гипотез с помощью доверительных интервалов

- •Проверка статистических гипотез с помощью доверительных интервалов

- •Оценка эффектов уровней фактора

- •Примерами контрастов являются

- •Двухфакторный дисперсионный анализ с пересечением уровней

- •Проверка однородности дисперсий

- •Непараметрические методы факторного анализа. Ранговый однофакторный анализ.

- •Критерий Краскела-Уолллиса.

- •Непараметрические методы факторного анализа. Ранговый двухфакторный анализ без повторений

- •Критерий Фридмана

- •Корреляционный анализ. Постановка задач статистического исследования зависимостей

- •Измерители парной статистической связи. Корреляционное отношение

- •Коэффициент корреляции как измеритель степени тесноты связи

- •Оценка показателей тесноты связи по выборочным данным

- •Оценка показателя тесноты связи по выборочным данным. Анализ коэффициента корреляции

- •Оценка показателей тесноты связи по выборочным данным

- •Анализ коэффициента корреляции

- •Оценка степени тесноты связи при нелинейной зависимости

- •Анализ частных связей. Анализ множественных связей

- •Анализ частных связей

- •Анализ множественных связей

- •Ранговые коэффициенты корреляции

- •Коэффициент ранговой корреляции Спирмена

- •Коэффициент ранговой корреляции Кендалла

- •Зависимость между признаками, измеренными в номинальной или порядковой шкалах

- •Регрессионный анализ. Основные понятия регрессионного анализа

- •Метод наименьших квадратов

- •Простая линейная регрессия

- •Решение этих двух уравнений дает:

- •Проверка значимости линии регрессии

- •Проверка адекватности модели регрессии. Метод остатков

- •Доверительные интервалы для параметров простой линейной регрессии

- •Доверительные интервалы для линии регрессии. Доверительный интервал для значений зависимой переменной

- •Доверительный интервал для значений зависимой переменной

- •Проверка гипотез относительно параметров линейной регрессии

- •Сравнение двух линий регрессии путем сравнения параметров регрессионной модели

- •Обратная простая регрессия

- •Множественная линейная регрессия

- •Нелинейная регрессия

- •Оценка результата измерения: Виды измерений

- •Оценка результата измерения: Погрешности измерений

- •Обработка результатов наблюдений, распределенных по закону Пуассона

Обратная простая регрессия

В основе построения градировочных графиков, как правило, лежат методы линейной регрессии. Трудность построения и использования градуировок связана с так называемой проблемой обратной регрессии. Дело в том, что зависимая и независимая переменные меняются местами при использовании готового графика. То, что было независимой переменной, при измерении становится результатом, что порождает существенные проблемы.

Предположим, что необходимо провести калибровку манометра (датчика давления) и при этом известно, что показания манометра являются линейной функцией давления:

![]()

Ч то

можно записать в виде уравнения:

то

можно записать в виде уравнения:

Для калибровки манометра на него подают n контролируемых давлений xi (i = 1, 2,…, n) и считывают показания манометра yi. По этим данным подбирают уравнение

к оторое

можно использовать для оценивания

(предсказания) неизвестного давления

x0

при заданном показании манометра y0

оторое

можно использовать для оценивания

(предсказания) неизвестного давления

x0

при заданном показании манометра y0

В то же время для x0 можно рассчитать границы (1 − α) доверительного интервала:

где d1 и d2 – действительные несовпадающие корни уравнения:

Конечный доверительный интервал получается тогда и только тогда, когда

т . е. когда регрессия является значимой.

Если оценка x0 не попадает в границы интервала и , то доверительная область для x0 состоит их двух полупрямых.

Если же уравнение не имеет действительных корней, то доверительная область совпадает во всей действительной прямой.

Множественная линейная регрессия

Во многих практических задачах простая (однофакторная) линейная регрессия дает недостаточную информацию о зависимой переменной. Так, например, урожайность какой-либо культуры определяется несколькими факторами, такими как количество осадков, температура, влажность воздуха, физические и химические показатели почвы и т. д. В таких случаях обращаются к множественной регрессионной модели.

М одель

множественной линейной регрессии имеет

следующий вид:

одель

множественной линейной регрессии имеет

следующий вид:

Предположения относительно множественной линейной регрессии аналогичны тем, которые применялись для простой линейной регрессии. В частности, что все xi считаются фиксированными и для любого набора xi значения yi распределены по нормальному закону с постоянной дисперсией.

Д ля

получения оценок параметров b0,

b1,

...,bk

методом наименьших квадратов нужно

минимизировать по этим параметрам

выражение

ля

получения оценок параметров b0,

b1,

...,bk

методом наименьших квадратов нужно

минимизировать по этим параметрам

выражение

П риравняв

нулю частные производные

риравняв

нулю частные производные

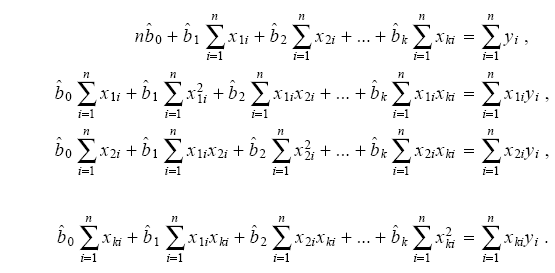

после упрощений получается следующая система нормальных уравнений для нахождения оценок параметров:

Пусть b – вектор-столбец размера (k+ 1), состоящий из коэффициентов b0 , b1, …, bk , y – вектор-столбец из n наблюдений, ε – вектор-столбец из n ошибок и X – матрица наблюдений размером n(k+ 1) :

Тогда уравнение модели регрессии можно записать в виде:

Выражение для D можно представить в матричном виде:

тогда вектор оценок b получается из решения системы уравнений:

решение которой имеет вид:

![]()

Н есмещенной

оценкой дисперсии является:

есмещенной

оценкой дисперсии является:

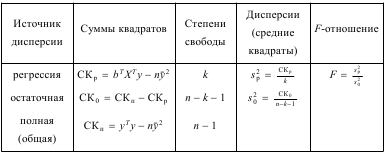

Дисперсионный анализ множественной линейной регрессии проводится в следующей таблице: