- •1.1. Методы искусственного интеллекта в прикладных системах и системах принятии решений

- •1.2. Интеллектуальные информационные технологии в прикладных системах и системах принятия решений

- •1.3. Типология задач интеллектуализации систем

- •Лекция 2. Представление знаний в интеллектуальных системах

- •2.1. Модели представления знаний

- •2.2. Системы, основанные на правилах

- •2.3. Системы, основанные на автоматическом доказательстве теорем

- •2.4. Системы, основанные на автоматическом порождении (выдвижении) гипотез

- •Лекция 3. Структура и основные компоненты прикладных интеллектуальных систем

- •3.1. Прикладные системы, основанные на знаниях

- •3.2. Структура системы управления, основанной на знаниях

- •3.3. Структура интеллектуальных систем поддержки принятия решения

- •3.4. Обобщенная структура экспертной системы

- •Лекция 4. Классификация прикладных интеллектуальных систем

- •4.1. Классификация экспертных систем

- •4.2. Примеры прикладных интеллектуальных систем

- •Лекция 5. Основные понятия и определения теории принятия решений

- •5.1. Роли людей в процессе принятия решений

- •5.2. Альтернативы

- •5.3. Критерии

- •5.4. Основные этапы процесса принятия решений

- •5.5. Математические методы теории принятия решений

- •Лекция 6. Принятие решений с помощью статистической проверки гипотез

- •6.1. Статистические решения

- •6.2. Основные задачи статистических решений

- •6.3. Статистическая проверка гипотез

- •6.4. Ошибки решения

- •6.5. Решающее правило при проверке гипотез

- •Лекция 7. Байесовская и последовательная процедуры принятия решения.

- •7.1. Байесовские процедуры принятия решения

- •7.1.1. Байесовская процедура при проверке простой гипотезы

- •7.1.2. Байесовские процедуры в задаче классификации

- •7.2. Принятие решения с помощью последовательной процедуры Вальда

- •Лекция 8. Принятие решения методом дискриминантнного анализа

- •8.1. Классификация в случае, когда распределения классов определены полностью

- •8.1.1. Модель двух нормальных распределений с общей ковариационной матрицей (модель Фишера)

- •8.1.2. Модель двух нормальных распределений с разными ковариационными матрицами

- •8.1.3. Модель нескольких нормальных распределений с общей ковариационной матрицей

- •8.2. Классификация при наличии обучающих выборок

- •8.2.1. Подстановочный алгоритм в модели Фишера

- •8.2.3. Правила классификации

- •8.3. Ошибка решающего правила

- •Лекция 9. Древообразные классификаторы

- •9.1. Назначение древообразных классификаторов

- •9.1. Структура дерева классификации

- •9.3. Вычислительные задачи древообразных классификаторов

- •9.3.1. Определение качества предсказания

- •9.3.2. Выбор разбиений

- •9.3.3. Определение правила прекращения разбиения

- •Лекция 10. Деревья решений

- •9.1. Характеристики дерева решений

- •9.2. Построение дерева решений

- •Лекция 11. Методы прогнозирования

- •11.1. Анализ временных рядов

- •11.1.1. Модель временного ряда

- •11.1.2. Тренд, сезонная и циклическая компоненты

- •11.1.3. Декомпозиция временного ряда

- •11.1.4. Экспоненциальное сглаживание

- •11.2. Каузальные методы прогнозирования

- •11.3. Качественные методы прогнозирования

- •Лекция 12. Основная задача линейного программирования

- •12.1. Математическая модель основной задачи линейного программирования

- •12.2. Задача линейного программирования с ограничениями-неравенствами

- •12.3. Примеры задач линейного программирования

- •12.3.1. Транспортная задача

- •12.3.2. Задача о назначениях

- •Лекция 13. Симплекс-метода решения задачи линейного программирования

- •13.1. Характеристика симплекс–метода

- •13.2. Табличный алгоритм замены базисных переменных

- •13.3. Отыскание опорного решения основной задачи линейного программирования

- •13.4. Отыскание оптимального решения основной задачи линейного программирования

- •Лекция 14. Многокритериальные методы принятия решений при объективных моделях

- •14.1. Объединение критериев

- •14.2. Метод главного критерия

- •14.3. Метод последовательных уступок

- •14.4. Метод целевого программирования

- •14.5. Метод, использующий принцип гарантированного результата

- •14.6. Метод равных наименьших относительных отклонений

- •14.7. Процедура STEM поиска удовлетворительных значений критериев

- •Лекция 15. Выбор Парето–оптимальных решений

- •15.1. Основные определения

- •15.2. Графическая интерпретация

- •15.3. Постановка задачи

- •Лекция 16. Оценка многокритериальных альтернатив с помощью теории полезности

- •16.1. Теория полезности

- •16.2. Принятие решения на основе значения ожидаемой полезности

- •16.3. Многокритериальная теория полезности (MAUT)

- •Лекция 17. Сравнение альтернатив методом аналитической иерархии

- •17.1. Основные этапы метода аналитической иерархии

- •17.2. Декомпозиция задачи

- •17.3. Попарное сравнение критериев и альтернатив

- •17.4. Свойства идеальной матрицы сравнений

- •Лекция 18. Приоритеты для критериев и альтернатив и выбор наилучшей альтернативы в методе анализа иерархий

- •18.1. Вычисление собственных характеристик обратно симметричной матрицы

- •18.2. Вычисление величины приоритетов

- •18.3. Определение наилучшей альтернативы

- •18.4. Проверка согласованности

- •18.5. Пример применения метода анализа иерархий

- •Лекция 19. Оценка многокритериальных альтернатив методами ELECTRE

- •19.1. Этапы подхода, направленного на разработку индексов попарного сравнения альтернатив

- •19.2. Свойства бинарных отношений

- •19.3. Метод ELECTRE I

- •19.4. Метод ELECTRE II

- •19.5. Метод ELECTRE III

- •Лекция 20. Основные понятия и математическая модель игровых методов обоснования решений

- •20.1. Основные понятия теории игр

- •20.2. Математическая модель игры

- •20.3. Нижняя и верхняя цена игры. Принцип минимакса

- •Лекция 21. Методы решения игр

- •21.1. Решение игры в чистых стратегиях

- •21.2. Решение игры в смешанных стратегиях

- •21.3. Упрощение игр

- •21.4. Решение игры 2х2

- •21.5. Графический метод решения (2х2)-игр

- •Лекция 22. Игры 2 х п

- •Лекция 23. Решение игр т х 2 и т х п

- •23.1. Решение игр т х 2

- •23.2. Решение игр т х п

- •Лекция 24. Критерии принятия решений в условиях риска и неопределенности

- •24.1. Основные понятия. Математическая модель

- •24.3. Максиминный критерий Вальда

- •24.4. Критерий минимаксного риска Сэвиджа

- •24.5. Критерий пессимизма-оптимизма Гурвица

- •Литература

Правило классификации на основании апостериорных вероятностей

Для принятия решения об отнесении объекта с описанием Х к классу Ωi , i = 1,…, m,

можно использовать байесовский подход, который заключается в вычислении и сравнении апостериорных вероятностей Р ( Ωi | х) принадлежности объекта классу Ωi . В этом случае решающее правило формулируется следующим образом:

классифицируемый объект х относится к классу i = 1, …, |

m, для |

которого значение апостериорной вероятности Р ( Ωi | х) |

является |

максимальным |

|

При предположениях нормальности распределений и равенства ковариационных матриц для т = 2 классов апостериорные вероятности равны

Р ( Ω1 | х) = |

p1exp(u) /( p2 + |

p1 exp(u)), |

Р ( Ω2 | х) = |

p2 exp(u) /( p2 + |

p1exp(u)). |

Если параметры нормальных распределений неизвестны, эти вероятности могут быть оценены по данным обучающей выборки как

ˆ |

| х) = |

p1exp(v) /( p2 + |

p1exp(v)), |

P ( Ω1 |

|||

ˆ |

| х) = |

p2 exp(v) /( p2 + |

p1 exp(v)), |

P ( Ω2 |

где v – значение функция классификации u (x) (8.2) после подстановки в нее оценок (8.7) и (8.8), полученных по обучающей выборке.

Правило классификации на основании расстояния Махаланобиса |

|

Правило классификации может быть построено на основании |

расстояния |

Махаланобиса (8.4): |

|

классифицируемое наблюдение будет относиться к тому классу, расстояние Махаланобиса до центра которого минимально

8.3. Ошибка решающего правила

Для определения ошибки решающего правила классифицируем экзаменационную выборку с помощью построенного решающего правила и вычислим частоту ошибочных решений. Результаты вычислений представляются в виде матрицы классификации, строками которой являются номера классов в экзаменационной выборке (наблюдаемый класс), а столбцами – решение, полученное на основании решающего правила (предсказанный класс).

Лекция 9. Древообразные классификаторы

9.1. Назначение древообразных классификаторов

Древообразные классификаторы применяются при классификации в случае, когда классы описаны путем указания всех входящих в них наблюдений. Число классов может быть произвольным. Задача принятия решения (выбора варианта действия из m ≥ 2 возможных) на основе древообразных классификаторов заключается в определении номера класса, к которому относится классифицируемое наблюдение. Деревья классификации – это способ представления правил классификации, на основании которых принимается решение, в виде иерархической структуры.

Рассмотрим случай двух классов:

V0 = {( xk , yk ), k = 1,…, n}, |

(9.1) |

46

где xk – вектор возможного значения наблюдения,

yk = 1, если наблюдение (объект) принадлежит первому классу, yk = 2, если

наблюдение (объект) принадлежит второму классу.

Будем считать, что новые наблюдения извлекаются наудачу и независимо друг от друга из ряда (9.1).

В основе описываемого метода лежит понятие бинарного дерева – графа. Эти деревья приято изображать в перевернутом виде: корень сверху, листья – внизу. Под словом «корень» понимаем самый верхний узел (вершину графа). Под словом «лист» понимается узел, из которого не выходят дуги (ребра) к расположенным ниже узлам (терминальный узел).

С каждым узлом t дерева связаны следующие объекты [15]: Rt – подмножество пространства наблюдений (R);

Vt – подмножество генеральной совокупности (9.1) с xk Rt ;

At – правило классификации из разрешенного набора правил для Х Rt .

Кроме того, для нетерминальных узлов вводится правило разбиения на два подмножества Rl(t) и Rr(t) таких, что Rl(t) Rr(t) = Rt и Rl(t) ∩ Rr(t) = Ο.

Древообразные классификаторы определяются рекурсивно. Для этого задаются

•критерий качества классификации на Rt ,

•разрешенный класс правил для построения At ,

•способ построения Rl(t) и Rr(t) ,

•способ объявления узла листом, т. е. правило прекращения последовательных разбиений. В качестве корневого (нулевого) узла принимается узел с R0 , совпадающий со

всем пространством возможных значений Х и V0 = {( xk , |

yk ), k = 1,…, n}. |

9.1. Структура дерева классификации |

|

Рассмотрим структуру дерева классификации, |

предназначенного для принятия |

решения о типе урагана. Данные представляют собой значения двух координат: долготы (Longitude) и широты (Latitude), при которых 37 штормов достигли ураганной силы. Штормы классифицируются как ураганы двух типов, возникающие в Северной Атлантике: BARO (бароклинические) и TROP (тропические).

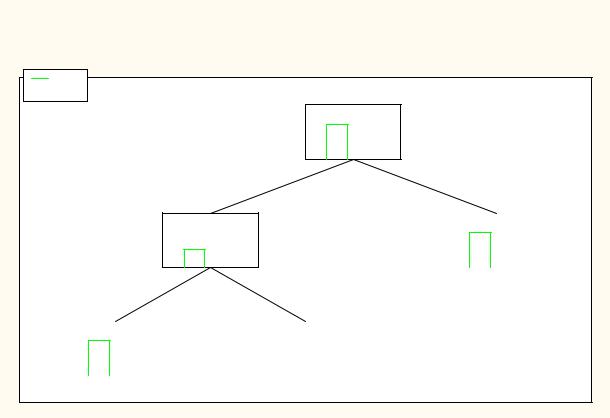

Ниже приводится дерево классификации (рис. 9.1).

Заглавие графа дает итоговую информацию о том, что дерево классификации имеет два разбиения и три терминальных узла. Терминальные узлы, или, как их иногда называют, листья, представляют собой узлы, в которых не принимается решение о дальнейшем разбиении. На графе терминальные узлы отмечаются пунктирной красной линией, в то время как остальные узлы решения отмечаются сплошной черной линией.

Построение дерева начинается с узла, называемого корнем. На графе он помечается цифрой 1 в левом верхнем углу. Первоначально все 37 ураганов приписываются корневому узлу и временно классифицируются как ураганы типа BARO, как указано меткой BARO в правом верхнем углу корневого узла. Тип BARO выбран в качестве начальной классификации, так как ураганов этого типа несколько больше, чем ураганов типа TROP. Это можно увидеть на гистограмме, расположенной внутри корневого узла. Легенда, идентифицирующая, какие столбцы гистограммы соответствуют ураганам типов BARO и TROP, расположена в верхнем левом углу графа.

47

|

|

Дерево классификации |

|

|

|

|

|

Классификационная переменная CLASS |

|

||

|

Число разбиений = 2; число терминальных узлов = 3 |

|

|||

BARO |

|

|

|

|

|

TROP |

|

|

|

|

|

|

|

|

1 |

BARO |

|

|

|

27 |

|

|

10 |

|

|

|

LONGITUD≤67,75 |

|

|

|

2 |

TROP |

|

3 |

BARO |

|

9 |

|

18 |

|

|

|

|

LONGITUD≤62,5 |

|

|

|

4 |

BARO |

5 |

TROP |

|

|

Рис. 5.1. Дерево классификации

Корневой узел разбивается, образуя два новых узла. Текст, находящийся ниже корневого узла, описывает условие разделения. В нем указано, что ураганы со значением координаты долгота (Longitude) меньше или равным 67,75, относятся к узлу 2 и предварительно классифицируются как ураганы типа TROP, а ураганы со значением координаты долгота (Longitude) больше 67,75, приписываются к узлу 3 и классифицируются как ураганы типа BARO. Значения 27 и 10, напечатанные над узлами 2 и 3 соответственно, указывают число наблюдений (объектов), отнесенных к каждому из этих двух дочерних узлов из их родительского (корневого) узла. Аналогичным образом производится разбиение в узле 2. В результате 9 ураганов со значением координаты долгота (Longitude) меньше или равным 62,5, относятся к узлу 4 и классифицируются как ураганы типа BARO, а остальные 18 ураганов со значением координаты долгота (Longitude) больше 62,5, приписываются к узлу 4 и классифицируются как ураганы типа TROP.

В каждом узле строится гистограмма распределения объектов по классам. Информация, связанная с построением дерева, представлена, в табл. 9.1.

|

|

|

Структура дерева классификации |

|

Таблица 9.1 |

|||

|

|

|

|

|

||||

Дерево |

|

Дочерние узлы, число наблюдений в классе (n), предсказываемый класс, |

||||||

|

|

|

|

условие разбиения в узле |

|

|

||

Узел |

Левая |

|

Правая |

n в классе |

n в классе |

Предсказан- |

Константа |

Разделяющая |

|

ветвь |

|

ветвь |

BARO |

TROP |

ный класс |

разбиения |

переменная |

1 |

2 |

|

3 |

19 |

18 |

BARO |

– 67.75 |

LONGITUDЕ |

2 |

4 |

|

5 |

9 |

18 |

TROP |

– 62.50 |

LONGITUDЕ |

3 |

|

|

|

10 |

0 |

BARO |

|

|

4 |

|

|

|

9 |

0 |

BARO |

|

|

5 |

|

|

|

0 |

18 |

TROP |

|

|

48