- •Введение

- •1. Структура и классификация сапр

- •1.1.Разновидности сапр

- •1.2.Функции, характеристики и примеры cae/cad/cam-систем

- •1.3.Понятие о cals-технологии

- •1.4.Комплексные автоматизированные системы

- •1.5.Системы управления в составе комплексных автоматизированных систем

- •1.6.Автоматизированные системы делопроизводства (асд)

- •2.Системы автоматизированного проектирования и их место среди других автоматизированных систем

- •3.Системные среды и программно-методические комплексы сапр

- •3.1.Функции сетевого программного обеспечения

- •3.1.1.Системы распределенных вычислений

- •3.1.2.Прикладные протоколы и телекоммуникационные информационные услуги

- •3.1.3.Информационная безопасность

- •3.2.Назначение и состав системных сред сапр

- •3.2.1.Системные среды автоматизированных систем

- •3.2.2.Подходы к интеграции по в сапр

- •3.2.3.Технологии интеграции по типа dde и ole

- •3.2.4.Управление данными в сапр

- •3.2.5.Варианты управления данными в сетях ас

- •3.2.6.Интеллектуальные серверы бд

- •3.2.7.Распределенные базы данных (рбд)

- •3.2.8.Программные средства управления проектированием в сапр

- •3.2.9.Примеры подсистем управления данными и проектированием

- •3.3.Инструментальные среды разработки программного обеспечения

- •3.3.1.Среды быстрой разработки приложений

- •3.3.2.Компонентно-ориентированные технологии

- •3.3.3.Пример реализации компонентно-ориентированной технологии в сапр

- •4.Системный подход к проектированию

- •4.1.Понятие инженерного проектирования

- •4.2.Принципы системного подхода

- •4.3.Основные понятия системотехники

- •5.Структура процесса проектирования

- •5.1.Иерархическая структура проектных спецификаций и иерархические уровни проектирования.

- •5.2.Стадии проектирования

- •5.3.Содержание технических заданий на проектирование

- •5.4.Классификация моделей и параметров, используемых при автоматизированном проектировании

- •5.5.Типовые проектные процедуры

- •6.Виды обеспечения и требования к их компонентам (гост 23501.101-87)

- •6.1.Программное обеспечение сапр

- •6.2.Информационное обеспечение сапр

- •6.3.Методическое обеспечение сапр

- •6.4.Математическое обеспечение сапр

- •6.5.Лингвистическое обеспечение сапр

- •6.6.Техническое обеспечение сапр

- •6.7.Организационное обеспечение сапр

- •7.Математическое моделирование автоматизированных систем

- •7.1.Математическое обеспечение анализа проектных решений

- •7.1.1.Математический аппарат в моделях разных иерархических уровней

- •7.1.2.Требования к математическим моделям и численным методам в сапр.

- •7.1.3.Место процедур формирования моделей в маршрутах проектирования

- •7.2.Математические модели в процедурах анализа на макроуровне

- •7.2.1.Исходные уравнения моделей

- •7.2.2.Примеры компонентных и топологических уравнений

- •7.2.3.Представление топологических уравнений

- •7.2.4.Особенности эквивалентных схем механических объектов.

- •7.2.5.Характеристика методов формирования ммс

- •7.2.6.Узловой метод

- •7.3.Методы и алгоритмы анализа на макроуровне

- •7.3.1.Выбор методов анализа во временной области

- •7.3.2.Алгоритм численного интегрирования соду

- •7.3.3.Методы решения систем нелинейных алгебраических уравнений

- •7.3.4.Методы решения систем линейных алгебраических уравнений

- •7.3.5.Анализ в частотной области

- •7.3.6.Многовариантный анализ

- •7.3.7.Организация вычислительного процесса в универсальных программах анализа на макроуровне.

- •7.4.Имитационное моделирование

- •7.4.1.Имитационное моделирование систем массового обслуживания

- •7.4.2.Событийный метод моделирования

- •7.4.3.Краткое описание языка срss

- •7.4.4.Сети Петри

- •7.4.5.Анализ сетей Петри

- •7.5.Математическое обеспечение синтеза проектных решений

- •7.5.1.Постановка задач параметрического синтеза

- •7.5.1.1.Место процедур синтеза в проектировании

- •7.5.1.2.Критерии оптимальности

- •7.5.1.3.Задачи оптимизации с учетом допусков

- •7.5.2.Обзор методов оптимизации

- •7.5.2.1.Классификация методов математического программирования

- •7.5.2.2.Методы одномерной оптимизации

- •7.5.2.3.Методы безусловной оптимизации

- •7.5.2.4.Необходимые условия экстремума

- •7.5.2.5.Методы поиска условных экстремумов.

- •7.5.3.Постановка задач структурного синтеза

- •7.5.3.1.Процедуры синтеза проектных решений

- •7.5.3.2.Задача принятия решений

- •7.5.3.3.Представление множества альтернатив

- •7.5.3.4.Морфологические таблицы

- •7.5.3.5.Альтернативные графы

- •7.5.3.6.Исчисления

- •7.5.4.Методы структурного синтеза в сапр

- •7.5.4.1.Системы искусственного интеллекта.

- •7.5.4.2.Дискретное математическое программирование

- •7.5.4.3.Элементы теории сложности

- •7.5.4.4.Эволюционные методы.

- •7.5.4.5.Постановка задачи поиска оптимальных решений с помощью генетических алгоритмов

- •7.5.4.6.Простой генетический алгоритм

- •7.5.4.7.Разновидности генетических операторов

- •7.5.4.8.Генетический метод комбинирования эвристик

- •8.Эффективность сапр

- •9.Понятие об открытых системах

- •9.1.История развития открытых систем

- •9.2.Существующие определения открытых систем и терминология

- •9.3.Различные подходы к понятию "открытые системы"

- •10.Технологии и стандарты информационной поддержки жизненного цикла изделий

- •Заключение

- •Библиографический список

- •Оглавление

- •394026 Воронеж, Московский просп., 14

7.5.2.4.Необходимые условия экстремума

В задачах безусловной оптимизации необходимые условия представляют собой равенство нулю градиента целевой функции

grad F(X) = 0.

В общей задаче математического программирования (7.35) необходимые условия экстремума, называемые условиями Куна-Таккера, формулируются следующим образом:

Для того чтобы точка Э была экстремальной точкой выпуклой задачи математического программирования (ЗМП), необходимо наличие неотрицательных коэффициентов ui, таких, что

-

ui φi(Э) = 0, i=l,2,...m;

(7.51)

и при этом соблюдались ограничения задачи, а также выполнялось условие

|

(7.52) |

где т – число ограничений типа неравенств, L – то же равенств, коэффициенты aj > 0.

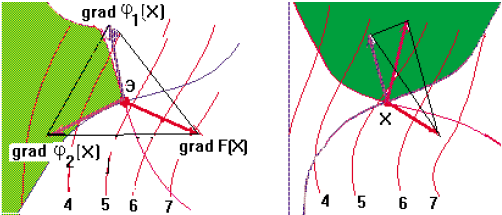

За приведенной абстрактной формулировкой условий скрывается достаточно просто понимаемый геометрический смысл. Действительно, рассмотрим сначала случай с ограничениями только типа неравенств. Если максимум находится внутри допустимой области R, то, выбирая все ui = 0, добиваемся выполнения (7.51); если же точка максимума Э лежит на границе области R, то, как видно из левой части рис. 7.26, эту точку всегда соответствующим подбором неотрицательных ui можно поместить внутрь оболочки, натянутой на градиенты целевой функции F(X) и функций-ограничений φi(Х). Наоборот, если точка не является экстремальной, то (7.51) нельзя выполнить при любом выборе положительных коэффициентов ui (см. правую часть рис. 7.26, где рассматриваемая точка X лежит вне выпуклой оболочки, натянутой на градиенты). Учет ограничений типа равенств очевиден, если добавляется последняя из указанных в (7.52) сумма.

Рисунок 7.26 – К пояснению условий Куна-Таккера

7.5.2.5.Методы поиска условных экстремумов.

Широко известен метод множителей Лагранжа, ориентированный на поиск экстремума при наличии ограничений типа равенств ψ(Х) = 0, т.е. на решение задачи

-

(7.53)

где R={Х | ψ(Х) = 0}.

Суть метода заключается в преобразовании задачи условной оптимизации (7.53) в задачу безусловной оптимизации с помощью образования новой целевой функции

![]()

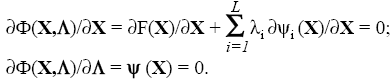

где λ = (λ1, λ2, λ3 ... λh) – вектор множителей Лагранжа, L – число ограничений. Необходимые условия экстремума функции Ф(Х):

-

(7.54)

Система (7.54) содержит n+L алгебраических уравнений, где п – размерность пространства управляемых параметров, ее решение дает искомые координаты экстремальной точки и значения множителей Лагранжа. Однако при численном решении (7.54), что имеет место при использовании алгоритмических моделей, возникают те же трудности, что и в методе Ньютона. Поэтому в САПР основными методами решения ЗМП являются методы штрафных функций и проекции градиента.

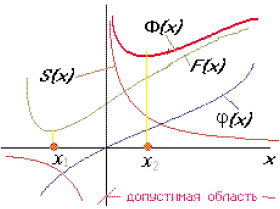

Основная идея методов штрафных функций – преобразование задачи условной оптимизации в задачу безусловной оптимизации путем формирования новой целевой функции Ф(Х) введением в исходную целевую функцию F(X) специальным образом выбранной функции штрафа S(X):

Ф(Х)=F(Х) + rS(Х),

где r – множитель, значения которого можно изменять в процессе оптимизации.

Среди методов штрафных функций различают методы внутренней и внешней точки. Согласно методам внутренней точки ( иначе называемым методами барьерных функций) исходную для поиска точку можно выбирать только внутри допустимой области, а для методов внешней точки как внутри, так и вне допустимой области (важно лишь, чтобы в ней функции целевая и ограничений были бы определены). Ситуация появления барьера у целевой функции Ф(х) и соотношение между условным в точке х2 и безусловным в точке xi минимумами F(x) в простейшем одномерном случае иллюстрируется рис. 7.27.

Рисунок 7.27 – Пояснение метода штрафных функций

Примеры штрафных функций:

1) для метода внутренней точки при ограничениях φi(Х)> О

![]()

где т – число ограничений типа неравенств;

2) для метода внешней точки при таких же ограничениях

![]()

здесь штраф сводится к включению в Ф(Х) суммы квадратов активных (т.е. нарушенных) ограничений;

3) в случае ограничений типа равенств ψi(Х) = 0

![]()

Чем больше коэффициент r, тем точнее решение задачи, однако при больших r может ухудшаться ее обусловленность. Поэтому в начале поиска обычно выбирают умеренные значения r, увеличивая их в окрестностях экстремума.

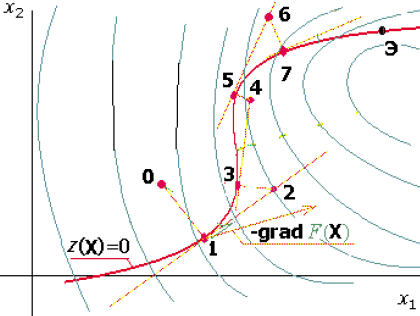

Основной вариант метода проекции градиента ориентирован на задачи математического программирования с ограничениями типа равенств.

Поиск при выполнении ограничений осуществляется в подпространстве (п-т) измерений, где п – число управляемых параметров, т – число ограничений, при этом движение осуществляется в направлении проекции градиента целевой функции F(X) на гиперплоскость, касательную к гиперповерхности ограничений (точнее к гиперповерхности пересечения гиперповерхностей ограничений).

Поиск минимума начинают со спуска из исходной точки на гиперповерхность ограничений. Далее выполняют шаг в указанном выше направлении (шаг вдоль гиперповерхности ограничений). Поскольку этот шаг может привести к заметному нарушению ограничений, вновь повторяют спуск на гиперповерхность ограничений и т.д. Другими cловами, поиск заключается в выполнении пар шагов, каждая пара включает спуск на гиперповерхность ограничений и движение вдоль гиперповерхности ограничений.

Идею метода легко пояснить для случая поиска в двумерном пространстве при одном ограничении ψ(Х) = 0. На рис. 7.28 это ограничение представлено жирной линией, а целевая функция – совокупностью более тонких линий равного уровня. Спуск обычно осуществляют по нормали к гиперповерхности ограничений (в данном случае к линии ограничения). Условие окончания поиска основано на сопоставлении значений целевой функции в двух последовательных точках, получаемых после спуска на гиперповерхность ограничений.

Рисунок 7.28 – Траектория поиска в соответствии с методом проекции градиента: Э - условный экстремум; 0,1,2,3 – точки на траектории поиска

Рассмотрим вопрос, касающийся получения аналитических выражений для направлений спуска и движения вдоль гиперповерхности ограничений.

Спуск. Необходимо из текущей точки поиска В попасть в точку А, являющуюся ближайшей к В точкой на гиперповерхности ограничений, т.е. решить задачу

min |B-A|

при условии ψ(Х) = 0, которое после линеаризации в окрестностях точки В имеет вид

ψ(B) + (grad ψ(B))T(A-B) = 0.

Используя метод множителей Лагранжа, обозначая A-B=U и учитывая, что минимизация расстояния равнозначна минимизации скалярного произведения U на U, запишем

Ф(А) = UTU + λ(ψ(B)+(grad ψ(В))TU);

-

dФ/dА = 2U + λ(grad ψ(В)) = 0;

(7.55)

dФ/dλ, = ψ(В) + (grad ψ(В))TU = 0.

(7.56)

Тогда из (7.55) получаем выражение

U = - 0,5λ (grad ψ(В)),

подставляя его в (7.65), имеем

ψ(В) - 0,5λ (grad ψ(В))Т grad ψ(В)= 0;

откуда

λ = (0,5(grad ψ(В))T grad ψ(В))-1 ψ(В).

и окончательно, подставляя А в (7.55), находим

U = - grad ψ(В) (grad ψ(В))T grad ψ(В))-1 ψ(В).

Движение вдоль гиперповерхности ограничений. Шаг в гиперплоскости D, касательной к гиперповерхности ограничений, следует сделать в направлении вектора S, на котором целевая функция уменьшается в наибольшей мере при заданном шаге h. Уменьшение целевой функции при переходе из точки А в новую точку С подсчитывают, используя формулу линеаризации F(X) в окрестностях точки А:

F(C) - F(A) = h(grad F(A))TS,

где grad F(A)TS – приращение F(X), которое нужно минимизировать, варьируя направления S

-

min F(C) = min ((grad F(A))TS),

(7.57)

где вариация S осуществляется в пределах гиперплоскости D; gradψ(A) и S – ортогональные векторы. Следовательно, минимизацию (7.57) необходимо выполнять при ограничениях

(grad ψ(A))TS = 0,

STS=1.

Последнее ограничение говорит о том, что при поиске направления движения, вектор S должен лишь указывать это направление, т.е. его длина несущественна (пусть S – единичный вектор). Для решения (7.57) используем метод множителей Лагранжа

Ф(S, λ,q) = (grad F(A))TS + λ(grad ψ(A))TS + q(STS - 1),

где λ и q – множители Лагранжа;

-

dФ/dS = grad F(A) + λ grad ψ(A) + qS = 0;

(7.58)

dФ/dλ, = (grad ψ(A))TS = 0;

(7.59)

dФ/dq = STS-1 = 0.

(7.60)

Из (7.58) следует, что

S = -(grad F(A) + λ grad ψ (A) )/q

подставляя S в (7.59), получаем

(grad ψ(A))Tgrad F(A) + λ (grad ψ(A))Tgrad ψ(A) = 0,

откуда

|

(7.61) |

Таким образом, матрица

P = E - grad ψ(A)[(grad ψ(A))Tgrad ψ(A)]-1 grad ψ(A))T

представляет собой проектирующую матрицу, а вектор S, рассчитанный по (7.61), – проекцию градиента grad F(A) на гиперповерхность ограничений.

Частным случаем применения метода проекции градиента являются задачи оптимизации с максиминным критерием. Действительно, для поиска экстремума функции минимума

![]()

где Zj - нормированная величина j-го выходного параметра yj удобно применять метод проекции градиента. В качестве ограничений задачи в исходной постановке фигурируют только прямые ограничения

xmax i>xi>xmin i

Здесь xmax i и xmin i – граничные значения допустимого диапазона варьирования параметра хi. В процессе поиска, если минимальной является функция Zq(X) и траектория поиска пересекает гребень

-

Zq(X) - Zk(X) = 0,

(7.62)

то поиск продолжается в направлении проекции градиента функции Zq(X) на гиперповерхность гребня (7.62).