- •Введение

- •1. Структура и классификация сапр

- •1.1.Разновидности сапр

- •1.2.Функции, характеристики и примеры cae/cad/cam-систем

- •1.3.Понятие о cals-технологии

- •1.4.Комплексные автоматизированные системы

- •1.5.Системы управления в составе комплексных автоматизированных систем

- •1.6.Автоматизированные системы делопроизводства (асд)

- •2.Системы автоматизированного проектирования и их место среди других автоматизированных систем

- •3.Системные среды и программно-методические комплексы сапр

- •3.1.Функции сетевого программного обеспечения

- •3.1.1.Системы распределенных вычислений

- •3.1.2.Прикладные протоколы и телекоммуникационные информационные услуги

- •3.1.3.Информационная безопасность

- •3.2.Назначение и состав системных сред сапр

- •3.2.1.Системные среды автоматизированных систем

- •3.2.2.Подходы к интеграции по в сапр

- •3.2.3.Технологии интеграции по типа dde и ole

- •3.2.4.Управление данными в сапр

- •3.2.5.Варианты управления данными в сетях ас

- •3.2.6.Интеллектуальные серверы бд

- •3.2.7.Распределенные базы данных (рбд)

- •3.2.8.Программные средства управления проектированием в сапр

- •3.2.9.Примеры подсистем управления данными и проектированием

- •3.3.Инструментальные среды разработки программного обеспечения

- •3.3.1.Среды быстрой разработки приложений

- •3.3.2.Компонентно-ориентированные технологии

- •3.3.3.Пример реализации компонентно-ориентированной технологии в сапр

- •4.Системный подход к проектированию

- •4.1.Понятие инженерного проектирования

- •4.2.Принципы системного подхода

- •4.3.Основные понятия системотехники

- •5.Структура процесса проектирования

- •5.1.Иерархическая структура проектных спецификаций и иерархические уровни проектирования.

- •5.2.Стадии проектирования

- •5.3.Содержание технических заданий на проектирование

- •5.4.Классификация моделей и параметров, используемых при автоматизированном проектировании

- •5.5.Типовые проектные процедуры

- •6.Виды обеспечения и требования к их компонентам (гост 23501.101-87)

- •6.1.Программное обеспечение сапр

- •6.2.Информационное обеспечение сапр

- •6.3.Методическое обеспечение сапр

- •6.4.Математическое обеспечение сапр

- •6.5.Лингвистическое обеспечение сапр

- •6.6.Техническое обеспечение сапр

- •6.7.Организационное обеспечение сапр

- •7.Математическое моделирование автоматизированных систем

- •7.1.Математическое обеспечение анализа проектных решений

- •7.1.1.Математический аппарат в моделях разных иерархических уровней

- •7.1.2.Требования к математическим моделям и численным методам в сапр.

- •7.1.3.Место процедур формирования моделей в маршрутах проектирования

- •7.2.Математические модели в процедурах анализа на макроуровне

- •7.2.1.Исходные уравнения моделей

- •7.2.2.Примеры компонентных и топологических уравнений

- •7.2.3.Представление топологических уравнений

- •7.2.4.Особенности эквивалентных схем механических объектов.

- •7.2.5.Характеристика методов формирования ммс

- •7.2.6.Узловой метод

- •7.3.Методы и алгоритмы анализа на макроуровне

- •7.3.1.Выбор методов анализа во временной области

- •7.3.2.Алгоритм численного интегрирования соду

- •7.3.3.Методы решения систем нелинейных алгебраических уравнений

- •7.3.4.Методы решения систем линейных алгебраических уравнений

- •7.3.5.Анализ в частотной области

- •7.3.6.Многовариантный анализ

- •7.3.7.Организация вычислительного процесса в универсальных программах анализа на макроуровне.

- •7.4.Имитационное моделирование

- •7.4.1.Имитационное моделирование систем массового обслуживания

- •7.4.2.Событийный метод моделирования

- •7.4.3.Краткое описание языка срss

- •7.4.4.Сети Петри

- •7.4.5.Анализ сетей Петри

- •7.5.Математическое обеспечение синтеза проектных решений

- •7.5.1.Постановка задач параметрического синтеза

- •7.5.1.1.Место процедур синтеза в проектировании

- •7.5.1.2.Критерии оптимальности

- •7.5.1.3.Задачи оптимизации с учетом допусков

- •7.5.2.Обзор методов оптимизации

- •7.5.2.1.Классификация методов математического программирования

- •7.5.2.2.Методы одномерной оптимизации

- •7.5.2.3.Методы безусловной оптимизации

- •7.5.2.4.Необходимые условия экстремума

- •7.5.2.5.Методы поиска условных экстремумов.

- •7.5.3.Постановка задач структурного синтеза

- •7.5.3.1.Процедуры синтеза проектных решений

- •7.5.3.2.Задача принятия решений

- •7.5.3.3.Представление множества альтернатив

- •7.5.3.4.Морфологические таблицы

- •7.5.3.5.Альтернативные графы

- •7.5.3.6.Исчисления

- •7.5.4.Методы структурного синтеза в сапр

- •7.5.4.1.Системы искусственного интеллекта.

- •7.5.4.2.Дискретное математическое программирование

- •7.5.4.3.Элементы теории сложности

- •7.5.4.4.Эволюционные методы.

- •7.5.4.5.Постановка задачи поиска оптимальных решений с помощью генетических алгоритмов

- •7.5.4.6.Простой генетический алгоритм

- •7.5.4.7.Разновидности генетических операторов

- •7.5.4.8.Генетический метод комбинирования эвристик

- •8.Эффективность сапр

- •9.Понятие об открытых системах

- •9.1.История развития открытых систем

- •9.2.Существующие определения открытых систем и терминология

- •9.3.Различные подходы к понятию "открытые системы"

- •10.Технологии и стандарты информационной поддержки жизненного цикла изделий

- •Заключение

- •Библиографический список

- •Оглавление

- •394026 Воронеж, Московский просп., 14

7.5.1.3.Задачи оптимизации с учетом допусков

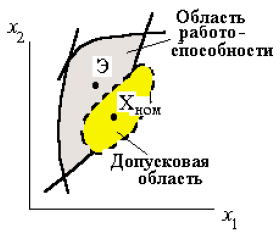

Содержательную сторону оптимизации с учетом допусков поясняет рис. 7.19, на котором представлены области работоспособности и допусковая в двумерном пространстве управляемых параметров. Если собственно допуски заданы и не относятся к управляемым параметрам, то цель оптимизации – максимальным образом совместить эти области так, чтобы вероятность выхода за пределы области работоспособности была минимальной.

Рисунок 7.19 – Области допусковая и

работоспособности

Решение этой задачи исключительно трудоемко, так как на каждом шаге оптимизации нужно выполнять оценку упомянутой вероятности методами статистического анализа, а для сложных моделей объектов таким методом является метод статистических испытаний. Поэтому на практике подобные задачи решают, принимая те ИЛИ иные допущения.

Например, если допустить, что цель оптимизации достигается при совмещении центров областей работоспособности Э и допусковой Хном, то оптимизация сводится к задаче центрирования, т.е. к определению центра Э. Задачу центрирования обычно решают путем предварительного нормирования управляемых параметров хi с последующим вписыванием гиперкуба с максимально возможными размерами в нормированную область работоспособности.

Примечание. Нормирование проводят таким образом, что допусковая область приобретает форму гиперкуба, получающегося после нормирования.

Очевидно, что решение задачи центрирования позволяет не только оптимизировать номинальные значения проектных параметров, но и их допуски, если последние относятся к управляемым параметрам.

7.5.2.Обзор методов оптимизации

7.5.2.1.Классификация методов математического программирования

В САПР основными методами оптимизации являются поисковые методы. Поисковые методы основаны на пошаговом изменении управляемых параметров

-

Хk+1 = Хk, + ΔХk

(7.39)

где в большинстве методов приращение ΔХk вектора управляемых параметров вычисляется по формуле

-

ΔХk=hg(Xk).

(7.40)

Здесь Xk – значение вектора управляемых параметров на k-м шаге, h – шаг, a g(Xk) – направление поиска. Следовательно, если выполняются условия сходимости, то реализуется пошаговое (итерационное) приближение к экстремуму.

Методы оптимизации классифицируют по ряду признаков.

В зависимости от числа управляемых параметров различают методы одномерной и многомерной оптимизации, в первых из них управляемый параметр единственный, во вторых размер вектора X не менее двух. Реальные задачи в САПР многомерны, методы одномерной оптимизации играют вспомогательную роль на отдельных этапах многомерного поиска.

Различают методы условной и безусловной оптимизации по наличию или отсутствию ограничений. Для реальных задач характерно наличие ограничений, однако методы безусловной оптимизации также представляют интерес, поскольку задачи условной оптимизации с помощью специальных методов могут быть сведены к задачам без ограничений.

В зависимости от числа экстремумов различают задачи одно- и многоэкстремальные. Если метод ориентирован на определение какого-либо локального экстремума, то такой метод относится к локальным методам. Если же результатом является глобальный экстремум, то метод называют методом глобального поиска. Удовлетворительные по вычислительной эффективности методы глобального поиска для общего случая отсутствуют и потому на практике в САПР используют методы поиска локальных экстремумов.

Наконец, в зависимости от того, используются при поиске производные целевой функции по управляемым параметрам или нет, различают методы нескольких порядков. Если производные не используются, то имеет место метод нулевого порядка, если используются первые или вторые производные, то соответственно метод первого или второго порядка. Методы первого порядка называют также градиентными, поскольку вектор первых производных F(X) по X есть градиент целевой функции

grad (F(X)) = (dF/dx1, dF/dx2,...dF/dxn).

Конкретные методы определяются следующими факторами:

способом вычисления направления поиска g(Xk) в формуле (7.40);

способом выбора шага h;

способом определения окончания поиска.

Определяющим фактором является первый из перечисленных в этом списке, он подробно описан ниже.

Шаг может быть или постоянным, или выбираться исходя из одномерной оптимизации – поиска минимума целевой функции в выбранном направлении g(Xk). В последнем случае шаг будем называть оптимальным.

Окончание поиска обычно осуществляют по правилу: если на протяжении г подряд идущих шагов траектория поиска остается в малой е-окрестности текущей точки поиска Хь то поиск следует прекратить, следовательно, условие окончания поиска имеет вид | Xk - Xk-r |<ε.