- •В. И. Дмитриев

- •Глава 1 Математические модели сигналов…………………………………………...19

- •Глава 1 математические модели сигналов

- •§ 1.1. Понятия сигнала и его модели

- •§ 1.2. Формы представления детерминированных сигналов

- •§ 1.3. Временная форма представления сигнала

- •§ 1.4. Частотная форма представления сигнала

- •§ 1.5. Соотношения между длительностью импульсов и шириной их спектров

- •§ 1.6. Спектральная плотность мощности детерминированного сигнала

- •§ 1.7. Функция автокорреляции детерминированного сигнала

- •§ 1.8. Случайный процесс как модель сигнала

- •§ 1.9. Стационарные и эргодические случайные процессы

- •§ 1.10. Спектральное представление случайных сигналов

- •§ 1.11. Частотное представление стационарных

- •Глава 2. Преобразование непрерывных сигналов в дискретные

- •§ 2.1. Преимущества цифровой формы представления сигналов

- •§ 2.2. Общая постановка задачи дискретизации

- •Воспроизводящая функция представляется аппроксимирующим полиномом

- •§ 2.3. Способы восстановления непрерывного сигнала

- •§ 2.4. Критерии качества восстановления

- •§ 2.5. Методы дискретизации посредством выборок

- •§ 2.6. Равномерная дискретизация. Теорема котельникова

- •§ 2.7. Теоретические и практические аспекты использования теоремы котельникова

- •§ 2.8. Дискретизация по критерию наибольшего отклонения

- •Оценка снизу для остаточного члена имеет вид

- •§ 2.9. Адаптивная дискретизация

- •Момент очередного отсчета определяется выполнением равенства

- •§ 2.10. Квантование сигналов

- •§ 2.11. Квантование сигналов при наличии помех

- •§ 2.12. Геометрическая форма представления сигналов

- •Контрольные вопросы

- •Глава 3. Количественная оценка информации

- •§ 3.1. Энтропия как мера неопределенности выбора

- •§ 3.2 Свойства энтропии

- •§ 3.3. Условная энтропия и ее свойства

- •§ 3.4. Энтропия непрерывного источника информации (дифференциальная энтропия)

- •§ 3.5. Свойства дифференциальной энтропии

- •§ 3.6. Количество информации как мера снятой неопределенности

- •§ 3.7. Эпсилон-энтропия случайной величины

- •Контрольные вопросы

- •Глава 4. Информационные характеристики источника сообщений и канала связи

- •§ 4.1. Основные понятия и определения

- •§ 4.2. Информационные характеристики источника дискретных сообщений

- •§ 4.3 Информационные характеристики дискретных каналов связи

- •§ 4.4. Информационные характеристики источника непрерывных сообщений

- •§ 4.5. Информационные характеристики непрерывных каналов связи

- •§ 4.6. Согласование физических характеристик сигнала и канала

- •§ 4.7. Согласование статистических свойств источника сообщений и канала связи

- •Глава 5. Кодирование информации при передаче по дискретному каналу без помех

- •§ 5.1. Кодирование как процесс выражения информации в цифровом виде

- •111 100 101

- •§ 5.2. Технические средства представления информации в цифровой форме

- •§ 5.3. Кодирование как средство криптографического закрытия информации

- •§ 5.4. Эффективное кодирование

- •§ 5.5. Технические средства кодирования

- •Глава 6. Кодирование информации при передаче

- •§ 6.1. Основная теорема шеннона о кодировании

- •§ 6.2. Разновидности помехоустойчивых кодов

- •§ 6.3. Блоковые коды

- •§ 6.4. Построение двоичного группового кода

- •0...01001, 0...01010, 0...01100.

- •§ 6.5. Технические средства кодирования и декодирования для групповых кодов

- •§ 6.6. Построение циклических кодов

- •§ 6.7. Выбор образующего многочлена по заданному объему кода и заданной корректирующей способности

- •§ 6.8 Технические средства кодирования и декодирования для циклических кодов

- •Остатки Векторы ошибок Опознаватели

- •Остатки Векторы ошибок Остатки

- •§ 6.9. Коды боуза — чоудхури — хоквингема

- •§ 6.10. Итеративные коды

- •Число ошибок такого вида в4 для блока изlхn символов равно

- •§ 6.11 Сверточные коды

- •Контрольные вопросы

- •Заключение

- •Список литературы

- •Приложения

§ 1.9. Стационарные и эргодические случайные процессы

Случайные процессы различаются по степени однородности протекания их во времени. В общем случае процесс может иметь определенную тенденцию развития и характеристики, зависящие от начала отсчета времени. Такие случайные процессы называются нестационарными.

Для описания сигнала математическая модель в виде нестационарного случайного процесса подходит наилучшим образом, но неконструктивна в силу своей чрезмерной сложности.

Поэтому очень часто вводят предположение о стационарности случайного процесса, что позволяет существенно упростить математический аппарат исследования.

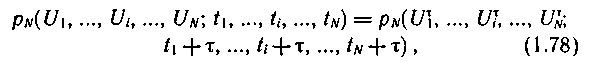

Случайный процесс называют стационарным в узком смысле, если выражения для плотностей вероятности не зависят от начала отсчета времени, т. е. справедливо соотношение

где

U![]() —случайная

величина, отражающая значение процесса

в момент времени t

= ti

+ τ

(τ

— произвольное число).

—случайная

величина, отражающая значение процесса

в момент времени t

= ti

+ τ

(τ

— произвольное число).

Иначе

говоря, стационарность процесса

предполагает его существование и

статистическую однородность во всем

диапазоне времени от -![]() до +

до +![]() .

.

Такое предположение противоречит физическим свойствам реальных сигналов, в частности тому, что всякий реальный сигнал существует лишь в течение конечного отрезка времени. Однако аналогично установившимся детерминированным процессам случайные процессы, протекающие в установившемся режиме системы при неизменных внешних условиях на определенных отрезках времени, с известным приближением можно рассматривать как стационарные.

При решении многих технических задач идут на дальнейшее упрощение модели, рассматривая случайный процесс стационарным в широком смысле. Процесс U(t) принято называть стационарным в широком смысле, если выполняется условие постоянства математического ожидания и дисперсии, а корреляционная функция не зависит от начала отсчета времени и является функцией только одного аргумента τ = t2 - t1, т.е.

Так как условие постоянства дисперсии является частным случаем требования к корреляционной функции при τ = 0:

![]()

то выполнения соотношений (1.79) и (1.81) достаточно, чтобы рассматривать случайный процесс U(t) как стационарный.

Всякий стационарный случайный процесс является стационарным в широком смысле. В дальнейшем, если это не оговорено особо, стационарность будем рассматривать в широком смысле.

Случайные процессы, наблюдаемые в устойчиво работающих реальных системах, имеют конечное время корреляции. Поэтому для стационарных процессов, представляющих практический интерес, справедливо соотношение

![]()

Если для случайного процесса равенства (1.79), (1.81) не выдерживаются, но на интересующем нас интервале времени изменением указанных параметров можно пренебречь, его называют квазистационарным.

Среди стационарных случайных процессов многие удовлетворяют свойству эргодичности. Оно проявляется в том, что каждая реализация случайного процесса достаточной продолжительности несет практически полную информацию о свойствах всего ансамбля реализаций, что позволяет существенно упростить процедуру определения статистических характеристик, заменяя усреднение значений по ансамблю реализаций усреднением значений одной реализации за длительный интервал времени.

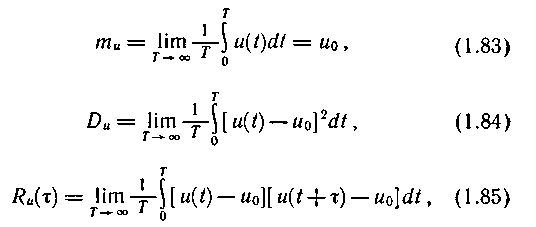

Следовательно, для стационарных эргодических процессов справедливы соотношения

где u(t) — конкретная реализация случайного процесса U(t).

Результаты исследования случайных процессов в их временном представлении, т. е. с использованием формул (1.83) и (1.85), лежат в основе корреляционной теории сигналов.

Для облегчения практического определения корреляционных функций в соответствии с (1.85) серийно выпускаются специальные вычислительные устройства — коррелометры (корреляторы).