- •В. И. Дмитриев

- •Глава 1 Математические модели сигналов…………………………………………...19

- •Глава 1 математические модели сигналов

- •§ 1.1. Понятия сигнала и его модели

- •§ 1.2. Формы представления детерминированных сигналов

- •§ 1.3. Временная форма представления сигнала

- •§ 1.4. Частотная форма представления сигнала

- •§ 1.5. Соотношения между длительностью импульсов и шириной их спектров

- •§ 1.6. Спектральная плотность мощности детерминированного сигнала

- •§ 1.7. Функция автокорреляции детерминированного сигнала

- •§ 1.8. Случайный процесс как модель сигнала

- •§ 1.9. Стационарные и эргодические случайные процессы

- •§ 1.10. Спектральное представление случайных сигналов

- •§ 1.11. Частотное представление стационарных

- •Глава 2. Преобразование непрерывных сигналов в дискретные

- •§ 2.1. Преимущества цифровой формы представления сигналов

- •§ 2.2. Общая постановка задачи дискретизации

- •Воспроизводящая функция представляется аппроксимирующим полиномом

- •§ 2.3. Способы восстановления непрерывного сигнала

- •§ 2.4. Критерии качества восстановления

- •§ 2.5. Методы дискретизации посредством выборок

- •§ 2.6. Равномерная дискретизация. Теорема котельникова

- •§ 2.7. Теоретические и практические аспекты использования теоремы котельникова

- •§ 2.8. Дискретизация по критерию наибольшего отклонения

- •Оценка снизу для остаточного члена имеет вид

- •§ 2.9. Адаптивная дискретизация

- •Момент очередного отсчета определяется выполнением равенства

- •§ 2.10. Квантование сигналов

- •§ 2.11. Квантование сигналов при наличии помех

- •§ 2.12. Геометрическая форма представления сигналов

- •Контрольные вопросы

- •Глава 3. Количественная оценка информации

- •§ 3.1. Энтропия как мера неопределенности выбора

- •§ 3.2 Свойства энтропии

- •§ 3.3. Условная энтропия и ее свойства

- •§ 3.4. Энтропия непрерывного источника информации (дифференциальная энтропия)

- •§ 3.5. Свойства дифференциальной энтропии

- •§ 3.6. Количество информации как мера снятой неопределенности

- •§ 3.7. Эпсилон-энтропия случайной величины

- •Контрольные вопросы

- •Глава 4. Информационные характеристики источника сообщений и канала связи

- •§ 4.1. Основные понятия и определения

- •§ 4.2. Информационные характеристики источника дискретных сообщений

- •§ 4.3 Информационные характеристики дискретных каналов связи

- •§ 4.4. Информационные характеристики источника непрерывных сообщений

- •§ 4.5. Информационные характеристики непрерывных каналов связи

- •§ 4.6. Согласование физических характеристик сигнала и канала

- •§ 4.7. Согласование статистических свойств источника сообщений и канала связи

- •Глава 5. Кодирование информации при передаче по дискретному каналу без помех

- •§ 5.1. Кодирование как процесс выражения информации в цифровом виде

- •111 100 101

- •§ 5.2. Технические средства представления информации в цифровой форме

- •§ 5.3. Кодирование как средство криптографического закрытия информации

- •§ 5.4. Эффективное кодирование

- •§ 5.5. Технические средства кодирования

- •Глава 6. Кодирование информации при передаче

- •§ 6.1. Основная теорема шеннона о кодировании

- •§ 6.2. Разновидности помехоустойчивых кодов

- •§ 6.3. Блоковые коды

- •§ 6.4. Построение двоичного группового кода

- •0...01001, 0...01010, 0...01100.

- •§ 6.5. Технические средства кодирования и декодирования для групповых кодов

- •§ 6.6. Построение циклических кодов

- •§ 6.7. Выбор образующего многочлена по заданному объему кода и заданной корректирующей способности

- •§ 6.8 Технические средства кодирования и декодирования для циклических кодов

- •Остатки Векторы ошибок Опознаватели

- •Остатки Векторы ошибок Остатки

- •§ 6.9. Коды боуза — чоудхури — хоквингема

- •§ 6.10. Итеративные коды

- •Число ошибок такого вида в4 для блока изlхn символов равно

- •§ 6.11 Сверточные коды

- •Контрольные вопросы

- •Заключение

- •Список литературы

- •Приложения

§ 3.7. Эпсилон-энтропия случайной величины

Ранее было показано, что неопределенность реализации непрерывным источником информации состояния в конкретный момент времени (отсчета) равна бесконечности. Тем более равна бесконечности неопределенность реализации непрерывным источником конкретного сигнала длительности Т.

Однако такой результат получен в предположении возможности фиксировать любые сколь угодно малые различия между реализациями. На практике такая возможность отсутствует. Это объясняется тем, что воспринимающие информацию датчики, включая человека, обладают ограниченной чувствительностью и конечной разрешающей способностью, а также тем, что процесс восприятия сопровождается помехами.

Если учесть, что нас интересует приближенное восприятие реализации, то количество информации, приходящееся на отсчет или на единицу времени, можно вычислить.

Ограничимся рассмотрением простейшего случая, когда отдельные состояния источника информации представляют собой независимые реализации случайной величины U. (Эпсилон - энтропия случайного процесса рассмотрена в § 4.4.)

Ансамбль реализаций случайной величины U описывается плотностью распределения вероятностей р(u). О значениях случайной величины U можно судить по значениям другой случайной величины Ζ, если мера их различия не превышает заданной верности воспроизведения. В этом случае говорят, что Ζ воспроизводит U.

Для количественной оценки степени сходства сигналов целесообразно ввести какую-либо функцию ρ(z, u), имеющую природу «расстояния». Тогда удобным критерием верности V(Z, U) является среднее значение функции p(z, u), взятое по всему множеству значений z и u:

![]()

где ρ(z, u) — плотность совместного распределения вероятностей величин Ζ и U.

Наиболее широко используется среднеквадратический критерий, при котором ρ(z, u) представляет собой квадрат обычного евклидова расстояния между точками в соответствующем пространстве (см. § 2.12).

Требование к верности в данном случае задается с использованием критерия V(ZU):

![]()

где

![]() — условная

плотность распределения — функция

правдоподобия того, что конкретный

сигнал u

будет воспроизведен как сигнал z;

ε

— заданное значение верности.

— условная

плотность распределения — функция

правдоподобия того, что конкретный

сигнал u

будет воспроизведен как сигнал z;

ε

— заданное значение верности.

Так

как плотность р(u)

определена, то для выполнения условия

(3.60) варьировать можно только условной

плотностью распределения

![]() .

.

Если случайная величина Ζ воспроизводит случайную величину U с некоторой верностью ε, то количество информации, содержащееся в воспроизводящей величине Ζ относительно U, конечно и в соответствии с (3.54) может быть записано в форме

![]()

где

![]()

- плотность воспроизводящей величины Ζ.

Желательно

обеспечить заданную верность

воспроизведения при минимальном

количестве получаемой информации.

Поэтому среди множества функций

![]() ,

удовлетворяющих

условию (3.60), целесообразно выбрать

такую, которая обеспечивает наименьшее

I(ZU)

[10, 35].

,

удовлетворяющих

условию (3.60), целесообразно выбрать

такую, которая обеспечивает наименьшее

I(ZU)

[10, 35].

Минимальное

количество информации в одной случайной

величине Ζ

относительно другой U,

при котором

удовлетворяется заданное требование

к верности воспроизведения величины

U,

называется

ε-энтропией

величины U

и обозначается

![]() :

:

![]()

при

![]()

Используя

безусловную

![]() и условную

и условную

![]() дифференциальные

энтропии величины U,

выражение

(3.63) можно представить в виде

дифференциальные

энтропии величины U,

выражение

(3.63) можно представить в виде

![]()

где

![]() — условная

плотность вероятности того, что в тех

случаях, когда был принят сигнал z,

передавался сигнал u.

— условная

плотность вероятности того, что в тех

случаях, когда был принят сигнал z,

передавался сигнал u.

Пример

3.9. Найти

![]() источника

информации, ансамбль состояний которого

описывается нормально распределенной

случайной величиной U

с дисперсией

источника

информации, ансамбль состояний которого

описывается нормально распределенной

случайной величиной U

с дисперсией

![]() при верности воспроизведения

при верности воспроизведения![]() .

.

Будем

считать, что заданная верность

воспроизведения обусловлена действием

аддитивной статистически не связанной

с сигналом помехой Ξ,

причем Μ

[Ξ]

=0 и Μ[Ξ![]() ]

= ε

]

= ε![]() .

Передаваемый сигнал u

рассматриваем как сумму воспроизводящего

сигнала z

и помехи u=z+

.

Передаваемый сигнал u

рассматриваем как сумму воспроизводящего

сигнала z

и помехи u=z+![]() .

.

Так

как в данном случае

![]() в выражении

(3.64) полностью определяется помехой

в выражении

(3.64) полностью определяется помехой

![]()

то

![]()

где h(Ξ) — дифференциальная энтропия помехи; ρ(ξ) — плотность распределения помехи Ξ.

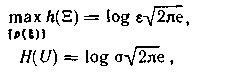

Ранее [см. (3.41)] нами установлено, что при ограничении на дисперсию случайной величины максимальной дифференциальной энтропией обладает нормальное распределение. Поэтому в соответствии с (3.42) получаем

откуда

![]()

Так

как σ![]() определяет среднюю мощность Р

определяет среднюю мощность Р![]() сигнала, аε

сигнала, аε![]() — среднюю мощность ρ

— среднюю мощность ρ![]() помехи Ξ,

то выражение (3.65) характеризует зависимость

эпсилон - энтропии от величины

помехи Ξ,

то выражение (3.65) характеризует зависимость

эпсилон - энтропии от величины

![]() ,

называемойотношением

сигнал/помеха.

,

называемойотношением

сигнал/помеха.

При

заданном отношении сигнал/помеха

значение H![]() (U)для нормально

распределенной случайной величины

является максимально возможным.

(U)для нормально

распределенной случайной величины

является максимально возможным.

Для

произвольно распределенной случайной

величины U

при том же

критерии верности и малых ε

[когда H![]() (U)велико]

справедливо приближенное равенство

(U)велико]

справедливо приближенное равенство

![]()