- •В. И. Дмитриев

- •Глава 1 Математические модели сигналов…………………………………………...19

- •Глава 1 математические модели сигналов

- •§ 1.1. Понятия сигнала и его модели

- •§ 1.2. Формы представления детерминированных сигналов

- •§ 1.3. Временная форма представления сигнала

- •§ 1.4. Частотная форма представления сигнала

- •§ 1.5. Соотношения между длительностью импульсов и шириной их спектров

- •§ 1.6. Спектральная плотность мощности детерминированного сигнала

- •§ 1.7. Функция автокорреляции детерминированного сигнала

- •§ 1.8. Случайный процесс как модель сигнала

- •§ 1.9. Стационарные и эргодические случайные процессы

- •§ 1.10. Спектральное представление случайных сигналов

- •§ 1.11. Частотное представление стационарных

- •Глава 2. Преобразование непрерывных сигналов в дискретные

- •§ 2.1. Преимущества цифровой формы представления сигналов

- •§ 2.2. Общая постановка задачи дискретизации

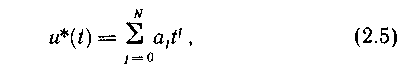

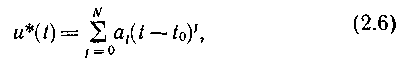

- •Воспроизводящая функция представляется аппроксимирующим полиномом

- •§ 2.3. Способы восстановления непрерывного сигнала

- •§ 2.4. Критерии качества восстановления

- •§ 2.5. Методы дискретизации посредством выборок

- •§ 2.6. Равномерная дискретизация. Теорема котельникова

- •§ 2.7. Теоретические и практические аспекты использования теоремы котельникова

- •§ 2.8. Дискретизация по критерию наибольшего отклонения

- •Оценка снизу для остаточного члена имеет вид

- •§ 2.9. Адаптивная дискретизация

- •Момент очередного отсчета определяется выполнением равенства

- •§ 2.10. Квантование сигналов

- •§ 2.11. Квантование сигналов при наличии помех

- •§ 2.12. Геометрическая форма представления сигналов

- •Контрольные вопросы

- •Глава 3. Количественная оценка информации

- •§ 3.1. Энтропия как мера неопределенности выбора

- •§ 3.2 Свойства энтропии

- •§ 3.3. Условная энтропия и ее свойства

- •§ 3.4. Энтропия непрерывного источника информации (дифференциальная энтропия)

- •§ 3.5. Свойства дифференциальной энтропии

- •§ 3.6. Количество информации как мера снятой неопределенности

- •§ 3.7. Эпсилон-энтропия случайной величины

- •Контрольные вопросы

- •Глава 4. Информационные характеристики источника сообщений и канала связи

- •§ 4.1. Основные понятия и определения

- •§ 4.2. Информационные характеристики источника дискретных сообщений

- •§ 4.3 Информационные характеристики дискретных каналов связи

- •§ 4.4. Информационные характеристики источника непрерывных сообщений

- •§ 4.5. Информационные характеристики непрерывных каналов связи

- •§ 4.6. Согласование физических характеристик сигнала и канала

- •§ 4.7. Согласование статистических свойств источника сообщений и канала связи

- •Глава 5. Кодирование информации при передаче по дискретному каналу без помех

- •§ 5.1. Кодирование как процесс выражения информации в цифровом виде

- •111 100 101

- •§ 5.2. Технические средства представления информации в цифровой форме

- •§ 5.3. Кодирование как средство криптографического закрытия информации

- •§ 5.4. Эффективное кодирование

- •§ 5.5. Технические средства кодирования

- •Глава 6. Кодирование информации при передаче

- •§ 6.1. Основная теорема шеннона о кодировании

- •§ 6.2. Разновидности помехоустойчивых кодов

- •§ 6.3. Блоковые коды

- •§ 6.4. Построение двоичного группового кода

- •0...01001, 0...01010, 0...01100.

- •§ 6.5. Технические средства кодирования и декодирования для групповых кодов

- •§ 6.6. Построение циклических кодов

- •§ 6.7. Выбор образующего многочлена по заданному объему кода и заданной корректирующей способности

- •§ 6.8 Технические средства кодирования и декодирования для циклических кодов

- •Остатки Векторы ошибок Опознаватели

- •Остатки Векторы ошибок Остатки

- •§ 6.9. Коды боуза — чоудхури — хоквингема

- •§ 6.10. Итеративные коды

- •Число ошибок такого вида в4 для блока изlхn символов равно

- •§ 6.11 Сверточные коды

- •Контрольные вопросы

- •Заключение

- •Список литературы

- •Приложения

§ 2.3. Способы восстановления непрерывного сигнала

Воспроизведение сигнала по выборкам можно производить как на основе ортогональных, так и неортогональных базисных функций, которые определяют тип аппроксимирующего полинома и принцип приближения: интерполяционный, экстраполяционный, комбинированный.

При неортогональных представлениях сигнала наиболее часто используются степенные алгебраические полиномы вида

или

где αj — действительные коэффициенты.

Если координаты сигнала представлены в виде разности выборок, то при его восстановлении, как правило, сначала проводят вычисление последовательности выборок и уже по ним строят аппроксимирующий полином u*(t).

Выбор системы базисных функций в составе аппроксимирующего полинома u*(t) во многом определяется требованием обеспечения простоты технической реализации аппаратных (программных) средств дискретизации и восстановления сигнала.

Если базисные функции выбраны так, что значения аппроксимирующего полинома совпадают со значениями выборок в моменты их отсчета, то такой полином называют интерполирующим.

С точки зрения сокращения числа отсчетов интерполяционные методы восстановления сигнала предпочтительнее, однако, для их реализации необходима задержка сигнала на интервал интерполяции, что в ряде случаев недопустимо. Поэтому в системах управления, работающих в реальном времени, используются экстра-поляционные методы, не требующие задержки сигнала при проведении операций определения значений выборок и восстановления сигнала.

При замене функции u(t) совокупностью отсчетов основная задача заключается в том, чтобы на интервале преобразования взять их не более чем требуется для восстановления исходного сигнала с заданной точностью в соответствии с выбранным критерием качества приближения.

Ограничение на число членов аппроксимирующего полинома (2.4) обычно не позволяет обеспечить заданную точность воспроизведения на всем интервале преобразования Т. Поэтому его разбивают на отрезки τj, называемые участками аппроксимации, и на каждом из них воспроизведение осуществляют аппроксимирующим полиномом (2.4), причем длительность участков аппроксимации может быть различной. В случае использования интерполяционного метода восстановления многочленом ненулевой степени на участке аппроксимации может размещаться несколько отсчетов.

§ 2.4. Критерии качества восстановления

При известной конечной совокупности координат сигнала и выбранном способе воспроизведения должна обеспечиваться заданная точность восстановления сигнала. Требования к точности восстановления диктуются потребителем информации. В зависимости от целевого назначения получаемой информации используются различные критерии точности приближения u*(t) к u(t).

В соответствии с критерием равномерного воспроизведения, называемым также критерием наибольшего отклонения, устанавливается абсолютное значение допустимой погрешности:

![]()

где m — максимальная погрешность приближения; Δi — участок аппроксимации; u(t) = u(t) — u*(t) — текущая погрешность приближения.

Если

сигнал задан множеством возможных

реализаций, то наибольшая допустимая

погрешность

![]() устанавливается для всей совокупности

реализацийu(t)

и

устанавливается для всей совокупности

реализацийu(t)

и

u*(t):

![]()

Такой критерий применяется, например, в случаях, когда необходимо обеспечить возможность фиксации любых изменений исходного сигнала, включая кратковременные выбросы, в особенности, если они соответствуют аварийному режиму объекта.

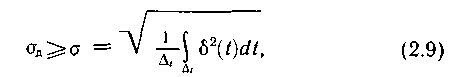

Широко используется также критерий среднеквадратического приближения:

где Д — допустимая среднеквадратическая погрешность приближения; σ— среднеквадратическая погрешность приближения.

При множестве возможных реализаций сигнала величина σ усредняется в соответствии с их вероятностями.

В технической реализации неравномерная дискретизация на основе критерия среднеквадратического приближения сложнее, чем на базе критерия равномерного приближения.

Интегральный критерий приближения определяется соотношением

![]()

где Д - допустимая средняя погрешность приближения; ε — средняя погрешность приближения.

Применяется также вероятностный критерий, в соответствии с которым задается допустимый уровень рД величины ρ — вероятности того, что текущая погрешность приближения (t) не превысит некоторого определенного значения 0:

![]()