- •В. И. Дмитриев

- •Глава 1 Математические модели сигналов…………………………………………...19

- •Глава 1 математические модели сигналов

- •§ 1.1. Понятия сигнала и его модели

- •§ 1.2. Формы представления детерминированных сигналов

- •§ 1.3. Временная форма представления сигнала

- •§ 1.4. Частотная форма представления сигнала

- •§ 1.5. Соотношения между длительностью импульсов и шириной их спектров

- •§ 1.6. Спектральная плотность мощности детерминированного сигнала

- •§ 1.7. Функция автокорреляции детерминированного сигнала

- •§ 1.8. Случайный процесс как модель сигнала

- •§ 1.9. Стационарные и эргодические случайные процессы

- •§ 1.10. Спектральное представление случайных сигналов

- •§ 1.11. Частотное представление стационарных

- •Глава 2. Преобразование непрерывных сигналов в дискретные

- •§ 2.1. Преимущества цифровой формы представления сигналов

- •§ 2.2. Общая постановка задачи дискретизации

- •Воспроизводящая функция представляется аппроксимирующим полиномом

- •§ 2.3. Способы восстановления непрерывного сигнала

- •§ 2.4. Критерии качества восстановления

- •§ 2.5. Методы дискретизации посредством выборок

- •§ 2.6. Равномерная дискретизация. Теорема котельникова

- •§ 2.7. Теоретические и практические аспекты использования теоремы котельникова

- •§ 2.8. Дискретизация по критерию наибольшего отклонения

- •Оценка снизу для остаточного члена имеет вид

- •§ 2.9. Адаптивная дискретизация

- •Момент очередного отсчета определяется выполнением равенства

- •§ 2.10. Квантование сигналов

- •§ 2.11. Квантование сигналов при наличии помех

- •§ 2.12. Геометрическая форма представления сигналов

- •Контрольные вопросы

- •Глава 3. Количественная оценка информации

- •§ 3.1. Энтропия как мера неопределенности выбора

- •§ 3.2 Свойства энтропии

- •§ 3.3. Условная энтропия и ее свойства

- •§ 3.4. Энтропия непрерывного источника информации (дифференциальная энтропия)

- •§ 3.5. Свойства дифференциальной энтропии

- •§ 3.6. Количество информации как мера снятой неопределенности

- •§ 3.7. Эпсилон-энтропия случайной величины

- •Контрольные вопросы

- •Глава 4. Информационные характеристики источника сообщений и канала связи

- •§ 4.1. Основные понятия и определения

- •§ 4.2. Информационные характеристики источника дискретных сообщений

- •§ 4.3 Информационные характеристики дискретных каналов связи

- •§ 4.4. Информационные характеристики источника непрерывных сообщений

- •§ 4.5. Информационные характеристики непрерывных каналов связи

- •§ 4.6. Согласование физических характеристик сигнала и канала

- •§ 4.7. Согласование статистических свойств источника сообщений и канала связи

- •Глава 5. Кодирование информации при передаче по дискретному каналу без помех

- •§ 5.1. Кодирование как процесс выражения информации в цифровом виде

- •111 100 101

- •§ 5.2. Технические средства представления информации в цифровой форме

- •§ 5.3. Кодирование как средство криптографического закрытия информации

- •§ 5.4. Эффективное кодирование

- •§ 5.5. Технические средства кодирования

- •Глава 6. Кодирование информации при передаче

- •§ 6.1. Основная теорема шеннона о кодировании

- •§ 6.2. Разновидности помехоустойчивых кодов

- •§ 6.3. Блоковые коды

- •§ 6.4. Построение двоичного группового кода

- •0...01001, 0...01010, 0...01100.

- •§ 6.5. Технические средства кодирования и декодирования для групповых кодов

- •§ 6.6. Построение циклических кодов

- •§ 6.7. Выбор образующего многочлена по заданному объему кода и заданной корректирующей способности

- •§ 6.8 Технические средства кодирования и декодирования для циклических кодов

- •Остатки Векторы ошибок Опознаватели

- •Остатки Векторы ошибок Остатки

- •§ 6.9. Коды боуза — чоудхури — хоквингема

- •§ 6.10. Итеративные коды

- •Число ошибок такого вида в4 для блока изlхn символов равно

- •§ 6.11 Сверточные коды

- •Контрольные вопросы

- •Заключение

- •Список литературы

- •Приложения

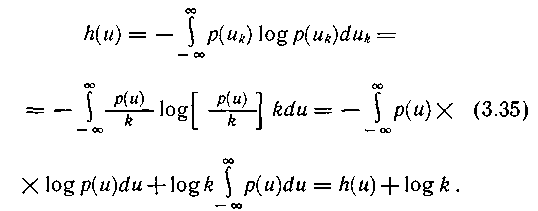

§ 3.5. Свойства дифференциальной энтропии

1. Дифференциальная энтропия в отличие от энтропии дискретного источника является относительной мерой неопределенности. Ее значение зависит от масштаба случайной величины U, а следовательно, и от выбора единицы ее измерения.

Изменим

масштаб случайной величины U,

например,

в k

раз,

оставив неизменным масштаб равномерно

распределенной в единичном интервале

случайной величины U',

принятой

за эталон. Если

![]() то

то![]() .

.

Тогда

Если одновременно изменить масштаб величины U', то относительная неопределенность также изменится, так как значение эталона будет уже иным.

Из относительности дифференциальной энтропии следует, что энтропия может принимать положительные, отрицательные и нулевые значения.

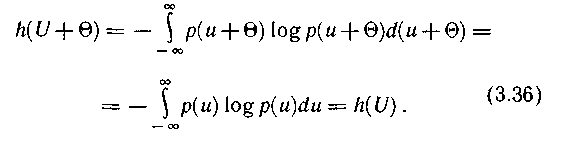

2. Дифференциальная энтропия не зависит от конкретных значений случайной величины U и, в частности, от изменения всех ее значений на постоянное. Действительно, масштаб U при этом не меняется и справедливо равенство

3. Какие же непрерывные распределения обладают максимальной дифференциальной энтропией?

а. Если единственным ограничением для случайной величины U является область ее возможных значений [α, β], то максимальной дифференциальной энтропией обладает равномерное распределение вероятностей в этой области.

При доказательстве решается задача определения плотности распределения р(u), обеспечивающей максимальное значение функционала

![]()

при ограничении

Используя, например, метод неопределенных множителей Лагранжа, получим

![]()

Нетрудно убедиться в том, что найденная функция р(u) обеспечивает максимум функционала h(U), причем

![]()

б. Если ограничения на область значений непрерывной случайной величины U отсутствуют, но известно, что дисперсия ее ограничена, то максимальной дифференциальной энтропией обладает нормальное распределение величины U.

При доказательстве решается задача определения функции р(u), обеспечивающей максимальное значение функционала

![]()

при ограничениях

![]()

где σ — среднеквадратическое отклонение от математического ожидания Ū =0 (σ — заданное ограничение).

Искомую плотность распределения р(u) находят, например, методом неопределенных множителей Лагранжа.

Она оказывается гауссовской:

![]()

Вычислив

функционал (3.40) для этого распределения,

получим значение максимальной

дифференциальной энтропии

![]() .

В двоичных

единицах неопределенности

.

В двоичных

единицах неопределенности

![]()

Поскольку в информационных системах сигнал, описываемый случайной величиной U, часто представляет собой электрическое напряжение (или ток), дисперсия U пропорциональна средней мощности сигнала. Тогда в соответствии с (3.41) можно утверждать, что при заданной мощности наибольшей средней неопределенностью выбора будет обладать источник, генерирующий сигналы, амплитуды которых распределены по нормальному закону.

4. Соотношения для дифференциальной энтропии объединения статистически зависимых непрерывных источников аналогичны соответствующим формулам для дискретных источников:

![]()

где

![]()

Справедливость

соотношения (3.43) легко проверить

подстановкой выражения (3.32), заданного

для h(V),

и выражения

(3.34) —для

![]() .

.

Так как

![]()

то

![]()

причем равенство имеет место только в случае отсутствия статистической связи между U и V.

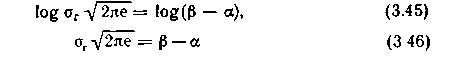

Пример 3.6.Определить, насколько мы выиграем в мощности, используя для организации мешающего воздействия, характеризующегося энтропией, источник шума с гауссовской плотностью распределения по сравнению с источником, имеющим в интервале [α, β] равномерную плотность распределения.

В соответствии с (3.42) дифференциальная энтропия гауссовского распределения

![]()

где

σ![]() — дисперсия, характеризующая мощность,

выделяемую на резисторе с сопротивлением

в 1 Ом.

— дисперсия, характеризующая мощность,

выделяемую на резисторе с сопротивлением

в 1 Ом.

Для равномерного распределения энтропия определена соотношением (3.39):

![]()

Вычислим

дисперсию σ![]() равномерного на интервале [α,

β]

распределения:

равномерного на интервале [α,

β]

распределения:

![]()

Из условия обеспечения равенства энтропий следует

Возведя (3.46) в квадрат и подставив в (3.44), получим

![]()

Следовательно, искомый выигрыш составляет 42 %.