- •В. И. Дмитриев

- •Глава 1 Математические модели сигналов…………………………………………...19

- •Глава 1 математические модели сигналов

- •§ 1.1. Понятия сигнала и его модели

- •§ 1.2. Формы представления детерминированных сигналов

- •§ 1.3. Временная форма представления сигнала

- •§ 1.4. Частотная форма представления сигнала

- •§ 1.5. Соотношения между длительностью импульсов и шириной их спектров

- •§ 1.6. Спектральная плотность мощности детерминированного сигнала

- •§ 1.7. Функция автокорреляции детерминированного сигнала

- •§ 1.8. Случайный процесс как модель сигнала

- •§ 1.9. Стационарные и эргодические случайные процессы

- •§ 1.10. Спектральное представление случайных сигналов

- •§ 1.11. Частотное представление стационарных

- •Глава 2. Преобразование непрерывных сигналов в дискретные

- •§ 2.1. Преимущества цифровой формы представления сигналов

- •§ 2.2. Общая постановка задачи дискретизации

- •Воспроизводящая функция представляется аппроксимирующим полиномом

- •§ 2.3. Способы восстановления непрерывного сигнала

- •§ 2.4. Критерии качества восстановления

- •§ 2.5. Методы дискретизации посредством выборок

- •§ 2.6. Равномерная дискретизация. Теорема котельникова

- •§ 2.7. Теоретические и практические аспекты использования теоремы котельникова

- •§ 2.8. Дискретизация по критерию наибольшего отклонения

- •Оценка снизу для остаточного члена имеет вид

- •§ 2.9. Адаптивная дискретизация

- •Момент очередного отсчета определяется выполнением равенства

- •§ 2.10. Квантование сигналов

- •§ 2.11. Квантование сигналов при наличии помех

- •§ 2.12. Геометрическая форма представления сигналов

- •Контрольные вопросы

- •Глава 3. Количественная оценка информации

- •§ 3.1. Энтропия как мера неопределенности выбора

- •§ 3.2 Свойства энтропии

- •§ 3.3. Условная энтропия и ее свойства

- •§ 3.4. Энтропия непрерывного источника информации (дифференциальная энтропия)

- •§ 3.5. Свойства дифференциальной энтропии

- •§ 3.6. Количество информации как мера снятой неопределенности

- •§ 3.7. Эпсилон-энтропия случайной величины

- •Контрольные вопросы

- •Глава 4. Информационные характеристики источника сообщений и канала связи

- •§ 4.1. Основные понятия и определения

- •§ 4.2. Информационные характеристики источника дискретных сообщений

- •§ 4.3 Информационные характеристики дискретных каналов связи

- •§ 4.4. Информационные характеристики источника непрерывных сообщений

- •§ 4.5. Информационные характеристики непрерывных каналов связи

- •§ 4.6. Согласование физических характеристик сигнала и канала

- •§ 4.7. Согласование статистических свойств источника сообщений и канала связи

- •Глава 5. Кодирование информации при передаче по дискретному каналу без помех

- •§ 5.1. Кодирование как процесс выражения информации в цифровом виде

- •111 100 101

- •§ 5.2. Технические средства представления информации в цифровой форме

- •§ 5.3. Кодирование как средство криптографического закрытия информации

- •§ 5.4. Эффективное кодирование

- •§ 5.5. Технические средства кодирования

- •Глава 6. Кодирование информации при передаче

- •§ 6.1. Основная теорема шеннона о кодировании

- •§ 6.2. Разновидности помехоустойчивых кодов

- •§ 6.3. Блоковые коды

- •§ 6.4. Построение двоичного группового кода

- •0...01001, 0...01010, 0...01100.

- •§ 6.5. Технические средства кодирования и декодирования для групповых кодов

- •§ 6.6. Построение циклических кодов

- •§ 6.7. Выбор образующего многочлена по заданному объему кода и заданной корректирующей способности

- •§ 6.8 Технические средства кодирования и декодирования для циклических кодов

- •Остатки Векторы ошибок Опознаватели

- •Остатки Векторы ошибок Остатки

- •§ 6.9. Коды боуза — чоудхури — хоквингема

- •§ 6.10. Итеративные коды

- •Число ошибок такого вида в4 для блока изlхn символов равно

- •§ 6.11 Сверточные коды

- •Контрольные вопросы

- •Заключение

- •Список литературы

- •Приложения

§ 2.9. Адаптивная дискретизация

Если ранее рассмотренные методы и алгоритмы дискретизации были рассчитаны на все множество возможных реализаций сигнала и потому опирались на предельные значения его динамических характеристик, то при адаптивной дискретизации мы ориентируемся на динамические характеристики конкретной реализации, что позволяет получить минимальное число выборок, обеспечивающих восстановление этой реализации с заданной точностью

В основе принципа адаптивной дискретизации лежит непосредственное слежение за текущей погрешностью восстановления сигнала ε

Наиболее широкое применение на практике получили алгоритмы дискретизации с адаптацией по длине интервала аппроксимации. В процессе последовательного наращивания интервала аппроксимации производится сравнение сигнала u(t) с воспроизводящей функцией u*(t), формируемой с учетом текущих значений динамических характеристик сигнала. Когда погрешность воcпроизведения достигает заданного значения ε0, наращивание интервала прекращается и производится отсчет. Интервалы времени между отсчетами при этом оказываются произвольными.

В качестве воспроизводящих функций наиболее часто используются степенные алгебраические полиномы (2.5) нулевой и первой степеней. При этом возможны как интерполяционные, так и экстраполяционные способы адаптивной дискретизации Интерполяционные способы не нашли широкого применения, поскольку их реализация связана с запоминанием сигнала на интервале аппроксимации и выполнением большого числа вычислительных операций. Поэтому ограничимся рассмотрением примеров адаптивной дискретизации на основе экстраполяции

Пример 2.6. Провести адаптивную дискретизацию реализации сигнала u(t), изображенной на рис 2.11, с использованием аппроксимирующего многочлена типа (2.5) нулевой степени. Наибольшее допустимое отклонение равно 0.

На момент tj начала каждого интервала аппроксимирующий полином u*(t) принимаем равным u(tj) и вычисляем разность Δu(t)=u(t) - u*(tj), которую сравниваем с ε0. Установление равенства

![]()

соответствует моменту tj+1 окончания интервала и проведения очередного отсчета.

Результаты дискретизации отображены на том же рисунке.

Пример 2.7. Провести адаптивную дискретизацию реализации сигнала u(t) изображенного на рис 2.12 многочленом типа (2.5) первой степени. Наибольшее допустимое отклонение равно ε0.

На момент tj начала каждого интервала аппроксимации

![]()

где u'(tj) — производная сигнала u(t) в момент времени tj.

Момент очередного отсчета определяется выполнением равенства

![]()

Результаты дискретизации приведены на том же рис.2.12.

При аппаратной реализации данного алгоритма следует иметь в виду, что вследствие наличия операции дифференцирования сигнала он неэффективен при наличии высокочастотных помех.

§ 2.10. Квантование сигналов

Поскольку

математической моделью непрерывного

сигнала является случайный процесс

U(t),

мгновенное

значение сигнала U

= U(ti)

представляет

собой случайную величину. Диапазон ее

изменения, называемый непрерывной

шкалой мгновенных значений сигнала,

ограничен значениями umin

и umax,

что отражает

условие физической реализуемости

сигнала. Непрерывную шкалу мгновенных

значений un=

umax

–

umin

сигнала

разбивают на n

интервалов,

называемых шагами квантования. Границами

шагов квантования являются значения

u0

= umin

, u1

, ..., un-1

, un=umax.

Из множества мгновенных значений,

принадлежащих i-му

шагу квантования (ui-1![]() u<ui),

только одно значение u'i

является разрешенным (i-й

уровень квантования). Любое другое из

указанного множества значений округляется

до u'i

. Совокупность величин u'i(i=1,

2, ...,

n)

образует

дискретную шкалу уровней квантования.

Если эта шкала равномерна, т. е. разность

значений

u<ui),

только одно значение u'i

является разрешенным (i-й

уровень квантования). Любое другое из

указанного множества значений округляется

до u'i

. Совокупность величин u'i(i=1,

2, ...,

n)

образует

дискретную шкалу уровней квантования.

Если эта шкала равномерна, т. е. разность

значений

![]() u'i

= u'i

- u'i-1

постоянна на всем протяжении непрерывной

шкалы мгновенных значений сигнала u,

квантование называют равномерным. Если

постоянство значений Δu'i

не

выдерживается — квантование неравномерное.

Благодаря простоте технической реализации

равномерное квантование получило

наиболее широкое распространение.

u'i

= u'i

- u'i-1

постоянна на всем протяжении непрерывной

шкалы мгновенных значений сигнала u,

квантование называют равномерным. Если

постоянство значений Δu'i

не

выдерживается — квантование неравномерное.

Благодаря простоте технической реализации

равномерное квантование получило

наиболее широкое распространение.

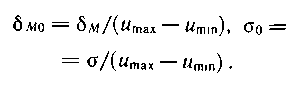

В результате замены мгновенного значения сигнала U соответствующим уровнем квантования u'i возникает погрешность δi = u - u'i, которую называют ошибкой квантования. Эта погрешность является случайной величиной. Нас чаще всего интересует ее максимальное значение M = mах|i| и средне - квадратическое отклонение σ для всего диапазона изменения мгновенных значений сигнала. Используются также приведенные значения этих величин

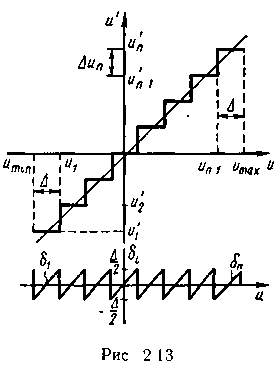

С позиций минимизации наибольшей возможной ошибки квантования непрерывную шкалу мгновенных значений сигнала целесообразно разбить на n одинаковых шагов квантования Δ = (umax — umin)/n и уровни квантования разместить в середине каждого шага (рис 2.13) При этом максимальная ошибка квантования не превышает 0.5Δ. Если каждый уровень квантования выбран равным нижней (верхней) границе шага квантования, максимальная ошибка квантования возрастает до величины Δ.

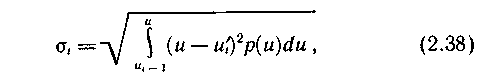

С реднеквадратическое

отклонение ошибки квантования дляi-ro

шага σi

зависит

не только от шага Δi

и расположения

в нем i-ro

уровня

квантования, но и от закона распределения

мгновенных значений сигнала в пределах

этого шага:

реднеквадратическое

отклонение ошибки квантования дляi-ro

шага σi

зависит

не только от шага Δi

и расположения

в нем i-ro

уровня

квантования, но и от закона распределения

мгновенных значений сигнала в пределах

этого шага:

где р(u) — функция плотности вероятности мгновенных значений сигнала U.

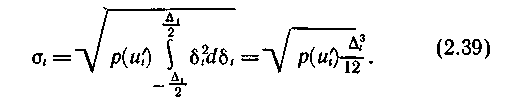

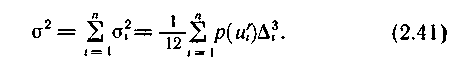

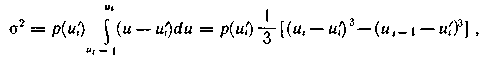

Считая шаги квантования малыми по сравнению с диапазоном изменения сигнала, плотность р(u) в пределах каждого i-го шага можно принять постоянной и равной некоторому среднему значению, например р(u'i). При таких предположениях минимальная среднеквадратическая ошибка σi достигается при расположении уровня квантования в середине шага:

Преобразовав подкоренное выражение к виду

![]()

отмечаем, что дисперсия ошибки квантования на i-м шаге равна Δ2i/12 равномерно распределенного на этом шаге сигнала, умноженной на вероятность

р(u'i)i попадания мгновенного значения сигнала в пределы данного шага. Дисперсия полной ошибки квантования σ2 для всей непрерывной шкалы мгновенных значений сигнала определяется как математическое ожидание дисперсий Δ2i/12 на отдельных шагах квантования:

При одинаковых шагах квантования (Δi = Δ)

![]()

Так как принимаем

![]()

то

![]()

Таким образом, при квантовании с постоянным шагом и размещении уровней квантования в середине шага (равномерное квантование) среднеквадратическая ошибка квантования, как для равномерного, так и для произвольного распределения мгновенных значений сигнала одинакова:

![]()

Шум квантования. При квантовании сигнала по уровню случайный процесс заменяется ступенчатой зависимостью U'(t). Изменяющуюся во времени ошибку квантования (t), также представляющую собой случайный процесс, называют шумом квантования:

![]()

Сохраняя ранее введенные предположения (о малости шага квантования и равномерности распределения в нем мгновенных значений сигнала) и считая случайные процессы U(t) и (t) эргодическими, среднеквадратическую ошибку равномерного квантования σ можно определить по реализации δι(t) (рис. 2.14). В пределах каждого шага квантования Δ зависимость δι(t) заменяется прямой ttg1, где β — переменный угол наклона прямой. При размещении уровней квантования в середине каждого шага математическое ожидание ошибки квантования равно нулю, а ее среднеквадратическое значение определяется выражением

Так как

![]()

что соответствует ранее полученному значению [см. (2.44)].

При заданной допустимой среднеквадратической ошибке квантования и отсутствии помех число уровней квантования находим из соотношения

![]()

Однако при неравномерном законе распределения мгновенных значений сигнала квантование с постоянным шагом не является оптимальным по критерию минимума среднеквадратической ошибки σ. Квантуя участки с менее вероятными значениями сигнала с большим шагом, указанное значение среднеквадратической ошибки можно уменьшить.

Пример 2.8. Показать, что при квантовании сигнала u(t), имеющего плотность распределения значений р(u), с постоянным шагом Δ, значение которого много меньше диапазона изменения u(t), среднеквадратическая ошибка квантования σ достигает минимума при расположении уровня квантования в середине шага.

Дисперсия ошибки квантования в пределах i-го шага в соответствии с (2.38) может быть записана в виде

где u'i – i-й уровень квантования.

Приравнивая нулю производную этого выражения, находим условие минимума:

![]()

откуда

![]()

при одинаковых знаках имеем ui = ui-1, что соответствует случаю отсутствия квантования (Δ = 0). Приняв разные знаки, получаем

![]()

что и требовалось показать.