- •Приближенные числа

- •Правила вычислений с приближенными числами.

- •Приближенное решение алгебраических и трансцендентных уравнений. Отделение корней и уточнение приближенных корней. Графическое решение уравнений.

- •Метод половинного деления (метод «вилки»).

- •Метод хорд.

- •Метод Ньютона (метод касательных).

- •Метод итерации. Приведение уравнений к виду, удобному для итерации.

- •Приближенное решение систем линейных уравнений. Метод итераций.

- •Приближенное решение систем нелинейных уравнений. Метод итерации.

- •Постановка задачи интерполирования функций. Общее решение задачи интерполирования функции полиномом.

- •Интерполяционная формула Лагранжа

- •Интерполирование сплайнами

- •14 Аппроксимирование функций (15 не нашли)

- •Аппроксимирование функций. Метод ортогональных функций.

- •Квадратурная формула Ньютона-Котеса

- •Квадратурная формула Гаусса

- •Численные метода решения задачи Коши для обыкновенных дифференциальных уравнений. Метод Эйлера. Метод Эйлера-Коши

- •Метод Рунге-Кутта

- •Редукция к задаче Коши двухточечной краевой задачи для линейного уравнения второго порядка.

- •Метод коллокации.

- •23.Аппроксимация производных конечно-разностными соотношениями.

- •Метод конечных разностей численного решения обыкновенных дифференциальных уравнений.

- •Принципы построения сеток на плоскости и в пространстве.

- •26. Построение разностных схем для уравнений параболического типа.

- •27. Экстремумы функций. Классификация методов безусловной оптимизации.

- •28. Общая характеристика методов оптимизации нулевого порядка.

- •Метод прямого поиска (метод Хука-Дживса).

- •Метод деформируемого многогранника (метод Нелдера-Мида).

- •Метод вращающихся координат (метод Розенброка).

- •Метод параллельных касательных (метод Пауэлла).

- •Общая характеристика методов оптимизации первого порядка.

- •34.Метод наискорейшего спуска

- •35. Общая характеристика методов оптимизации второго порядка. Метод Ньютона.

- •36. Метод Ньютона с регулировкой шага (метод с переменной метрикой)

- •37. Метод статистических испытаний (метод Монте-Карло)

- •38. Вычисление кратных интегралов методом Монте-Карло

- •39. Структура искусственной нейронной сети (инс)

- •40. Компьютерная модель нейрона (нейроэлемента, нэ)

- •41. Функции активации нейроэлементов

- •45.Методы обучения элементарного перцептрона.

- •46.Многослойный перцептрон.

- •47. Понятие обучающей выборки.

45.Методы обучения элементарного перцептрона.

Важным свойством любой нейронной сети является способность к обучению. Процесс обучения является процедурой настройки весов и порогов с целью уменьшения разности между желаемыми (целевыми) и получаемыми векторами на выходе.

Обучение с учителем.

Метод коррекции ошибки

Классический метод обучения перцептрона — это метод коррекции ошибки. Он представляет собой такой вид обучения с учителем, при котором вес связи не изменяется до тех пор, пока текущая реакция перцептрона остается правильной. При появлении неправильной реакции вес изменяется на единицу, а знак (+/-) определяется противоположным от знака ошибки.

Обучение без учителя

Кроме классического метода обучения перцептронаРозенблатт также ввёл понятие об обучении без учителя, предложив следующий способ обучения: Альфа-система подкрепления.

Это система подкрепления, при которой веса всех активных связей cij, которые ведут к элементу uj, изменяются на одинаковую величину r, а веса неактивных связей за это время не изменяются.

46.Многослойный перцептрон.

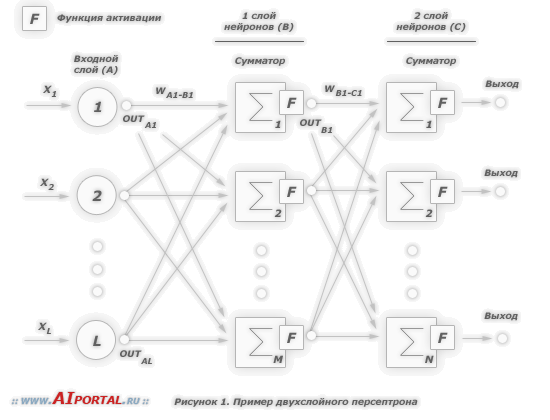

сигнал в таких сетях распространяется в прямом направлении, от слоя к слою. Многослойный персептрон в общем представлении состоит из следующих элементов:

множества входных узлов, которые образуют входной слой;

одного или нескольких скрытых слоев вычислительных нейронов;

одного выходного слоя нейронов.

Многослойный персептрон представляет собой обобщение однослойного персептрона Розенблатта. Примероммногослойногоперсептронаявляетсяследующаямодельнейроннойсети:

Количество входных и выходных элементов в многослойном персептроне определяется условиями задачи. Сомнения могут возникнуть в отношении того, какие входные значения использовать, а какие нет. Вопрос о том, сколько использовать промежуточных слоев и элементов в них, пока совершенно неясен. В качестве начального приближения можно взять один промежуточный слой, а число элементов в нем положить равным полусумме числа входных и выходных элементов.

Многослойные персептроны успешно применяются для решения разнообразных сложных задач и имеют следующих три отличительных признака.

47. Понятие обучающей выборки.

Обуче́ние с учи́телем — один из способов машинного обучения, в ходе которого испытуемая система принудительно обучается с помощью примеров «стимул-реакция». С точки зрения кибернетики, является одним из видов кибернетического эксперимента. Между входами и эталонными выходами (стимул-реакция) может существовать некоторая зависимость, но она не известна. Известна только конечная совокупность прецедентов — пар «стимул-реакция», называемая обучающей выборкой.

Выборка или выборочная совокупность — множество случаев (испытуемых, объектов, событий, образцов), с помощью определённой процедуры выбранных из генеральной совокупности для участия в исследовании.

Характеристики выборки:

Качественная характеристика выборки – кого именно мы выбираем и какие способы построения выборки мы для этого используем.

Количественная характеристика выборки – сколько случаев выбираем, другими словами объём выборки.

Необходимость выборки

Объект исследования очень обширный. Например, потребители продукции глобальной компании – огромное количество, территориально разбросанных рынков.

Существует необходимость в сборе первичной информации.