- •501. Загальна постановка задачі лінійного програмування. Приклади економічних задач лінійного програмування.

- •502. Модель задачі лінійного програмування в розгорнутому і скороченому вигляді, а також в матричній і векторній формах.

- •503. Властивості розв'язків задачі лінійного програмування. Геометрична інтерпретація задач лінійного програмування.

- •504. Означення планів задачі лінійного програмування (допустимий, опорний, оптимальний).

- •505. Побудова опорного плану задачі лінійного програмування, перехід до іншого опорного плану.

- •Такому плану відповідає розклад

- •506. Теорема про оптимальність розв'язку задачі лінійного програмування симплекс-методом.

- •Якщо розглядається задача на відшукання мінімального значення цільової функції, то формулюється така теорема.

- •507. Знаходження оптимального розв'язку задачі лінійного програмування. Алгоритм симплексного методу.

- •508. Симплексний метод із штучним базисом. Ознака оптимальності плану із штучним базисом.

- •Взаємозв’язок між розв’язками початкової та розширеної задач лінійного програмування не є очевидним і визначається такою теоремою.

- •509. Двоїста задача. Правила побудови двоїстої задачі. Симетричні й несиметричні двоїсті задачі.

- •510. Економічний зміст двоїстої задачі й двоїстих оцінок.

- •511. Теореми двоїстості, їх економічна інтерпретація.

- •512. Застосування теорем двоїстості в розв’язуванні задач лінійного програмування.

- •513. Методи розв'язування двоїстої задачі лінійного програмування.

- •514. Аналіз розв'язків лінійних економіко-математичних моделей. Оцінка рентабельності продукції. Доцільність введення нової продукції.

- •515. Аналіз обмежень дефіцитних і недефіцитних ресурсів.

- •516. Аналіз коефіцієнтів цільової функції задач лінійного програмування.

- •517. Транспортна задача лінійного програмування. Економічна і математична постановка транспортної задачі.

- •518. Методи побудови опорних планів транспортної задачі. Випадок виродженості. Теорема про розв'язування транспортної задачі.

- •519. Двоїста задача до транспортної задачі. Метод потенціалів.

- •520. Розв'язування транспортної задачі методом потенціалів.

- •521. Відкриті транспортні задачі. Метод розв'язування.

- •522. Цілочислове програмування. Область застосування цілочислових задач в плануванні й управлінні виробництвом.

- •523. Геометрична інтерпретація задачі цілочислового програмування.

- •524. Метод Гоморі повністю цілочислових задач. Знаходження цілої й дробової частини числа. Алгоритм розв'язування задачі.

- •525. Постановка задачі нелінійного програмування, математична модель. Геометрична інтерпретація.

- •526. Графічний метод розв'язування задач нелінійного програмування.

- •527. Метод множників Лагранжа. Теорема Лагранжа. Алгоритм розв'язування задачі на безумовний екстремум.

- •528. Поняття про опуклі функції. Геометрична інтерпретація задачі опуклого програмування на площині.

- •529. Сідлова точка та необхідні і достатні умови її існування. Теорема Куна-Таккера.

- •530. Квадратична функція та її властивості.

- •531. Математична модель задачі опуклого програмування з сепарабельною цільовою функцією.

- •532. Постановка задачі квадратичного програмування та її математична модель.

- •533. Градієнтні методи розв'язання задач нелінійного програмування та їх класифікація.

- •534. Метод Франка-Вульфа. Алгоритм розв'язування задачі нелінійного програмування.

- •535. Сепарабельна функція та її властивості. Розв'язування задач нелінійного програмування методом кусково-лінійної апроксимації.

- •536. Математична постановка задачі динамічного програмування, її економічний зміст. Принцип оптимальності Беллмана.

- •537. Основні рекурентні співвідношення розв'язування задач динамічного програмування.

- •538. Методи розв'язування задач динамічного програмування. Основні кроки алгоритму розв'язування задачі динамічного програмування.

- •539. Математична постановка задачі стохастичного програмування і область їх застосування в управлінні виробничими системами.

- •540. 3Ведення розв'язання одноетапної статичної задачі стохастичного програмування до детермінованої задачі лінійного програмування.

- •541. Основні поняття теорії ігор. Гра двох гравців з нульовою сумою, правила гри, ціна гри, пара оптимальних стратегій для двох осіб.

- •542. Платіжна матриця. Основна теорема теорії ігор. Принцип мінімаксу.

- •543. Гра в чистих стратегіях. Поняття сідлової точки і її знаходження.

- •544. Гра2x2 взмішаних стратегіях. Алгоритм розв'язування задачі.

- •545. Зведення гри двох осіб до задачі лінійного програмування.

- •547. Основні числові характеристики випадкового процесу та їх властивості.

- •548. Кореляційна функція випадкового процесу та її властивості. Нормована кореляційна функція.

- •549. Поняття про оператор перетворення випадкового процесу. Лінійні однорідні перетворення. Нелінійні перетворення.

- •550. Визначення стаціонарного випадкового процесу, щільність ймовірностей для одного, k періодів.

- •551. Кореляційна функція, нормована кореляційна функція та їх властивості.

- •552. Ергодичні властивості стаціонарного випадкового процесу та його математична трактовка.

- •554. Стаціонарний випадковий процес із лінійною кореляційною функцією.

- •555. Стаціонарний випадковий процес із експоненціальною кореляційною функцією.

- •556. Пуассонівський процес та його математична модель.

- •557. Імовірні твірні функції.

- •558. Визначення ланцюга Маркова. Матриця однокрокового переходу. Однорідні ланцюги Маркова та їх класифікація.

- •559. Поглинаючі однорідні ланцюги Маркова та їх числові характеристики. Фундаментальна матриця.

- •560. Регулярні однорідні ланцюги Маркова та їх числові характеристики. Фундаментальна матриця для цих ланцюгів.

533. Градієнтні методи розв'язання задач нелінійного програмування та їх класифікація.

Градієнтні методи належать до наближених методів розв’язування задач нелінійного програмування і дають лише певне наближення до екстремуму, причому за збільшення обсягу обчислень можна досягти результату з наперед заданою точністю, але в цьому разі є можливість знаходити лише локальні екстремуми цільової функції. Зауважимо, що такі методи можуть бути застосовані лише до тих типів задач нелінійного програмування, де цільова функція і обмеження є диференційовними хоча б один раз. Зрозуміло, що градієнтні методи дають змогу знаходити точки глобального екстремуму тільки для задач опуклого програмування, де локальний і глобальний екстремуми збігаються.

В основі градієнтних методів лежить основна властивість градієнта диференційовної функції — визначати напрям найшвидшого зростання цієї функції. Ідея методу полягає у переході від однієї точки до іншої в напрямку градієнта з деяким наперед заданим кроком.

534. Метод Франка-Вульфа. Алгоритм розв'язування задачі нелінійного програмування.

Розглянемо метод Франка — Вульфа, процедура якого передбачає визначення оптимального плану задачі шляхом перебору розв’язків, які є допустимими планами задачі.

Нехай необхідно відшукати max F=f(x1,x2,…,xn) за лінійних обмежень: Сума(j=1,n)aijxj<bi (i=1,m); xj>0 (j=1,n).

Допустимо, що Х0 — початкова точка, що належить множині допустимих планів даної задачі. В деякому околі цієї точки нелінійну цільову функцію замінюють лінійною і потім розв’язують задачу лінійного програмування. Нехай розв’язок лінійної задачі дав значення цільової функції F0, тоді з точки Х0 в напрямку F0 необхідно рухатись доти, поки не припиниться зростання цільової функції. Тобто у зазначеному напрямку вибирають наступну точку Х1, цільова функція знову замінюється на лінійну, і знову розв’язується задача лінійного програмування.

535. Сепарабельна функція та її властивості. Розв'язування задач нелінійного програмування методом кусково-лінійної апроксимації.

Нехай задані x1<x2<…<xn — точки зміни формул.

Як і всі кусково-задані функції, кусково-лінійну функцію зазвичай задають на кожному з інтервалів (-безкінечність;x1),(x1,x2);…(xn;+безкінечність) окремою формулою. Записують це у вигляді:

{k0x+b0, x<x1

f(x)={k1x+b1, x1<x<x2

{…

{knx+bn, xn<x

Якщо до того ж виконані умови узгодження aixi+bi=ai+1xi+bi+1=f(xi) при i=1,2,…,n, то кусково-лінійна функція буде неперервною. Неперервна кусково-лінійна функція називається також лінійним сплайном.

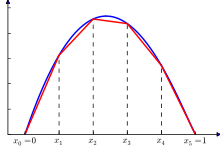

Функція (синя) і її кусково-лінійна апроксимація (червона).

536. Математична постановка задачі динамічного програмування, її економічний зміст. Принцип оптимальності Беллмана.

Динамічне програмування являє собою математичний апарат, що дає змогу здійснювати планування багатокрокових керованих процесів, а також процесів, які розвиваються у часі.

До задач динамічного програмування належать такі, що пов’язані з оптимальним розподілом капіталовкладень, розподілом продукції між різними регіонами, визначенням найкоротшого шляху завезення товарів споживачам, задачі щодо заміни устаткування, оптимального управління запасами тощо.

Економічні процеси можна уявити складеними з кількох етапів (кроків). На кожному з них здійснюється вплив на розвиток всього процесу. Тому у разі планування багатоетапних процесів прийняття рішень на кожному етапі має враховувати попередні зміни та бути підпорядкованим кінцевому результату. Динамічне програмування дає змогу прийняти ряд послідовних рішень, що забезпечує оптимальність розвитку процесу в цілому.

Ддля прийняття оптимального рішення на k-му кроці багатокрокового процесу потрібна оптимальність рішень на всіх його попередніх кроках, а сукупність усіх рішень дає оптимальний розв’язок задачі лише в тому разі, коли на кожному кроці приймається оптимальне рішення, що залежить від початкової суми, визначеної на попередньому кроці.

Цей факт є основою методу динамічного програмування і є сутністю так званого принципу оптимальності Р. Белмана, який формулюється так:

Оптимальний розв’язок багатокрокової задачі Х(х1,х2,…хn) має ту властивість, що яким би не був стан системи в результаті деякої кількості кроків, необхідно вибирати управління Xi+1 на найближчому кроці так, щоб воно разом з оптимальним управлінням на всіх наступних кроках приводило до максимального виграшу на всіх останніх кроках, включаючи даний.