- •Курс лекций

- •Оглавление

- •1. Архитектура и принципы работы обычных эвм с центральным процессором (cpu) 9

- •2. Методы повышения производительности традиционных эвм 27

- •3. Типы архитектур высокопроизводительных вычислительных систем 45

- •4. Потоковые параллельные вычисления для физического моделирования 62

- •5. Применение графических процессоров на примерах сложения матриц и решения дифференциальных уравнений 82

- •6. Молекулярная динамика на графическом процессоре 100

- •7. Высокоскоростное моделирование систем с дальнодействием 125

- •8. Восстановление потенциалов межчастичных взаимодействий по температурной зависимости периода решетки методами высокоскоростного мдм на графических процессорах 145

- •9. Базовые особенности программирования графических процессоров шейдерной модели 4.0 160

- •Введение

- •1.Архитектура и принципы работы обычных эвм с центральным процессором (cpu)

- •1.1.Структура традиционной эвм

- •1.2.Организация работы эвм

- •1.3.Иерархия памяти компьютера

- •1.4. Выполнение команд

- •1.5.Требования к коммуникационным линиям

- •1.6.Устройства ввода-вывода

- •2.Методы повышения производительности традиционных эвм

- •2.1. Распараллеливание расчетов

- •2.2.Конвейерная обработка данных и команд

- •2.3.Высокопроизводительные процессоры

- •2.3.1.Суперскалярные процессоры

- •2.3.2.Процессоры risc с сокращенным набором команд

- •2.3.3.Процессоры со сверхдлинным командным словом

- •2.3.4.Векторные процессоры

- •2.3.5.Процессоры для параллельных компьютеров

- •2.3.6.Процессоры с многопоточной архитектурой

- •2.3.7.Технология Hyper-Threading

- •2.4.Требования к памяти высокопроизводительных эвм

- •2.5.Коммуникационная сеть высокопроизводительных эвм

- •2.5.1.Статические и динамические топологии и маршрутизация коммуникационных систем

- •2.5.2.Многокаскадные сети и методы коммутации

- •2.6.Классификация архитектур параллельных компьютеров

- •3.Типы архитектур высокопроизводительных вычислительных систем

- •3.1.Simd архитектура (с разделяемой и распределенной памятью)

- •3.2. Mimd архитектура с разделяемой и распределенной памятью

- •3.3. Комбинированные системы

- •3.4. Мультипроцессорные и мультикомпьютерные системы

- •3.5.Кластеры пэвм и рабочих станций

- •3.6.Особенности параллельного программирования

- •4.Потоковые параллельные вычисления для физического моделирования

- •4.1.Общие принципы распараллеливания расчётов

- •4.2.Обмен данными между процессором и памятью

- •4.3.Графические процессоры как вычислительные системы для поточно-параллельных расчётов

- •4.3.1.Вычислительные возможности центральных процессоров общего назначения и графических процессоров

- •4.3.2.Графический конвейер

- •4.3.3.История программируемости графических процессоров

- •4.3.4.Требования к алгоритмам для gpu, поддерживающих шейдерную модель 3.0

- •4.3.5.Возможности gpu в рамках шейдерной модели 3.0 и взаимодействие gpu с памятью

- •4.3.6.Проблема одинарной точности

- •4.4.Средства программирования графических процессоров

- •4.4.1.Общая структура программы для физического моделирования на графическом процессоре

- •4.4.2.Необходимое программное обеспечение

- •4.5.Области использования графических процессоров

- •5.Применение графических процессоров на примерах сложения матриц и решения дифференциальных уравнений

- •5.1.Распараллеливание независимых вычислений

- •5.2.Используемый графический процессор

- •5.3.Представление данных для графического процессора

- •5.4.Программирование вычислительного ядра

- •5.5.Взаимодействие центрального и графического процессоров

- •5.5.1.Функции центрального процессора

- •5.5.2.Пример программы

- •6.Молекулярная динамика на графическом процессоре

- •6.1.Принципы моделирования ионных кристаллов методом молекулярной динамики

- •6.2.Программирование графического процессора для расчёта действующих на ионы результирующих сил

- •6.2.1.Исходные данные

- •6.2.2.Представление исходных данных для gpu

- •6.2.3.Алгоритм расчёта результирующих сил с использованием графического процессора

- •6.2.4.Шейдер для расчёта результирующей силы

- •6.3.Исполнение шейдера из программы мд-моделирования на c#

- •6.3.1.Этапы алгоритма моделирования, исполняемые на cpu

- •6.3.2.Процедуры на c#, обеспечивающие работу с графическим процессором

- •6.4.Постановка граничных условий и стабилизация макросостояния молекулярно-динамической системы

- •6.4.1.Компенсация импульса и момента импульса

- •6.4.2.Стабилизация температуры

- •7.Высокоскоростное моделирование систем с дальнодействием

- •7.1.Актуальность моделирования

- •7.2.Высокоскоростные алгоритмы моделирования систем с дальнодействующими силами

- •7.3.Методика высокоскоростного молекулярно-динамического моделирования диоксида урана

- •7.4.Экспериментальные результаты и их обсуждение

- •7.5.Анализ зависимостей среднего квадрата смещений ионов кислорода от времени

- •8.Восстановление потенциалов межчастичных взаимодействий по температурной зависимости периода решетки методами высокоскоростного мдм на графических процессорах

- •8.1.Задача восстановления потенциалов межчастичных взаимодействий в кристаллах

- •8.2.Исходные данные и метод восстановления потенциалов

- •8.3.Модель и детали реализации

- •9.Базовые особенности программирования графических процессоров шейдерной модели 4.0

- •9.1.Предпосылки появления новой шейдерной модели

- •9.2.Архитектура gpu шейдерной модели 4.0. Преимущества этой модели

- •9.2.1.Иерархия вычислительных блоков и памяти в шейдерной модели 4.0

- •9.2.2.Конвейерная обработка данных на gpu sm4

- •9.2.3.Логическая структура вычислений на gpu sm4

- •9.2.4.Преимущества gpu шейдерной модели 4.0

- •9.3.Средства высокоуровневого программирования gpu шейдерной модели 4.0

- •9.3.1.Совместимость с шейдерной моделью 3.0

- •9.3.2.Специальные средства программирования gpu sm4. Cuda

- •9.3.3.Средства для написания и компиляции программ на cuda

- •9.3.4.Структура программы на cuda

- •9.4.Перемножение матриц на cuda

- •9.4.1.Алгоритм перемножения матриц

- •9.4.2.Процедура перемножения матриц на gpu sm4

- •9.4.3.Вызов процедуры перемножения матриц из программы на c

- •9.5.Молекулярная динамика на cuda

- •9.5.1.Алгоритм с использованием разделяемой памяти

- •9.5.2.Расчёт сил на gpu с использованием 3-го закона Ньютона

- •Библиографический список

- •Приложение 1 Операторы и функции языка hlsl, использованные в курсе лекций п.1.2. Типы данных

3.Типы архитектур высокопроизводительных вычислительных систем

3.1.Simd архитектура (с разделяемой и распределенной памятью)

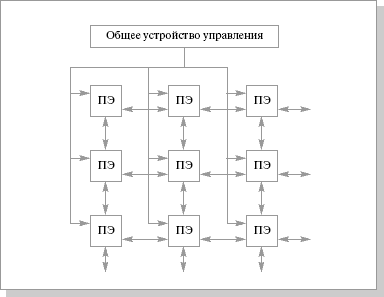

Чаще всего, при упоминании архитектуры SIMD, понимают матричные процессоры. Эти процессоры имеют общее управляющее устройство, которое генерирует поток команд. Также в составе есть несколько процессорных элементов, которые работают параллельно и каждый обрабатывает свой поток данных. По сути, общая производительность системы должна равняться сумме производительностей, входящих в нее элементов. Но чтобы приблизится к этой величине необходимо применять ряд технических решений. В частности, необходима организация связи между процессорными элементами для полной их загрузки. Пример такой связи приведен на рис. 3.1.

Рис. 3.1. Структура матричной вычислительной системы SOLOMON (60-е годы) [8]

В этом процессоре была реализована многомодальность. В каждом процессорном элементе существовал специальный регистр (регистр моды), которой имел четыре состояния. Мода попадала в этот регистр от устройства управления. В ходе выполнения команд моды передаются в коде операции и сравниваются со значением регистра. Если значения совпадают, то операция выполняется. В других случаях операция не выполняется, но процессорный элемент может передать свои операнды соседнему элементу. Такое решение позволяет выделять строки или столбцы процессорных элементов. Это очень удобно при работе с матрицами.

3.2. Mimd архитектура с разделяемой и распределенной памятью

Вторым по быстродействию устройством в компьютерах (после процессора) является оперативная память. Это связано с несколькими факторами. Во-первых, само время цикла работы с памятью tmem больше времени цикла работы центрального процессора tcp. Во вторых, при обращении к памяти она будет занята в течение времени tcp+tmem. Для уменьшения подобных задержек существует два возможных варианта. Организовать работу на основе разделяемой памяти, когда есть одна большая память и все процессоры имеют одинаковый доступ к ней. Или работать с распределенной памятью, выделив каждому процессору свою оперативную память (локальную) и запретить доступ к ней со стороны других процессоров. Разрабатывать программу, не зная какой тип памяти будет использоваться на данном параллельном компьютере, - бесполезное занятие. Так например, что делать при перемножении двух матриц? Если вы работаете по первому варианту, то можно один раз задать структуру данных и разместить ее в памяти. А если реализована разделяемая память, то необходимо создать копии матриц на каждом процессоре, т.е. послать всем процессорам сообщение с данными о матрицах.

Наиболее просто реализовать разделяемую память следующим образом – соединить одной шиной все процессоры, в конце поставив оперативную память. Конечно, такой вариант не идеален из-за постоянных конфликтов между процессорами. Если одни из процессоров начнет принимать или передавать данные, то доступ к оперативной памяти для остальных процессоров будет закрыт. Этот конфликт приводит к тому, что появляется предел производительности. Увеличение числа процессоров не будет приводить к увеличению производительности – шина станет узким местом. Однако, и это научились обходить. Достаточно ввести систему кэш-памяти для хранения команд. К каждому процессору добавляют локальную кэш-память. Причем, каждая следующая необходимая процессору команда будет с большой вероятностью находится там. Соответственно, уменьшается число обращений к шине уменьшится, а это позволит добавить в систему еще несколько процессоров. Проблема кэш-памяти – это ее локальность. Если двум процессорам понадобилось из общей памяти значение С1, то это значение скопируется в обе кэш-памяти. Один из процессоров меняет значение переменной и отправляет обратно в общую память. В это время второй процессор работает, совершенно ничего не подозревая, со старым значением С1. Такое несоответствие влечет необходимость постоянного обновления данных в кэш-памяти всех процессоров. Можно реализовать разделяемую память на нескольких физических модулях. Для процессоров эти устройства будут представлены как единое (подробнее в п.3.3). Но для правильной работы необходимы переключатели. Если обращений к одному и тому же дискретному модулю от разных процессоров не много, то быстродействие возрастет.

Для организации распределенной памяти, как было сказано выше, необходимо подключить собственную оперативную память каждому процессору. При такой архитектуре нет необходимости использовать общую шину и переключатели, т.е. исчезают конфликты, связанные с этими устройствами. Но взамен тех проблем появляются новые. Они связаны с корректной организацией обмена информацией между процессорами. Проще организовать такой обмен при помощи сообщений, в которых будут содержаться данные. На формирование, обработку, получение и отправление таких пакетов уходит время, что, естественно, сказывается на производительности.

Оба варианта организации работ с памятью с успехом применяются, что и нашло отражение в SMP и MPP системах.

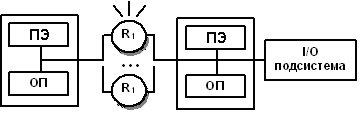

SMP (symmetric multiprocessing) – симметричная мультипроцессорная архитектура. Архитектура с общей разделяемой памятью. При такой организации все процессоры имеют одинаковые права на доступ к памяти и одинаковую адресацию для всех ячеек памяти (отсюда и название – симметричная). Такой способ очень удобен при обмене данными между процессорами. Основой в SMP-системе является высокоскоростная шина, к слотам которой можно подключить процессорные элементы (ПЭ), подсистему ввода/вывода (I/O). Работа контролируется операционной системой (ОС). Наиболее часто применяется такая система в серверах.

Рис. 3.2. Схематичный вид SMP-архитектуры [9]

За счет SMP-архитектуры можно получить простую и универсальную систему для программирования. В этой системе нет ограничений на модель программирования (можно организовать модель параллельных ветвей с независимыми процессорами или модель с межпроцессорным обменом). Кроме того можно получить доступ сразу ко всему объему памяти, возможность использовать средства автоматического распараллеливания (зачастую они оказываются достаточно эффективными), облегчить эксплуатацию системы, понизив ее цену.

Но поскольку система использует общую память, то ее недостатки напрямую связаны с недостатками систем с распределенной памятью, включающими плохую масштабируемость, частые конфликты между процессорными элементами, ограниченную пропускную способность системной шины. Так возможно использовать не более 32 процессоров (как следствие предыдущих трех недостатков).

Альтернативой SMP стала MPP-архитектура.

MPP(massive parallel processing) – массивно-параллельная архитектура. Как не сложно догадаться, эта архитектура основана на физически разделенной памяти. Такую систему можно строить на основе отдельных модулей, состоящих из процессорного элемента (ПЭ), локальной операционной памяти (ОП), двух коммуникационных процессоров (роутеры) или сетевого адаптера. Возможно подключение периферийных устройств. Наличие сразу двух сетевых адаптеров связано с тем, что один из них работает на передачу команд, другой – на передачу данных. В принципе, каждый модуль может выступать как самостоятельная, независимая ЭВМ. Доступ к ОП имеет только ПЭ из того же модуля. Между собой модули соединены коммуникационными каналами, по которым и происходит обмен информацией. Организовать работу MPP-систему можно двумя способами:

С управляющей машиной. В этом случае один из модулей работает в качестве основного, контролирующего все остальные. Именно на главном модуле будет стоять полновесная операционная система и программное обеспечение. На остальных модулях можно использовать урезанные варианты ОС и ПО, которые позволят модулю выполнять работу только его ветви распараллеленного приложения.

Равноправные модули. Каждый модуль имеет полноценные ОС и ПО.

Рис. 3.3. Схематичный вид MPP-архитектуры [9]

В отличие от SMP-систем, MPP легко масштабируется. Именно это является главным преимуществом. Число процессоров в таких системах может достигать нескольких тысяч.

Но MPP не лишена недостатков:

Меньшая, по сравнению с SMP, скорость межпроцессорного обмена. Это связано с тем, что необходима специальная техника программирования для корректного обмена информацией между процессорами.

Ограниченность объема памяти каждого из процессоров.

Может возникнуть ситуация, и это не редкость, когда часть оборудования не будет загружена полностью.

В качестве примеров MPP-систем можно привести такие суперкомпьютеры как Hitachi SR8000, CRAY T3E (эту систему можно масштабировать до 2048 процессоров).