- •В.В. Давнис, в.И. Тинякова эконометрические методы прогнозирования

- •1. Теоретические основы прогнозирования

- •1.1. Сущность экономического прогнозирования

- •1.2. Типология прогнозов

- •1.3. Этапы прогнозирования

- •2. Экстраполяция временных рядов

- •2.1. Сущность экстраполяции

- •2.2. Типы роста и трендовые модели

- •2.3. Метод наименьших квадратов (мнк)

- •В общем случае поиск оптимальных параметров сводится к решению нелинейной экстремальной задачи. Обычно рассматривают линейный случай

- •Решая линейную систему (2.26) с помощью замены

- •2.4. Адекватность. Критерий Дарбина – Уотсона

- •2.5. Критерии точности прогнозных расчетов

- •3. Регрессионный анализ и прогноз

- •3.1. Множественная регрессия

- •3.1.1. Основные понятия регрессионного анализа

- •3.1.2. Общий вид модели множественной регрессии

- •3.1.3. Метод наименьших квадратов в матричной форме

- •3.1.4. Парная регрессия как частный случай множественной

- •3.1.5. Мультиколлинеарность факторов

- •3.1.6. Особенности применение регрессионных моделей в прогнозных расчетах

- •3.2. Обобщенный регрессионный анализ

- •3.2.1. Обобщенная схема мнк

- •Здесь использован тот факт, что

- •3.2.2. Метод взвешенных наименьших квадратов

- •3.2.3. Корректировка стандартных ошибок

- •3.2.4. Тесты на гетероскедастичность

- •3.3. Регрессионные модели с автокоррелированными остатками

- •3.3.1.Общая схема мнк в случае автокорреляции первого порядка

- •3.3.2. Методы тестирования на автокорреляцию

- •3.3.3. Методы оценивания параметра

- •3.3.4. Прогнозные расчеты при автокоррелированных остатках

- •3.4. Регрессионные модели с лаговыми переменными

- •3.4.1. Общий вид моделей с лагами в независимых переменных

- •4. Авторегрессионные процессы и их модели

- •4.1. Стационарность

- •4.2. Модель авторегрессии

- •4.3. Понятие интеграции

- •4.4. Модели скользящей средней

- •4.5. Авторегрессионные модели скользящей средней

- •4.6. Авторегрессионные интегрированные модели скользящей средней

- •4.7. Коэффициент автокорреляции и проверка его значимости

- •4.8. Определение порядка моделей arma

- •4.9. Построение моделей arima

- •4.10. Проверка адекватности моделей arma

- •4.11. Оценка точности прогнозных расчетов по моделям arima

- •5. Адаптивные модели прогнозирования

- •5.1. Специфика адаптивного моделирования

- •5.2. Полиномиальные модели

- •5.3. Рекуррентный метод наименьших квадратов

- •5.4. Многофакторные адаптивные модели

- •5.5. Адаптивные многошаговые модели

- •5.6. Выбор начальных значений и

- •6. Прогнозирование сезонных колебаний

- •6.1. Моделирование периодических колебаний

- •Эта запись получена с использованием тригонометрического тождества

- •6.2. Аддитивная и мультипликативная модели

- •6.3. Моделирование сезонных колебаний

- •6.4. Адаптивные модели сезонных явлений

3.1.2. Общий вид модели множественной регрессии

Многофакторные

регрессионные модели дают хороший

результат только в тех случаях, когда

удается выделить наиболее значимые

факторы, а влиянием других факторов,

воздействующих на моделируемый процесс,

можно пренебречь. Такие ситуации в

экономике, как правило, создаются

искусственно, путем абстрагирования

от условий реальности, для изучения

эффектов влияния отдельных факторов.

В действительности, не удается

контролировать поведение всех

экономических переменных, т.е. фактически

не удается обеспечить равенство всех

прочих условий для выяснения влияния

исследуемой группы факторов. Поэтому,

чтобы учесть и все прочие условия в

модель, кроме факторов, вводится случайная

составляющая

![]() ,

позволяющая многофакторную регрессию

записать в виде

,

позволяющая многофакторную регрессию

записать в виде

![]() ,

(3.3)

,

(3.3)

где

![]() –

моделируемый показатель (зависимая

переменная);

–

моделируемый показатель (зависимая

переменная);

![]() –

вектор-строка

независимых переменных;

–

вектор-строка

независимых переменных;

![]() –

вектор-столбец

оцениваемых параметров;

–

вектор-столбец

оцениваемых параметров;

![]() –

функция, определяющая

структуру регрессионной модели;

–

функция, определяющая

структуру регрессионной модели;

![]() – ненаблюдаемая

случайная составляющая, характеризующая

ту долю вариации зависимой переменной,

которая не объясняется соответствующими

изменениями независимых переменных.

– ненаблюдаемая

случайная составляющая, характеризующая

ту долю вариации зависимой переменной,

которая не объясняется соответствующими

изменениями независимых переменных.

В экономических исследованиях чаще всего используется линейная форма зависимости

![]() ,

,

![]() (3.4)

(3.4)

или нелинейные формы

степенная:

![]() ;

;

экспонента:

![]() ;

;

показательная:

![]() ;

;

гипербола:

![]() ,

,

легко приводимые к линейным путем логарифмирования или замены переменных. Поэтому ниже будут рассматриваться методы построения только линейных моделей.

3.1.3. Метод наименьших квадратов в матричной форме

Для оценки параметров

линейного уравнения множественной

регрессии применяется метод наименьших

квадратов. Скалярный вариант этого

метода позволяет получать оценки

параметров

![]() путем решения

системы нормальных уравнений

путем решения

системы нормальных уравнений

(3.5)

(3.5)

которая получается путем дифференцирования суммы квадратов отклонений

![]() .

(3.6)

.

(3.6)

Современный подход к изложению регрессионного анализа основан на матричной алгебре. Поэтому ниже будет рассмотрен матричный вариант МНК.

Чтобы понять

переход от скалярного представления

регрессионной модели к матричному,

запишем регрессионное уравнение для

каждого

![]() -го

(

-го

(![]() )

наблюдения в виде следующей системы:

)

наблюдения в виде следующей системы:

(3.7)

(3.7)

Для удобства будем

считать, что коэффициент

![]() регрессионного уравнения в системе

(4.7) умножен на специально введенную

искусственную переменную

регрессионного уравнения в системе

(4.7) умножен на специально введенную

искусственную переменную

![]() .

С учетом введенной переменной эта

система может быть записана следующим

образом:

.

С учетом введенной переменной эта

система может быть записана следующим

образом:

.

(3.8)

.

(3.8)

Введя обозначения

;

;

;

;

;

;

,

,

перепишем (4.8) в компактной матричной форме

![]() .

(3.9)

.

(3.9)

Сумма квадратов отклонений МНК для (4.9) записывается следующим образом:

.

(3.10)

.

(3.10)

Выполнив умножение в (3.10)

![]()

и

продифференцировав по вектору

![]() результат

перемножения

результат

перемножения

![]() ,

,

получаем систему уравнений в матричной форме

![]() ,

(3.11)

,

(3.11)

решение которой позволяет записать выражение для оценки вектора параметров регрессионного уравнения следующим образом:

![]() .

(3.12)

.

(3.12)

Если выполняются гипотезы, лежащие в основе модели множественной регрессии:

1)

![]() –

спецификация модели;

–

спецификация модели;

2)

![]() –детерминированная

матрица, имеющая максимальный ранг

–детерминированная

матрица, имеющая максимальный ранг

![]() ;

;

3a)

;

3b)

;

3b)

,

,

то оценки (3.12) обладают рядом полезных свойств, описание которых приводится ниже.

Прежде всего,

покажем, что математическое ожидание

оценок МНК равно

![]() .

Для этого представим оценку в следующем

виде:

.

Для этого представим оценку в следующем

виде:

![]()

![]() .

(3.13)

.

(3.13)

Приведенное представление совместно с гипотезой 3а) позволяет записать

![]() .

(3.14)

.

(3.14)

Данное свойство принято назвать несмещенностью оценок МНК. Несмещенность – важное свойство, но его недостаточно для полного описания качественных характеристик вычисляемых по МНК оценок.

Второй качественной

характеристикой является стандартная

ошибка. Для

ее получения вычислим ковариационную

матрицу оценки

![]() ,

т.е. математическое ожидание произведения

отклонений оценки вектора параметров

от своего математического ожидания

,

т.е. математическое ожидание произведения

отклонений оценки вектора параметров

от своего математического ожидания

![]() .

(3.15)

.

(3.15)

Так как из (4.13)

следует

![]() ,

то, произведя замену, получаем

,

то, произведя замену, получаем

![]()

![]() .

(3.16)

.

(3.16)

Дисперсия

![]() ,

фигурирующая в (4.16), обычно неизвестна

и поэтому ее величина оценивается по

выборочным наблюдениям, т.е. принимается

равной

,

фигурирующая в (4.16), обычно неизвестна

и поэтому ее величина оценивается по

выборочным наблюдениям, т.е. принимается

равной

![]() ,

(3.17)

,

(3.17)

где

![]() – вектор

остатков, вычисление которых, в отличие

от случайных составляющих

– вектор

остатков, вычисление которых, в отличие

от случайных составляющих

![]() ,

становится возможным после построения

регрессионного уравнения, так как

,

становится возможным после построения

регрессионного уравнения, так как

![]() .

Таким образом, ковариационная матрица

векторной оценки имеет вид

.

Таким образом, ковариационная матрица

векторной оценки имеет вид

![]() .

(3.18)

.

(3.18)

Квадратные корни

из элементов главной диагонали матрицы

(3.18) принято называть стандартными

ошибками

коэффициентов регрессии. Эти ошибки

обозначают

![]() .

По теореме Гаусса – Маркова оценки МНК

имеют наименьшие стандартные ошибки в

классе линейных (по

.

По теореме Гаусса – Маркова оценки МНК

имеют наименьшие стандартные ошибки в

классе линейных (по![]() )

несмещенных оценок.

)

несмещенных оценок.

С помощью стандартных ошибок определяется уровень надежности вычисленных оценок коэффициентов регрессии: проверяются гипотезы относительно значимости оценок коэффициентов регрессии, строятся доверительные интервалы. Другими словами, с их помощью устанавливается надежность построенной модели.

Иногда построение уравнения множественной регрессии начинается с построения регрессии в стандартизованном масштабе

![]() ,

(3.19)

,

(3.19)

где

![]() ,

,

![]() – стандартизованные переменные;

– стандартизованные переменные;

![]() – стандартизованные

коэффициенты регрессии, которые принято

называть бета-коэффициентами. Они

получаются как решение системы нормальных

уравнений в стандартизованном масштабе

– стандартизованные

коэффициенты регрессии, которые принято

называть бета-коэффициентами. Они

получаются как решение системы нормальных

уравнений в стандартизованном масштабе

(3.20)

(3.20)

Коэффициентами

системы (20) являются парные коэффициенты

корреляции. Интересна содержательная

интерпретация

![]() -

коэффициентов. В отличие от коэффициентов

регрессии

-

коэффициентов. В отличие от коэффициентов

регрессии

![]() ,

которые зависят от масштаба измерений

зависимой и независимых переменных,

эти коэффициенты свободны от такой

зависимости и поэтому могут использоваться

для ранжирования факторов по степени

их влияния на моделируемый показатель.

Связь коэффициентов множественной

регрессии

,

которые зависят от масштаба измерений

зависимой и независимых переменных,

эти коэффициенты свободны от такой

зависимости и поэтому могут использоваться

для ранжирования факторов по степени

их влияния на моделируемый показатель.

Связь коэффициентов множественной

регрессии

![]() со стандартизованными коэффициентами

со стандартизованными коэффициентами

![]() определяется

соотношением

определяется

соотношением

![]() ,

(3.21)

,

(3.21)

что позволяет осуществить переход от стандартизованного уравнения к обычному, свободный член которого вычисляется через среднее значение по формуле

![]() .

(3.22)

.

(3.22)

В случае необходимости

(например, для ранжирования факторов

по степени воздействия на моделируемый

показатель) можно, не прибегая к построению

стандартизованного уравнения, определить

![]() - коэффициенты по коэффициентам регрессии

- коэффициенты по коэффициентам регрессии

![]()

![]() .

(3.23)

.

(3.23)

Кроме того,

![]() -

коэффициенты могут использоваться для

расчета множественного коэффициента

корреляции

-

коэффициенты могут использоваться для

расчета множественного коэффициента

корреляции

![]() ,

(3.24)

,

(3.24)

показывающего тесноту линейной связи независимых переменных, включенных в модель, с зависимой переменной.

В общем случае теснота совместного влияния факторов на моделируемый показатель оценивается индексом корреляции

,

(3.25)

,

(3.25)

значения которого для линейной модели совпадает с множественным коэффициентом корреляции.

Качество построенной модели в целом удобно оценивать с помощью коэффициента множественной детерминации, определяемого как квадрат индекса множественной корреляции, умноженного на 100

![]() (3.26)

(3.26)

и показывающего на сколько процентов изменение зависимой переменной объясняется соответствующими изменениями независимых переменных.

Для этих же целей, когда особое внимание обращается на статистическую значимость, используется скорректированный коэффициент множественной детерминации, рассчитываемый через скорректированный на число степеней свободы множественный индекс корреляции по формуле

![]() .

(3.27)

.

(3.27)

Значимость уравнения множественной регрессии в целом оценивается с помощью дисперсионного отношения Фишера (F-критерия)

![]() .

(3.28)

.

(3.28)

В числители критерия

(3.28) стоит сумма квадратов отклонений,

обусловленная регрессией («объясненная»

или «факторная»), деленная на число

степеней свободы

![]() ,

а в знаменателе – остаточная сумма

квадратов отклонений, деленная на (

,

а в знаменателе – остаточная сумма

квадратов отклонений, деленная на (![]() )

(остаточная дисперсия).

)

(остаточная дисперсия).

Если

![]() ,

то построенная модель считается

адекватной.

,

то построенная модель считается

адекватной.

![]() – это максимально возможное значение

дисперсионного отношения Фишера при

данных степенях свободы и доверительном

уровне

– это максимально возможное значение

дисперсионного отношения Фишера при

данных степенях свободы и доверительном

уровне

![]() (см. Приложение).

(см. Приложение).

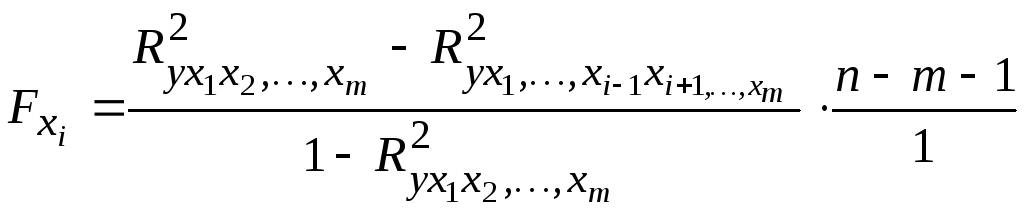

Частный F-критерий

позволяет оценить статистическую

значимость каждого из факторов,

включенного в модель. Для фактора

![]() значение частного F-критерия

определяется по формуле

значение частного F-критерия

определяется по формуле

.

(3.29)

.

(3.29)

Статистическая значимость каждого коэффициента регрессии оценивается также с помощью t-критерия Стьюдента

![]() ,

(3.30)

,

(3.30)

где

![]() –

средняя квадратическая ошибка коэффициента

регрессии, определяемая по формуле

–

средняя квадратическая ошибка коэффициента

регрессии, определяемая по формуле

.

(3.31)

.

(3.31)

Коэффициенты регрессии линейного уравнения интерпретируется как коэффициенты абсолютного роста. С их помощью можно рассчитать средние коэффициенты эластичности, которые определяются по формуле

![]() .

(3.32)

.

(3.32)