- •Статистический анализ взаимосвязи социально-экономических явлений

- •Брянск издательство бгту

- •Карабан, л.А. Статистический анализ взаимосвязи социально-экономических явлений: учеб.- практ. Пособие / л.А. Карабан. – бгту, 2010. – 152 с. – (Сер. «Необъятная статистика»).

- •Предисловие

- •Введение

- •Раздел I. МетоДы изучения взаимосвязей в статистике

- •Глава 1. Теоретические основы исследования взаимосвязей социально-экономических явлений

- •Виды и формы взаимосвязи между явлениями

- •1.2. Общие понятия о стохастических, функциональных и корреляционных связях

- •1.4. Основные приемы изучения взаимосвязей

- •Глава 2. Теоретические основы Корреляционного анализа

- •2.2. Статистические методы изучения корреляционной связи

- •2.3. Измерение тесноты корреляционной связи

- •Рассмотрим использование парных коэффициентов корреляции для измерения многофакторной связи

- •2.5. Корреляционный анализ порядковых переменных или ранговая корреляция

- •Рассмотрим применение коэффициента корреляции рангов Спирмэна

- •Оценим возможности использования коэффициента корреляции рангов Кендэлла

- •Определим возможности применения коэффициента конкордации

- •2.6. Корреляция категоризированных (номинальных) переменных

- •Рассмотрим использование коэффициентов взаимной сопряженности

- •Глава 3. Дисперсионный анализ как метод установления тесноты связи между Явлениями

- •3.1. Общее понятие и цели дисперсионного анализа

- •3.2. Оценка существенности и достоверности связи. Многофакторный дисперсионный анализ

- •Глава 4. Проведение регрессионного анализа

- •4.1. Построение однофакторного уравнения регрессии

- •4.3. Построение и статистический анализ двухфакторной линейной модели (трехмерной регрессии)

- •4. 4. Экономическая интерпретация многофакторной регрессионной модели

- •Раздел II. Практическая реализация методов расчета показателей связи ______________________________________________

- •Глава 1. Использование средств microsoft excel для оценки взаимосвязей явлений

- •1.1.Технология решения задач корреляционного

- •Рассмотрим процедуру построения системы показателей и анализ матрицы коэффициентов парной корреляции.

- •Проведём обзор выбора вида моделей с оценкой их параметров

- •Рассмотрим порядок проведения проверки качества построенной модели

- •Рассмотрим практическую оценку влияния отдельных факторов на зависимую переменную в построенной модели регрессии.

- •Разберём вопрос использования многофакторных моделей для анализа и прогнозирования развития экономических систем.

- •Глава 2. Примеры решения типовых задач

- •2.1. Определение параметров уравнения регрессии

- •2.2. Вычисление линейного коэффициента корреляции

- •2. 3. Задачи для закрепления изученного материала

- •2.4. Задачи для самостоятельного выполнения

- •Правила ответа на письменный тест

- •Заключение

- •Список использованной и рекомендуемой литературы

- •Приложения приложение 1

- •Приложение 2

- •Приложение 3

- •Приложение 4

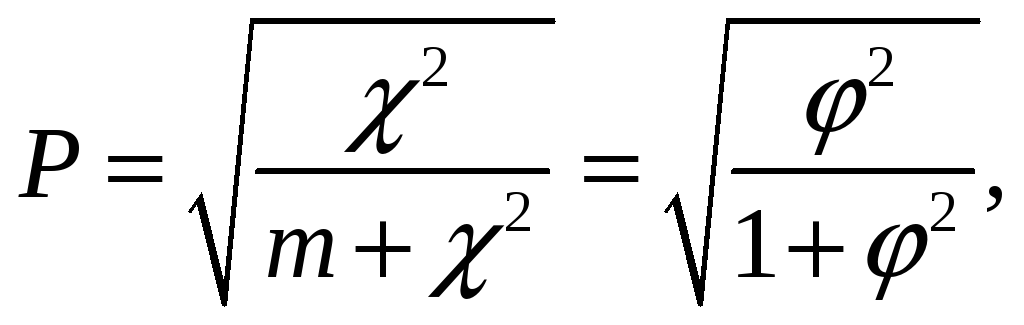

Рассмотрим использование коэффициентов взаимной сопряженности

Измерение

тесноты связи между номинальными

переменными производят с помощью

коэффициентов взаимной сопряженности.

Все они основаны на нормировании

![]() :

погашении

зависимости от числа наблюдений и

размерности таблицы. Все эти меры связи

изменяются в интервале [0,1].

:

погашении

зависимости от числа наблюдений и

размерности таблицы. Все эти меры связи

изменяются в интервале [0,1].

Коэффициент взаимной сопряженности К. Пирсона:

(39)

(39)

где

![]() .

.

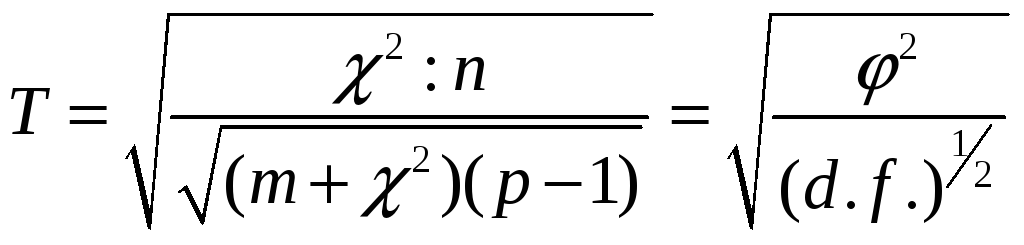

Этот коэффициент не принимает во внимание число категорий для переменных х и у. Более совершенным является коэффициент сопряженности А.А. Чупрова

.

(40)

.

(40)

Этот коэффициент, если таблица не квадратная, никогда не достигает 1.

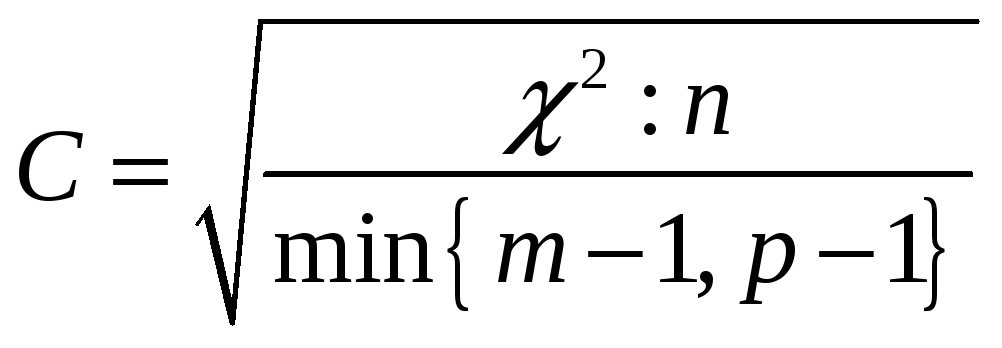

Модификацией этого коэффициента является коэффициент взаимной сопряженности Г. Крамера

, (41)

, (41)

т.е. в знаменателе подкоренного выражения берется минимальная из величин: число строк без единицы либо число столбцов без единицы.

Для квадратных таблиц Т=С.

По данным табл. 10

![]() ,

,

![]() .

.

Тогда Р=0,147; Т=С=0,147. Если таблица сопряженности не является четырехклеточной, то Р>(Т, С).

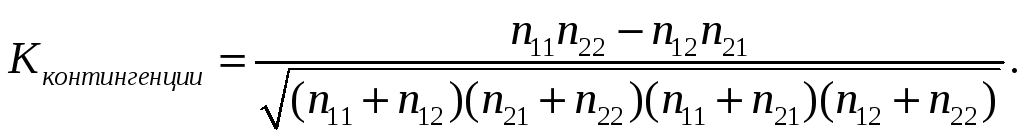

Для

таблиц 2![]() 2

разработаны специальные меры связи.

Основные из них – это коэффициент

ассоциации и коэффициент контингенции.

Коэффициент ассоциации рассчитывается

по формуле

2

разработаны специальные меры связи.

Основные из них – это коэффициент

ассоциации и коэффициент контингенции.

Коэффициент ассоциации рассчитывается

по формуле

.

(42)

.

(42)

По данным табл. 10 получаем

![]() .

.

Коэффициент контингенции вычисляется по следующей формуле:

(43)

(43)

По данным табл. 10 получаем

![]()

Коэффициент ассоциации дал значительно более высокую оценку тесноты связи. Недостаток использования этого коэффициента в том, что если хотя бы одна из клеточных частот равна нулю, то коэффициент ассоциации становится равным единице.

Таким образом, коэффициент контингенции – более надежная мера связи, нежели коэффициент ассоциации [3].

РЕЗЮМЕ

Особенность связей в экономике и социальной сфере состоит в том, что их закономерный характер проявляется лишь в массе явлений – в среднем по совокупности.

При статистической связи разным значениям одной переменной (фактора, х) соответствуют разные распределения другой переменной (результата, у).

Корреляционная связь – частный случай статистической связи, при которой разным значениям переменной соответствуют разные средние значения другой переменной.

Возможность измерения связей во многом зависит от уровня измерения переменных. Основные типы шкал: номинальная шкала, порядковая, интервальная.

Поле корреляции – это поле точек, на котором каждая точка соответствует единице совокупности; ее координаты определяются значениями признаков х и у.

Применяются различные зависимости для вычисления коэффициента корреляции как меры тесноты линейной связи. Он может быть определён на основе ковариации, коэффициента регрессии, правила разложения дисперсии.

Коэффициент парной корреляции изменяется от -1 (случай полной обратной связи) до 1 (случай полной прямой связи), по абсолютной величине от 0 до 1.

Частная корреляция – это измерение связи между двумя переменными при элиминировании прочих переменных. Различают частные корреляции разных порядков, которые могут быть определены на основе рекуррентной формулы.

Множественная корреляция – это измерение связи между несколькими переменными.

В этой главе приведено:

|

▼

▲ |

|

-

Методики измерения основных параметров, характеризующих корреляционные связи.

|

|

|