- •1. Основные определения.

- •2. Этапы обращения информации.

- •3. Понятие сигнала и его модели.

- •4. Формы представления детерминированных сигналов.

- •5. Представление сигнала в виде взвешенной суммы базисных функций. Понятие дискретного спектра сигнала и спектральной плотности.

- •6. Ортогональное представление сигналов.

- •7. Временная форма представления сигнала.

- •8. Частотная форма представления сигнала.

- •9. Спектры периодических сигналов.

- •10. Распределение энергии в спектре периодичного сигнала.

- •11. Спектры непериодических сигналов.

- •12. Распределение энергии в спектре непериодического сигнала. Равенство Парсеваля.

- •13. Соотношение между длительностью импульсов и шириной их спектра.

- •14. Спектральная плотность мощности детерминированного сигнала.

- •15. Функция автокорреляции детерминированного сигнала.

- •16. Случайный процесс как модель сигнала. Понятие ансамбля и пространства состояний. Виды случайных процессов.

- •17. Вероятностные характеристики случайного процесса.

- •18. Стационарные и эргодические случайные процессы.

- •19. Спектральное представление случайных сигналов.

- •20. Частотное представление стационарных случайных сигналов. Дискретные спектры.

- •21. Частотное представление стационарных случайных сигналов. Непрерывные спектры.

- •22. Основные свойства спектральной плотности.

- •23. Дискретизация непрерывных величин.

- •24. Квантование по времени. Теорема Котельникова.

- •25. Понятие модуляции.

- •26. Амплитудная модуляция.

- •27. Частотная модуляция.

- •28. Фазовая модуляция.

- •29. Модуляция импульсного тока.

- •30. Кодоимпульсные сигналы.

- •31. Многократная модуляция.

- •32. Количество информации в дискретных сообщениях. Энтропия дискретного источника.

- •33. Свойства энтропии.

- •34. Условия энтропии и ее свойства.

- •35. Передача информации от дискретного источника. Частное количество информации.

- •37. Частная условная энтропия. Условная энтропия источника. Апостериорная энтропия источника.

- •38. Количество информации в переданном сообщении дискретным источником.

- •39. Энтропия квантовой величины.

- •40. Количество информации в непрерывном сообщении. Априорная (безусловная) и апостериорная (условная) дифференциальные энтропии. Симметричность выражения количества информации.

- •43. Количество и скорость передачи информации при нормальном распределении сигнала и помехе (погрешности).

- •42. Количество информации, передаваемое за определенное время. Скорость передачи информации.

- •41. Количество передаваемой информации с учетом наличия аддитивной помехи.

- •44. Количество и скорость передачи информации при равномерном распределении сигнала и нормальном распределении помехи (погрешности).

- •45. Дифференциальная энтропия равномерно распределенной погрешности. Энтропийная погрешность.

- •46. Код, кодирование, кодовые сигналы.

- •47. Системы счисления.

- •48. Числовые коды.

- •49. Коды, не обнаруживающие возможных искажений.

- •50. Коды, обнаруживающие ошибки.

- •51. Информационная способность кода и избыточность.

- •52. Коды с коррекцией искажений.

42. Количество информации, передаваемое за определенное время. Скорость передачи информации.

41. Количество передаваемой информации с учетом наличия аддитивной помехи.

Интерес представляет среднее количество информации, принимаемая в единицу времени, т.е. средняя скорость передачи информации по данному каналу. Эта величина

![]() (47)

(47)

При независимом аддитивном шуме S(t) и нормальных распределениях “u” и “S” средняя скорость передачи информации

![]() (48)

(48)

Информационные характеристики применимы не только к системам передачи информации, но и к измерительным приборам и системам. Погрешность есть помеха, вносящая дезинформацию. При аддитивной независимой (помехе) погрешности справедливо соотношение, аналогичное (44):

![]() (49)

(49)

где I(U, W) – среднее количество информации получаемое при одном измерении величины u; Hдиф(W) и Hдиф() – дифференциальные энтропии воспроизводимой величины и погрешности.

Если к тому же измеряемая величина “u” и погрешность имеют нормальные распределения, то количество информации можно выразить через дисперсии этих величин по аналогии с (45):

![]() (50)

(50)

Рассматривая измеряемую величину, как случайную функцию времени, можем определить среднюю скорость получения информации при измерении по формуле (47). Если при этом “u” и - взаимно независимые величины с нормальными распределениями, то

![]() (51)

(51)

Если распределения “u” и отличны от нормальных, то получить столь простые формулы не удастся. Однако для случая, когда среднеквадратическое отклонение погрешности () много меньше среднеквадратического отклонения (u) измеряемой величины или диапазона измерений, т.е. разности (uкон-uнач), можно получить достаточно удовлетворительные приближенные соотношения. При (u)>>() ошибка в подсчете количества информации будет невелика, если в формуле (50) опустить слагаемое, равное 1, т.е. пользоваться выражением

![]()

Но это выражение можно также получить, если в формуле (49) заменить дифференциальную энтропию измеряемой величины Hдиф(W). Можно полагать, что при сформулированном условии относительной малости погрешности такая замена энтропий в формуле (49) справедлива не только для случая нормальных распределений “г” и . Итак, при относительно малых погрешностях

![]() (52)

(52)

44. Количество и скорость передачи информации при равномерном распределении сигнала и нормальном распределении помехи (погрешности).

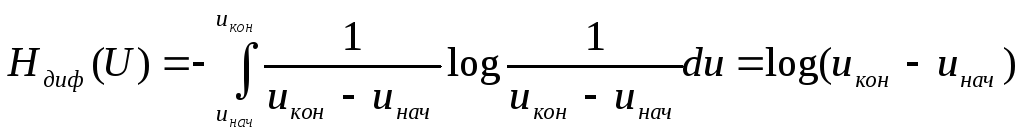

Предположим, что измеряемая величина “u” имеет равномерный закон распределения в диапазоне от начального uнач до конечного значения uкон. Дифференциальная энтропия такой величины

(53)

(53)

Если погрешность имеет нормальное распределение, то

![]() (54)

(54)

Тогда для равномерного распределения “u” и нормального распределения :

![]() (55)

(55)

45. Дифференциальная энтропия равномерно распределенной погрешности. Энтропийная погрешность.

Теперь рассмотрим случайный процесс u(t) с равномерным распределением “u” и равномерным спектром, ограниченным частотой Fmax. Если погрешность относительно мала, а закон распределения ее близок к нормальному, то скорость получения информации при измерении можно приближенно оценить по формуле

![]() (56)

(56)

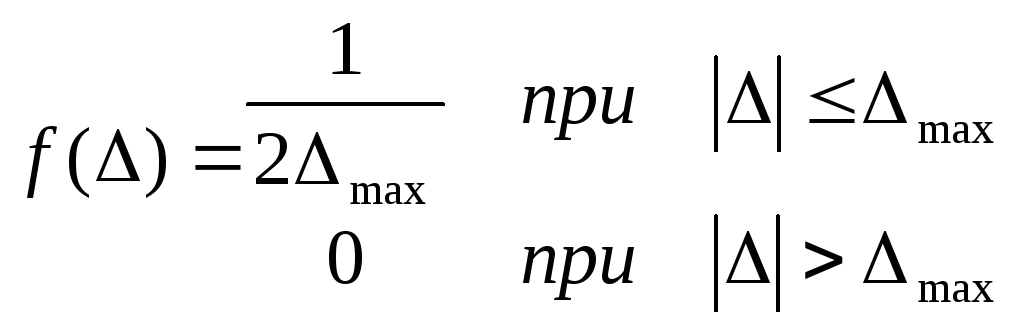

Рассмотрим случай, когда погрешность распределена равномерно в диапазоне от -max до +max, т.е.

(57)

(57)

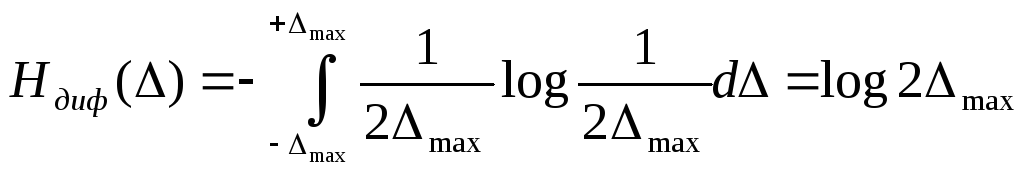

При этом

(58)

(58)

Существуют понятие энтропийной погрешности. Смысл ее состоит в том, что реальная погрешность заменяется некоторой условной погрешностью с равномерным распределением, причем максимальное значение условной погрешности выбирают так, чтобы величина создаваемой ею дезинформации была такой же, как и при данной реальной погрешности. Это максимальное значение и называется энтропийной погрешностью.

Например, при

реальной погрешности с нормальным

законом распределения нужно выбрать

![]() так,

чтобы были равны между собой величины

Hдиф(),

рассчитанные по формулам (54) и (58). Величину

так,

чтобы были равны между собой величины

Hдиф(),

рассчитанные по формулам (54) и (58). Величину

![]() выбирают

из условия

выбирают

из условия

![]()

Отсюда

![]()

Следовательно, при нормальном распределении реальны погрешности энтропийная погрешность приблизительно вдвое больше среднеквадратического отклонения.

Применяя информационные критерии к измерительным преобразователям, следует помнить, что у них выходная величина не должна равняться входной “u”: поэтому нужно вместо брать величину, пересчитанную от выхода преобразователя к его входу, и определять погрешность в единицах входной величины.