- •«Оренбургский государственный университет»

- •Методические указания для выполнения расчетно-графического задания по дисциплине «Статистика»

- •Содержание

- •Методические указания по выполнению расчетно-графического задания

- •Абсолютные, относительные и средние величины Теоретические основы статистического изучения абсолютных, относительных и средних величин

- •Решение типовой задачи

- •Решение

- •Задание для самостоятельного освоения Вариант №1

- •Вариант №2

- •Вариант №3

- •Вариант №4

- •Вариант №5

- •Сводка и группировка статистических показателей Теоретические основы статистической сводки и группировки

- •Решение типовых задач Задача №1 – Типологическая группировка

- •Решение задачи №1:

- •Задача №2 – Аналитическая группировка

- •Задание для самостоятельного освоения Вариант №1

- •Вариант №2

- •Вариант №3

- •Вариант №4

- •Вариант №5

- •Статистическое изучение структуры Теоретические основы статистического изучения

- •Решение типовой задачи

- •Решение

- •Задание для самостоятельного освоения Вариант №1

- •Вариант №2

- •Вариант №3

- •Вариант №4

- •Вариант №5

- •Корреляционно-регрессионный анализ Теоретические основы статистического изучения

- •Решение типовой задачи

- •Решение:

- •Задание для самостоятельного освоения Вариант №1

- •Вариант №2

- •Вариант №3

- •Вариант №4

- •Вариант №5

- •Анализ временных рядов Теоретические основы статистического изучения

- •Решение типовых задач

- •Задача №2 – Выявление тренд составляющей

- •Задача №3 – Выявление сезонной составляющей

- •Задание для самостоятельного освоения

- •Рекомендуемая литература

- •Статистика государственных финансов

- •Решение типовой задачи статистика денежного обращения

- •Статистика налогов и налогообложения

- •Список использованных источников

Корреляционно-регрессионный анализ Теоретические основы статистического изучения

Одним из важнейших понятий в статистике является понятие взаимосвязей:

Корреляционные (вероятностные, стохастические) взаимосвязи – проявляется при большом числе наблюдений в виде определенной зависимости между средним значением результативного признака и признаками-факторами.

В статистике различают следующие варианты зависимостей:

-

парная корреляция – связь между двумя признаками, один из которых результативный, а другой факторный;

-

частная корреляция – зависимость между результативным и одним факторным признаком, при фиксированном значении других факторных признаков;

-

множественная корреляция - зависимость результативного признака от нескольких факторных признаков.

-

каноническая корреляция – зависимость группы результативного признака от группы факторных признаков.

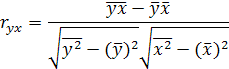

Коэффициент линейной корреляции был предложен английским статистиком К.Пирсоном. Его интерпретация такова: отклонение признака-фактора от его среднего значения на величину своего среднего квадратического отклонения в среднем по совокупности приводит к отклонению признака-результата от своего значения на r его среднего квадратического отклонения.

Коэффициент корреляции является отвлеченным показателем, характеризующим тесноту связи между переменными, если эта связь линейная. Одной из формул расчета показателя является следующая:

Коэффициент корреляции обладает следующими свойствами:

-

Принимает значения на отрезке [-1;1]

-

0 – связь между x и y отсутствует;

-

(0-0,3] - связь присутствует но она незначительна;

-

(0,3-0,5] - умеренная связь;

-

(0,5-0,7] - средняя связь;

-

(0,7-0,99] - тесная связь;

-

1 - связь между x и y функциональная.

Следующий коэффициент – коэффициент детерминации, равный квадрату коэффициента корреляции r2, выраженный в процентах и показывающий, какой процент вариации результата признака объясняется вариацией факторного признака.

В статистике выделяют различные виды регрессионные модели.

Парная регрессия - представляет собой регрессию между двумя переменными. В качестве примера можно назвать зависимость прибыли предприятия (зависимая переменная) от производительности труда (объясняющая переменная);

Множественная регрессия - регрессия между зависимой переменной у и несколькими причинно обусловленными объясняющими (независимыми, или предсказывающими) х1 х2,..., хт. Так, имеется множественная регрессия между прибылью предприятия (y) и производительностью труда (x1), объем основных фондов (x2), объем оборотных средств (x2).

следующие формулы для нахождения параметров уравнения:

![]()

![]()

а0 – не имеет экономической интерпретации, но существует мнение, что он показывает усредненное влияние всех прочих факторов, не включенных в исследование.

а1 – коэффициент регрессии, показывает, на сколько в среднем изменится величина результативного признака y при изменении факторного признака x на натуральную единицу.

Если а1 >0 то связь прямая, если а1 < 0 то связь обратная.

Коэффициенты условно-чистой регрессии аj являются именованными числами, выраженными в разных единицах измерения, и поэтому несравнимы друг с другом. Для преобразования их в сравнимые относительные показатели применяется следующий метод:

Стандартизованный коэффициент регрессии или - коэффициентом:

![]()

Показывает, на сколько среднеквадратических отклонений () изменится результативный признак если величина факторного признака изменяются на одно среднеквадратическое отклонение.

Коэффициент эластичности:

![]()

Показывает на сколько процентов в среднем изменится значение зависимой переменной y если независимая переменная x изменится на 1%.