- •Тема 1. Случайные события

- •2 Алгебра событий.

- •3 Определения вероятности события.

- •4 Элементы комбинаторики

- •1 Теоремы сложения вероятностей.

- •4 Формула полной вероятности. Формула вероятности гипотез.

- •Тема 2. Повторные независимые испытания

- •2 Наивероятнейшее число наступлений события в независимых испытаниях.

- •3 Локальная теорема Муавра-Лапласа.

- •4 Интегральная теорема Муавра-Лапласа. Пуассоновское приближение

- •Тема 3. Дискретные случайные величины

- •2 Закон распределения вероятностей дискретной случайной величины.

- •3 Математическое ожидание и его свойства.

- •4 Дисперсия дискретной случайной величины и ее свойства

- •5 Одинаково распределенные взаимно-независимые случайные величины

- •Тема 4. Непрерывные случайные величины

- •2)Дифференциальная функция (плотность распределения) непрерывной случайной величины и ее свойства.

- •Тема 5. Основные законы распределения случайных величин

- •1. Основные законы распределения дискретных случайных величин.

- •2) Равномерное распределение

- •Тема 6. Функции случайных величин и векторов

- •2) Композиция законов распределения

- •3) Специальные законы распределения

- •Тема 7. Многомерные случайные величины

- •2)Функции распределения многомерной случайной величины.

- •3)Вероятность попадания двумерной случайной величины в полуполосу и прямоугольник.

- •4)Числовые характеристики системы двух случайных величин

- •Тема 8. Закон больших чисел

- •2)Неравенство и теорема Чебышева

- •3)Понятие о центральной предельной теореме

- •Часть II. Математическая статистика

- •Тема 10. Вариационные ряды распределения

- •1) Понятие и виды вариационных рядов распределения.

- •2) Графическое изображение рядов распределения и связь между ними.

- •1) Понятие и виды вариационных рядов распределения

- •2) Графическое изображение рядов распределения и связь между ними.

- •1) Средняя арифметическая и ее свойства.

- •2) Дисперсия ряда распределения и ее свойства. Среднее квадратическое отклонение.

- •3)Моменты ряда распределения и связь между ними

- •Тема 11. Выборочный метод

- •2)Статистические оценки выборочной совокупности и их свойства.

- •3) Точечные и интервальные оценки.

- •Тема 12. Проверка статистических гипотез

- •1)Понятие и виды статистических гипотез.

- •2)Статистический критерий проверки гипотез.

- •3)Уровень значимости. Мощность критерия.

- •2)Статистический критерий проверки гипотез

- •Тема 13. Дисперсионный анализ

- •1)Понятие и модели дисперсионного анализа.

- •2)Однофакторный дисперсионный анализ.

- •1)Понятие и модели дисперсионного анализа.

- •2)Однофакторный дисперсионный анализ.

- •4.1.2.3. Двухфакторный дисперсионный анализ. Факторы а и в

- •Тема 14. Корреляционно-регрессионный анализ

- •1)Понятие корреляционной зависимости.

- •2) Оценка методом наименьших квадратов коэффициентов регрессии

- •Тема 15. Статистический анализ временных рядов

- •1)Понятие экономического временного ряда и его составляющие.

- •2)Тренд динамического ряда.

- •2)Тренд динамического ряда

4.1.2.3. Двухфакторный дисперсионный анализ. Факторы а и в

Основное уравнение двухфакторного дисперсионного анализа

SS

= SS![]() +

SS

+

SS![]() +

SS

+

SS![]() +

SS

+

SS![]() (12.17)

(12.17)

Одинаковое число повторных опытов (m= 1,2,…,n):

SS=![]() ,

(12.18)

,

(12.18)

где SS- общая сумма квадратов разностей наблюдений и их среднего значения (сумма квадратов общих эффектов);

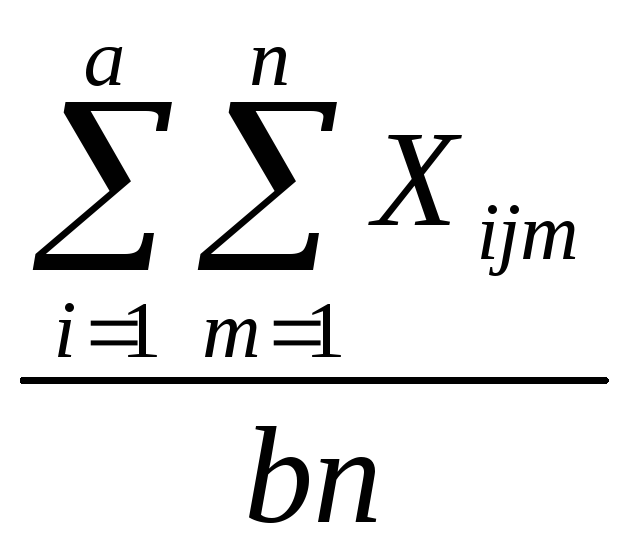

SS![]() =bn

=bn![]() ,

(12.19)

,

(12.19)

где SS- вклад в общую сумму квадратов, обусловленный различиями в уровнях фактора А, или взвешенная сумма квадратов эффектов фактора А (сумма квадратов между группами);

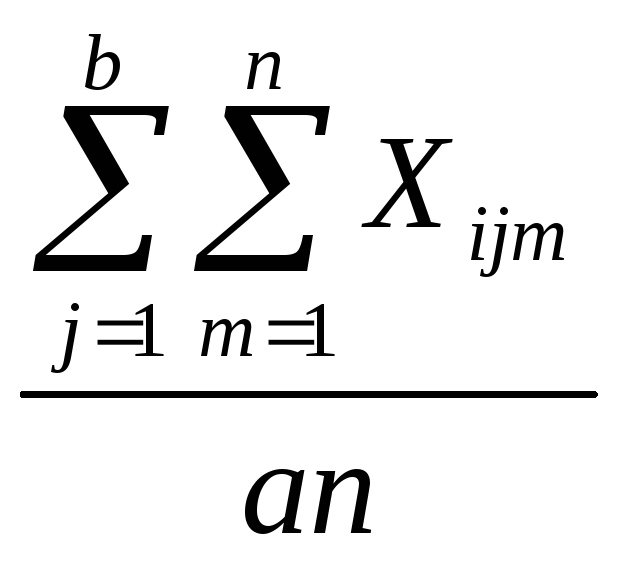

SS![]() =an

=an![]() ,

(12.20)

,

(12.20)

где

SS![]() - взвешенная сумма квадратов эффектов

фактораB(сумма квадратов

между группами);

- взвешенная сумма квадратов эффектов

фактораB(сумма квадратов

между группами);

SS![]() =n

=n

![]() ,

(12.21)

,

(12.21)

где

SS![]() - взвешенная сумма квадратов взаимодействия

уровней факторов А и В или смешанный

эффект факторов А и В (сумма квадратов

между группами);

- взвешенная сумма квадратов взаимодействия

уровней факторов А и В или смешанный

эффект факторов А и В (сумма квадратов

между группами);

SS![]() =

=![]() ,

(12.22)

,

(12.22)

где

SS![]() - сумма квадратов внутри групп – остаток,

вклад в общую сумму квадратов, вызванный

случайной изменчивостью данных внутри

групп;

- сумма квадратов внутри групп – остаток,

вклад в общую сумму квадратов, вызванный

случайной изменчивостью данных внутри

групп;

![]() =

=

,

(12.23)

,

(12.23)

где

![]() -

общее среднее,N=abn– общее число опытов;

-

общее среднее,N=abn– общее число опытов;

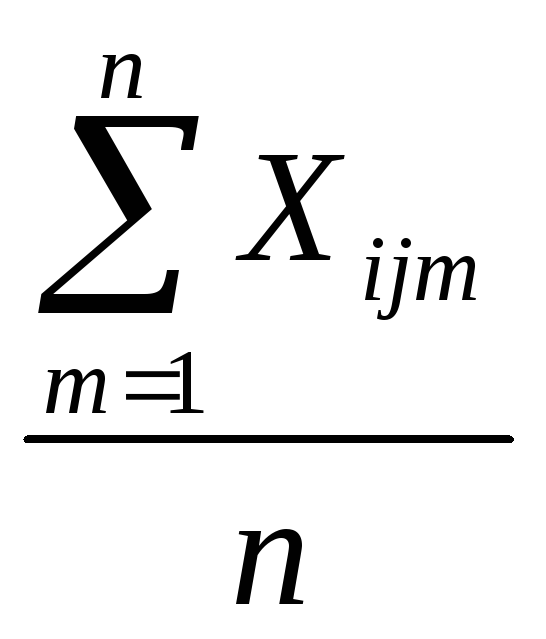

![]() =

=

,

,![]() =

= , (12.24)

, (12.24)

где

![]() ,

,![]() -

средние значения наiуровне фактора А,jуровне

фактораBсоответственно.

-

средние значения наiуровне фактора А,jуровне

фактораBсоответственно.

![]() =

=

,

(12.25)

,

(12.25)

где

![]() -

среднее значение при различных сочетаниях

уровнейij.

-

среднее значение при различных сочетаниях

уровнейij.

При

разном числе повторных опытов (m=1,2,…,n![]() )

суммирование ведется не доn,

а доn

)

суммирование ведется не доn,

а доn![]() ,

т.е. -

,

т.е. -![]() .

.

Оценки дисперсий и определение числа степеней свободы

S![]() =

=

![]() , (12.26)

, (12.26)

где

![]() -

оценка общей дисперсии;

-

оценка общей дисперсии;

![]() ν=N- 1 - число степеней

свободы при определении общей дисперсии;

ν=N- 1 - число степеней

свободы при определении общей дисперсии;

S![]() =

=![]() ,S

,S![]() =

=![]() ,

,

где

![]() -

оценка дисперсии по уровням фактора А;ν

-

оценка дисперсии по уровням фактора А;ν![]() =a–1 - число степеней

свободы фактораA;

=a–1 - число степеней

свободы фактораA;![]() -

оценка дисперсии по уровням фактораB;

-

оценка дисперсии по уровням фактораB;

ν![]() =b–1 - число степеней

свободы фактораB;

=b–1 - число степеней

свободы фактораB;

S![]() =

=

![]() ,

(12.27)

,

(12.27)

где

![]() - оценка дисперсии по уровням факторовAиB;

- оценка дисперсии по уровням факторовAиB;

νab= (a–1)(b–1) -число степеней свободы взаимодействия факторовAиB;

S![]() =

=

![]() , (12.28)

, (12.28)

где

![]() -

остаточная оценка дисперсии (дисперсия

ошибки);

-

остаточная оценка дисперсии (дисперсия

ошибки);

ν![]() =N–ab=ab(n- 1) - число степеней свободы при определении

ошибки.

=N–ab=ab(n- 1) - число степеней свободы при определении

ошибки.

Общее число степеней свободы:

![]() =

ν

=

ν![]() +

+

![]() +

+

![]() +ν

+ν![]() =N– 1 = (a–1)(N–a)

(12.29)

=N– 1 = (a–1)(N–a)

(12.29)

Проверка

H![]() -

гипотезы

-

гипотезы

Определение расчетного значения критерия:

F=

![]() ;F

;F![]()

![]() =

=

![]() ;F

;F![]()

![]() =

=![]() ;F

;F![]()

![]() =

=

![]() . (12.30)

. (12.30)

Критическое

значение F![]() определяется приν

определяется приν![]() =ν

=ν![]() иν

иν![]() =ν

=ν![]() .

.

Если

F![]()

![]() F

F![]() при α ,ν

при α ,ν![]() ,ν

,ν![]() ,

то гипотезаH

,

то гипотезаH![]() -

принимается.

-

принимается.

В противном случае – отклоняется и продолжается анализ гипотез о влиянии уровней факторов.

Тема 14. Корреляционно-регрессионный анализ

1)Понятие корреляционной зависимости.

2) Оценка методом наименьших квадратов коэффициентов регрессии

В экономике большую роль играет исследование зависимостей и взаимосвязей между объективно существующими явлениями и процессами. Оно дет возможность глубже понять сложный механизм причинно-следственных отношений между явлениями. Для исследования интенсивности, вида и формы причинных влияний в эконометрике применяется корреляционно - регрессионный анализ. Он находит широкое применение при прогнозировании, при решении задач народнохозяйственного и внутрихозяйственного планирования, при выявлении факторов, воздействуя на которые можно вмешиваться в экономический процесс с целью получения нужных результатов

Под причинной связью понимают такое соединение явлений и процессов реальной действительности, когда изменение одного из них - это следствие изменения другого. Часто одно и тоже явление может выступать как результат одной или нескольких причин и в то же время само служит причиной наступления других явлений и процессов.

Функциональная связь y=f(x): для каждой независимой переменной Х существует вполне определенное значение зависимой переменнойY.

Статистическая или стохастическая (вероятностная) связь отражает закономерности только в массовых явлениях.

Статистической зависимостью называют зависимость, при которой изменение одной из величин влечет изменение распределения другой.

Статистическую зависимость называют корреляционной, если при изменении значений одной величины меняется среднее значение другой.

Корреляция означает соответствие, соотношение.

При изучении конкретных зависимостей вводят понятия:

- факторные признаки (факторы) - объясняющие, независимые переменные, причины Х. Могут быть случайными и неслучайными;

- результативные признаки (показатели) – объясняемые зависимые переменные Y, случайные.

Иногда Х и Yможно менять местами.

С корреляционным анализом тесно связан регрессионный. Их объединяют методы обработки данных, отличают цели и формы установления связи. В корреляционном анализе оценивается сила стохастической связи, в регрессионном – форма.

Регрессия – это односторонняя стохастическая зависимость, когда одна из переменных служит причиной для изменения другой.

а) Относительно характера корреляции:

− положительная (равнонаправленная, прямая);

− отрицательная (обратная).

б) Относительно числа переменных:

− простая или парная;

− множественная, с ее помощью можно охватить весь причинно-следственный комплекс;

− частная корреляция, корреляция между двумя переменными при фиксированном влиянии других (вскрывается внутренняя структура соотношений, т.е. элиминируется влияние других факторов).

в) Относительно формы связи:

− линейная;

− нелинейная.

г) Относительно типа связи явлений:

− непосредственная корреляция;

− косвенная корреляция;

− ложная корреляция.

Виды регрессии.

а) Относительно числа явлений (переменных), учитываемых в регрессии:

− простая регрессия (парная) регрессия;

− множественная или частная регрессия.

б) Относительно формы зависимости:

− линейная регрессия;

− нелинейная регрессия.

в) Относительно характера регрессии (имеет смысл только для простой линейной регрессии):

− положительная регрессия;

− отрицательная регрессия.

г) Относительно типа связи явлений:

− непосредственная регрессия – причина прямо воздействует на следствие;

− косвенная регрессия, Yи Х не состоят в прямой зависимости, а детерминируются общей для них причиной, через третью переменную;

− нонсенс- регрессия (абсурдную).

Задачи корреляционного и регрессионного анализа

а) Измерение степени связности (тесноты, силы, строгости, интенсивности) двух и более явлений:

− уточняет (верифицирует) известные связи;

− обнаруживает неизвестные.

б) Отбор факторов, оказывающих наибольшее влияние на Y, на основании степени связности – эти факторы потом используют в регрессионном анализе.

в) Обнаружение неизвестных причинных связей – непосредственно не определяет их, но устанавливает степень необходимости этих связей и достоверность суждения о них, чтобы не было «ложной» корреляции.

г) Установление формы зависимости (для случая парной регрессии):

− убывающая;

− возрастающая.

д) Определение функции регрессии.

е) Оценка неизвестных значений зависимой переменной – можно воспроизвести значение Yпри заданных значениях Х внутри интервала (интерполяция) и вне интервала (экстраполяция заданных изменений Х).

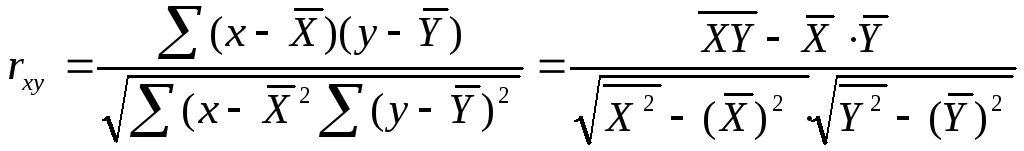

Корреляционная связь чаще всего характеризуется выборочным коэффициентом корреляции r, который характеризует степень линейной функциональной зависимости между Х и Y. Коэффициент корреляции имеет следующие свойства:

![]() ;

;

Если r= 1, то между Х и Y существует функциональная линейная

зависимость;

Если r=0, то Х и Y некоррелированны

Если Х и Y образуют систему нормально зависимых СВ, то из их некоррелированности следует их независимость;

Коэффициенты корреляции YнаXиXнаYсовпадают.

Существует достаточно много методов оценки r, основные из них:

а) в случае парной зависимости - коэффициент корреляции Пирсона:

,

(13.1)

,

(13.1)

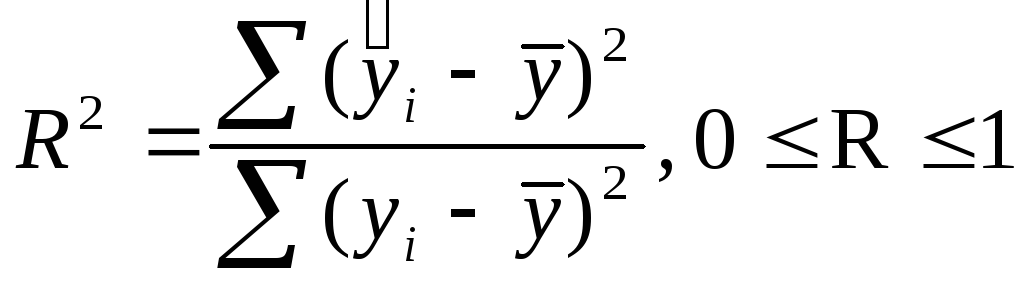

![]()

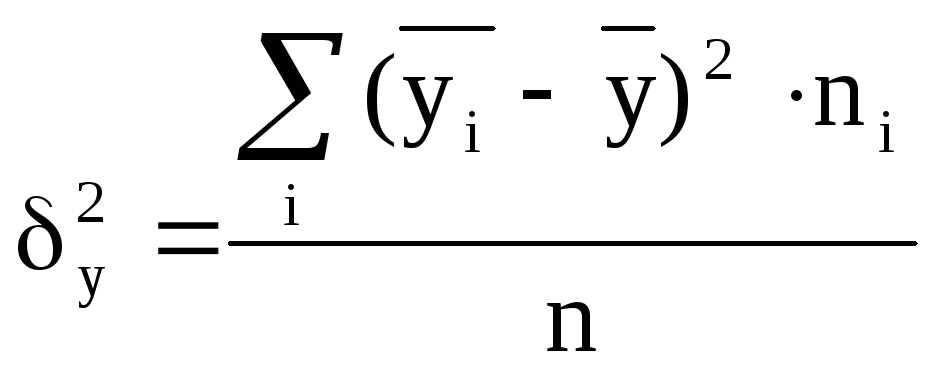

R2- множественный коэффициент детерминации, характеризующий долю зависимости независимой переменной от зависимых. Коэффициент корреляции характеризует степень линейной зависимости между переменными. Нелинейная связь не обнаруживается. В этом случае для оценки используется корреляционное отношение. Корреляционным отношениемYиXназывается отношение межгруппового среднего квадратического отклонения δy переменнойYк её общему среднему квадратическому отклонению σy

![]() ,

(13.2)

,

(13.2)

где межгрупповая дисперсия определяется по формуле

.

.

.Основные свойства корреляционных отношений:

1)

![]() ;

;

2) если η=0,то корреляционная связь отсутствует;

3) если η=1,то переменные связаны функционально;

4)

для линейной зависимости между переменными

XиYнеобходимо

и достаточно, чтобы выполнялось равенство![]() ;

;

5)

ηXY![]() ηYX;

ηYX;

6)

![]()

В других случаях (когда вид распределения неизвестен) используют меры связи, не регламентирующие нормальность выборок (методы непараметрической статистики), например, коэффициент ранговой корреляции Спирмена -rs:

(13.3)

(13.3)

где

![]() - квадраты разности рангов,

- квадраты разности рангов,

n - число наблюдений (число пар рангов).

Ранг - это порядковый номер значений признака, расположенных в порядке возрастания или убывания их величин.

Оценка методом наименьших квадратов коэффициентов регрессии

По результатам эксперимента могут быть определены не «истинные» коэффициенты регрессии , соответствующие генеральной совокупности, а лишь их оценки B = (b0,b1, … ,bj,…, bd), вычисленные по выборке объемом n. В этом случае уравнение регрессии в векторной форме имеет вид:

Ŷ=(Х,В), (13.4)

где Ŷ – предсказанные (прогнозируемые) значения выходной величины.

При выводе и использовании формул регрессионного анализа удобнее пользоваться векторной формой представления уравнений регрессии:

=Х+; Ŷ=ХВ , (13.5)

где - вектор наблюдений; Х – матрица значений независимых переменных;,В – векторы коэффициентов и их оценок соответственно;- вектор ошибок:

Первый столбец матрицы Х содержит фиктивную переменную

х i0=1, i=1,2,…, n.

После вычисления коэффициентов регрессии нужно вернуться к первоначальным обозначениям для того, чтобы облегчить интерпретацию результатов.

Задачи регрессионного анализа:

вычисление коэффициентов регрессии;

проверка значимости коэффициентов регрессии;

проверка адекватности модели;

выбор “лучшей” регрессии;

- вычисление стандартных ошибок.

Проверка адекватности модели основана на методах дисперсионного анализа.

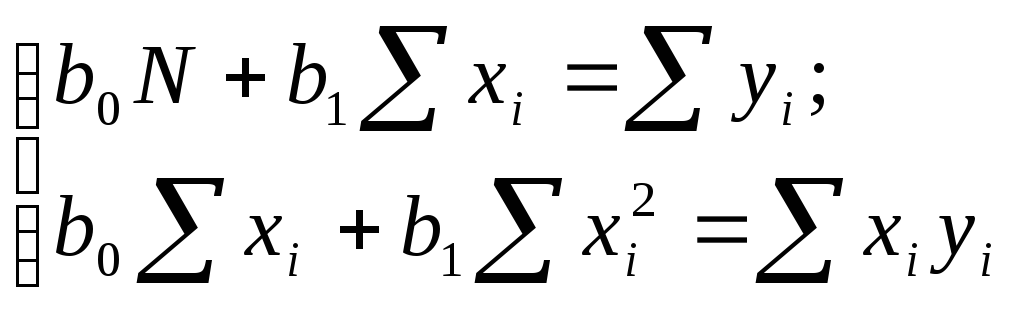

Парная

регрессия.Рассмотрим решение системы

нормальных уравнений в простейшем

случае – линейная регрессия от одного

фактора х, число определяемых коэффициентов:

d=2;

![]() Система нормальных уравнений

Система нормальных уравнений

![]() (13.6)

(13.6)

Ршив систему (4.4.8′′) относительно b0и b1, получим искомое уравнение, которое носит название регрессии Y на Х.

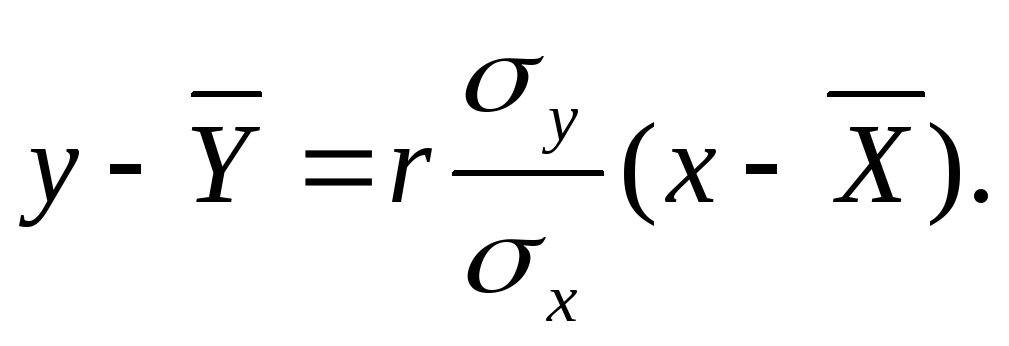

Если Х и Y - система двух нормально распределенных случайных величин, то, преобразуя (13.6) уравнение регрессии Y на Х можно записать:

(13.7)

(13.7)

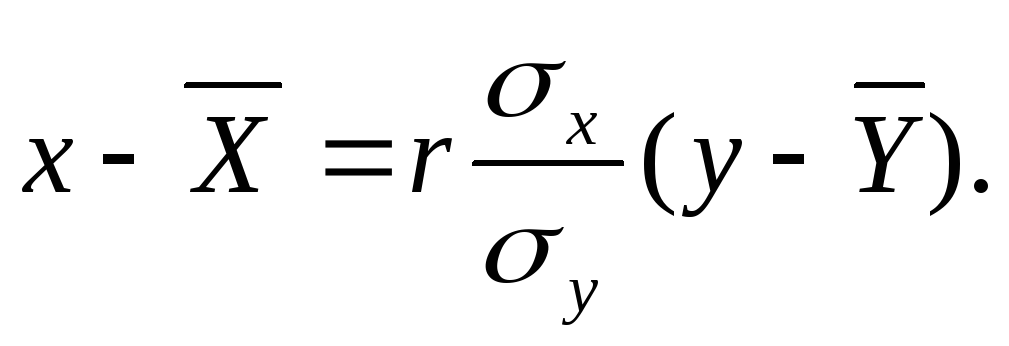

Соответственно уравнение регрессии Х на Y:

(13.8)

(13.8)

После построения уравнения регрессии возникает вопрос о качестве решения. Адекватность линии регрессии зависит от того, какая часть суммы квадратов относительно среднего обусловлена суммой квадратов относительно регрессии, а какая суммой квадратов обусловленной регрессией. Суммы квадратов связаны с некоторым числом - числом их степеней свободы =df. Это число показывает, сколько независимых элементов информации (из n чисел y1,y2,...,yn) необходимо для образования данной суммы квадратов.

Для

построения таблицы дисперсионного

анализа необходимо получить средние

квадраты (MS), для этого каждая сумма SS

делится на соответствующие число

степеней свободы df (

![]() ).

).

Если

в уравнении регрессии (y=b0+b1x)

b1=0, то величина![]() распределена по распределению Фишера

c (1, n-2) степенями свободы. Этот факт

используется для проверки гипотезы Н0:

b1=0 с уровнем значимости(риском ошибиться не более чем в100%

случаев), против альтернативы Н1:b10.

распределена по распределению Фишера

c (1, n-2) степенями свободы. Этот факт

используется для проверки гипотезы Н0:

b1=0 с уровнем значимости(риском ошибиться не более чем в100%

случаев), против альтернативы Н1:b10.

Обобщим все в таблице дисперсионного анализа

Таблица дисперсионного анализа (основное разложение)

|

Источник вариации |

Число степеней свободы, df |

Суммы квадратов, SS |

Средние квадраты, MS |

Fрасч. |

Fкр. |

|

Обусловленный регрессией |

1 |

|

MSR |

|

F(1, n-2) |

|

Относительно регрессии (остаток) |

n-2 |

|

|

|

|

|

Общий, скорректирован-ный на среднее Y |

n-1 |

|

|

|

|

Если Fрасч.>Fкр.при заданном уровне значимостии соответствующих числах степеней свободы, то гипотеза Н0: b1=0 отбрасывается с риском ошибиться не более чем в100% случаев (и уравнение регрессии считается статистически значимым).

Доля суммы квадратов, объясняемая регрессией называется множественным коэффициентом детерминации (квадратом множественного коэффициента корреляции R):

.

(13.9)

.

(13.9)

Значимость

R2определяется поF-критерию.![]()

![]() .

ЕслиFрасч.>Fкр.,

то гипотезу Н0:R=0

отвергают и связь междуxиyсчитают статистически

значимой. Если Y зависит только от одной

переменной Х, то R=r - парному коэффициенту

корреляции.

.

ЕслиFрасч.>Fкр.,

то гипотезу Н0:R=0

отвергают и связь междуxиyсчитают статистически

значимой. Если Y зависит только от одной

переменной Х, то R=r - парному коэффициенту

корреляции.