- •В.А. Павский

- •Оглавление

- •Часть 1. Понятие случайного события и его вероятности……..9

- •Часть 2. Случайные величины и функции распределения…….52

- •Часть 3. Предельные теоремы…………………………………………….130

- •Часть 4. Элементы математической статистики………………..141

- •Введение

- •Часть 1. Понятие случайного события и его вероятности

- •Операции над событиями

- •Кроме того, если выполнено условие

- •Следствия из аксиом

- •Из определения сразу следует, что

- •Элементы комбинаторики

- •Пример 5. Сколько существует размещений с повторениями при выборкеkшаров изn?

- •1.3 Вычисление вероятностей событий

- •1.3.1 Классический метод вычисления вероятностей

- •Пример.Поnящикам случайно распределяютсяnшаров. Считая, что ящики и шары различимы, найти вероятности следующих событий:

- •1.3.2 Геометрический метод вычисления вероятностей

- •1.3.3 Статистическое определение вероятности

- •1.3.4 Условная вероятность

- •Произвольны, причем рв.

- •Формула (6) считается определением, ниоткуда не выводится и является отражением здравого смысла. Поясним это на примере геометрического изображения событий (рис. 3).

- •Теорема умножения.ПустьА,в,тогда

- •1.4 Формула полной вероятности и формула Байеса (Bayes) Формула полной вероятности

- •Применяя теорему умножения получим

- •Применяя (9), получим

- •Формула Байеса

- •Вероятности ,, называютапостериорнымивероятностями гипотезВk, поскольку оценка происходит после того, как событиеАпроизошло.

- •1.5 Независимые испытания

- •1.6 Локальная теорема Муавра – Лапласа

- •Интегральная теорема Муавра-Лапласа

- •Функция - табулирована, ее значения приведены в табл. 4 приложения.

- •Сравнивая решение задачи п.1.5. А), б), можно предположить, что, так как – наивероятнейшее число, с большой вероятностью реализуется событие40k60, с центром в точкеk0:

- •1.8 Формула Пуассона

- •Часть 2. Случайные величины и функции распределения

- •Например, к дискретным случайным величинам относятся:

- •Свойства функции распределения.

- •Свойства плотности

- •Примеры основных распределений

- •2.1 Числовые характеристики случайных величин

- •2.1.1 Математическое ожидание, мода, медиана

- •Моменты

- •Свойства дисперсии

- •2.2 Вычисление числовых характеристик стандартных распределений

- •1. Биномиальное распределение.

- •Приложения нормального распределения

- •2.3 Функции от случайных величин

- •2.3.1 Функции от одного случайного аргумента

- •2.3.2 Многомерные случайные величины

- •2.3.3 Условные законы распределения

- •2.3.4 Моменты многомерных случайных величин

- •Свойства коэффициента корреляции

- •2.3.5 Случайные процессы

- •2.3.5.1 Марковские процессы

- •2.3.5.2 Непрерывные цепи Маркова

- •2.3.5.3 Потоки событий

- •2.3.6 Основы теории массового обслуживания

- •Часть 3. Предельные теоремы

- •Вместо (111), часто используют неравенство

- •3.1 Закон больших чисел

- •3.2 Центральные предельные теоремы

- •Часть 4. Элементы математической статистики

- •4.1 Оценка функций распределения

- •Свойства эмпирической функции распределения

- •4.2 Точечные оценки неизвестных параметров законов распределения

- •Итак, пусть имеем выборку (122). Для оценки математического ожидания

- •4.3 Доверительный интервал

- •Окончательно

- •4.4 Проверка статистической однородности

- •Заключение

- •Обозначения

- •Приложение

- •Значения некоторых числовых величин

- •Продолжение таблицы 5

- •Продолжение таблицы 7

- •Библиографический список

Следствия из аксиом

Следствие 1.

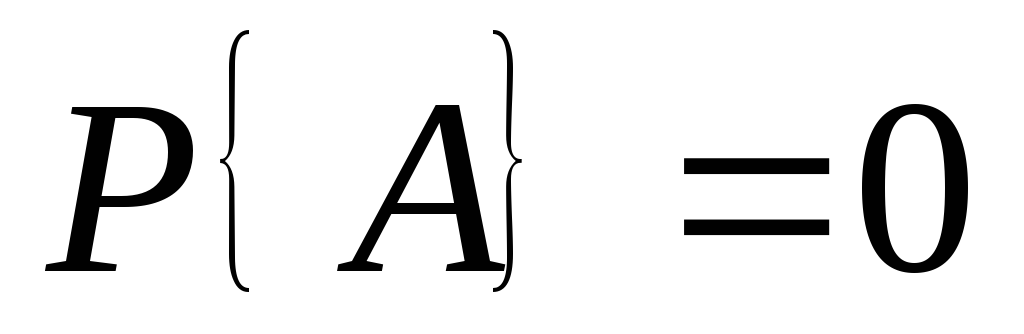

Р = 0.

В самом деле, имеем =и=, то естьинесовместны.

Следовательно, 1 = Р=Р=по аксиоме 3=Р+Р= 1 +Р. ОтсюдаР= 0.▼

Следствие 2.

Если А , то Р = 1 – Р .

Доказательство сразу следует из условия А = , А = .▼

Следствие 3.

Если А , то 0 Р А .

В

самом деле, так как

,

тоРРР,

тогда![]() .

Знак равенства возможен тогда, когдаА=илиА=,

или

.

Знак равенства возможен тогда, когдаА=илиА=,

или![]() иА.▼

иА.▼

Следствие 4 (Теорема сложения).

Для любых А, В имеет место

РАВ=РА+РВ-РАВ.

В самом деле, имеем

А В = А ( В \ ( А В )) и В = ( А В) ( В \ ( А В )).

События правой части несовместные, отсюда

Р А В = Р А + Р В \ ( А В ),

Р В = Р А В + Р В \ ( А В ).

Вычитая из первого равенства второе, получаем

РАВ-Р В=РА-Р АВ.▼

Следствие 5.

Для любых А, В ,

Р А В Р А + Р В .

Доказательство следует из условия Р А В и следствия 4. ▼

Очевидны обобщения на произвольное число событий.

Определение. События А, В из вероятностного пространства (,ℱ,Р) называются независимыми, если вероятность их совместного осуществления равна произведению вероятностей этих событий, то есть

Р А В = Р А Р В .

Из определения сразу следует, что

Для любого А события А и независимы.

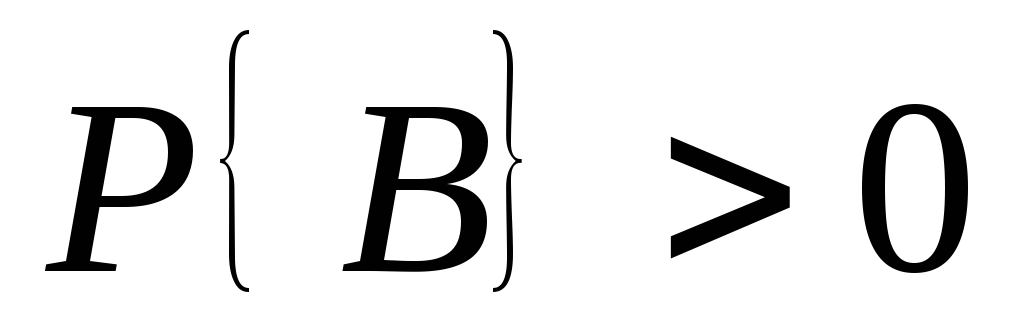

Если Р В = 0 и событие А произвольно, то В и А независимы.

Если события А и Вi независимы, i = 1, 2 и В1 В2, то А и ( В1\ В2 ) независимы.

Если события А и Вi независимы и Вi попарно несовместны, то есть i j Вi Вj = , то А и

также независимы.

также независимы.Событие А не зависит от самого себя тогда и только тогда, когда либо

,

либо

,

либо  .

.Если события А и В несовместны, то есть А В = и Р А 0,

,

то А

и В

зависимы.

,

то А

и В

зависимы.

В

самом деле, пусть события А

и В

независимы, тогда ![]() ,

но по условию

,

но по условию ![]() .

Получили противоречие, то есть А

и В

- зависимы.▼

.

Получили противоречие, то есть А

и В

- зависимы.▼

Замечание 1. Понятие независимости в теории вероятностей имеет более глубокий смысл, чем независимость обычная. Принято считать события независимыми, если они не связаны причинно. На практике, понятие зависимости и независимости случайных событий относительно. Если события слабо связаны, и эта связь несущественно влияет на конечный результат, то такие события считают независимыми, поскольку в этом случае построение математических моделей реальных ситуаций становится много проще. Наиболее глубоко в теории вероятностей изучены именно независимые события.

Замечание 2. Из аксиоматического построения вероятности события следует, что событие случайно, если оно не достоверно и не невозможно. Это определение через отрицание и из него следует, что имеет смысл говорить о вероятности как о некотором определенном, но неизвестном нам числе. Утверждение, что вероятность событияАсуществует, нуждается в обосновании, а если оно принято в качестве гипотезы, то в последующей проверке. Это следует учитывать при построении математических моделей реальных ситуаций.

Рассматривая вероятность события как число из промежутка [0,1], мы обычно предполагаем в какой его части это число будет находиться. И чем больше мы имеем информации о случайном событии, тем точнее предположение. Это позволяет нам определить вероятность как меру возможности (уверенности) появления случайного события.

Именно так Блез Паскаль в письме Пьеру Ферма в 1654 году написал: «Я считаю более простым и естественным принять степень уверенности в появлении достоверного события равной единице. Тем самым, возможность наступления случайных событий соизмеряется с тем, какую часть единицы они составляют».

Так впервые была формализована связь между случайным событием и числом, его измеряющим, – вероятностью.