- •В.А. Павский

- •Оглавление

- •Часть 1. Понятие случайного события и его вероятности……..9

- •Часть 2. Случайные величины и функции распределения…….52

- •Часть 3. Предельные теоремы…………………………………………….130

- •Часть 4. Элементы математической статистики………………..141

- •Введение

- •Часть 1. Понятие случайного события и его вероятности

- •Операции над событиями

- •Кроме того, если выполнено условие

- •Следствия из аксиом

- •Из определения сразу следует, что

- •Элементы комбинаторики

- •Пример 5. Сколько существует размещений с повторениями при выборкеkшаров изn?

- •1.3 Вычисление вероятностей событий

- •1.3.1 Классический метод вычисления вероятностей

- •Пример.Поnящикам случайно распределяютсяnшаров. Считая, что ящики и шары различимы, найти вероятности следующих событий:

- •1.3.2 Геометрический метод вычисления вероятностей

- •1.3.3 Статистическое определение вероятности

- •1.3.4 Условная вероятность

- •Произвольны, причем рв.

- •Формула (6) считается определением, ниоткуда не выводится и является отражением здравого смысла. Поясним это на примере геометрического изображения событий (рис. 3).

- •Теорема умножения.ПустьА,в,тогда

- •1.4 Формула полной вероятности и формула Байеса (Bayes) Формула полной вероятности

- •Применяя теорему умножения получим

- •Применяя (9), получим

- •Формула Байеса

- •Вероятности ,, называютапостериорнымивероятностями гипотезВk, поскольку оценка происходит после того, как событиеАпроизошло.

- •1.5 Независимые испытания

- •1.6 Локальная теорема Муавра – Лапласа

- •Интегральная теорема Муавра-Лапласа

- •Функция - табулирована, ее значения приведены в табл. 4 приложения.

- •Сравнивая решение задачи п.1.5. А), б), можно предположить, что, так как – наивероятнейшее число, с большой вероятностью реализуется событие40k60, с центром в точкеk0:

- •1.8 Формула Пуассона

- •Часть 2. Случайные величины и функции распределения

- •Например, к дискретным случайным величинам относятся:

- •Свойства функции распределения.

- •Свойства плотности

- •Примеры основных распределений

- •2.1 Числовые характеристики случайных величин

- •2.1.1 Математическое ожидание, мода, медиана

- •Моменты

- •Свойства дисперсии

- •2.2 Вычисление числовых характеристик стандартных распределений

- •1. Биномиальное распределение.

- •Приложения нормального распределения

- •2.3 Функции от случайных величин

- •2.3.1 Функции от одного случайного аргумента

- •2.3.2 Многомерные случайные величины

- •2.3.3 Условные законы распределения

- •2.3.4 Моменты многомерных случайных величин

- •Свойства коэффициента корреляции

- •2.3.5 Случайные процессы

- •2.3.5.1 Марковские процессы

- •2.3.5.2 Непрерывные цепи Маркова

- •2.3.5.3 Потоки событий

- •2.3.6 Основы теории массового обслуживания

- •Часть 3. Предельные теоремы

- •Вместо (111), часто используют неравенство

- •3.1 Закон больших чисел

- •3.2 Центральные предельные теоремы

- •Часть 4. Элементы математической статистики

- •4.1 Оценка функций распределения

- •Свойства эмпирической функции распределения

- •4.2 Точечные оценки неизвестных параметров законов распределения

- •Итак, пусть имеем выборку (122). Для оценки математического ожидания

- •4.3 Доверительный интервал

- •Окончательно

- •4.4 Проверка статистической однородности

- •Заключение

- •Обозначения

- •Приложение

- •Значения некоторых числовых величин

- •Продолжение таблицы 5

- •Продолжение таблицы 7

- •Библиографический список

Окончательно

2,9528<M<3,1108;

б) для D, при = 1- ,0.

Из

формулы (138) и приложения, таблица 7, для

р=![]() и r

= 21, имеем

и r

= 21, имеем

![]() .

.

Тогда для D , из формулы (138), получаем

![]() или

или

![]() .

.

Сравнивая результаты для приближенного и точного методов интервальных оценок, можно выдвинуть гипотезу о том, что если доверительный интервал для математического ожидания меняет центр симметрии, то для дисперсии он тем больше, чем ближе к нормальному распределению выборка.

4.4 Проверка статистической однородности

Теория вероятностей изучает такие события, результат которых устойчив, или, что тоже самое, статистически однороден. Как определить, достигли мы желаемого результата, после проведенной серии экспериментов, или нет? Следует ли провести еще одну серию, чтобы закрепить свои предположения? Ясно, что исчерпывающего ответа на эти вопросы получить нельзя.

Однако некоторые оценки сделать можно, если использовать центральную предельную теорему.

Пусть имеем случайную величину = (1, …, n), с нормированным нормальным распределением (М = 0, D = 1), где 1, ..., n – результат серии экспериментов.

Поставим задачу. Проведено две серии экспериментов: в первой серии из n1 экспериментов событие А появилось 1 раз, а во второй серии из n2 экспериментов событие А появилось 2 раз. Можно ли предполагать что вероятность события А одинакова в обоих случаях?

Пусть в первой серии Р{А}= р1, а во второй Р{А}= р2. Верна ли гипотеза Н0: р1 = р2?

Для

ответа на вопрос, необходимо чтобы

разность частот

![]() ,

была достаточно мала, тогда ее можно

объяснить случайными причинами. Если

ошибка

в самом деле мала, то естественно

предположить, что случайные величины

1

и 2

распределены нормально, то есть при р1

= р2,

будем иметь

,

была достаточно мала, тогда ее можно

объяснить случайными причинами. Если

ошибка

в самом деле мала, то естественно

предположить, что случайные величины

1

и 2

распределены нормально, то есть при р1

= р2,

будем иметь

![]() .

.

Если

считать, что серии опытов независимы,

то

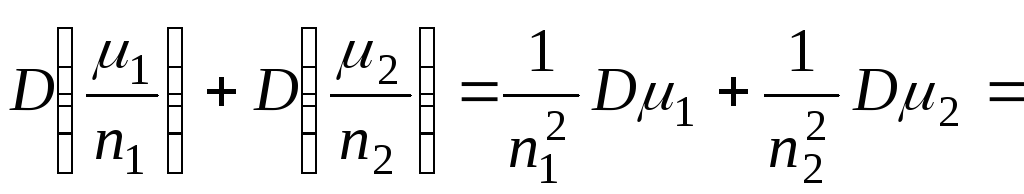

имеет распределение близкое к нормальному,

у которого

![]() и

и

![]()

Если

значение

![]() известно, то по табл. 3 приложения,

нормального распределения, можно

получить ответ на вопрос.

известно, то по табл. 3 приложения,

нормального распределения, можно

получить ответ на вопрос.

Серии

опытов, в силу предположения, будем

считать сериями испытаний Бернулли,

тогда если р1

= р2

= р,

то

.

.

Значение р неизвестно, но используя данные эксперимента, можно заменить р на

![]()

(так как это лучшее, что можно предложить в данной ситуации), тогда

![]() .

(139)

.

(139)

Случайная

величина

нормирована и имеет приблизительно

нормальное распределение, из которого

следует, что значения

![]() >2 3

маловероятны.

>2 3

маловероятны.

В самом деле, например, для = - 1,96, по табл. 3 приложения находим Ф(-1,96) = 0,0250, а для = 1,96, значение Ф ( >1,96) = 0,0250 (рис. 35).

Р ис.

35

ис.

35

Представим сказанное на языке теории вероятностей, то есть определим область принятия гипотезы Н0.

Заранее зададим малое (например, = 0,05), означающее, что событию с такой вероятностью произойти практически невозможно. Число называется уровнем значимости. Используются значения 0,1; 0,05; 0,02; 0,01; 0,001.

Пусть значение случайной величины , в данной серии испытаний, оказалось равным =. Если 0, то находим Р = Ф; Если >0, то имеем Р > = 1-Ф+ (табл. 3 приложения).

Объединяя, значения вероятностей, получаем Р > = 2Ф- (в нашем случае, Р >=20,025 = 0,05, рис. 35). При 2Ф- , гипотеза Н0 отвергается, иначе – данные выборки не противоречат гипотезе Н0 и ее нет оснований не принять, если отсутствует субъективный фактор.

Замечание. Так как, например, как в нашем случае, при Ф = 0,0250 следует, что = -1,96, то область принятия гипотезы Н0 есть -1,96 1,96.

Если значение вероятности равно или близко к , то принять гипотезу Н0 или отвергнуть, зависит от изучаемого объекта и субъективного фактора.

Задача. Пусть вероятность успеха р, заданной серии n испытаний Бернулли предполагается равной числу р0 . Если проверяется гипотеза Н0: р = р0, то случайная величина

![]() (140)

(140)

(где - число успехов в серии)

имеет, приблизительно, стандартное нормальное распределение.

Вывод формулы (140) вполне аналогичен предыдущим рассуждениям.

Пример. Проверяется симметричность монеты, гипотеза Н0: р0 = 0,5, по двум проведенным сериям из n испытаний Бернулли каждая, для уровня значимости = 0,05.

Герб

имеет частоту а) в первой серии

![]() ,

б) во второй серии

,

б) во второй серии

![]() .

Требуется проверить однородность

выборок и выполнение гипотезы Н0

для первой, второй и обеих серий.

.

Требуется проверить однородность

выборок и выполнение гипотезы Н0

для первой, второй и обеих серий.

Решение. Проверим выборки на однородность. Имеем, по формуле (139),

![]() .

.

Так как -0,447>-1,96 (см. замечание), то гипотеза Н0 принимается, то есть с вероятностью 0,95 можно считать, что монета симметрична.

Проверим монету на симметричность по первой выборке. По формуле (140) имеем

![]() .

.

Так как –1,26 >-1,96, то гипотезу Н0 принимаем. Для других вариантов результат, очевидно, будет лучше.