- •В.В.Бурляев численные методы в примерах на excel

- •1. Решение нелинейного уравнения с одним неизвестным.

- •1.1 Отделение корней.

- •1.2 Уточнение корней: метод итераций.

- •1.3 Уточнение корней: метод Ньютона.

- •1.4. Уточнение корней: метод бисекции ( деления отрезка пополам ).

- •1.5 Уточнение коней: подпрограмма excel “Подбор параметра”.

- •2. Системы линейных алгебраических уравнений.

- •2.1. Матричный метод.

- •2.2. Метод приближенных вычислений.

- •2.3. Метод Гаусса – Зайделя.

- •3. Решение систем нелинейных уравнений.

- •3.1. Выбор начальных приближений.

- •3.2 Метод Ньютона.

- •3.3. Метод итераций.

- •4. Численные методы одномерной оптимизации.

- •4.1. Метод дихотомии.

- •4.2. Метод золотого сечения.

- •4.3. Встроенная подпрограмма excel “Поиск решения”.

- •5. Многомерные задачи оптимизации.

- •5.1. Безусловная оптимизация: метод покоординатного спуска.

- •5.2. Безусловная оптимизация: метод наискорейшего спуска.

- •5.3. Безусловная оптимизация: подпрограмма excel “Поиск решения”.

- •5.4. Условная оптимизация: метод штрафных функций.

- •5.5. Условная оптимизация: подпрограмма excel “Поиск решения”.

- •5.6. Условная оптимизация: линейное программирование.

- •6. Метод наименьших квадратов.

- •7. Вычисление определенных интегралов.

- •8. Численное решение обыкновенного дифференциального уравнения

- •8.1. Метод Эйлера.

- •8.2. Метод Рунге-Кутта четвертого порядка.

- •8.3. Метод прогноза и коррекции: метод Адамса.

- •9. Решение систем обыкновенных дифференциальных уравнений.

- •9.1. Задача Коши.

- •9.2. Краевая задача: метод стрельбы.

- •9.3. Краевая задача: метод прогонки.

- •10. Численное решение уравнений с частными производными

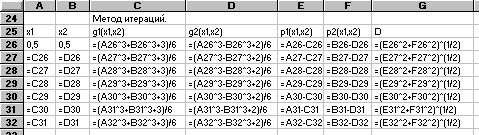

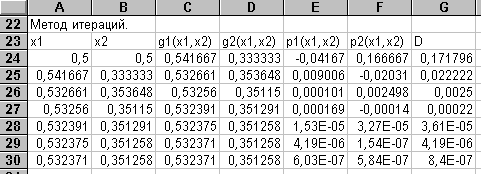

3.3. Метод итераций.

Пусть задана система нелинейных уравнений 2-го порядка

f1(x1,x2) = 0

f2(x1,x2) = 0

причем левые части уравнений известны в виде формул. Заданы также числовые значения начальных приближений х10 и х20, а также Е - точность вычислений значений корней.

Для применения итераций исходная система приводится к виду

х1 = g1(x1,x2)

x2 = g2(x1,x2),

где функции gi называются итерирующими. Алгоритм решения задается итерирующими формулами

х1i+1 = g1(x1i,x2i)

x2i+1 = g2(x1i,x2i),

где i -номер итерации, i = 0,1,2,... Для прекращения итераций вычисляются значения

p1i+1 = х1i+1 - x1i

p2i+1 = x2i+1 - x2i,

D=( p1i2+p2i2)(1/2),

и D сравнивается с Е. Итерации продолжаются до тех пор, пока не выполнится условие D<=E. Чтобы процесс вычислений сходился к этому условию, нужно выполнение достаточного условия сходимости:

dg1/dx1 + dg1/dx2

dg2/dx1 + dg2/dx2.

Возможно также суммирование по столбцам.

Пример 3.3.

Решим систему из примера 3.1 методом итераций. Начальные приближения также возьмем из того же примера. Пусть Е = 0,00001. Выпишем формулы для итерирующих функций

g1(x1,x2) = (x13 + x23 + 3)/6

g2(x1,x2) = (x13 - x23 + 2)/6.

При изменении независимых переменных в пределах 0<= x1<=1 и 0<= x2<=1 достаточное условие сходимости выполняется, т.к.

dg1/dx1 + dg1/dx2x12)/2 + (x22)/2

dg2/dx1 + dg2/dx2x12)/2 + -(x22)/2.

Проведем вычисления на том же рабочем листе, что и в примере 4.2.

Отведем столбец А, начиная с 26 строки под значения х1, столбец В под значения х2, столбец С - под g1, столбец D - под g2, следующие три столбца под р1,р2 и D.

4. Численные методы одномерной оптимизации.

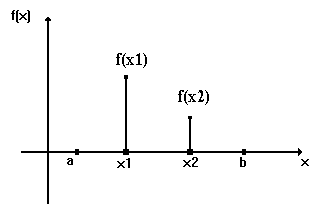

Одномерная задача оптимизации в общем случае формулируется следующим образом: найти значение независимой переменной Х, заданной на интервале[a,b], при котором некоторая целевая функция f(X) принимает минимальное значение. Если ставится задача нахождения максимума, например, функции g(X), то преобразованием f(X) = - g(X) она приводится к отысканию минимума f(X). Целевая функция f(X) должна быть задана в виде формулы. Если существует производная f’(X), то задача сводится к решению уравнения f’(X) = 0, например, методами, описанными в разделе 2.

Численные методы оптимизации используются тогда, когда целевая функция недифференцируема и, в общем случае, может быть не гладкой и даже непрерывной, т.е. может иметь разрывы первого рода по Дирихле.

Единственное условие, предъявляемое к целевой функции - она должна быть унимодальной на интервале [a,b], т.е. иметь на этом интервале только один минимум и не иметь ни максимумов, ни точек перегиба. Математически свойство унимодальности записывается так. Функция f(X) называется унимодальной на интервале [a,b], если на этом интервале существует такая точка Х*, что для значений Х

X1<X2<X*<X3<X4

выполняется условие

f(X1)>f(X2)>f(X*)<f(X3)<f(X4).

В этом определении очень важно, что все неравенства - строгие.

Процесс нахождения минимума унимодальной функции численными методами оптимизации, называемыми иногда методами поиска, состоит в последовательном сужении интервала [a,b] - начального интервала неопределенности - так, чтобы его длина достигала значения Е - заданной погрешности решения.