- •1.1 Помехи в электронных системах. Характеристики помех.

- •1.2 Свойства эргодичности ссп.

- •1.3 Код с парным количеством единиц.

- •2.1 Помехи. Характеристики помех.

- •1) Источники помех, которые находятся вне системы;

- •2) Источники помех, которые находятся в системе.

- •2.2 Свойства стационарности ссп.

- •2.3 Ошибки и искажения в системах передачи

- •3.1 Структура системы с линейно независимыми сигналами.

- •3.2 Квантование по уровню

- •3.3 Код Хемминга.

- •4.1 Построение неразделимого циклического кода

- •4.2 Энтропия статистически зависимых сообщений

- •4.3 Амплитудная модуляция

- •5.1 Понятие информации. Измерение информации.

- •5.2 Спектр ссп

- •5.3 Условие линейной независимости

- •6.1 Количество информации, ее связь со сложностью структуры источника

- •6.2 Интервал корреляции, суть понятия

- •6.3 Обнаружение двукратных ошибок кодом Хэмминга

- •7.1 Статистический подход к измерению информации

- •7.2 Эффективная ширина спектра стационарного случайного процесса

- •7.3 Построение неразделимого циклического кода

- •8.1 Энтропия дискретных сообщений. Свойства энтропии

- •8.2 Определение количества информации при наличии помех

- •8.3 Код, обнаруживающий пакетную ошибку

- •9.1 Энтропия непрерывных сообщений

- •9.2 Скорость передачи информации

- •9.3 Виды ошибок при передаче и воспроизведении информации

- •10.1 Распределения с максимальной энтропией

- •10.2 Корреляционный критерий дискретизации

- •10.3 Системы с частотным уплотнением

- •11.1 Непрерывные сообщения. Случайный или детерминированный процесс?

- •11.2 Какие характеристики сигналов определяют выбор интервала дискретизации?

- •11.3 Системы с временным уплотнением

- •12.1 Типичные сообщения. Свойства типичных сообщений

- •12.2 Корреляционная функция ссп. Свойства корреляционной функции

- •12.3 От чего зависят корректирующие свойства циклического кода?

- •13.1 Основные характеристики случайных процессов

- •13.2 Пропускная способность канала связи

- •13.3. Уплотнение информации в системах передачи и регистрации информации

- •14.1 Понятие стационарности случайного процесса.

- •14.2 Теорема Котельникова-Шеннона.

- •15.1 Мера Хартли. Свойство аддитивности.

- •15.2 Дискретизація повідомлень.

- •15.3 Условия ортогональности и взаимности.

- •16.1 Шумы и помехи в системах связи. Характеристики шумов и помех.

- •16.2 Функция отсчетов. Её свойства.

- •16.3 Дельта-модуляция.

- •17.1 Энтропия объединения двух случайно зависимых источников.

- •17.2 Восстановительные функции. Требования к ним.

- •17.3 Фазова маніпуляція. Застосування у цифрових системах передачі.

- •18.1 Факторы, определяющие пропускную способность канала связи.

- •18.2 Функция отсчетов. Её свойства.

- •18.3 Условия исправления ошибок циклическим кодом.

- •19.1 Пропускна спроможність неперервного каналу зв”язку

- •19.2 Поняття ефективної ширини спектра свп.

- •19.3 Кратність помилки, кодова відстань, пакетна помилка. Поняття.

- •20.1 Залежність пропускної спроможності неперервного каналу зв’язку від смуги частот.

- •20.2 Мета і завдання кодування

- •20.3 Семантичний підхід до визначення кількості інформації

- •21.1 Критерій найбільшого припустимого відхилення. Загальний підхід.

- •21.2 Пропускна спроможність дискретного каналу без завад.

- •21.3 Обмінні співвідношення у каналах передачі інформації

- •22.1 Оптимальное кодирование. Критерий оптимальности кода

- •22.2 Семантичний підхід до визначення кількості інформації

- •22.3 Построение циклического кода

- •23. 1 Понятие стационарности (ссп).

- •23.2 Условная Энтропия .Понятие.

- •23.3 Оптимальное кодирование. Критерий оптимальности кода

- •24.1 Код Шеннона-Фано.

- •24.2 Свойства корреляционной функции стационарного случайного процесса

- •24.3 Правила построения кода Хеминга

- •25.1 Код Хаффмена

- •25.2 Властивості ентропії

- •25.3 Перетворення сигналів при ущільненні повідомлення.

- •26.1 Кодування блоків повідомлень. Переваги та недоліки

- •26.2 Оцінка похибки відновлення дискретизованих повідомлень

- •26.3 Відносна фазова маніпуляція

5.2 Спектр ссп

Стационарный в узком смысле, если его функция распределения плотности вероятности произвольного порядка n не меняется при любом сдвиге всей группы точек t1 , t2 … tn вдоль оси времени. То есть pn(x1,t1; x2,t2; ...; xn,tn) = pn(x1, t1 + τ; x2, t2 + τ; ...; xn,tn + τ). Вероятностные характеристики СВП в узком смысле не меняются в случае изменения расположения отсчетной точки на временной оси.

Стационарным в широком смысле называют процесс, математическое ожидание которого не зависит от времени, а корреляционная функция зависит только от разницы t2 – t1 = τ и не зависит от самых интервалов t1 и t2.

Энергетический спектр стационарного процесса может быть определен двумя путями:

- непосредственным наблюдением одной

реализации

![]() и нахождением предела;

и нахождением предела;

- нахождением преобразования Фурье от корреляционной функции.

Использование преобразования Фурье к случайным процессам невозможно по таким причинам:

Реализации случайного процесса

не удовлетворяют условию абсолютной

интегрируемости

не удовлетворяют условию абсолютной

интегрируемости

.

.Для случайного процесса

частотный спектр также является

случайной функцией.

частотный спектр также является

случайной функцией.

Можно обобщить гармонический

анализ, усредняя спектральные разложения,

полученные для отдельных реализаций:

.

Средняя мощность сигнала:

.

Средняя мощность сигнала:

.

Также средняя мощность выражается через

частотный спектр:

.

Также средняя мощность выражается через

частотный спектр:

.

Функция под интегралом называется

спектральной плотностью мощности

.

Функция под интегралом называется

спектральной плотностью мощности

![]() .

Найдем спектральную плотность

совокупности реализаций (путем усреднения

по ансамблю).

.

Найдем спектральную плотность

совокупности реализаций (путем усреднения

по ансамблю).

Учитывая, что

![]() ,

имеем преобразования Винера-Хинчина:

,

имеем преобразования Винера-Хинчина:

,

,

.

Спектральная плотность является прямым

преобразованием Фурье от корреляционной

функции.

.

Спектральная плотность является прямым

преобразованием Фурье от корреляционной

функции.

5.3 Условие линейной независимости

В случае, когда по линии передается

сигнал, содержащий информацию от

нескольких источников, нужно обеспечить

передачу такого сигнала с помощью

специального преобразования. Теория

линейного разделения сигналов позволяет

представлять сигналы в виде набора

сигнальных функций

![]() ,

,

![]() …

…![]() .

Необходимым и достаточным условием

разделимости сигналов является условие

линейной независимости: равенство

.

Необходимым и достаточным условием

разделимости сигналов является условие

линейной независимости: равенство

возможно только в случае, когда все

коэффициенты

возможно только в случае, когда все

коэффициенты

![]() равны нулю. Ни одна

равны нулю. Ни одна

![]() не может быть выражена через линейную

композицию других линейных составляющих.

не может быть выражена через линейную

композицию других линейных составляющих.

Таким образом, в качестве сигнальных функций, которые используются в многоканальных системах передачи информации, используют линейно независимые функции.

6.1 Количество информации, ее связь со сложностью структуры источника

Информация – это данные, которые снимают неопределенность о каком-нибудь объекте или явлении. Информация обычно представляется в форме сообщений.

Количество информации зависит от того,

какой был использован подход. При

структурном подходе информация

вычисляется с помощью меры Хартли:![]() ,

где n – количество элементов сообщения,

m – алфавит.

,

где n – количество элементов сообщения,

m – алфавит.

При статистическом подходе количество информации зависит от вероятности появления элементов сообщения. Если источник выдает дискретные сообщения, то количество информации: , где - вероятность появления i-го символа.

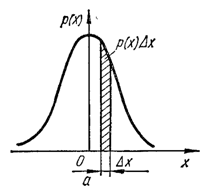

Непрерывное сообщение – это то, которое на конечном временном интервале представляет собой некоторую непрерывную функцию времени.

,

где

,

где

![]() - одномерная плотность вероятности

ансамбля сообщений,

- одномерная плотность вероятности

ансамбля сообщений,

![]() - интервал квантования (погрешность

измерения).

- интервал квантования (погрешность

измерения).

Функция плотности вероятности характеризует вероятность попадания непрерывной случайной величины х в некоторый элементарный интервал значений Δx.