- •1.1 Помехи в электронных системах. Характеристики помех.

- •1.2 Свойства эргодичности ссп.

- •1.3 Код с парным количеством единиц.

- •2.1 Помехи. Характеристики помех.

- •1) Источники помех, которые находятся вне системы;

- •2) Источники помех, которые находятся в системе.

- •2.2 Свойства стационарности ссп.

- •2.3 Ошибки и искажения в системах передачи

- •3.1 Структура системы с линейно независимыми сигналами.

- •3.2 Квантование по уровню

- •3.3 Код Хемминга.

- •4.1 Построение неразделимого циклического кода

- •4.2 Энтропия статистически зависимых сообщений

- •4.3 Амплитудная модуляция

- •5.1 Понятие информации. Измерение информации.

- •5.2 Спектр ссп

- •5.3 Условие линейной независимости

- •6.1 Количество информации, ее связь со сложностью структуры источника

- •6.2 Интервал корреляции, суть понятия

- •6.3 Обнаружение двукратных ошибок кодом Хэмминга

- •7.1 Статистический подход к измерению информации

- •7.2 Эффективная ширина спектра стационарного случайного процесса

- •7.3 Построение неразделимого циклического кода

- •8.1 Энтропия дискретных сообщений. Свойства энтропии

- •8.2 Определение количества информации при наличии помех

- •8.3 Код, обнаруживающий пакетную ошибку

- •9.1 Энтропия непрерывных сообщений

- •9.2 Скорость передачи информации

- •9.3 Виды ошибок при передаче и воспроизведении информации

- •10.1 Распределения с максимальной энтропией

- •10.2 Корреляционный критерий дискретизации

- •10.3 Системы с частотным уплотнением

- •11.1 Непрерывные сообщения. Случайный или детерминированный процесс?

- •11.2 Какие характеристики сигналов определяют выбор интервала дискретизации?

- •11.3 Системы с временным уплотнением

- •12.1 Типичные сообщения. Свойства типичных сообщений

- •12.2 Корреляционная функция ссп. Свойства корреляционной функции

- •12.3 От чего зависят корректирующие свойства циклического кода?

- •13.1 Основные характеристики случайных процессов

- •13.2 Пропускная способность канала связи

- •13.3. Уплотнение информации в системах передачи и регистрации информации

- •14.1 Понятие стационарности случайного процесса.

- •14.2 Теорема Котельникова-Шеннона.

- •15.1 Мера Хартли. Свойство аддитивности.

- •15.2 Дискретизація повідомлень.

- •15.3 Условия ортогональности и взаимности.

- •16.1 Шумы и помехи в системах связи. Характеристики шумов и помех.

- •16.2 Функция отсчетов. Её свойства.

- •16.3 Дельта-модуляция.

- •17.1 Энтропия объединения двух случайно зависимых источников.

- •17.2 Восстановительные функции. Требования к ним.

- •17.3 Фазова маніпуляція. Застосування у цифрових системах передачі.

- •18.1 Факторы, определяющие пропускную способность канала связи.

- •18.2 Функция отсчетов. Её свойства.

- •18.3 Условия исправления ошибок циклическим кодом.

- •19.1 Пропускна спроможність неперервного каналу зв”язку

- •19.2 Поняття ефективної ширини спектра свп.

- •19.3 Кратність помилки, кодова відстань, пакетна помилка. Поняття.

- •20.1 Залежність пропускної спроможності неперервного каналу зв’язку від смуги частот.

- •20.2 Мета і завдання кодування

- •20.3 Семантичний підхід до визначення кількості інформації

- •21.1 Критерій найбільшого припустимого відхилення. Загальний підхід.

- •21.2 Пропускна спроможність дискретного каналу без завад.

- •21.3 Обмінні співвідношення у каналах передачі інформації

- •22.1 Оптимальное кодирование. Критерий оптимальности кода

- •22.2 Семантичний підхід до визначення кількості інформації

- •22.3 Построение циклического кода

- •23. 1 Понятие стационарности (ссп).

- •23.2 Условная Энтропия .Понятие.

- •23.3 Оптимальное кодирование. Критерий оптимальности кода

- •24.1 Код Шеннона-Фано.

- •24.2 Свойства корреляционной функции стационарного случайного процесса

- •24.3 Правила построения кода Хеминга

- •25.1 Код Хаффмена

- •25.2 Властивості ентропії

- •25.3 Перетворення сигналів при ущільненні повідомлення.

- •26.1 Кодування блоків повідомлень. Переваги та недоліки

- •26.2 Оцінка похибки відновлення дискретизованих повідомлень

- •26.3 Відносна фазова маніпуляція

12.1 Типичные сообщения. Свойства типичных сообщений

Сообщение – это форма представления информации.

При большой длине n источником будет

формироваться типичные сообщения, в

котором относительная частота появления

отдельных элементов хі,

т.е. отношение числа данных элементов

nі к

общему числу элементов в сообщении

стремится к вероятности появления этих

элементов, т.е.

стремится к вероятности появления этих

элементов, т.е.

Таким образом, в типичное сообщение

достаточно большой длины n

будет входить

элементов вида хі,

а вероятности появления типичных

сообщений р будут одинаковы и могут

быть найдены:

Поскольку суммарная вероятность всех

типичных сообщений стремится к единице

при увеличении длины сообщений, число

типичных сообщений L можно определить

по формуле:

Количество информации в одном сообщении:

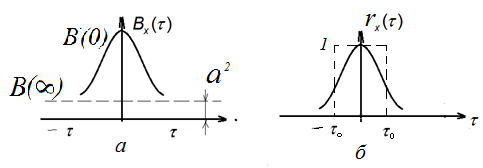

12.2 Корреляционная функция ссп. Свойства корреляционной функции

Корреляционная функция отображает связь между значением случайного процесса в различные моменты времени. Она определяется как среднее значение произведения значений случайной величины x(t) в моменты времени t1 и t2

Свойства КФ

,

тогда

,

тогда

и

и

становятся независимыми величинами.

становятся независимыми величинами.

![]()

При

![]() коррел. ф-я равна мощности

постоянной составляющей реализации

случайного стационарного процесса.

коррел. ф-я равна мощности

постоянной составляющей реализации

случайного стационарного процесса.

,

КФ принимает максимальное значение

,

КФ принимает максимальное значение

При корреляционная функция равна полной средней мощности случайного процесса.

Дисперсия ССП – это разность между средней мощностью процесса и мощностью постоянной составляющей.

Корреляционная функция является четной функцией

.

.

Т акже

используют нормированую

КФ:

акже

используют нормированую

КФ:

а) Пример графика КФ

б) График нормированной КФ

Интервал корреляции

![]() оценивает

статистическую связь. Показывает то,

что при

оценивает

статистическую связь. Показывает то,

что при

![]() значения

значения

![]() можно считать статистически независимыми.

можно считать статистически независимыми.

Интервал корреляции можно оценить :![]() ,

что равняется половине основы

прямоугольника единичной высоты, площадь

которого равна площади под кривой

нормированной КФ.

,

что равняется половине основы

прямоугольника единичной высоты, площадь

которого равна площади под кривой

нормированной КФ.

12.3 От чего зависят корректирующие свойства циклического кода?

Циклический код способен не только обнаруживать, но и справлять однократные ошибки, если длина кодовой комбинации не больше длинны цикла.

Корректирующие свойства циклического кода зависят от выбора образующего полинома данного кода.

При двоичном кодировании для исправления ошибки нужно знать всего лишь место искаженного символа. Тогда коррекция производится путем инвертирования данного символа.

Некоторые свойства обнаружения ошибок:

Циклический код с образующим полиномом G(x)=x+1 будет обнаруживать все однократные ошибки и ошибки непарной кратности.

Циклический код с образующим полиномом G(x)=

будет обнаруживать все однократные и

двукратные ошибки, если длинна кодовой

комбинации не больше длинны цикла.

будет обнаруживать все однократные и

двукратные ошибки, если длинна кодовой

комбинации не больше длинны цикла.Циклический код с образующим полиномом вида

будет обнаруживать все однократные,

двукратные и трехкратные ошибки.

будет обнаруживать все однократные,

двукратные и трехкратные ошибки.Циклический код с обнаруживающим полиномом G(x)=

будет обнаруживать все групповые ошибки

длинны k и меньше.

будет обнаруживать все групповые ошибки

длинны k и меньше.

Пример:

Принята кодовая комбинация 1101001, которая соответствует полиному

Р(Х)= Х6 +Х5 +Х3+1 с образующим полиномом N(x)=Х3 +Х2+1. Поделим полученную комбинацию на образующий полином:

П ри делении вышел остаток R(X) – была ошибка при передаче. Добавим остаток к исходному полиному: Р(Х)+ R(X )= Х6 +Х5 +Х3

Поделим полученный полином на образующий:

п оделилось

без остатка: исправили ошибку. 1101001

1101000

оделилось

без остатка: исправили ошибку. 1101001

1101000

Сравним полученную и принятые комбинации:

Ошибка была в последнем разряде.