- •1.1 Помехи в электронных системах. Характеристики помех.

- •1.2 Свойства эргодичности ссп.

- •1.3 Код с парным количеством единиц.

- •2.1 Помехи. Характеристики помех.

- •1) Источники помех, которые находятся вне системы;

- •2) Источники помех, которые находятся в системе.

- •2.2 Свойства стационарности ссп.

- •2.3 Ошибки и искажения в системах передачи

- •3.1 Структура системы с линейно независимыми сигналами.

- •3.2 Квантование по уровню

- •3.3 Код Хемминга.

- •4.1 Построение неразделимого циклического кода

- •4.2 Энтропия статистически зависимых сообщений

- •4.3 Амплитудная модуляция

- •5.1 Понятие информации. Измерение информации.

- •5.2 Спектр ссп

- •5.3 Условие линейной независимости

- •6.1 Количество информации, ее связь со сложностью структуры источника

- •6.2 Интервал корреляции, суть понятия

- •6.3 Обнаружение двукратных ошибок кодом Хэмминга

- •7.1 Статистический подход к измерению информации

- •7.2 Эффективная ширина спектра стационарного случайного процесса

- •7.3 Построение неразделимого циклического кода

- •8.1 Энтропия дискретных сообщений. Свойства энтропии

- •8.2 Определение количества информации при наличии помех

- •8.3 Код, обнаруживающий пакетную ошибку

- •9.1 Энтропия непрерывных сообщений

- •9.2 Скорость передачи информации

- •9.3 Виды ошибок при передаче и воспроизведении информации

- •10.1 Распределения с максимальной энтропией

- •10.2 Корреляционный критерий дискретизации

- •10.3 Системы с частотным уплотнением

- •11.1 Непрерывные сообщения. Случайный или детерминированный процесс?

- •11.2 Какие характеристики сигналов определяют выбор интервала дискретизации?

- •11.3 Системы с временным уплотнением

- •12.1 Типичные сообщения. Свойства типичных сообщений

- •12.2 Корреляционная функция ссп. Свойства корреляционной функции

- •12.3 От чего зависят корректирующие свойства циклического кода?

- •13.1 Основные характеристики случайных процессов

- •13.2 Пропускная способность канала связи

- •13.3. Уплотнение информации в системах передачи и регистрации информации

- •14.1 Понятие стационарности случайного процесса.

- •14.2 Теорема Котельникова-Шеннона.

- •15.1 Мера Хартли. Свойство аддитивности.

- •15.2 Дискретизація повідомлень.

- •15.3 Условия ортогональности и взаимности.

- •16.1 Шумы и помехи в системах связи. Характеристики шумов и помех.

- •16.2 Функция отсчетов. Её свойства.

- •16.3 Дельта-модуляция.

- •17.1 Энтропия объединения двух случайно зависимых источников.

- •17.2 Восстановительные функции. Требования к ним.

- •17.3 Фазова маніпуляція. Застосування у цифрових системах передачі.

- •18.1 Факторы, определяющие пропускную способность канала связи.

- •18.2 Функция отсчетов. Её свойства.

- •18.3 Условия исправления ошибок циклическим кодом.

- •19.1 Пропускна спроможність неперервного каналу зв”язку

- •19.2 Поняття ефективної ширини спектра свп.

- •19.3 Кратність помилки, кодова відстань, пакетна помилка. Поняття.

- •20.1 Залежність пропускної спроможності неперервного каналу зв’язку від смуги частот.

- •20.2 Мета і завдання кодування

- •20.3 Семантичний підхід до визначення кількості інформації

- •21.1 Критерій найбільшого припустимого відхилення. Загальний підхід.

- •21.2 Пропускна спроможність дискретного каналу без завад.

- •21.3 Обмінні співвідношення у каналах передачі інформації

- •22.1 Оптимальное кодирование. Критерий оптимальности кода

- •22.2 Семантичний підхід до визначення кількості інформації

- •22.3 Построение циклического кода

- •23. 1 Понятие стационарности (ссп).

- •23.2 Условная Энтропия .Понятие.

- •23.3 Оптимальное кодирование. Критерий оптимальности кода

- •24.1 Код Шеннона-Фано.

- •24.2 Свойства корреляционной функции стационарного случайного процесса

- •24.3 Правила построения кода Хеминга

- •25.1 Код Хаффмена

- •25.2 Властивості ентропії

- •25.3 Перетворення сигналів при ущільненні повідомлення.

- •26.1 Кодування блоків повідомлень. Переваги та недоліки

- •26.2 Оцінка похибки відновлення дискретизованих повідомлень

- •26.3 Відносна фазова маніпуляція

4.2 Энтропия статистически зависимых сообщений

Энтропия -

это количество информации, приходящейся

на один

символ сообщения

(мера неопределенности).

Жесткая статистическая связь

Статистическая связь отсутствует

Взаимно статистическая

связь между

сообщениями Х и Y характеризуется

условной вероятностью

![]() ,

определяющими вероятность появления

элементов

,

определяющими вероятность появления

элементов

![]() при

условии, что стало

известно элемент сообщения

при

условии, что стало

известно элемент сообщения

![]() .

.

Информативность сообщения

Y после

того, как стал известен элемент

,

характеризуется частной условной энтропией,

которая определяется выражением

![]() .

.

Проведем усреднения по всем возможным

элементам и найдем полную условную

энтропию сообщения Y относительно

сообщения Х:

![]() .

.

Используя известные соотношения для

вероятности общего появления двух

зависимых событий

![]() ,

получим:

,

получим:

![]() .

.

Смысл условной энтропии H (Y / X) состоит в том, что она является мерой количества информации в сообщении Y, когда известно, что передаются сообщения X.

Используя соотношение теории вероятности, можно показать, что условная энтропия сообщения Y относительно сообщения Х при жесткой статистической зависимости (это когда один из условных вероятностей в строке таблицы условных вероятностей равна единице, а все остальные = 0) равна 0, т.е. в сообщениях Y нет никакой новой информации.

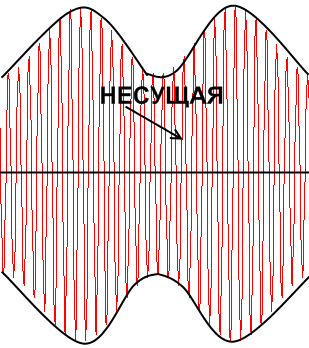

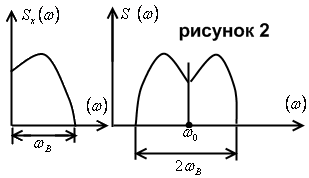

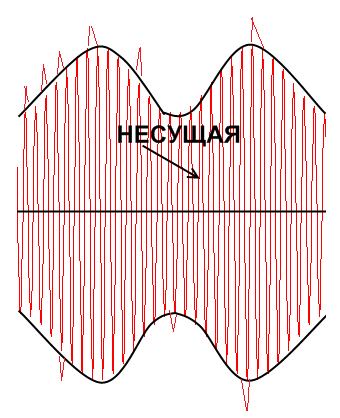

4.3 Амплитудная модуляция

Модуляция - один из видов физического кодирования, при котором сообщения подается (кодируется) изменением (модуляцией) параметров определенного несущего колебания (носителя) по закону первичного сигнала. Изменяемые параметры носителя называют информативными.

Амплитудная модуляция – это изменение амплитуды колебаний, которая осуществляется на частоте, которая намного меньше, чем частота несущего колебания.

П ри

АМ модулированый сигнал s(t) описывается

выражением:

ри

АМ модулированый сигнал s(t) описывается

выражением:

![]() ,

де m – коэффициент модуляции; X(t) –

нормированая функция сообщения

,

де m – коэффициент модуляции; X(t) –

нормированая функция сообщения

![]() .

.

Спектр АМ-сигнала

![]() определяется:

определяется:

![]() ,

де

,

де

![]() –

–

![]() -функция;

-функция;

![]() – спектр сообщения, которое передается.

– спектр сообщения, которое передается.

При АМ происходит перенос сообщения

на частоту

![]() .

Ширина спектра АМ-сигнала в два раза

шире, чем спектр информационного

сообщения.

.

Ширина спектра АМ-сигнала в два раза

шире, чем спектр информационного

сообщения.

А мплитуда

АМ-сигнала изменяется от

мплитуда

АМ-сигнала изменяется от

![]() до

до

![]() ,

а мощность от

,

а мощность от

![]() до

до

![]() ,

где

,

где

![]() - мощность колебаний несущей частоты.

Средняя мощность АМ-сигнала

- мощность колебаний несущей частоты.

Средняя мощность АМ-сигнала

![]() .

.

Кроме рассмотренной АМ еще используется передача методом АМ без несущей частоты - балансная модуляция и однополосная модуляция. Использование балансной и однополосной модуляции позволяет улучшить энергетические характеристики передатчика за счет сокращения бесполезного расхода энергии на составляющие несущей частоты.

О сновным

недостатком амплитудной модуляции

является низкая помехоустойчивость.

Аддитивные помехи действуют в основном

на амплитуду сигнала, поэтому при

детектировании получим значительно

искаженный сигнал по амплитуде.

сновным

недостатком амплитудной модуляции

является низкая помехоустойчивость.

Аддитивные помехи действуют в основном

на амплитуду сигнала, поэтому при

детектировании получим значительно

искаженный сигнал по амплитуде.

5.1 Понятие информации. Измерение информации.

Информация – это сведенья, которые можно хранить, передавать и преобразовывать. Это снятие неопределенности о каком-нибудь объекте.

Сообщение – это форма представления информации, удобная для передачи по линии связи.

Существует три основных направления при измерении информации:

Структурное: учитывает дискретное строение информации. Подсчет информации осуществляется простым подсчетом информационных элементов комбинаторным методом:

,

где L – количество возможных сообщений,

n – количество элементов сообщения, m

– алфавит. Если имеем k источников

сообщений, то количество возможных

сообщений от всех источников

,

где L – количество возможных сообщений,

n – количество элементов сообщения, m

– алфавит. Если имеем k источников

сообщений, то количество возможных

сообщений от всех источников

.

Чтобы сохранялось свойство аддитивности,

используют логарифмическую меру Хартли

.

Чтобы сохранялось свойство аддитивности,

используют логарифмическую меру Хартли

.

Если имеем несколько источников, то

количество информации от всех источников

.

Если имеем несколько источников, то

количество информации от всех источников

.

.Статистическое: учитывает вероятность появления сообщений. Все значения измеряемой величины рассматриваются, как исходы опыта. Сумма вероятностей всех исходов

.

Формула Шеннона используется для

измерения информации при этом подходе:

.

Формула Шеннона используется для

измерения информации при этом подходе:

,

где

,

где

- вероятность появления i-го символа.

- вероятность появления i-го символа.Семантическое: учитывает целесообразность, полезность и смысловую наполненность информации.