- •1.1 Помехи в электронных системах. Характеристики помех.

- •1.2 Свойства эргодичности ссп.

- •1.3 Код с парным количеством единиц.

- •2.1 Помехи. Характеристики помех.

- •1) Источники помех, которые находятся вне системы;

- •2) Источники помех, которые находятся в системе.

- •2.2 Свойства стационарности ссп.

- •2.3 Ошибки и искажения в системах передачи

- •3.1 Структура системы с линейно независимыми сигналами.

- •3.2 Квантование по уровню

- •3.3 Код Хемминга.

- •4.1 Построение неразделимого циклического кода

- •4.2 Энтропия статистически зависимых сообщений

- •4.3 Амплитудная модуляция

- •5.1 Понятие информации. Измерение информации.

- •5.2 Спектр ссп

- •5.3 Условие линейной независимости

- •6.1 Количество информации, ее связь со сложностью структуры источника

- •6.2 Интервал корреляции, суть понятия

- •6.3 Обнаружение двукратных ошибок кодом Хэмминга

- •7.1 Статистический подход к измерению информации

- •7.2 Эффективная ширина спектра стационарного случайного процесса

- •7.3 Построение неразделимого циклического кода

- •8.1 Энтропия дискретных сообщений. Свойства энтропии

- •8.2 Определение количества информации при наличии помех

- •8.3 Код, обнаруживающий пакетную ошибку

- •9.1 Энтропия непрерывных сообщений

- •9.2 Скорость передачи информации

- •9.3 Виды ошибок при передаче и воспроизведении информации

- •10.1 Распределения с максимальной энтропией

- •10.2 Корреляционный критерий дискретизации

- •10.3 Системы с частотным уплотнением

- •11.1 Непрерывные сообщения. Случайный или детерминированный процесс?

- •11.2 Какие характеристики сигналов определяют выбор интервала дискретизации?

- •11.3 Системы с временным уплотнением

- •12.1 Типичные сообщения. Свойства типичных сообщений

- •12.2 Корреляционная функция ссп. Свойства корреляционной функции

- •12.3 От чего зависят корректирующие свойства циклического кода?

- •13.1 Основные характеристики случайных процессов

- •13.2 Пропускная способность канала связи

- •13.3. Уплотнение информации в системах передачи и регистрации информации

- •14.1 Понятие стационарности случайного процесса.

- •14.2 Теорема Котельникова-Шеннона.

- •15.1 Мера Хартли. Свойство аддитивности.

- •15.2 Дискретизація повідомлень.

- •15.3 Условия ортогональности и взаимности.

- •16.1 Шумы и помехи в системах связи. Характеристики шумов и помех.

- •16.2 Функция отсчетов. Её свойства.

- •16.3 Дельта-модуляция.

- •17.1 Энтропия объединения двух случайно зависимых источников.

- •17.2 Восстановительные функции. Требования к ним.

- •17.3 Фазова маніпуляція. Застосування у цифрових системах передачі.

- •18.1 Факторы, определяющие пропускную способность канала связи.

- •18.2 Функция отсчетов. Её свойства.

- •18.3 Условия исправления ошибок циклическим кодом.

- •19.1 Пропускна спроможність неперервного каналу зв”язку

- •19.2 Поняття ефективної ширини спектра свп.

- •19.3 Кратність помилки, кодова відстань, пакетна помилка. Поняття.

- •20.1 Залежність пропускної спроможності неперервного каналу зв’язку від смуги частот.

- •20.2 Мета і завдання кодування

- •20.3 Семантичний підхід до визначення кількості інформації

- •21.1 Критерій найбільшого припустимого відхилення. Загальний підхід.

- •21.2 Пропускна спроможність дискретного каналу без завад.

- •21.3 Обмінні співвідношення у каналах передачі інформації

- •22.1 Оптимальное кодирование. Критерий оптимальности кода

- •22.2 Семантичний підхід до визначення кількості інформації

- •22.3 Построение циклического кода

- •23. 1 Понятие стационарности (ссп).

- •23.2 Условная Энтропия .Понятие.

- •23.3 Оптимальное кодирование. Критерий оптимальности кода

- •24.1 Код Шеннона-Фано.

- •24.2 Свойства корреляционной функции стационарного случайного процесса

- •24.3 Правила построения кода Хеминга

- •25.1 Код Хаффмена

- •25.2 Властивості ентропії

- •25.3 Перетворення сигналів при ущільненні повідомлення.

- •26.1 Кодування блоків повідомлень. Переваги та недоліки

- •26.2 Оцінка похибки відновлення дискретизованих повідомлень

- •26.3 Відносна фазова маніпуляція

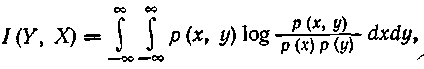

8.2 Определение количества информации при наличии помех

При наличии помех количество информации, которое содержится в принятом сообщении Y относительно переданного Х, определяется как разница между энтропией источника и помехами: I(Y,X)=H(X)-H(X/Y).

При условии что уровень помех очень большой, считается, что сообщение Х и У являются статистически независимыми, и тогда: І(Y,X) = H(X) — H(X/Y)=0

При условии что уровень помех незначительный, считается, что сообщение Х и У являются жестко статистически зависимыми, и тогда: І(Y,X) = H(X)

Величина І(Y,X) называется полной взаимной информацией, ее можно также вычислить с помощью дополнительной энтропии – энтропии помех Н(Y,X)= H(N):

І(Y,X) = H(X) + H(Y) — Н(Y,X)

Для дискретных сообщений:

Для оценки непрерывных сообщений:

При статистически независимых Х и N: I(Y,X) = H(Y)-H(N).

При нормальном распределении помехи

при длительности сообщения Тс, при

условий, что принятое сообщение у(t)

имеет ограниченный спектр с верхней

частотой Fв, то можно записать:

![]() .

.

8.3 Код, обнаруживающий пакетную ошибку

Групповая ошибка называется пакетной

ошибкой. Пакетная ошибка – это

участок искаженной последовательности

символов, который начинается неправильным

(искаженным) символом и заканчивается

искаженным, в котором могут быть, как

искаженные так и неискаженные, но

количество искаженных подряд символов

не превышает допустимое число (![]() )

. Длина пакета – это количество символов

между первым и последним искаженным

символом, включая эти символы.

)

. Длина пакета – это количество символов

между первым и последним искаженным

символом, включая эти символы.

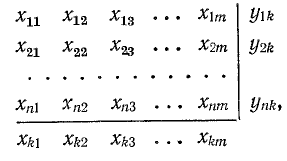

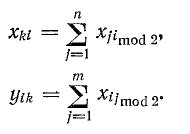

Для обнаружения пакетной ошибки

используются групповые коды с

проверкой на четность. Если использовать

код с четным числом единиц, то его

недостатком будет необнаружение четных

групповых ошибок. Для обнаружения

групповых ошибок эффективно используется

матричный код, который разбивает

комбинацию на матрицу, состоящую из

определенного количества столбцов и

рядков.

Контрольные символы хki определяется сумой по модулю 2 символов расположенных в столбце

П ри

ошибке, длина которой не больше длинны

рядка, в каждую проверку при приеме

сообщения будут входить не более одного

искаженного символа и эти ошибки будут

обнаружены. Для повышения обнаруживающей

способности проверку можно делать по

строкам и по столбцам, для еще более

точного обнаружения можно использовать

диагональные проверки. Недостаток

такого кодирования в том, что для

формирования матрицы нужно время,

которое будет вносить задержку в передачу

информации.

ри

ошибке, длина которой не больше длинны

рядка, в каждую проверку при приеме

сообщения будут входить не более одного

искаженного символа и эти ошибки будут

обнаружены. Для повышения обнаруживающей

способности проверку можно делать по

строкам и по столбцам, для еще более

точного обнаружения можно использовать

диагональные проверки. Недостаток

такого кодирования в том, что для

формирования матрицы нужно время,

которое будет вносить задержку в передачу

информации.

9.1 Энтропия непрерывных сообщений

Непрерывные сообщения могут принимать любые значения в некоторых приделах и являются непрерывными функциями времени.

Особенностью непрерывных сообщений является то, что вероятность появления каждого из отдельных значений равна нулю.

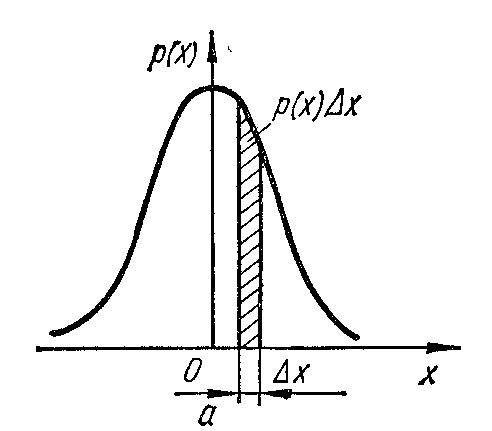

С татистические

свойства непрерывной величины

характеризуют функцией плотности

вероятности распределения ее значений

р

(х). Функцию

р

(х) называют также

дифференциальным законом распределения

величины х. Данная

функция характеризует вероятность

попадания непрерывной

случайной величины х

в

некоторый элементарный интервал значений

Δx. Эта вероятность определяется

произведением р(х)Δx;

и стремится

к нулю при уменьшении ширины интервала.

Таким образом энтропия

татистические

свойства непрерывной величины

характеризуют функцией плотности

вероятности распределения ее значений

р

(х). Функцию

р

(х) называют также

дифференциальным законом распределения

величины х. Данная

функция характеризует вероятность

попадания непрерывной

случайной величины х

в

некоторый элементарный интервал значений

Δx. Эта вероятность определяется

произведением р(х)Δx;

и стремится

к нулю при уменьшении ширины интервала.

Таким образом энтропия

При уменьшении Δx; (увеличении m) первое слагаемое в пределе стремится к интегралу, пределом второго слагаемого

будет

— logΔx.

Таким

образом получим:

.

.

Информативность

непрерывных сообщений, обусловленная

их статистическими

свойствами, полностью определяется

первым слагаемым,

тогда как второе слагаемое зависит лишь

от выбранного интервала

Δx

и является постоянной величиной (при

постоянном Δx).

Первое

слагаемое называется дифференциальной

энтропией.

При

решении конкретных задач обычно

используется выражение для дифференциальной

энтропии без специальных оговорок, а

величина

называется

энтропией и характеризует количество

информации, приходящейся

на один отсчет непрерывного сообщения.

называется

энтропией и характеризует количество

информации, приходящейся

на один отсчет непрерывного сообщения.