- •3 Модуль 1.

- •Тема 1. Методологічні засади статистики

- •1.1. Джерела статистики. Предмет та категорії статистики

- •1.2. Теоретичні та методологічні основи статистики

- •Тема 2. Статистичне спостереження

- •2.1. Зміст, форми, види та способи статистичного спостереження

- •2.2. План статистичного спостереження

- •Тема 3. Зведення та групування статистичних даних

- •3.1. Суть статистичного зведення та групування

- •3.2. Статистичні групування. Види групувань

- •3.3. Ряди розподілу в статистиці

- •Тема 4. Узагальнюючи статистичні показники

- •4.1. Абсолютні величини та їх значення в статистичних дослідженнях

- •4.2. Відносні величини в статистиці. Форми їх вираження

- •4.3. Види відносних величин

- •4.3 Суть і використання середніх величин

- •4.4 Види середніх величин та методи їх розрахунку

- •Тема 5. Аналіз рядів розподілу

- •5.1. Структурні середні в статистиці

- •5.2 Характеристика показників варіації

- •5.3 Спрощені способи розрахунку дисперсії

- •5.4 Дисперсія альтернативної ознаки

- •5.5 Загальна, групова, середня з групових і міжгрупова дисперсії. Правило додавання дисперсії

- •Тема 6. Аналіз концентрації диференціації та подібності розподілів

- •6.1 Показники асиметричності розподілу

- •6.2 Аналіз локалізації, інтенсивності структурних зрушень та подібності структур

- •Тема 7. Статистичні методи вимірювання взаємозв'язків

- •7.1 Види взаємозв’язків між явищами

- •7.2 Основи кореляційно-регресійного аналізу

- •Тема 8. Аналіз інтенсивності динаміки

- •8.1. Динамічні ряди, їх види та правила побудови

- •8.2. Показники динамічного ряду

- •Тема 9. Аналіз тенденцій розвитку та коливань

- •9.1 Методи виявлення тенденцій розвитку в динамічних рядах

- •9.2 Інтерполяція і екстраполяція. Прогнозування суспільних явищ. Аналіз сезонних коливань

- •Тема 10. Індексний метод

- •10.1. Суть індексів та їх роль у статистичному аналізі

- •10.2. Агрегатний індекс ― основна форма загальних індексів

- •10.3. Середньозважені індекси

- •10.4. Індекси зі змінною і постійною вагою

- •10.5. Індекси змінного та фіксованого складу. Індекси структурних зрушень

- •Тема 11. Вибірковий метод

- •11.1. Загальне поняття про вибіркове спостереження

- •11.2. Види та способи відбору одиниць із генеральної сукупності

- •11.3. Помилки вибіркового спостереження

- •11.4. Визначення обсягу вибірки

- •Тема 12. Подання статистичних даних: таблиці, графіки, карти

- •12.1 Роль і значення графічного методу

- •12.2 Основні елементи графіка. Правила побудови статистичних графіків.

- •12.3. Види статистичних графіків і способів їх побудови

Тема 7. Статистичні методи вимірювання взаємозв'язків

7.1 Види взаємозв’язків між явищами

Усі явища суспільного життя існують не ізольовано, а у нерозривному взаємозв’язку, тобто залежать одне від одного, тому вивчення взаємозв’язків та вимірювання причинних залежностей є одним із найважливіших завдань статистики. Причинна залежність являє собою головну форму закономірних зв’язків, проте причина сама по собі не визначає повною мірою наслідку; останній залежить також і від умов, у яких діє причина. Тому для виникнення наслідку необхідні і причини, і умови, тобто фактори. Ознака, яка характеризує наслідок, являється результативною, а та, що характеризує фактор,— факторною.

За статистичною природою зв’язки поділяють на функціональні та стохастичні. При функціональному зв’язку кожному можливому значенню факторної ознаки х відповідає чітко визначене значення результативної ознаки у, тобто функціональні зв’язки характеризуються повною відповідністю між причиною і наслідком, факторною і результативною ознаками. Така залежність притаманна фізичним, хімічним явищам тощо. В суспільних процесах це найчастіше зв’язок

25

складових елементів розрахункових формул відповідних показників, наприклад, залежність врожайності сільськогосподарської культури від валового збору і розміру посівної площі.

При стохастичному зв’язку кожному значенню ознаки х відповідає певна множина значень ознаки у, які варіюють і утворюють ряд розподілу (умовний). Стохастичний зв’язок проявляється зміною умовних розподілів.

Підвидом стохастичної залежності є кореляційна, коли зі зміною факторної ознаки х змінюються групові середні результативної ознаки у, тобто замість умовних розподілів порівнюються середні значення цих розподілів.

Головною характеристикою кореляційного зв’язку є лінія регресії. Лінія регресії у на х ― це функція, яка зв’язує середні значення ознаки у зі значеннями ознаки х. Залежно від форми лінії регресії розрізняють лінійний і нелінійний зв’язки.

7.2 Основи кореляційно-регресійного аналізу

У кореляційно-регресійному аналізі оцінка лінії регресії здійснюється не в окремих точках, як в аналітичному групуванні, а в кожній точці інтервалу зміни факторної ознаки х. Тобто лінія регресії у даному випадку безперервна і зображується у вигляді певної функції Y = f(x), яка являється рівнянням регресії, а Y — це теоретичні значення результативної ознаки.

Серед безлічі функцій найпоширенішою в статистично-економічному аналізі є лінійна Y = b0 + b1x. Це пояснюється, передусім, її простотою та змістовністю параметрів. Крім того, факторна ознака часто варіює в невеликих межах, що дає змогу показати апроксимацію зв’язку лінійною функцією.

Параметр b1 лінійного рівняння являється коефіцієнтом регресії. Він показує, на скільки одиниць власного виміру в середньому змінюється значення ознаки у зі збільшенням значення ознаки х на одиницю.

На етапі оцінки лінії регресії визначають параметри обраного рівняння методом найменших квадратів. Основна умова цього методу полягає у мінімізації суми квадратів відхилень емпіричних значень у від теоретичних Y:

![]() (7.1)

(7.1)

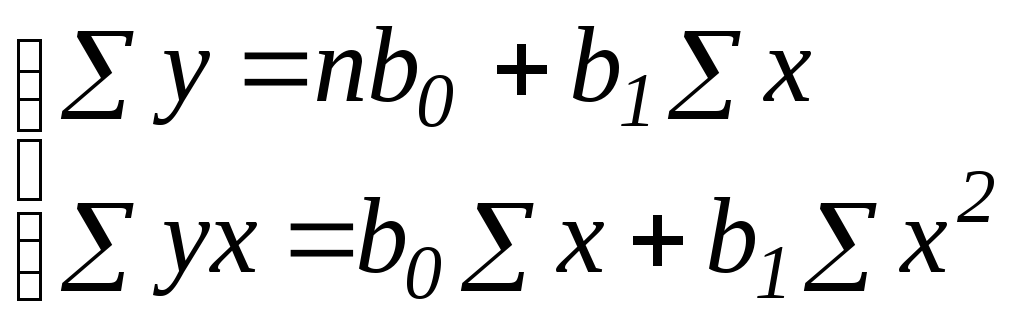

Це дає можливість отримати найкращі оцінки параметрів b0 і b1. Для їх обчислення треба скласти і розв’язати систему нормальних рівнянь. Лінійній моделі відповідає система рівнянь з двома невідомими:

Дослідження форми зв’язку іноді приводить до необхідності використання нелінійних рівнянь регресії. У цьому разі при визначенні параметрів методом найменших квадратів рівняння регресії слід привести до лінійного вигляду певними перетвореннями. При вивченні взаємозв’язків найчастіше використовують такі функції:

1)

степеневу

![]() ,

яка приводиться до лінійного вигляду

логарифму-

,

яка приводиться до лінійного вигляду

логарифму-

26

ванням

![]() .

Подальші розрахунки аналогічні лінійній

моделі;

.

Подальші розрахунки аналогічні лінійній

моделі;

2)

гіперболу

![]() приводять до лінійного вигляду, замінивши

х новою змінною (її зворотним значенням

приводять до лінійного вигляду, замінивши

х новою змінною (її зворотним значенням![]() );

);![]() ;

;

3)

параболу другого порядку

![]() .

Якщо замінити квадрат значень факторної

ознаки (

.

Якщо замінити квадрат значень факторної

ознаки (![]() ),

то дістанемо лінійну функцію від двох

змінних

),

то дістанемо лінійну функцію від двох

змінних![]() .

.

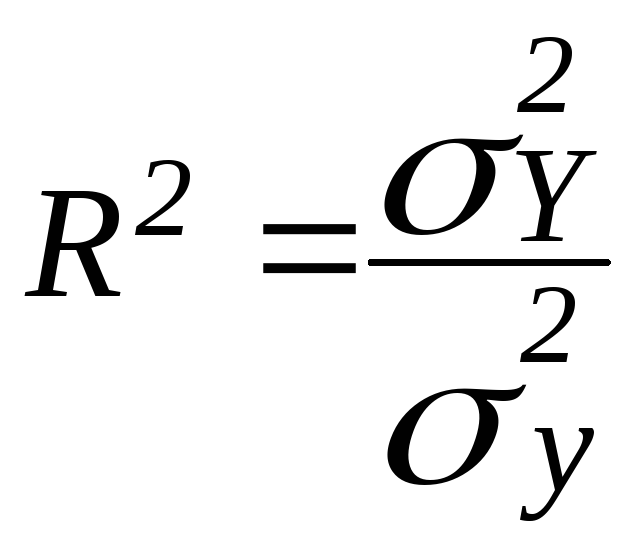

Мірою тісноти зв’язку в кореляційно-регресійному аналізі є коефіцієнт детермінації R2, аналогічний кореляційному відношенню:

(7.2)

(7.2)

Цей коефіцієнт характеризує ту частину варіації результативної ознаки у, яка відповідає лінійному рівнянню регресії.

Коефіцієнт детермінації R2, як і кореляційне відношення, приймає значення від 0 до 1. При R2 = 0 теоретична дисперсія дорівнює нулю, всі теоретичні значення Y збігаються з середнім значенням у. Лінійний кореляційний зв’язок між х і у відсутній.

При R2 = 1 теоретична дисперсія дорівнює загальній, залишкова — нулю; емпіричні значення у і теоретичні Y збігаються, зв’язок між ознаками х та у лінійно-функціональний.

Корінь квадратний з коефіцієнта детермінації являється індексом кореляції.

Як і R2, індекс кореляції змінюється в межах від 0 до 1, характеризує тісноту зв’язку, але економічної інтерпретації немає.

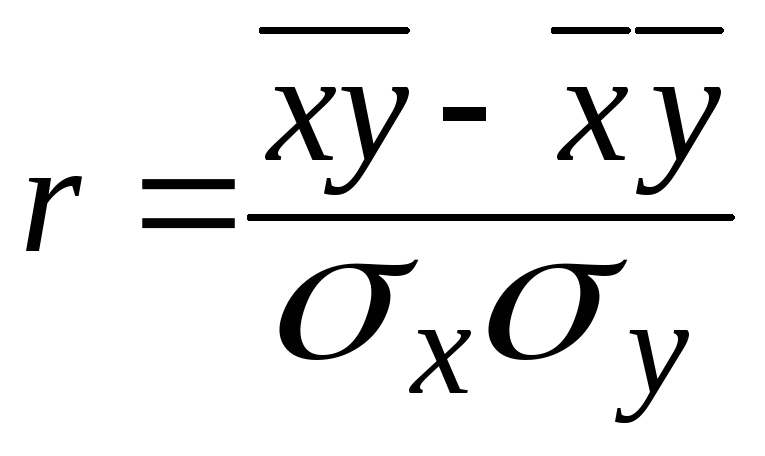

Для вимірювання тісноти зв’язку при лінійній залежності використовують лінійний коефіцієнт кореляції:

(7.3)

(7.3)

Значення r коливаються від – 1 до + 1 і характеризують не тільки тісноту, але й напрям зв’язку. Додатне значення r означає прямий зв’язок між ознаками, від’ємне ― зворотний. На практиці лінійний коефіцієнт кореляції визначають за формулою:

(7.4)

(7.4)

Абсолютна величина коефіцієнта кореляції збігається з індексом кореляції.

На практиці часто використовують множинні, багатофакторні рівняння регресії, коли на величину результативної ознаки впливають два, три і більше факторів.

При теоретичному обґрунтуванні моделі і виборі факторних ознак слід

27

враховувати тісноту кореляційного зв’язку між ознаками. При наявності зв’язку, який близький до функціонального (мультиколінеарності), оцінки параметрів багатофакторного рівняння регресії будуть ненадійними. Для оцінки мультиколінеарності між ознаками достатньо обчислити відповідні коефіцієнти кореляції. Якщо коефіцієнт кореляції двох факторних ознак близький до одиниці, то одну з них треба виключити. На цьому етапі важливо не тільки вибрати фактори, але й розкрити структуру взаємозв’язку між ними.

Складною є проблема обґрунтування функціонального вигляду багатофакторного рівняння регресії. Аналіз парних зв’язків непридатний, тому що фактори взаємозв’язані, а визначити зв’язок між у і хі при фіксованих значеннях інших факторних ознак дуже складно. Тому на практиці найчастіше використовують багатофакторні лінійні рівняння і рівняння, що приводяться до лінійного виду відповідними перетвореннями, тобто:

![]() (7.5)

(7.5)

Контрольні запитання

У чому відмінність між функціональним та стохастичним зв’язком?

Що уявляє собою кореляційний зв’язок?

Які основні задачі вирішують за допомогою кореляційного аналізу?

Дайте визначення статистичної моделі.

Основні етапи побудови однофакторної лінійної регресійної моделі.

Що характеризує коефіцієнт регресії?

Метод визначення параметрів рівняння регресії.

Перевірка значимості коефіцієнтів регресії.

Коефіцієнти кореляції та детермінації, їх сутність.

Основні правила побудови багатофакторної кореляційної моделі.