- •Вопросы госэкзамена по направлению

- •09.03.03 «Прикладная информатика», 2020-2021 уч.Год Дисциплина «Вычислительные системы, сети и телекоммуникации»

- •Понятие вычислительной системы; архитектура и организация; этапы развития

- •Краткая характеристика первого и второго поколений вычислительных систем

- •Технические новации вычислительных систем третьего поколения

- •Специфика вычислительных систем четвертого и пятого поколений

- •Концепция вычислительной машины с хранимой в памяти программой

- •Классификация вычислительных систем, таксономия Флинна

- •Основная память вычислительной машины; временные характеристики

- •Структура вычислительной машины фон Неймана

- •Устройство управления вычислительной машины фон Неймана

- •Арифметико-логическое устройство, укрупненное представление тракта данных

- •Управление трактом данных, стек, машинный цикл с прерыванием

- •Шестиуровневая модель современной вычислительной системы

- •Параллельные вычислительные системы, закон Амдала

- •Параллелизм

- •Параллелизм на уровне инструкций

- •Параллелизм данных

- •Параллелизм задач

- •Распределённые операционные системы

- •Закон Амдала

- •Эталонная модель взаимодействия открытых систем

- •Физический уровень модели osi/rm

- •Потенциальная скорость передачи данных; формулы Шеннона и Найквиста

- •Канальный уровень модели osi/rm; система стандартов ieee 802

- •Межсетевой уровень модели osi/rm

- •Транспортный уровень модели osi/rm

- •Назначение и примеры реализации уровней 5, 6, 7 модели osi/rm

- •Дисциплина «Сетевое управление и протоколы»

- •Стеки коммуникационных протоколов

- •Способы и протоколы маршрутизации в ip-сетях

- •Адресация в сетях ip, классы сетей

- •Структурирование ip-сетей с помощью подсетей; маски подсетей

- •Протокол iPv6

- •Дисциплина «Мультимедиа технологии»

- •Психофизиологический закон Вебера-Фехнера

- •Кривые равной громкости; динамический диапазон

- •Восприятие сложных звуков, критические полосы

- •Градиент передачи яркости, гамма-коррекция

- •Цветовые модели

- •Цветовые стандарты

- •Цветовое пространство yCbCr

- •Цветовая субдискретизация

- •Дисциплина «Методы обработки аудио и видео данных»

- •Дискретизация, теорема Котельникова

- •Квантование; шум квантования

- •Основы устранения избыточности и сжатия аудиоданных с потерями

- •Характеристики электронных изображений

- •Растрово-пиксельный принцип электронного изображения

- •Дисциплина «Статистическая обработка информации»

- •Разделы статистической обработки информации: теория оценок, теория проверки статистических гипотез

- •Смещенность оценки; примеры смещенных и несмещенных оценок

- •Состоятельность оценки; примеры состоятельных и несостоятельных оценок

- •Эффективность оценки; функции штрафа и риска

- •Смещенность симметричного распределения: выборочное среднее, выборочная медиана, усеченное среднее

- •Метод моментов: пример нахождения параметров равномерного распределения

- •Оценка закона распределения случайной величины: эмпирическая интегральная функция распределения

- •Оценка закона распределения случайной величины: метод гистограмм

- •Коэффициенты асимметрии и эксцесса; диаграммы Каллена-Фрея

- •Дисциплина «Построение и анализ графовых моделей»

- •Графы: определения, соотношение числа ребер и вершин

- •Изоморфизм графов, примеры

- •Пути, цепи, циклы; связность графов; алгоритм нахождения компонент связности

- •Эйлеров цикл: определение, условие существования, алгоритм нахождения

- •Гамильтонов цикл: определение, алгоритм нахождения на основе динамического программирования

- •Деревья: остовное дерево, алгоритм Крускала

- •Способы хранения структуры графа в эвм

- •Алгоритм поиска кратчайшего пути в графе

- •Задача о коммивояжере: оптимальный и эвристический алгоритмы решения

- •Раскраска графов, эвристический алгоритм раскраски

- •Дисциплина «Имитационное моделирование»

- •Входные потоки заявок смо: классификация и основные характеристики

- •Модель сервера смо

- •Модель буфера смо; дисциплины обслуживания

- •Классификация Кендалла

- •Теорема Литтла

- •Время пребывания заявки в системе типа m/m/1; среднее количество заявок в системе

- •Три леммы о пуассоновском потоке (слияние, расщепление, выход m/m/1)

- •Расчет однонаправленных сетей массового обслуживания (сети Джексона)

Метод моментов: пример нахождения параметров равномерного распределения

В тех

случаях, когда исследователю необходимо

провести оценку произвольных

параметров случайной величины (например,

границ в равномерном распределении

или показателя в экспоненциальном)

можно воспользоваться достаточно

универсальным методом

моментов (ММ). Суть

метода заключается в следующем. Параметры

случайной величины однозначно задают

функцию распределения

![]() ,

а, значит, и все моменты распределения.

Тогда, если необходимо оценить t

параметров

,

а, значит, и все моменты распределения.

Тогда, если необходимо оценить t

параметров

![]() ,

можно составить следующую систему из

t

уравнений:

,

можно составить следующую систему из

t

уравнений:

(1)

(1)

Переразрешив

данную систему относительно

![]() ,

получим новую систему уравнений,

позволяющую найти параметры распределения

через его моменты:

,

получим новую систему уравнений,

позволяющую найти параметры распределения

через его моменты:

(2)

(2)

После оценки моментов и подстановки их в систему (1) получим оценки для искомых параметров распределения.

Пример нахождения параметров равномерного распределения

По выборке равномерно распределенных случайных величин необходимо одновременно оценить оба параметра данного распределения (левую границу a и правую границу b). Известно, что:

Решив данную систему относительно a и b получим:

Оценив

по выборке

![]() и

и

![]() и, подставив их в данную систему, получим

оценки по ММ для a

и b.

и, подставив их в данную систему, получим

оценки по ММ для a

и b.

Очевидным недостатком данного метода является сложность переразрешения системы (1) в систему (2) для некоторых распределений, а также невысокая точность в случае одновременного оценивания большого количества параметров.

Оценка закона распределения случайной величины: эмпирическая интегральная функция распределения

Для

оценки интегральной функции обычно

исходят из определения, согласно

которому

показывает, с какой вероятностью

случайная величина попадает в область

![]() (см. формулу 1.1). Соответственно оценка

может быть осуществлена, например,

следующим способом:

(см. формулу 1.1). Соответственно оценка

может быть осуществлена, например,

следующим способом:

(1)

(1)

Оценка

![]() называется эмпирической

интегральной функцией распределения.

Как можно видеть из выражения (1),

является ступенчатой функцией,

скачкообразно изменяющейся в точках

называется эмпирической

интегральной функцией распределения.

Как можно видеть из выражения (1),

является ступенчатой функцией,

скачкообразно изменяющейся в точках

![]() на величину, равную 1/N.

на величину, равную 1/N.

Рисунок 1 – График интегральной и эмпирической интегральной функции для распределения хи-квадрат (объемы выборок – 10, 30, 100)

Очевидно, что чем больше объем выборки N, тем меньше величина «ступеньки» и, значит, тем более точной будет оценка функции . Этот факт выражается в следующих теоремах.

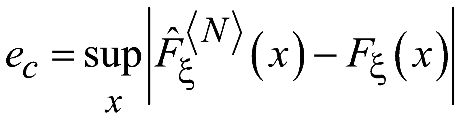

Теорема Гливенко-Кантелли.

Пусть

![]() - бесконечная последовательность из

чисел, распределенных согласно функции

.

Пусть

- бесконечная последовательность из

чисел, распределенных согласно функции

.

Пусть

![]() - эмпирическая интегральная функция

распределения, построенная по первым

N

элементам выборки. Тогда:

- эмпирическая интегральная функция

распределения, построенная по первым

N

элементам выборки. Тогда:

.

.

Здесь

обозначает точную

верхнюю грань для

ошибки в оценке. Таким образом,

эмпирическая интегральная функция

распределения является состоятельной

оценкой интегральной функции

распределения.

обозначает точную

верхнюю грань для

ошибки в оценке. Таким образом,

эмпирическая интегральная функция

распределения является состоятельной

оценкой интегральной функции

распределения.

Теорема Колмогорова.

Скорость сходимости функции к определяется из следующего выражения:

при

при

![]()

Здесь

![]() - случайная величина, распределенная

по закону Колмогорова:

- случайная величина, распределенная

по закону Колмогорова:

Т. е.

максимальная погрешность в оценке в

среднем убывает обратно пропорционально

корню из объема выборки:

(ср. с выражениями (2.3) и (2.5)).

(ср. с выражениями (2.3) и (2.5)).