- •Вопросы госэкзамена по направлению

- •09.03.03 «Прикладная информатика», 2020-2021 уч.Год Дисциплина «Вычислительные системы, сети и телекоммуникации»

- •Понятие вычислительной системы; архитектура и организация; этапы развития

- •Краткая характеристика первого и второго поколений вычислительных систем

- •Технические новации вычислительных систем третьего поколения

- •Специфика вычислительных систем четвертого и пятого поколений

- •Концепция вычислительной машины с хранимой в памяти программой

- •Классификация вычислительных систем, таксономия Флинна

- •Основная память вычислительной машины; временные характеристики

- •Структура вычислительной машины фон Неймана

- •Устройство управления вычислительной машины фон Неймана

- •Арифметико-логическое устройство, укрупненное представление тракта данных

- •Управление трактом данных, стек, машинный цикл с прерыванием

- •Шестиуровневая модель современной вычислительной системы

- •Параллельные вычислительные системы, закон Амдала

- •Параллелизм

- •Параллелизм на уровне инструкций

- •Параллелизм данных

- •Параллелизм задач

- •Распределённые операционные системы

- •Закон Амдала

- •Эталонная модель взаимодействия открытых систем

- •Физический уровень модели osi/rm

- •Потенциальная скорость передачи данных; формулы Шеннона и Найквиста

- •Канальный уровень модели osi/rm; система стандартов ieee 802

- •Межсетевой уровень модели osi/rm

- •Транспортный уровень модели osi/rm

- •Назначение и примеры реализации уровней 5, 6, 7 модели osi/rm

- •Дисциплина «Сетевое управление и протоколы»

- •Стеки коммуникационных протоколов

- •Способы и протоколы маршрутизации в ip-сетях

- •Адресация в сетях ip, классы сетей

- •Структурирование ip-сетей с помощью подсетей; маски подсетей

- •Протокол iPv6

- •Дисциплина «Мультимедиа технологии»

- •Психофизиологический закон Вебера-Фехнера

- •Кривые равной громкости; динамический диапазон

- •Восприятие сложных звуков, критические полосы

- •Градиент передачи яркости, гамма-коррекция

- •Цветовые модели

- •Цветовые стандарты

- •Цветовое пространство yCbCr

- •Цветовая субдискретизация

- •Дисциплина «Методы обработки аудио и видео данных»

- •Дискретизация, теорема Котельникова

- •Квантование; шум квантования

- •Основы устранения избыточности и сжатия аудиоданных с потерями

- •Характеристики электронных изображений

- •Растрово-пиксельный принцип электронного изображения

- •Дисциплина «Статистическая обработка информации»

- •Разделы статистической обработки информации: теория оценок, теория проверки статистических гипотез

- •Смещенность оценки; примеры смещенных и несмещенных оценок

- •Состоятельность оценки; примеры состоятельных и несостоятельных оценок

- •Эффективность оценки; функции штрафа и риска

- •Смещенность симметричного распределения: выборочное среднее, выборочная медиана, усеченное среднее

- •Метод моментов: пример нахождения параметров равномерного распределения

- •Оценка закона распределения случайной величины: эмпирическая интегральная функция распределения

- •Оценка закона распределения случайной величины: метод гистограмм

- •Коэффициенты асимметрии и эксцесса; диаграммы Каллена-Фрея

- •Дисциплина «Построение и анализ графовых моделей»

- •Графы: определения, соотношение числа ребер и вершин

- •Изоморфизм графов, примеры

- •Пути, цепи, циклы; связность графов; алгоритм нахождения компонент связности

- •Эйлеров цикл: определение, условие существования, алгоритм нахождения

- •Гамильтонов цикл: определение, алгоритм нахождения на основе динамического программирования

- •Деревья: остовное дерево, алгоритм Крускала

- •Способы хранения структуры графа в эвм

- •Алгоритм поиска кратчайшего пути в графе

- •Задача о коммивояжере: оптимальный и эвристический алгоритмы решения

- •Раскраска графов, эвристический алгоритм раскраски

- •Дисциплина «Имитационное моделирование»

- •Входные потоки заявок смо: классификация и основные характеристики

- •Модель сервера смо

- •Модель буфера смо; дисциплины обслуживания

- •Классификация Кендалла

- •Теорема Литтла

- •Время пребывания заявки в системе типа m/m/1; среднее количество заявок в системе

- •Три леммы о пуассоновском потоке (слияние, расщепление, выход m/m/1)

- •Расчет однонаправленных сетей массового обслуживания (сети Джексона)

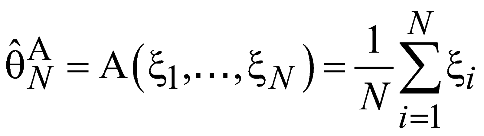

Состоятельность оценки; примеры состоятельных и несостоятельных оценок

При

обработке выборки исследователь

интуитивно предполагает, что, чем больше

ее объем, тем ближе будет оценка к

истинному значению. Т.е. с ростом N,

ошибка в оценивании

![]() должна стремиться к нулю. Это возможно,

если алгоритм оценки эффективно

использует ту информацию об искомом

параметре, которая содержится в выборке.

должна стремиться к нулю. Это возможно,

если алгоритм оценки эффективно

использует ту информацию об искомом

параметре, которая содержится в выборке.

Формально

данное свойство определяется следующим

образом: оценка является состоятельной,

если

![]() сходится по вероятности к

сходится по вероятности к

![]() ,

то есть:

,

то есть:

Для любого θ: NА p→ при N → ∞

То есть оценку параметра называют состоятельной, если с ростом объёма выборки N она сходится по вероятности к оцениваемому параметру.

Несостоятельная оценка – оценка, которая не сходится по вероятности к оцениваемому параметру с ростом выборки.

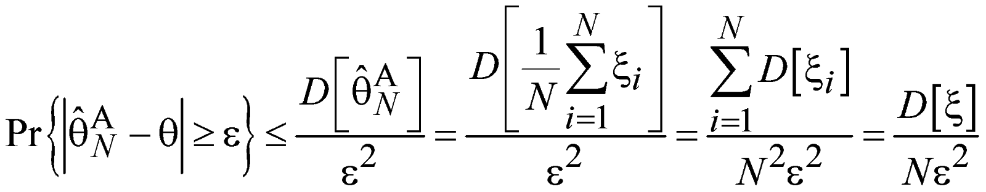

Сходимость

по вероятности в свою очередь означает,

что для любого, сколь угодно малого,

отличного от нуля

![]() :

:

![]()

То есть всегда найдется такой объем выборки, который с вероятностью, близкой к единице обеспечит необходимую величину ошибки в оценивании , какой бы малой она не была.

На практике «увидеть» сходимость «почти наверное» не представляется возможным, поскольку выборки конечны. Таким образом, для прикладной статистики достаточно требовать состоятельности оценки.

Пример состоятельной оценки:

При

анализе трафика, передаваемого с сервера

на компьютеры клиентов, производится

оценка среднего размера пакета

передаваемого по сети. Для этого из

общего потока выбирается N

пакетов,

размеры которых фиксируются и усредняются.

В данном примере случайная величина

![]() характеризует размер пакета, искомый

параметр

- среднее значение

(т.е.

характеризует размер пакета, искомый

параметр

- среднее значение

(т.е.

![]() ),

элементы выборки

),

элементы выборки

![]() - размеры зарегистрированных пакетов,

алгоритм оценивания

- размеры зарегистрированных пакетов,

алгоритм оценивания

.

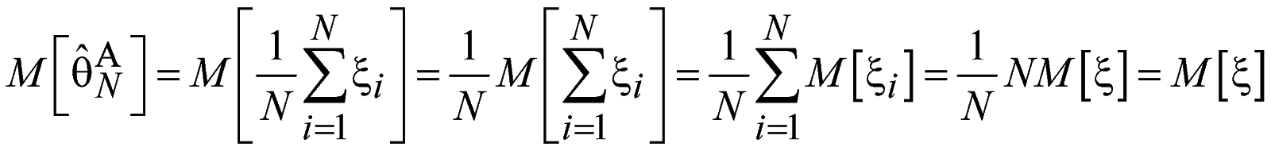

Проверим, является ли данная оценка

смещенной:

.

Проверим, является ли данная оценка

смещенной:

Таким

образом, данная оценка является

несмещенной, то есть

![]() и

можно применить второе неравенство

Чебышева.

и

можно применить второе неравенство

Чебышева.

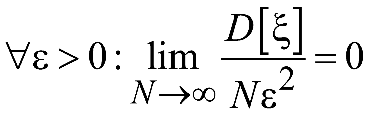

Очевидно,

что при конечной

![]() для

для

,

что доказывает состоятельность

рассмотренной оценки.

,

что доказывает состоятельность

рассмотренной оценки.

Выборочное среднее X= 1ni=1nXi является сильно состоятельной оценкой математического ожидания Xi.

Вообще, все (за редчайшими исключениями) оценки параметров, используемые в вероятностно-статистических методах принятия решений, являются состоятельными.

Эффективность оценки; функции штрафа и риска

Предположим,

что для проведения эксперимента перед

исследователем стоит выбор одного из

двух алгоритмов оценивания искомого

параметра системы. Оба алгоритма

обеспечивают оценки несмещенные и

состоятельные. Как осуществить выбор

одного из них? Для ответа на этот вопрос

вводят третий параметр оценки – параметр

эффективности.

Прежде, чем дать формальное определение

эффективности, дадим ее качественную

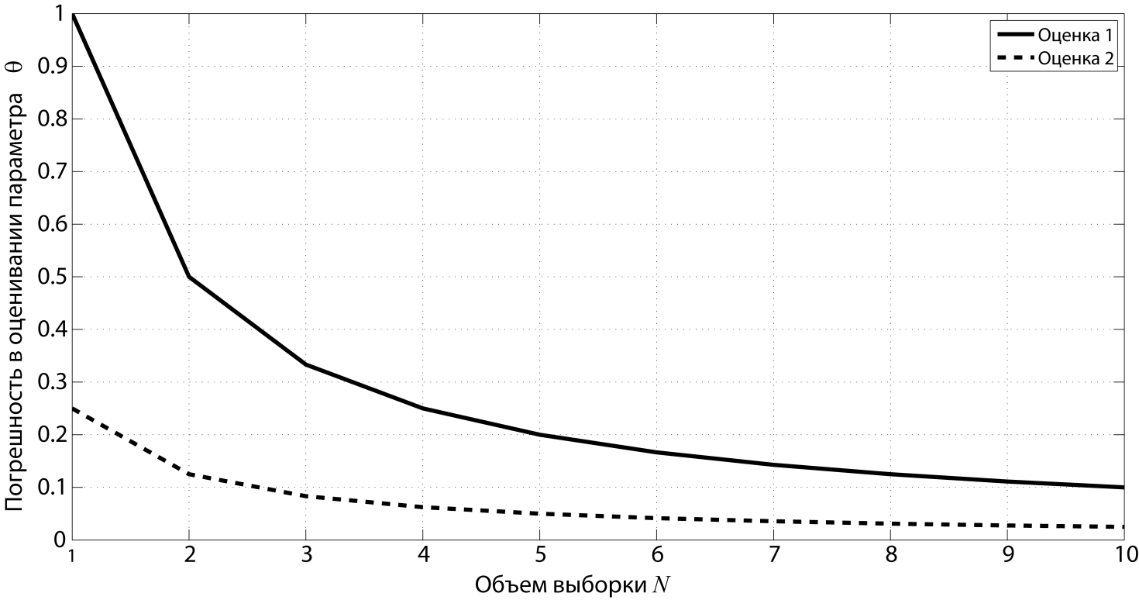

интерпретацию. На рис. 1 для двух

гипотетических оценок приводятся

графики зависимости погрешности

оценивания от объема выборки. Не смотря

на то, что оба алгоритма обеспечивают

сколь угодно малую погрешность при

![]() ,

при конечном N

алгоритм 2 явно кажется более

предпочтительным, т.е. оценка 2 эффективнее

оценки 1.

,

при конечном N

алгоритм 2 явно кажется более

предпочтительным, т.е. оценка 2 эффективнее

оценки 1.

Рис. 1. Сравнение двух алгоритмов оценивания.

Чтобы количественно измерять эффективность введем несколько вспомогательных функций.

Функцией

штрафа

![]() называется функция, характеризующая

меру негативных последствий, возникающих

при той или иной ошибке e

оценивания параметра системы. Как

правило, чем больше

называется функция, характеризующая

меру негативных последствий, возникающих

при той или иной ошибке e

оценивания параметра системы. Как

правило, чем больше

![]() ,

тем больше значение

.

Функция штрафа выбирается исходя из

специфики той предметной области, в

которой ведется статистический анализ

и может принимать достаточно сложный

вид.

,

тем больше значение

.

Функция штрафа выбирается исходя из

специфики той предметной области, в

которой ведется статистический анализ

и может принимать достаточно сложный

вид.

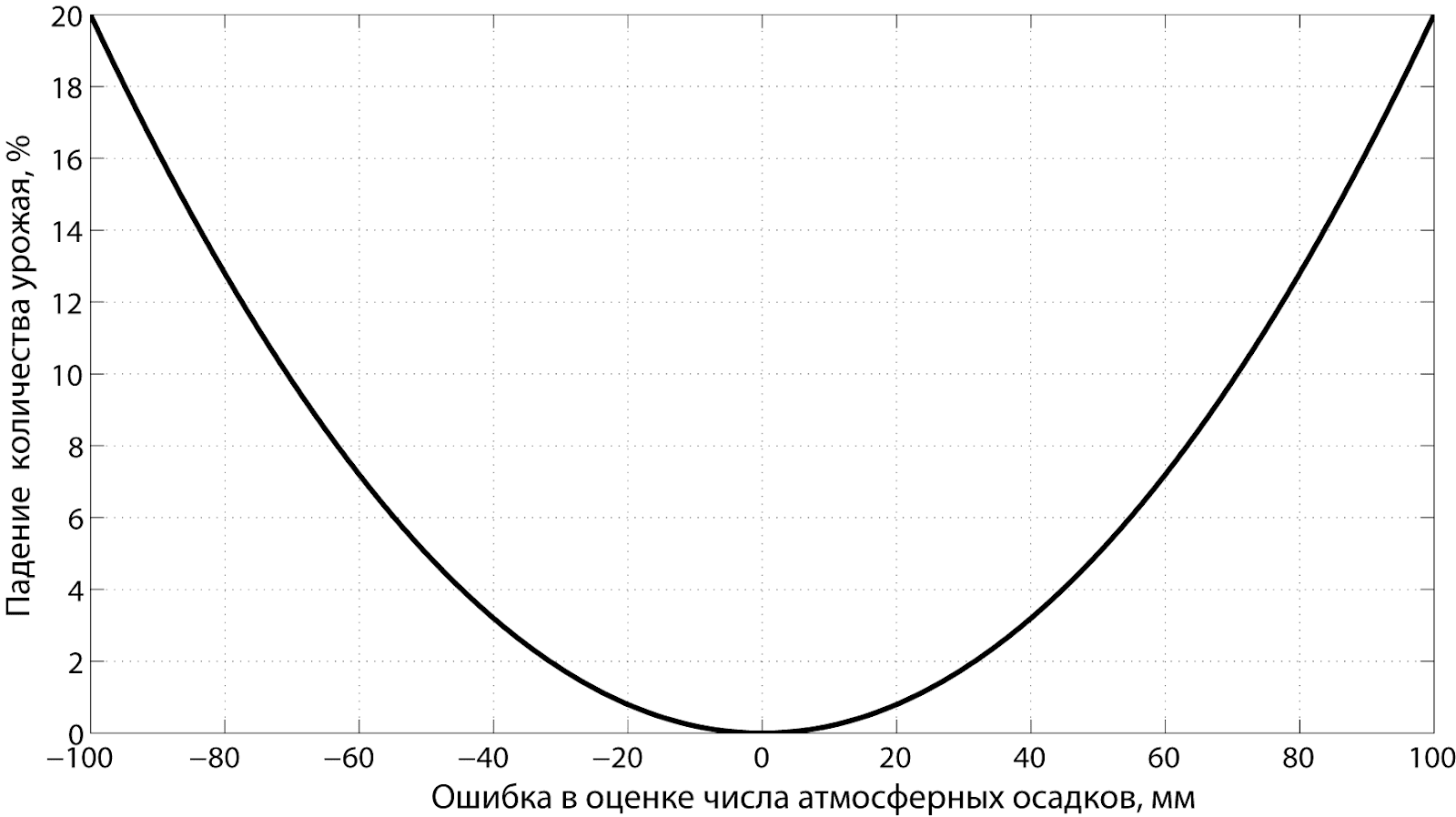

Пример иллюстрирующий функцию штрафа

По данным Гидрометцентра проводится оценка количества осадков, выпавших в некотором регионе. Из количества осадков рассчитывается тип и объем удобрений, которые необходимо применить на сельскохозяйственном поле. Известно, что неправильно выбранный режим удабривания приводит к падению количества урожая. Тогда, функция штрафа может иметь, например, вид, приведенный на рис. 2.

Рис. 2 Функция штрафа в примере, иллюстрирующем функцию штрафа.

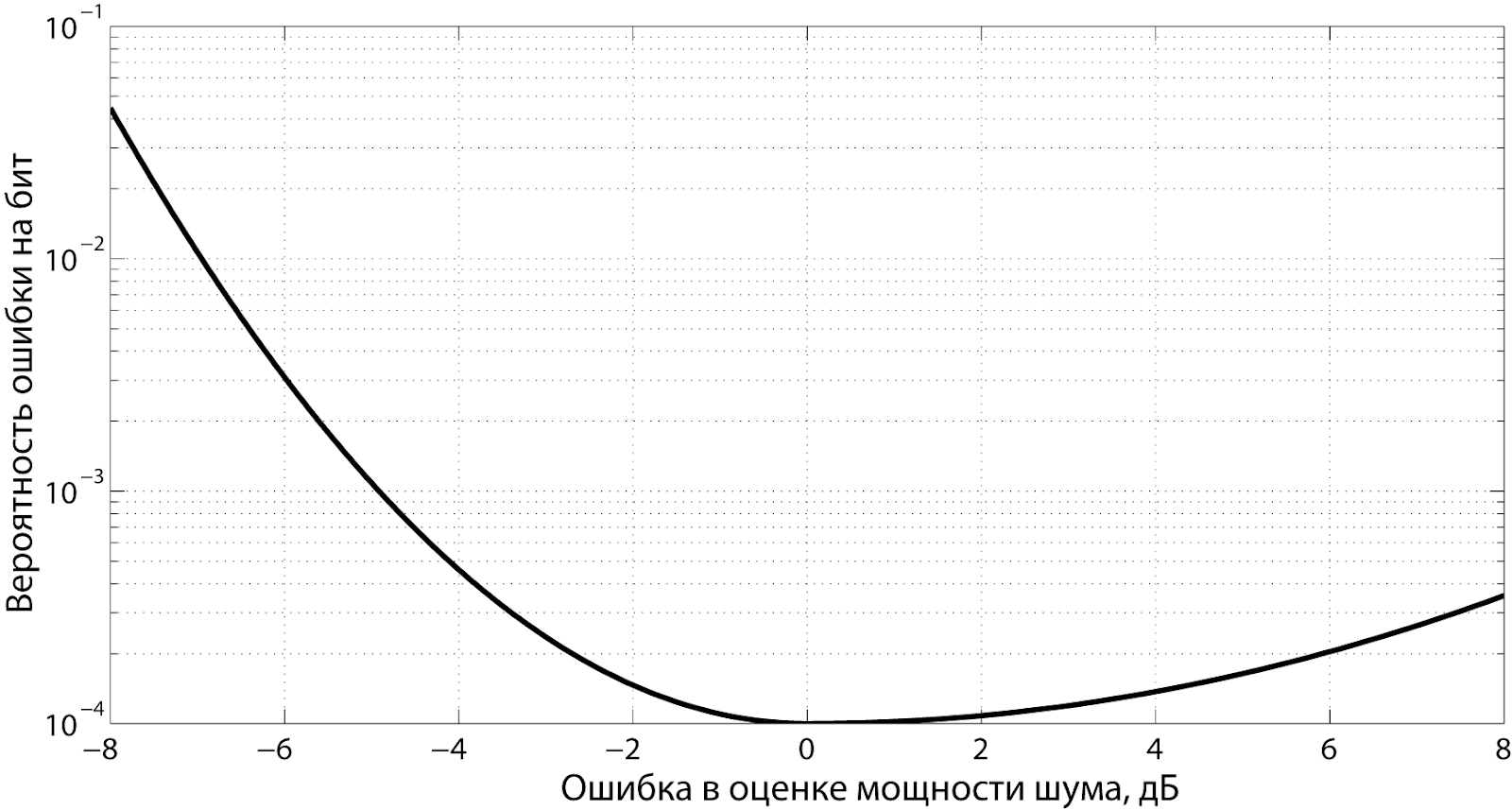

Пример иллюстрирующий функцию штрафа 2

В ходе работы телекоммуникационной системы приемник периодически проводит оценку мощности шумов, присутствующих в канале. Этот уровень учитывается в процессе декодирования принимаемого сообщения. Известно, что ошибочно введенная в декодер информация о шумах повышает вероятность битовой ошибки при приеме данных. При этом заниженная оценка мощности приводит к существенно большему ухудшению качества приема, нежели завышенная. Типичная функция штрафа приведена на рис. 3.

Рис. 3 Функция штрафа в примере, иллюстрирующем функцию штрафа 2.

Как

правило, многие реальные функции штрафа

могут быть хорошо аппроксимированы

так называемой квадратичной

штрафной функцией

![]() или абсолютной

штрафной функцией

или абсолютной

штрафной функцией

![]() .

.

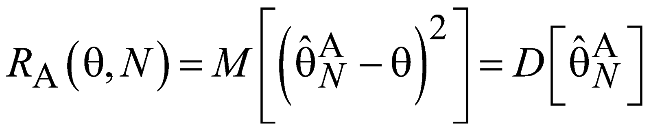

Оценка параметра является случайной величиной, а, значит, ошибка в оценивании и величина штрафа также являются случайными величинами. Таким образом, вводят функцию риска:

![]() .

.

Т.е. функция риска характеризует средний штраф, который заплатит исследователь при использовании алгоритма для оценки параметра по выборке объема N. Более эффективной является та оценка, которая обеспечивает меньший риск.

Стоит отметить, что для несмещенных оценок в случае применения квадратичной штрафной функции:

Т.е. функция риска совпадает с дисперсией оценки.

Как

можно видеть, функция риска зависит

как от объема выборки, так и от истинного

значения параметра

.

Таким образом, для различных диапазонов

значения

разные оценки могут оказаться более

или менее эффективными. При этом

ожидается, что для состоятельных оценок

![]() (функция риска) убывает с ростом N.

Следующий пример иллюстрирует эту

зависимость:

(функция риска) убывает с ростом N.

Следующий пример иллюстрирует эту

зависимость:

Проводится

эксперимент, в ходе которого выясняется

вероятность потери пакета

при передаче по вычислительной сети.

Для этого по сети передаются N

тестовых пакетов, успешный прием или

потеря которых регистрируется на

приемной стороне. Вводится величина

,

равная единице, в случае, если i-й

пакет оказался утерянным, и нулю иначе.

Тогда воспользуемся следующей несложной

оценкой:

.

Найдем выражение

для случая применения квадратичной

штрафной функции. Очевидно, что

.

Найдем выражение

для случая применения квадратичной

штрафной функции. Очевидно, что

![]() ,

тогда:

,

тогда:

Т.к. является Бернуллиевской случайной величиной с параметром , то:

.

.