- •1. Множественная линейная регрессия Задание

- •Методические рекомендации по выполнению работы

- •Комплексный пример основных расчетов по работе

- •2. Мультиколлинеарность Задание

- •Методические рекомендации по выполнению работы

- •2.1. Способ 1.

- •2.2. Способ 2.

- •6.1. Способ 1.

- •6.2. Способ 2.

- •Комплексный пример основных расчетов по работе 3

- •2.1. Способ 1.

- •2.2. Способ 2.

- •6.1. Способ 1.

- •6.2. Способ 2.

- •3. Гетероскедастичность Задание

- •Методические рекомендации по выполнению работы

- •4. Автокорреляция остатков Задание

- •Методические рекомендации по выполнению работы

2.1. Способ 1.

Вычисляем средние арифметические значенияобъясняющих переменных (см. табл.3.6): в ячейкуC18вводим формулу=СРЗНАЧ(C3:C17)и копируем ее в ячейкиD18:E18.

Вычисляем оценки стандартных отклоненийобъясняющих переменных: в ячейкуC19вводим формулу=СТАНДОТКЛОНП(C3:C17)и копируем ее в ячейкиD19:E19.

Выполняем

стандартизацию объясняющих переменных:

в ячейкуF3вводим

формулу=НОРМАЛИЗАЦИЯ(C3:C17;C$18;C$19)и

копируем ее в ячейкиF4:F17.

Затем формулу из ячейкиF3копируем в ячейкиG3:H3.

После этого формулу из ячейкиG3копируем в ячейкиG4:G17,

а из ячейкиH3копируем в ячейкиH4:H17.

В результате в ячейкахF3:H17получаем матрицу![]() стандартизованных объясняющих переменных.

стандартизованных объясняющих переменных.

Если стандартизация выполнена правильно, то средние значения стандартизованных объясняющих переменных с точностью до ошибки вычислений будут равны нулю (см. суммы по столбцам в ячейках F18:H18).

На основе матрицы

![]() находим корреляционную матрицу

объясняющих переменных (табл.3.8): выделяем

область пустых ячеекB53:D55размера

находим корреляционную матрицу

объясняющих переменных (табл.3.8): выделяем

область пустых ячеекB53:D55размера![]() (у нас три объясняющих переменных),

вводим формулу

(у нас три объясняющих переменных),

вводим формулу

=МУМНОЖ(ТРАНСП(F3:H17);F3:H17)/B20

нажимаем клавишу F2, затем – клавишиCtrl+Shift+Enter.

2.2. Способ 2.

Выбираем Сервис/Анализ данных/Корреляцияи в диалоговом окне указываем:

Входной интервал$C$2:$E$17

Группированиепо столбцам

Метки в первой строке

Выходной интервал$F$46

Подтверждаем ОК.

В результате в ячейках F46:I49появитсянижний треугольниккорреляционной матрицы.

Заполняем верхний треугольниккорреляционной матрицы, т.е. достраиваем корреляционную матрицу путем копирования значений ячеек нижнего треугольника в соответствующие ячейки верхнего треугольника. В примере для наглядности корреляционная матрица из ячеекF46:I49скопирована в ячейкиF52:I55, после чего значение ячейкиG54скопировано в ячейкуH53, значение ячейкиG55– в ячейкуI53и значение ячейкиH55– вI54.

3.Находим

определитель![]() корреляционной матрицы (табл.3.9): в ячейкуD57вводим формулу=МОПРЕД(G53:I55).

корреляционной матрицы (табл.3.9): в ячейкуD57вводим формулу=МОПРЕД(G53:I55).

Поскольку определитель 0,003454 близок к нулю, то в массиве объясняющих переменных может существовать мультиколлинеарность.

Вычисляем

статистику

![]() по формуле (3.1): в ячейкуD58вводим формулу=-(15-1-(2*3+5)/6)*LN(D57),

результат применения которой равен68,96176.

по формуле (3.1): в ячейкуD58вводим формулу=-(15-1-(2*3+5)/6)*LN(D57),

результат применения которой равен68,96176.

Для определения

![]() при

при![]() и степенях свободы

и степенях свободы![]() в ячейкуD59вводим

формулу=ХИ2ОБР(0,05;3), результат

применения которой равен7,814725.

в ячейкуD59вводим

формулу=ХИ2ОБР(0,05;3), результат

применения которой равен7,814725.

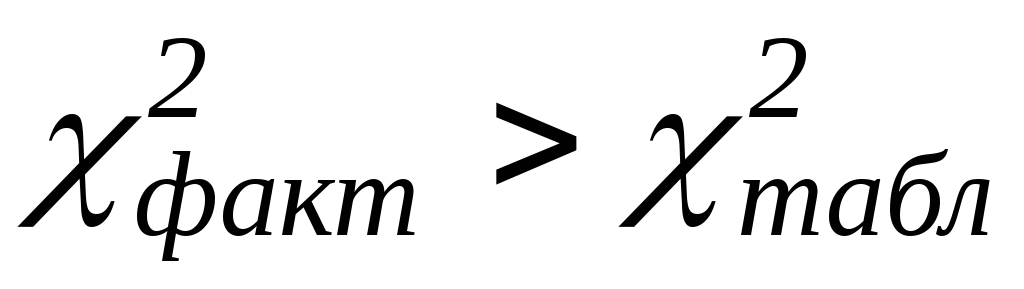

Поскольку

![]() ,

то с надежностью0,95в массиве

объясняющих переменных существуетобщая мультиколлинеарность.

,

то с надежностью0,95в массиве

объясняющих переменных существуетобщая мультиколлинеарность.

Таблица 3.9 – Исследование мультиколлинеарности методом Феррара-Глобера

|

|

B |

C |

D |

E |

F |

G |

H |

I |

J |

|

57 |

Определитель= |

0,003454 |

|

R^2(X1)= |

0,951906 |

|

F1= |

118,7545 | |

|

58 |

ХИ-факт= |

|

68,96176 |

|

R^2(X2)= |

0,951177 |

|

F2= |

116,8931 |

|

59 |

ХИ-табл= |

|

7,814725 |

|

R^2(X3)= |

0,943311 |

|

F3= |

99,83974 |

|

60 |

|

|

|

|

|

|

|

F-табл= |

3,88529 |

|

61 |

Обратная матрица |

|

|

|

|

|

|

| |

|

62 |

20,79242 |

11,67875 |

8,791835 |

|

r12= |

-0,56592 |

|

t12= |

-2,27658 |

|

63 |

11,67875 |

20,48218 |

-8,47489 |

|

r13= |

-0,45907 |

|

t13= |

-1,71382 |

|

64 |

8,791835 |

-8,47489 |

17,63996 |

|

r23= |

0,445859 |

|

t23= |

1,65204 |

|

65 |

|

|

|

|

|

|

|

t-табл= |

2,200986 |

Находим матрицу

![]() ,

обратную к корреляционной матрицеr:

выделяем область свободных ячеекB62:D64размера

,

обратную к корреляционной матрицеr:

выделяем область свободных ячеекB62:D64размера![]() (три объясняющих переменных), вводим

формулу=МОБР(G53:I55), нажимаем клавишуF2и затем клавишиCtrl+Shift+Enter.

(три объясняющих переменных), вводим

формулу=МОБР(G53:I55), нажимаем клавишуF2и затем клавишиCtrl+Shift+Enter.

По формуле (3.3) определяем коэффициенты детерминации для каждой объясняющей переменной:

в ячейку G57вводим формулу=1-1/B62![]() =0,951906

=0,951906

в ячейку G58вводим формулу=1-1/C63![]() =0,951177

=0,951177

в ячейку G59вводим формулу=1-1/D64![]() =0,943311

=0,943311

Все коэффициенты детерминации высокие.

По формуле (3.4) вычисляем F-статистики:

в ячейку J57вводим формулу=(B62-1)*(15-3)/(3-1)![]() =118,7545

=118,7545

в ячейку J58вводим формулу=(C63-1)*(15-3)/(3-1)![]() =116,8931

=116,8931

в ячейку J59вводим формулу=(D64-1)*(15-3)/(3-1)![]() =99,83974

=99,83974

Для определения

![]() при уровне значимости

при уровне значимости![]() и числе степеней свободы

и числе степеней свободы![]() ,

в ячейкуJ60вводим

формулу=FРАСПОБР(0,05;2;12), результат

применения которой равняется3,88529.

,

в ячейкуJ60вводим

формулу=FРАСПОБР(0,05;2;12), результат

применения которой равняется3,88529.

Так как все

![]() ,

токаждая объясняющая переменная

мультиколлинеарна с двумя другими.

,

токаждая объясняющая переменная

мультиколлинеарна с двумя другими.

Определяем наличие попарной мультиколлинеарности(пары факторов, между которыми существует мультиколлинеарность).

По формуле (3.5) находим частные коэффициенты корреляции:

в ячейку G62вводим формулу=-C62/КОРЕНЬ(B62*C63)![]() =-0,56592

=-0,56592

в ячейку G63вводим формулу=-D62/КОРЕНЬ(B62*D64)![]() =-0,45907

=-0,45907

в ячейку G64вводим формулу=-D63/КОРЕНЬ(C63*D64)![]() =0,445859

=0,445859

По формуле (3.6) для частных коэффициентов корреляции находим t-статистики:

в ячейку J62вводим формулу=G62*КОРЕНЬ(15-3-1)/КОРЕНЬ(1-G62^2)

![]() =-2,27658

=-2,27658

в ячейку J63вводим формулу=G63*КОРЕНЬ(15-3-1)/КОРЕНЬ(1-G63^2)

![]() =-1,71382

=-1,71382

в ячейку J64вводим формулу=G64*КОРЕНЬ(15-3-1)/КОРЕНЬ(1-G64^2)

![]() =1,65204

=1,65204

Для определения

табличного значения t-критерия

при уровне значимости![]() и числе степеней свободы15-3-1=11в

ячейкуJ65вводим

формулу=СТЬЮДРАСПОБР(0,05;(15-3-1)),

результат применения которой равняется2,200986.

и числе степеней свободы15-3-1=11в

ячейкуJ65вводим

формулу=СТЬЮДРАСПОБР(0,05;(15-3-1)),

результат применения которой равняется2,200986.

Значение

![]() ,

то есть между объясняющими переменными

,

то есть между объясняющими переменными![]() и

и![]() существует мультиколлинеарность.

существует мультиколлинеарность.

Таким образом, цена товараицена первого заменителя товарасоставляютмультиколлинеарную пару.

4.Примем меры к смягчению мультиколлинеарности.

Все

![]() ,

поэтому каждая объясняющая переменная

мультиколлинеарна с двумя другими.

Самые высокие (и практически одинаковые)

коэффициенты детерминации имеют

объясняющие переменные

,

поэтому каждая объясняющая переменная

мультиколлинеарна с двумя другими.

Самые высокие (и практически одинаковые)

коэффициенты детерминации имеют

объясняющие переменные![]() (цена товара) и

(цена товара) и![]() (цена первого товара-заменителя).

Поскольку только

(цена первого товара-заменителя).

Поскольку только![]() ,

то имеем одну мультиколлинеарную пару

– между

,

то имеем одну мультиколлинеарную пару

– между![]() и

и![]() .

.

На первом этапе

попробуем преобразоватьодну

из объясняющих переменных мультиколлинеарной

пары. Подвергать преобразованию

объясняющую переменную![]() (цена товара) не следует, т.к. это будет

противоречить экономическому смыслу

анализируемой причинной зависимости.

Поэтому вместо фактора

(цена товара) не следует, т.к. это будет

противоречить экономическому смыслу

анализируемой причинной зависимости.

Поэтому вместо фактора![]() (цена первого товара-заменителя) введем

фактор

(цена первого товара-заменителя) введем

фактор![]() .

Для наглядности скопируем массив

исходных данных, расположенный в ячейкахA2:E17, в ячейкиA68:E83. Затем в ячейкуD69введем формулу=C3-D3и скопируем

ее в ячейкиD70:D83(табл.3.10).

.

Для наглядности скопируем массив

исходных данных, расположенный в ячейкахA2:E17, в ячейкиA68:E83. Затем в ячейкуD69введем формулу=C3-D3и скопируем

ее в ячейкиD70:D83(табл.3.10).

Таблица 3.10 – Замена фактора Х2 на фактор (Х1-Х2)

|

|

A |

B |

C |

D |

E |

F |

G |

H |

I |

|

68 |

Набл-ние |

Y |

X1 |

X1-Х2 |

X3 |

|

|

|

|

|

69 |

1 |

21,6 |

25,2 |

-0,6 |

7,9 |

Достроенная корр.матрица |

| ||

|

70 |

2 |

25,2 |

24,3 |

-7 |

8,1 |

|

X1 |

X1-Х2 |

X3 |

|

71 |

3 |

26,0 |

23,9 |

-12,5 |

9,5 |

X1 |

1 |

0,986995 |

-0,96397 |

|

72 |

4 |

36,4 |

22,6 |

-16,1 |

10,3 |

X1-Х2 |

0,986995 |

1 |

-0,9705 |

|

73 |

5 |

38,5 |

21,5 |

-17,6 |

13,1 |

X3 |

-0,96397 |

-0,9705 |

1 |

|

74 |

6 |

43,6 |

20,4 |

-24,9 |

15,5 |

Определитель= |

0,001465 |

| |

|

75 |

7 |

40,1 |

19,1 |

-26,3 |

17,0 |

ХИ-факт= |

|

79,3992 |

|

|

76 |

8 |

47,8 |

14,7 |

-37,3 |

17,0 |

ХИ-табл= |

|

7,814725 |

|

|

77 |

9 |

55,5 |

14,4 |

-32,9 |

19,6 |

|

|

|

|

|

78 |

10 |

59,8 |

14,0 |

-37,8 |

20,8 |

|

|

|

|

|

79 |

11 |

68,0 |

12,2 |

-43,7 |

20,7 |

|

|

|

|

|

80 |

12 |

69,5 |

11,8 |

-47,1 |

21,6 |

|

|

|

|

|

81 |

13 |

73,4 |

8,9 |

-52,1 |

23,4 |

|

|

|

|

|

82 |

14 |

72,2 |

7,3 |

-56,9 |

23,0 |

|

|

|

|

|

83 |

15 |

76,6 |

5,9 |

-57,2 |

23,9 |

|

|

|

|

Теперь заново

оценим существование общеймультиколлинеарности методом

Феррара-Глобера (по критерию![]() )

в новом массиве объясняющими переменными,

среди которых вместо фактора

)

в новом массиве объясняющими переменными,

среди которых вместо фактора![]() рассматривается фактор

рассматривается фактор![]() .

Для этого получим треугольную

корреляционную матрицу новых объясняющих

переменных с помощью инструментаАнализ

данных/Корреляция, указав параметры

диалогового окна:

.

Для этого получим треугольную

корреляционную матрицу новых объясняющих

переменных с помощью инструментаАнализ

данных/Корреляция, указав параметры

диалогового окна:

Входной интервал$C$68:$E$83

Группированиепо столбцам

Метки в первой строке

Выходной интервал$F$70

В результате в ячейках F70:I73появитсянижний треугольниккорреляционной матрицы.

Здесь же заполняем верхний треугольниккорреляционной матрицы, т.е. достраиваем корреляционную матрицу путем копирования значений ячеек нижнего треугольника в соответствующие ячейки верхнего треугольника.

Находим определитель корреляционной матрицы: в ячейку H74вводим формулу=МОПРЕД(G71:I73), результат применения которой равняется0,001465.

Определитель

уменьшился (был 0,003454,стал0,001465).

Следовательно, общая мультиколлинеарностьусилилась, что подтверждает

критерий![]() :

:

вычисляем статистику

по формуле (3.1): в ячейкуH75вводим формулу=-(15-1-(2*3+5)/6)*LN(H74),

результат применения которой равен79,3992, что больше,

чем было для исходного массива объясняющих

переменных (68,96176);

по формуле (3.1): в ячейкуH75вводим формулу=-(15-1-(2*3+5)/6)*LN(H74),

результат применения которой равен79,3992, что больше,

чем было для исходного массива объясняющих

переменных (68,96176); при

при и тех же степенях свободы

и тех же степенях свободы остался прежним (7,814725);

остался прежним (7,814725);поскольку

,

то с надежностью0,95в массиве

объясняющих переменных существуетобщая мультиколлинеарность.

,

то с надежностью0,95в массиве

объясняющих переменных существуетобщая мультиколлинеарность.

Т.к. степень мультиколлинеарности возросла, то строить регрессию на преобразованных данных не имеет смысла – результат будет не лучше ранее полученного.

Поэтому делаем

вывод, что замена переменной ничего не

дала, и переменную

![]() исключаем из рассмотрения. Т.е. теперь

рассматриваем две объясняющие переменные:

исключаем из рассмотрения. Т.е. теперь

рассматриваем две объясняющие переменные:![]() (цена товара) и

(цена товара) и![]() (цена второго товара-заменителя).

(цена второго товара-заменителя).

Проверяем

наличие общеймультиколлинеарности

методом Феррара-Глобера (по критерию![]() )

между двумя оставшимися объясняющими

переменными

)

между двумя оставшимися объясняющими

переменными![]() и

и![]() .

.

Для наглядности

копируем исходные данные для Y,![]() и

и![]() в ячейкиA86:D101(табл.3.11).

в ячейкиA86:D101(табл.3.11).

Оцениваем

существование общеймультиколлинеарности

методом Феррара-Глобера (по критерию![]() )

между объясняющими переменными

)

между объясняющими переменными![]() и

и![]() .

Для этого получим треугольную

корреляционную матрицу этих объясняющих

переменных с помощью инструментаАнализ

данных/Корреляция, указав параметры

диалогового окна:

.

Для этого получим треугольную

корреляционную матрицу этих объясняющих

переменных с помощью инструментаАнализ

данных/Корреляция, указав параметры

диалогового окна:

Входной интервал$C$87:$D$101

Группированиепо столбцам

Метки в первой строке

Выходной интервал$F$88

В результате в ячейках F88:H90появитсянижний треугольниккорреляционной матрицы.

Таблица 3.11 – Исключение фактора Х2

|

|

A |

B |

C |

D |

E |

F |

G |

H |

|

86 |

Набл-ние |

Y |

X1 |

X3 |

|

|

|

|

|

87 |

1 |

21,6 |

25,2 |

7,9 |

|

Достроенная корр.матрица | ||

|

88 |

2 |

25,2 |

24,3 |

8,1 |

|

|

X1 |

X3 |

|

89 |

3 |

26,0 |

23,9 |

9,5 |

|

X1 |

1 |

-0,96397 |

|

90 |

4 |

36,4 |

22,6 |

10,3 |

|

X3 |

-0,96397 |

1 |

|

91 |

5 |

38,5 |

21,5 |

13,1 |

|

Определитель= |

0,070755 | |

|

92 |

6 |

43,6 |

20,4 |

15,5 |

|

ХИ-факт= |

|

33,10668 |

|

93 |

7 |

40,1 |

19,1 |

17,0 |

|

ХИ-табл= |

|

3,841455 |

|

94 |

8 |

47,8 |

14,7 |

17,0 |

|

|

|

|

|

95 |

9 |

55,5 |

14,4 |

19,6 |

|

|

|

|

|

96 |

10 |

59,8 |

14,0 |

20,8 |

|

|

|

|

|

97 |

11 |

68,0 |

12,2 |

20,7 |

|

|

|

|

|

98 |

12 |

69,5 |

11,8 |

21,6 |

|

|

|

|

|

99 |

13 |

73,4 |

8,9 |

23,4 |

|

|

|

|

|

100 |

14 |

72,2 |

7,3 |

23,0 |

|

|

|

|

|

101 |

15 |

76,6 |

5,9 |

23,9 |

|

|

|

|

Заполняем верхний треугольниккорреляционной матрицы, т.е. достраиваем корреляционную матрицу путем копирования значения ячейкиG90в ячейкуH89.

Находим определитель корреляционной матрицы: в ячейку H91вводим формулу=МОПРЕД(G89:H90), результат применения которой равняется0,070755. Определитель существенно возрос. Общая мультиколлинеарность уменьшилась:

вычисляем критерий

по формуле (3.1): в ячейкуH92вводим формулу=-(15-1-(2*2+5)/6)*LN(H91),

результат применения которой равен33,10668;

по формуле (3.1): в ячейкуH92вводим формулу=-(15-1-(2*2+5)/6)*LN(H91),

результат применения которой равен33,10668; при

при и степенях свободы

и степенях свободы :

в ячейкуH93вводим

формулу=ХИ2ОБР(0,05;1), результат

применения которой равен3,841455.

:

в ячейкуH93вводим

формулу=ХИ2ОБР(0,05;1), результат

применения которой равен3,841455.поскольку

,

то с надежностью0,95в массиве

объясняющих переменных существуетобщая мультиколлинеарность,

но степень её по сравнению с исходным

массивом объясняющих переменных

существенно ниже.

,

то с надежностью0,95в массиве

объясняющих переменных существуетобщая мультиколлинеарность,

но степень её по сравнению с исходным

массивом объясняющих переменных

существенно ниже.

По данным

B87:D101с помощью инструментаАнализ

Данных/Регрессиястроим множественную

линейную регрессияYна факторы![]() .

Таблицы регрессионного анализа

представлены в табл.3.12.

.

Таблицы регрессионного анализа

представлены в табл.3.12.

Таблица 3.12 – Регрессия Yна факторы Х1 и Х3

|

ВЫВОД ИТОГОВ |

|

|

|

|

| |

|

|

|

|

|

|

|

|

|

Регрессионная статистика |

|

|

|

|

| |

|

Множественный R |

0,982854 |

|

|

|

|

|

|

R-квадрат |

0,966002 |

|

|

|

|

|

|

Нормированный R-квадрат |

0,960335 |

|

|

|

|

|

|

Стандартная ошибка |

3,777272 |

|

|

|

|

|

|

Наблюдения |

15 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Дисперсионный анализ |

|

|

|

| ||

|

|

df |

SS |

MS |

F |

Значимость F |

|

|

Регрессия |

2 |

4864,731 |

2432,365 |

170,4795 |

1,54E-09 |

|

|

Остаток |

12 |

171,2134 |

14,26778 |

|

|

|

|

Итого |

14 |

5035,944 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Коэффициенты |

Стандартная ошибка |

t-статистика |

P-Значение |

Нижние 95% |

Верхние 95% |

|

Y-пересечение |

51,9163 |

20,5685 |

2,524068 |

0,026709 |

7,101384 |

96,73122 |

|

X1 |

-1,60369 |

0,587316 |

-2,73055 |

0,018248 |

-2,88335 |

-0,32404 |

|

X3 |

1,472891 |

0,661826 |

2,225496 |

0,045982 |

0,030896 |

2,914886 |

Проанализируем статистическое качество полученной эконометрической модели.

Коэффициент детерминации 0,966002(значение высокое и не намного уступает ранее полученному значению0,968117, т.е. коэффициент детерминации снизился незначительно), что указывает на очень тесную связь факторов и результата.

Уровень значимости F-статистики1,54E-09, что значительно меньше допустимого уровня значимости 0,05. Поэтому с надежностью 0,95 полученное значение коэффициента детерминации статистически значимо, и, следовательно, модель в целом является статистически достоверной.

Р-значения оценок параметров:

для

![]() (Y-пересечение):0,026709<

0,05;

(Y-пересечение):0,026709<

0,05;

для

![]() (коэффициент приX1): 0,018248<

0,05;

(коэффициент приX1): 0,018248<

0,05;

для

![]() (коэффициент приХ3): 0,045982<

0,05.

(коэффициент приХ3): 0,045982<

0,05.

Следовательно, с надежностью 0,95 оценки всех параметров являются статистически значимыми.

Вывод: в данном случае мультиколлинеарность не является серьезной проблемой(мультиколлинеарность удалось несколько смягчить).

5.Поскольку оценки всех параметров уравнения регрессии с надежностью 0,95 статистически значимые, построим 95-процентные доверительные интервалы для параметров модели. Они приведены в последней таблице регрессионного анализа (Нижние 95%;Верхние 95%):

7,101384

<![]() (Y-пересечение)

<96,73122;

(Y-пересечение)

<96,73122;

-2,88335

<![]() (параметр приX1)

<-0,32404;

(параметр приX1)

<-0,32404;

0,030896

<![]() (параметр приХ3)

<2,914886.

(параметр приХ3)

<2,914886.

Видно, что 95%-доверительные интервалы для параметров довольно большие, что указывает на недостаточное смягчение мультиколлинеарности (рассмотренные способы смягчения мультиколлинеарности оказались недостаточно эффективными).

6.Получимпрогнозныезначения спроса на товар

при наблюдаемых сочетаниях значений

учтенных в модели факторов![]() и

и![]() ,

т.е. определимточечные прогнозы

,

т.е. определимточечные прогнозы![]() .

.

Вначале скопируем

данные, на которых построена модель, в

ячейки A125:E140(табл.3.13). В этот массив добавим переменную![]() ,

значения которой во всех наблюдениях

равныединице. Переменная

,

значения которой во всех наблюдениях

равныединице. Переменная![]() соответствует переменной при свободном

члене

соответствует переменной при свободном

члене![]() .

Эта переменная потребуется при определении

интервального прогноза.

.

Эта переменная потребуется при определении

интервального прогноза.

Таблица 3.13 – Прогнозирование

|

|

A |

B |

C |

D |

E |

F |

G |

H |

I |

J |

K |

|

124 |

Прогнозирование |

|

|

|

|

|

|

|

| ||

|

125 |

Набл-ние |

Y |

Х0 |

X1 |

X3 |

Y^(n=15) |

ТЕНДЕНЦ |

Под корнем |

ДельтаY |

Ymin |

Ymax |

|

126 |

1 |

21,6 |

1 |

25,2 |

7,9 |

23,13906 |

23,13906 |

0,254143 |

4,14894 |

18,99012 |

27,28801 |

|

127 |

2 |

25,2 |

1 |

24,3 |

8,1 |

24,87697 |

24,87697 |

0,285455 |

4,397106 |

20,47986 |

29,27407 |

|

128 |

3 |

26,0 |

1 |

23,9 |

9,5 |

27,58049 |

27,58049 |

0,185016 |

3,539998 |

24,04049 |

31,12049 |

|

129 |

4 |

36,4 |

1 |

22,6 |

10,3 |

30,84361 |

30,84361 |

0,173994 |

3,432929 |

27,41068 |

34,27654 |

|

130 |

5 |

38,5 |

1 |

21,5 |

13,1 |

36,73176 |

36,73176 |

0,125601 |

2,916717 |

33,81505 |

39,64848 |

|

131 |

6 |

43,6 |

1 |

20,4 |

15,5 |

42,03077 |

42,03077 |

0,235813 |

3,996517 |

38,03425 |

46,02728 |

|

132 |

7 |

40,1 |

1 |

19,1 |

17,0 |

46,3249 |

46,3249 |

0,27681 |

4,330011 |

41,99489 |

50,65491 |

|

133 |

8 |

47,8 |

1 |

14,7 |

17,0 |

53,38116 |

53,38116 |

0,117807 |

2,824769 |

50,55639 |

56,20592 |

|

134 |

9 |

55,5 |

1 |

14,4 |

19,6 |

57,69178 |

57,69178 |

0,111952 |

2,753684 |

54,9381 |

60,44546 |

|

135 |

10 |

59,8 |

1 |

14,0 |

20,8 |

60,10073 |

60,10073 |

0,19644 |

3,647648 |

56,45308 |

63,74838 |

|

136 |

11 |

68,0 |

1 |

12,2 |

20,7 |

62,84009 |

62,84009 |

0,100493 |

2,608954 |

60,23113 |

65,44904 |

|

137 |

12 |

69,5 |

1 |

11,8 |

21,6 |

64,80717 |

64,80717 |

0,127583 |

2,939648 |

61,86752 |

67,74681 |

|

138 |

13 |

73,4 |

1 |

8,9 |

23,4 |

72,10908 |

72,10908 |

0,164619 |

3,339163 |

68,76992 |

75,44824 |

|

139 |

14 |

72,2 |

1 |

7,3 |

23,0 |

74,08583 |

74,08583 |

0,28306 |

4,378623 |

69,70721 |

78,46446 |

|

140 |

15 |

76,6 |

1 |

5,9 |

23,9 |

77,65661 |

77,65661 |

0,361215 |

4,94631 |

72,7103 |

82,60292 |

|

141 |

Сумма |

|

|

|

|

754,2 |

754,2 |

|

|

|

|

|

142 |

|

|

|

|

|

|

|

|

|

|

|

|

143 |

t-табл= |

2,178813 |

|

|

|

|

|

|

|

|

|