- •Структура умк дистанционного обучения учебной дисциплины

- •Рабочая программа

- •1. Цели и задачи дисциплины

- •1.1. Цель преподавания дисциплины.

- •1.2. Задачи изучения дисциплины.

- •Содержание и структура дисциплины

- •2.1. Лекции, их содержание и наименование тем

- •2.2. Лабораторные занятия

- •2.3. Практические занятия

- •Содержание самостоятельной работы студентов

- •1. Предмет и основные задачи эконометрики

- •1.1. Введение в предмет эконометрика

- •1.2. Основные этапы эконометрического исследования

- •2. Особенности построения эконометрических моделей

- •2.1. Обоснование формы эконометрической модели

- •2.2. Выбор факторов эконометрической модели

- •3. Множественная линейная регрессия

- •3.1. Анализ множественной линейной регрессии с помощью

- •3.2. Теоретические предпосылки мнк

- •3.3. Оценивание коэффициентов множественной

- •3.4. Интерпретация оценок параметров и уравнения

- •4. Анализ качества уравнения регрессии

- •4.1. Характеристики и критерии качества эконометрических

- •4.2. Дисперсии и стандартные ошибки параметров линейной регрессии

- •4.3. Доверительные интервалы коэффициентов регрессии

- •4.4. Стандартная ошибка и доверительные интервалы уравнения регрессии

- •4.5. Статистическая значимость уравнения регрессии

- •5. Уравнение регрессии в стандартизованной форме

- •5.1. Стандартизованные переменные

- •5.2. Нормальная система уравнений мнк в стандартизованных

- •5.3. Параметры стандартизованной регрессии

- •6. Возможности экономического анализа на основе многофакторной модели

- •6.1. Коэффициенты стандартизованной регрессии

- •6.2. Средние и частные коэффициенты эластичности

- •6.3. Линейные коэффициенты парной, частной и

- •Варианты контрольных заданий Вариант 1

- •Вариант 2

- •Вариант 3

- •Вариант 4

- •Вариант 5

- •Вариант 6

- •Вариант 7

- •Вариант 8

- •Вариант 9

- •Вариант 10

- •Вариант 11

- •Вариант 12

- •Вариант 13

- •Вариант 14

- •Вариант 15

- •Вариант 16

- •Вариант 17

- •Вариант 18

- •Вариант 19

- •Вариант 20

- •Вариант 21

- •Вариант 22

- •Вариант 23

- •Вариант 24

- •Вариант 25

- •Вариант 26

- •Вариант 27

- •Вариант 28

- •Вариант 29

- •Вариант 30

- •Порядок выполнения типового примера.

- •Вопросы к зачету по дисциплине «эконометрика»

- •6. Нелинейная регрессия

3.2. Теоретические предпосылки мнк

1°. Математическое ожидание случайного отклонения i равно нулю для всех наблюдений:

![]()

2°. Наличие гомоскедастичности (постоянство дисперсии случайных отклонений). Дисперсия случайных отклонений i должна быть постоянной:

D(i) = D(j) = 2 для любых наблюдений с номером i и j.

3°.

Отсутствие

автокорреляции. Случайные

отклонения i

и

j

не должны зависеть друг от друга для

всех i

![]() j.

j.

4°. Случайное отклонение должно быть независимым от объясняющих переменных:

![]() .

.

5°. Модель эмпирической регрессии должна являться линейной относительно параметров. Это ограничение не распространяется на факторные переменные.

6°. Отсутствие мультиколлинеарности. Между объясняющими переменными должна отсутствовать строгая (сильная) линейная зависимость.

7°. Случайные величины ‑ошибки i, i = 1, 2, ..., п, должны иметь нормальный закон распределения (i ~ N(0, )).

Выполнимость данной предпосылки важна для проверки статистических гипотез и построения интервальных оценок.

Как и в случае парной регрессии, истинные значения параметров bj с помощью случайной выборки получить невозможно. В этом случае вместо теоретического уравнения регрессии (2.3) оценивается так называемое эмпирическое уравнение регрессии. Эмпирическое уравнение регрессии представим в виде:

![]() (2.6)

(2.6)

Здесь

![]() — оценки

теоретических значений b0,

b1,

...,bp

коэффициентов регрессии (эмпирические

коэффициенты регрессий); е

— эмпирическая

оценка

неизвестного случайного отклонения .

Для индивидуальных наблюдений имеем:

— оценки

теоретических значений b0,

b1,

...,bp

коэффициентов регрессии (эмпирические

коэффициенты регрессий); е

— эмпирическая

оценка

неизвестного случайного отклонения .

Для индивидуальных наблюдений имеем:

![]() (2.7)

(2.7)

Оцененное уравнение в первую очередь должно описывать общую закономерную тенденцию изменения зависимой переменной Y. При этом необходимо иметь возможность оценить случайные отклонения измеренных значений yi от таких неслучайных расчетных значений.

По данным выборки объема п: (1, хi1, xi2, ..., xip, yi), i = 1, 2, ..., п, требуется оценить значения параметров bj вектора B , т.е. провести параметризацию выбранной модели (здесь хij, j = 0, 1, 2, ..., p значение переменной Xj в i-oм наблюдении).

При

выполнении перечисленных выше предпосылок

МНК относительно ошибок i

оценки

![]() коэффициентов

b0,

b1,

..., bp

множественной

линейной регрессии с помощью МНК являются

несмещенными, эффективными и состоятельными

(т.е. BLUE-оценками).

коэффициентов

b0,

b1,

..., bp

множественной

линейной регрессии с помощью МНК являются

несмещенными, эффективными и состоятельными

(т.е. BLUE-оценками).

На

основании (5.7) отклонение ei

значения

зависимой переменной Y

от

модельного значения

![]() ,

соответствующего

уравнению регрессии в i-oм

наблюдении (i

= 1, 2, ..., n),

рассчитывается по формуле:

,

соответствующего

уравнению регрессии в i-oм

наблюдении (i

= 1, 2, ..., n),

рассчитывается по формуле:

![]() (2.8)

(2.8)

Наиболее

распространенным методом оценки

параметров уравнения множественной

линейной регрессии является метод

наименьших квадратов (МНК).

Его суть состоит в минимизации суммы

квадратов отклонений наблюдаемых

значений зависимой переменной Y

от

ее расчетных значений

![]() ,

получаемых

с помощью модельного уравнения регрессии:

,

получаемых

с помощью модельного уравнения регрессии:

![]()

По МНК для нахождения оценок минимизируется следующая функция, квадратичная относительно коэффициентов регрессии b0, b1, ..., bp:

. (2.9)

. (2.9)

Данная функция является квадратичной относительно неизвестных величин bj, j = 0, 1, ..., p. Она ограничена снизу, следовательно, имеет минимум. Необходимым условием минимума функции S(b0, b1, ..., bp) является равенство нулю всех ее частных производных по bj. Частные производные квадратичной функции (2.9) являются линейными функциям относительно искомых оценок коэффициентов регрессии:

,

,

, (2.10)

, (2.10)

где j = 1, 2, ..., p.

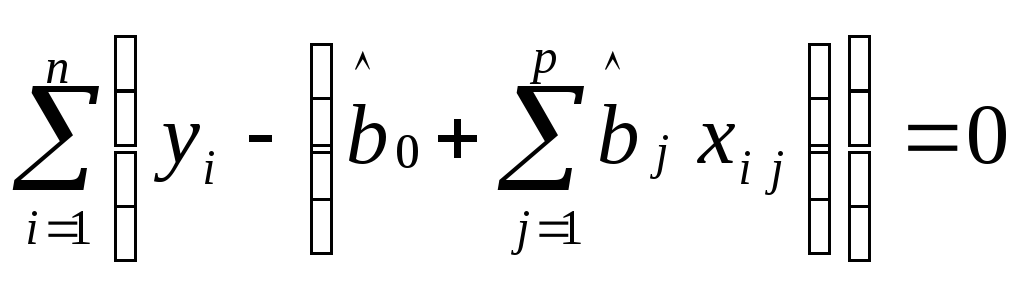

Приравнивая их к нулю, получаем нормальную систему р + 1 линейных уравнений с р + 1 неизвестными оценками коэффициентов регрессии, что является одним из достоинств метода МНК. Такая система имеет обычно единственное решение:

,

,

![]()

,

(2.11)

,

(2.11)

где j = 1, 2, ..., p.

В исключительных случаях, когда столбцы системы линейных уравнений линейно зависимы, она имеет бесконечно много решений или не имеет решения вовсе. Однако данные реальных статистических наблюдений к таким исключительным случаям практически никогда не приводят.

Система линейных уравнений относительно неизвестных оценок параметров линейной модели имеет следующий вид:

После деления всех уравнений системы на объем выборки n все суммарные величины преобразуются в соответствующие средние величины:

(2.12)

(2.12)

Из

первого уравнения можно определить

величину коэффициента регрессии

![]() :

:

![]()

Подставляя его в уравнение (2.8), получим следующую форму записи эмпирического линейного уравнения множественной регрессии:

![]()

Нормальную систему линейных уравнений МНК (2.11) наиболее наглядно можно представить с помощью векторно-матричной формы записи.