- •Экзаменационный билет №1

- •1. Статистические свойства квадратурных компонент случайного узкополосного гауссова сигнала, его огибающей и фазы.

- •Экзаменационный билет №2

- •1. Модели и классификация каналов телекоммуникаций. Каналы связи с помехами. Понятие переходной вероятности канала. Вероятностные характеристики дискретного симметричного канала без памяти.

- •Экзаменационный билет №3

- •1. Оптимальный прием сигналов на фоне помех. Критерий идеального наблюдателя. Структурная схема идеального приемника Котельникова.

- •Экзаменационный билет №4

- •1. Вероятностные характеристики случайных сигналов. Физический смысл дисперсии и акф эргодического сигнала.

- •Экзаменационный билет №6

- •1. Плотность распределения вероятности мгновенных значений случайного сигнала: возможные графики одномерной прв, двумерная, многомерная.

- •2. Согласованный фильтр. Импульсная характеристика согласованного фильтра и ее связь с временной формой согласованного с ней сигнала. Описание и форма сигнала на выходе согласованного фильтра.

- •Экзаменационный билет №7

- •Математическая модель узкополосного случайного сигнала в виде комплексного колебания.

- •Экзаменационный билет №8

- •1. Корреляционная функция случайного процесса. Определение и основные свойства, формулы расчета для дискретных сигналов, для эргодических непрерывных сигналов.

- •Экзаменационный билет №9

- •1. Определение количества информации по Шеннону. Энтропия источника случайных сообщений. Свойства энтропии. Энтропия двоичного источника.

- •2. Корреляционная функция стационарного эргодического случайного сигнала. Формула расчета и физический смысл интервала корреляции.

- •Экзаменационный билет №10

- •Понятие спектральной плотности мощности случайного сигнала.

- •Теорема Винера-Хинчина.

- •Принцип помехоустойчивого кодирования канала.

- •Экзаменационный билет №11

- •1. Количественное измерение информации. Энтропия дискретного источника и ее свойства. Энтропия двоичного источника.

- •2. Дисперсия случайного сигнала. Определение, формулы расчета для дискретных и непрерывных сигналов, физический смысл дисперсии, единицы измерения.

- •Алгоритм работы и структурная схема когерентного корреляционного приемника бинарных сигналов:

- •Экзаменационный билет №13

- •1. Понятие случайного сигнала «белый шум». Спектральная плотность мощности и корреляционная функция «белого» и небелого шума. Понятие квазибелого шума.

- •2. Структура сверточного кодера, как цифрового фильтра. Диаграмма состояний сверточного кодера, как конечного автомата. Импульсная характеристика сверточного кодера и порядок ее расчета.

- •Экзаменационный билет №14

- •Плотность распределения вероятности мгновенных значений узкополосного случайного сигнала.

- •Экзаменационный билет №15

- •Экзаменационный билет №16

- •Автокорреляционная функция (акф) – второй смешанный центральный момент двумерной плотности распределения вероятностей; центральный смешанный момент второго порядка.

- •Экзаменационный билет №18

- •1. Синтез оптимального приемника на согласованных фильтрах. Алгоритм работы и структура оптимального приемника на согласованных фильтрах для бинарных сигналов.

- •2. Эффективное кодирование источника. Словарное кодирование. Алгоритм Лемпеля-Зива. Порядок составления словаря и порядок формирования кодовых символов для передачи по каналу.

- •Экзаменационный билет №20

- •1. Формирователь модулирующих символов (фмс) для сигналов кам16. Сигнальное созвездие кам-16. Понятие о коде Грея.

- •Условная энтропия между входом и выходом в канале и взаимная информация входа и выхода

- •Экзаменационный билет №21Классификация случайных сигналов по виду закона распределения. Нормальный закон: формула одномерной прВинтеграл вероятности

- •Экзаменационный билет №22

- •2. Модели непрерывных каналов с аддитивным шумом: с постоянными параметрами, с неопределенной фазой, с общими и частотно-селективными замираниями.

- •Экзаменационный билет №23

- •1. Блочный код Хэмминга (7,4). Структура проверочной матрицы для систематического кода. Принцип кодирования с использованием проверочной матрицы.

- •Экзаменационный билет №24

- •1. Блочный код Хэмминга (7,4). Проверочная матрица систематического кода и получение синдрома кодового слова. Принцип синдромного декодирования систематического блокового кода.

- •2. Модели дискретных каналов. Математическое описание несимметричного канала без памяти и канала с памятью. Принцип относительной фазовой модуляции. Исключение обратной работы демодулятора.

- •Экзаменационный билет №25

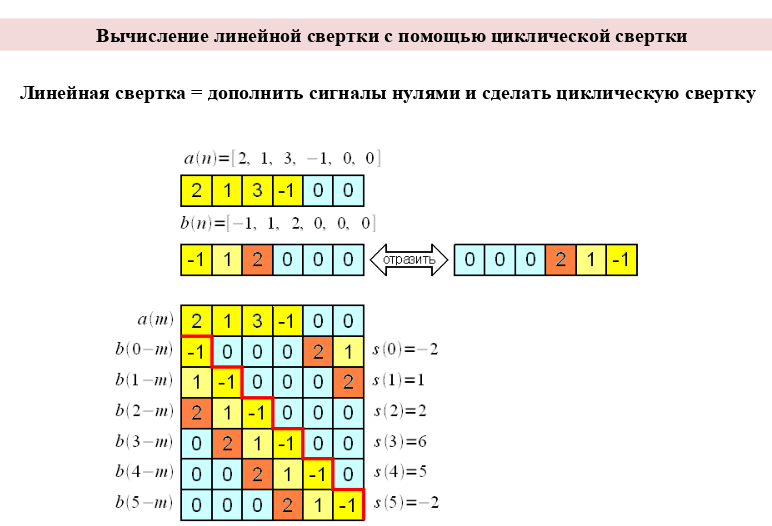

- •1. Импульсная характеристика линейной системы. Свертка сигнала и импульсной характеристики. Формулы свертки для непрерывных и дискретных сигналов. Порядок выполнения дискретной циклической свертки.

- •Экзаменационный билет №26

- •1. Особенности преобразования сигналов в параметрических цепях и системах. Параметрическое преобразование частоты. Принцип работы супергетеродинного приемного устройства. Понятие зеркальной частоты.

- •2. Статистические свойства квадратурных компонент случайного узкополосного сигнала. Статистические свойства огибающей и фазы узкополосного случайного сигнала.

- •Экзаменационный билет №27

- •1. Усреднение по ансамблю реализаций, усреднение по времени: формулы расчета для дискретных и непрерывных случайных сигналов. Эргодические случайные сигналы.

- •1. Критерий минимального среднего риска.

- •2. Критерий максимального правдоподобия (критерий мп).

- •3. Критерий идеального наблюдателя.

- •4. Критерий Неймана-Пирсона.

- •Экзаменационный билет №28

- •Возможные доп. Вопросы:

- •22 Билет) а нахуя нам каноническая матрица

Экзаменационный билет №28

1. Отношение правдоподобия для дискретных сообщений. Отношение правдоподобия двух гипотез при гауссовой помехе в канале связи. Почему дискретные отсчеты при гауссовой помехе можно считать независимыми. Правило максимума апостериорной вероятности.

Условную

плотность вероятности

![]() ,

рассматриваемую при известном после

приема векторе

,

рассматриваемую при известном после

приема векторе![]() как

функцию аргумента bi,

называют функцией

правдоподобия

гипотезы о передаче сообщения bi,

а

как

функцию аргумента bi,

называют функцией

правдоподобия

гипотезы о передаче сообщения bi,

а

-отношением

правдоподобия

двух гипотез о передаче сообщений bi

и bj.

-отношением

правдоподобия

двух гипотез о передаче сообщений bi

и bj.

В статистике метод оценки с помощью апостериорного максимума (MAP) тесно связан с методом максимального правдоподобия (ML), но дополнительно при оптимизации использует априорное распределение величины, которую оценивает.

Предположим,

что нам нужно оценить неконтролируемый

параметр выборки 𝜽 на базе наблюдений

x. Пусть 𝒇 — выборочное

распределение

x

такое, что 𝒇(x| 𝜽) — вероятность x в то

время как параметр выборки 𝜽. Тогда

функция

![]() ,

известна как функция

правдоподобия,

а оценка

,

известна как функция

правдоподобия,

а оценка

![]() как оценка максимального правдоподобия

𝜽.

как оценка максимального правдоподобия

𝜽.

Теперь,

предположим, что априорное распределение

g

на 𝜽 существует. Это позволяет

рассматривать 𝜽 как случайную

величину

как в Байесовской

статистике.

тогда апостериорное

распределение

𝜽

Метод оценки максимального правдоподобия затем оценивает 𝜽 как апостериорное распределение этой случайной величины:

![]()

Знаменатель апостериорного распределения не зависит от 𝜽 и поэтому не играет роли в оптимизации. Заметим, что MAP оценка 𝜽 соответствует ML оценке когда априорная g постоянна (т.е., константа).

В теории вероятностей и статистике гауссовский процесс — это стохастический процесс (совокупность случайных величин, индексированных некоторым параметром, чаще всего временем или координатами), такой что любой конечный набор этих случайных величин имеет многомерное нормальное распределение, то есть любая конечная линейная комбинация из них нормально распределена. Распределение гауссовского процесса – это совместное распределение всех его случайных величин и, в силу чего, является распределением функций с непрерывной областью определения.

2. Эффективное кодирование источника. Расчет избыточности источника. Эффективное кодирование . Код Шеннона-Фано и дерево кодирования если вероятности передаваемых символов р1=0.4; р2=0.2; р3=0.1; р4=0,08; р5=0,07; р6=0.15; р7=0.28; р8=0.12.

Эффективное кодирование источника. (без понятия перепроверьте)

Передача сигнала по предоставленному каналу связи возможна только тогда, когда размеры транспортируемого средства (сигнала) не превышают размеров транспортной среды (канала связи). Таким образом необходимым условием согласования сигнала с предоставленным каналом связи является выполнение неравенства: Vс ≤ Vк ; Vc – объем сигнала;Vк – емкость канала связи

Достаточными условиями согласования сигнала с предоставленным каналом связи является выполнение неравенств Tc ≤ Tк Fc ≤ Fк Wc ≤Wк;

где Tc – временная длительность сигнала,

Fс – эффективный спектр сигнала, определяемый эффективным спектра элементарного сигнала

Wc –логарифмическим превышением сигнала над помехой

Tк – длительность интервала времени, на который предоставлен канал связи,

Fк – эффективная полоса пропускания канала связи,

Wк – логарифмическим превышением сигнала над помехой

И наконец, условием эффективного использования предоставленного канала связи является выполнение равенства Vс =Vк . Конструктивным инструментом согласования сигнала с предоставленным каналом связи путем уменьшения объема сигнала Vс за счет уменьшения компонента Tc является использование возможностей эффективного кодирования.

Расчет избыточности источника.

Чем ближе энтропия источника к максимальной, тем рациональнее работает источник. Чтобы судить о том, насколько хорошо использует источник свой алфавит, вводят понятие избыточности источника сообщений:

,

где отношение H(x) / Hmax(x) называется

коэффициентом сжатия “μ”

,

где отношение H(x) / Hmax(x) называется

коэффициентом сжатия “μ”

Наличие избыточности приводит к загрузке канала связи передачей лишних букв сообщений, которые не несут информации ( их можно угадать и не передавая).

Эффективное кодирование

Эффективное кодирование используется в каналах без шума, т.е. в таких каналах, где помехи отсутствуют, либо ими можно пренебречь. Основной задачей кодирования в таком канале является обеспечение максимальной скорости передачи информации, близкой к пропускной способности канала передачи

Код Шеннона-Фано и дерево кодирования если вероятности передаваемых символов р1=0.4; р2=0.2; р3=0.1; р4=0,08; р5=0,07; р6=0.15; р7=0.28; р8=0.12.

Для решения задачи воспользуемся “методом оптимального кодирования Шеннона-Фано”, которое позволит минимизировать избыточность кода.

Шаг 1 Расставим вероятности передаваемых символов в порядке невозрастания (тупо убывания вот он ах...)

р1=0.4 ; р7=0.28 ; р2=0.2 ; р6=0.15 ; р8=0.12 ; р3=0.1 ; р4=0,08 ; р5=0,07;

Шаг 2 Разделим последовательность на две группы т.о. Чтобы сумма вероятностей в обеих группах была +- равной

р1=0.4; р7=0.28(сум 0.68); р2=0.2; р6=0.15; р8=0.12; р3=0.1; р4=0,08; р5=0,07(сум 0.72).

Шаг 3 Первой группе в префиксном коде присваивается двоичная цифра «0», второй части — «1». Поскольку во второй группе больше двух элементов разобьем её еще раз:

р2=0.2; р6=0.15(в сумме 0.35); р8=0.12; р3=0.1; р4=0,08; р5=0,07(в сумме 0.37).

р8=0.12; р3=0.1(в сумме 0.22); р4=0,08; р5=0,07(в сумме 0.15).

Шаг 4 Строим дерево

На всякий выпишу полученный код для символов:

Экзаменационный билет №29

1. Комплексная частотная характеристика линейной системы.Физический смысл АЧХ и ФЧХ. Формула расчета выходного сигнала линейной системы с использованием частотной характеристики при воздействии на входе детерминированного сигнала.

Комплексная частотная характеристика линейной системы - эти характеристики устанавливают связь выходного сигнала системы с входным.

Частотные характеристики. Бывают АЧХ и ФЧХ. Поскольку при подаче на вход линейной системы синусоидального сигнала на выходе также появляется синусоидальный сигнал той же частоты, частотные характеристики связывают амплитуды и фазы этих сигналов. АЧХ – отношение амплитуды выходного сигнала к амплитуде входного сигнала в зависимости от частоты. ФЧХ – сдвиг фаз между входным и выходным сигналами в зависимости от частоты

Физический смысл АЧХ и ФЧХ.

Амплитудно-частотную характеристику (АЧХ) определяют как отношение амплитуд выходных колебаний и входного сигнала M(w) = B/A. Фазочастотную характеристику (ФЧХ) определяют как разность фаз выходных и входных колебаний j(w) = jВ – jА или j(w)=2p×Dt(w)/T, где Dt(w) – время сдвига. Амплитудно-фазовая характеристика (АФХ) определяют как функцию, для которой АЧХ является модулем, а ФЧХ – аргументом.

Формула расчета выходного сигнала линейной системы с использованием частотной характеристики при воздействии на входе детерминированного сигнала.

Пусть на входе

некоторой линейной стационарной системы

действует детерминированный сигнал

![]() заданный обратным

преобразованием

Фурье:

заданный обратным

преобразованием

Фурье:

Будем полагать,

что известен частотный коэффициент

передачи

![]() системы. Как было доказано, комплексный

сигнал вида

системы. Как было доказано, комплексный

сигнал вида

![]() являясь собственной функцией системного

оператора, создает на выходе элементарную

реакцию

являясь собственной функцией системного

оператора, создает на выходе элементарную

реакцию

![]() Суммируя эти реакции, находим представление

выходного сигнала:

Суммируя эти реакции, находим представление

выходного сигнала:

2. Записать формулу плотности распределения вероятности гауссового случайного сигнала если математическое ожидание равно 0.375, а дисперсия равна 0.25. Построить качественно график, указать на нем положение математического ожидания и величину среднеквадратического отклонения.

![]()

![]()

![]()

По

Y максимальное 0.9 По Y максимальное

1

По Х масимальное 1.2 По Х масимальное

1.2

По

Y максимальное 0.9 По Y максимальное

1

По Х масимальное 1.2 По Х масимальное

1.2

Экзаменационный билет №30

1. Импульсная характеристика линейной системы. Свертка сигнала и импульсной характеристики. Линейная и циклическая дискретная свертка. Алгоритм вычисления линейной свертки дискретных сигналов.

2. В программе MathCAD построить гистограмму распределения частот гауссового случайного сигнала с математическим ожиданием равным 1.56 и дисперсией равной 1.25. Количество интервалов на гистограмме взять 12, количество дискретных отсчетов сигнала (длина выборки) 3000.

Экзаменационный билет №31

1. Методы построения согласованных фильтров (на примере фильтра для видеосигнала с 7-ми значным кодом Баркера).

2. Избыточность и производительность двоичного источника. Скорость передачи информации. Пропускная способность канала передачи.

Источник с фиксированной скоростью выдачи сообщений Vu = 1/Tu [симв/с] 𝐻′(𝑋)=𝑉𝑢𝐻(𝑋)

Количество информации, которое выдается источником в течение одной секунды непрерывной работы.

Максимальное количество информации, которое можно в принципе передать по данному дискретному каналу за один входной символ называют информационной емкостью или пропускной способностью канала: 𝑪=𝒎𝒂𝒙𝒏,𝒑(𝑿){𝟏𝒏𝑰(𝑿𝒏;𝒀𝒏)}

где максимизация выполняется по всем априорным распределениям вероятностей p(X) входных n-символьных блоков и длине блока n при фиксированных входных и выходных алфавитах (X и Y соответственно).

Пропускная способность C – фундаментальный параметр канала, определяющий его потенциальные возможности в части надежной передачи информации.

Экзаменационный билет №32

1. Синтез оптимального приемника на согласованных фильтрах. Структура оптимального приемника на согласованных фильтрах.

Структура оптимального приемника на согласованных фильтрах:

2. Эффективное кодирование источника. Словарное кодирование. Алгоритм Лемпеля-Зива.

Кодирование, которое осуществляет удаление или уменьшение избыточности из закодированных сообщений, называется эффективным.

Возможность эффективного кодирования основана на теореме Шеннона, согласно которой: Минимальное среднее количество элементов на выходе кодирующего устройства, соответствующее одному символу дискретного сообщения, можно сделать сколь угодно близким к максимальной энтропии источника.

Алгоритм названный так по первым буквам фамилий авторов и году своего опубликования. Классический алгоритм предельно прост, и может быть описан следующим образом: "если в прошедшем ранее выходном потоке уже встречалась подобная последовательность байт, причем запись о ее длине и смещении от текущей позиции короче чем сама эта последовательность, то в выходной файл записывается ссылка (смещение, длина), а не сама последовательность".

Пример 1: Строка "КОЛОКОЛ_ОКОЛО_КОЛОКОЛЬНИ" с помощью алгоритма LZ77 будет закодирована строкой "КОЛО(-4,3)_(-5,4)О_(-14,7)ЬНИ".