- •4.5 Контрольні питання 87

- •5.5 Контрольні питання 97

- •6.5 Контрольні питання 127

- •2Основні поняття теорії інформації

- •2.1Загальні положення

- •2.2Кругообертання інформації

- •2.3Класифікація інформації

- •2.4Структурні перетворення інформації

- •2.5Фази усунення надлишковості інформації

- •2.6Контрольні питання

- •3Інформаційна метрика

- •3.1Якісні і кількісні оцінки інформації

- •3.2Структурні міри інформації

- •3.2.1Загальна характеристика структурної метрики

- •3.2.2Геометрична міра інформації

- •3.2.3Комбінаторна міра інформації

- •3.2.4Адитивна міра (міра Хартлі)

- •3.2.5Специфіка структурної оцінки кількості інформації

- •3.2.6Інформаційна ємність

- •3.3Статистичні міри інформації

- •3.3.1Відповідність між ймовірністю і інформацією

- •3.3.2Ентропія як міра невизначеності

- •3.3.3Ентропія ансамблю (безумовна ентропія)

- •3.3.4Ентропія об’єднання, умовна ентропія

- •Ентропія безперервного джерела інформації (диференціальна ентропія)

- •3.3.5Кількість інформації як міра зняття невизначеності

- •3.4Кількість інформації і її надлишковість

- •3.5Оцінка якості виміру н контролю

- •3.6Семантичні міри інформації

- •3.6.1Поняття семиотика

- •3.6.2Змістовність інформації

- •3.6.3Доцільність інформації

- •3.6.4Динамічна ентропія

- •3.6.5Істотність інформації

- •3.7Контрольні питання

- •4Характеристики дискретних джерел інформації

- •4.1Продуктивність дискретного джерела та швидкість передачі інформації

- •4.2Інформаційні втрати при передачі інформації по дискретному каналу

- •4.3Пропускна здатність дискретного каналу

- •4.4Теорема Шеннона

- •4.5Контрольні питання

- •5Характеристики неперервних джерел інформації

- •5.1Квантування сигналів

- •5.2Інформаційні втрати при дискретизації неперервних джерел

- •5.3Продуктивність неперервного джерела та швидкість передачі інформації

- •5.4Пропускна здатність неперервного каналу

- •5.5Контрольні питання

- •6Кодування інформації

- •6.1Загальні поняття і визначення

- •6.2Кодування як процес представлення інформації в цифровому вигляді

- •6.3Ефективне кодування

- •6.4Кодування інформації для каналу з завадами

- •6.4.1Загальні поняття теорії завадостійкого кодування

- •6.4.2Різновиди завадостійких код

- •6.4.3Загальні принципи використання надлишковості

- •6.4.4Кодова відстань

- •6.5Контрольні питання

- •Перелік використаних джерел

3.2.4Адитивна міра (міра Хартлі)

У теорії інформації важливу роль грає комбінаторика чисел і кодів.

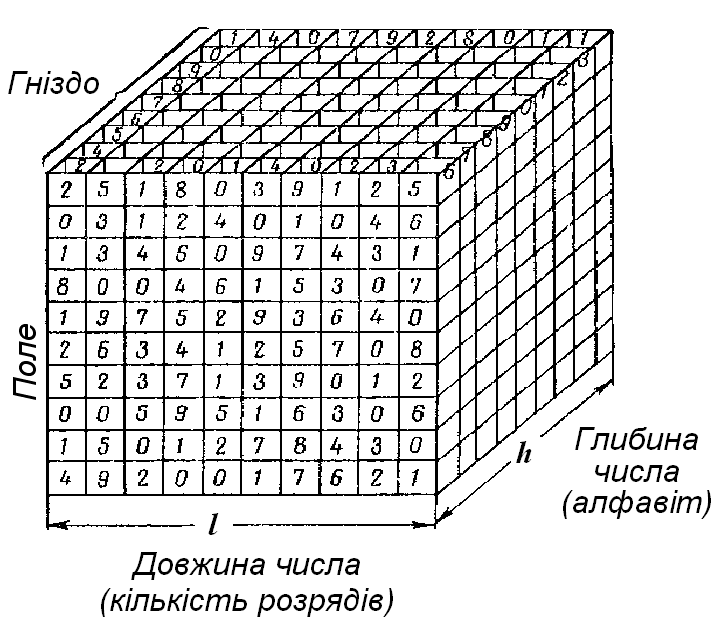

Введемо поняття глибини h і довжини l числа (рис. 2.1).

Глибиною числа h називається кількість різних елементів (знаків), що міститься в прийнятому алфавіті. Глибина числа відповідає основі системи числення і кодування. Один повний алфавіт займає одне числове гніздо, глибина якого також дорівнює h.

У кожен момент реалізується тільки один який-небудь знак з h можливих. На геометричній моделі (рис. 2.1) реалізація знаку набуває форми виставляння назовні потрібного знаку з глибини гнізда, що зберігає в певному порядку весь запас знаків. Технічно це може бути виконано, наприклад, шляхом зсуву знаків вперед або назад до появи потрібного.

Довжиною числа l називається кількість числових гнізд, тобто кількість повторень алфавіту, необхідних і достатніх для представлення чисел потрібної величини. Довжина числа відповідає розрядності системи числення і кодування. Один набір з l гнізд-алфавітів складає одну числову гряду, здатну представляти і зберігати одне повне число завдовжки l.

Деяка кількість чисел N представляється числовим полем.

Рисунок 2.1 –

Геометрична модель інформаційного

масиву у вигляді сукупності десяти

розрядних десяткових чисел

![]()

При глибині h і довжині l кількість чисел, яку можна представити за допомогою числової гряди, визначається формулою:

![]() , (2.6)

, (2.6)

тобто ємкість гряди експоненціально залежить від довжини числа l, що випливає з (2.3).

Прикладами технічних реалізацій вказаних систем можуть бути:

– роликовий лічильник з l роликами і h цифрами на обідку кожного ролика;

– комбінований комутатор з l перемикачами, з яких кожен перемикає h ланцюгів;

–запам'ятовуючий пристрій, з l комірками, кожна ємкістю h одиниць;

– зображення, що складається з l дискретних елементів, причому кожен елемент зображення характеризується h градаціями кольору і тону;

– сторінка

друкарського літературного тексту, в

якому міститься

![]() рядків і в середньому

рядків і в середньому

![]() букв в кожному рядку, тобто всього

букв в кожному рядку, тобто всього

![]() числових або буквених гнізд; кожне

гніздо має глибину h,

тобто здатне виставити одну з h

букв алфавіту.

числових або буквених гнізд; кожне

гніздо має глибину h,

тобто здатне виставити одну з h

букв алфавіту.

У наслідок показового закону залежності Q від l число Q не є зручною мірою для оцінки інформаційної ємкості. Тому Хартлі ввів адитивну двійкову логарифмічну міру, що дозволяє обчислювати кількість інформації в двійкових одиницях – бітах, (скорочено біт).

Для цього береться не само число Q, а його двійковий логарифм:

![]() .

(2.7)

.

(2.7)

Тут

![]() позначає кількість інформації за мірою

Хартлі.

позначає кількість інформації за мірою

Хартлі.

Якщо кількість розрядів (довжина l числа) дорівнює одиниці, і прийнята двійкова система числення (глибина h числа рівна двом) то потенційна кількість інформації дорівнює одному біту:

![]() .

.

Це і є одиниця інформації в прийнятій системі оцінки. Вона відповідає одній елементарній події, яка може відбутися або не відбутися.

Адитивна міра зручна тим, що вона забезпечує можливість додавання і пропорційність кількості інформації до довжини числа l, тобто кількості числових гнізд. Тому введена кількість інформації еквівалентна кількості двійкових знаків — нулів і одиниць — при кодуванні повідомлень по двійковій системі числення. Одному біту відповідає одна двійкова одиниця.

Приклад 2.9.

Визначається потенційна кількість інформації, що міститься в системі, інформаційна ємкість якої характеризується десятковим числом:

![]() .

.

Закодуємо це число по двійковій системі h = 2 і знайдемо його довжину l:

![]() .

.

Тоді

![]() .

.

Це означає, що по двійковій системі дане число запишеться (закодується): 10000000000.

Для

![]() кількість інформації

за Хартлі І

лежить в межах

кількість інформації

за Хартлі І

лежить в межах

![]() .

Звідси випливає,що кількість знаків

необхідно брати рівне І,

якщо І

ціле число , або доповняти до найбільшого

цілого числа, якщо І

– дробове число.

.

Звідси випливає,що кількість знаків

необхідно брати рівне І,

якщо І

ціле число , або доповняти до найбільшого

цілого числа, якщо І

– дробове число.

За

наявності декількох –

![]() джерел інформації спільна кількість

інформації, яку можна отримати від всіх

разом узятих джерел, дорівнює

джерел інформації спільна кількість

інформації, яку можна отримати від всіх

разом узятих джерел, дорівнює

![]() .

(2.8)

.

(2.8)