- •Моделирование систем управления

- •Два аспекта понятия моделирования. Понятие об идентификации.

- •Причины необходимости создания новых моделей

- •Характеристики объектов и процессов, которые надо учитывать при создании моделей

- •Приемы упрощения моделей

- •Этапы построения моделей

- •Определение цели получения модели

- •Определение ограничений и условий, учитываемых при построении моделей

- •Выбор подхода к решению задачи получения модели

- •Определение класса модели. Выбор метода решения задачи и ее решение

- •Общие принципы построения аналитических моделей

- •Модель поплавкового уровнемера

- •Модель процесса теплопередачи

- •Модель смесителя.

- •Модель реактора

- •Модель емкости с изменяющимся уровнем

- •Метод наименьших квадратов в одномерном случае

- •Метод наименьших квадратов в многомерном случае

- •Рекуррентный метод наименьших квадратов

- •Взвешенный мнк и другие разновидности мнк

- •Получение модели по частотным характеристикам

- •Идентификация систем по переходной характеристике

- •Идентификация звена 1-го порядка по переходной функции

- •Идентификация звена 1-го порядка с запаздыванием по переходной функции

- •Идентификация параметров колебательного звена 2-го порядка

- •Определение параметров апериодического звена 2-го порядка

- •4.1. Метод отрезков Ta и Tb

- •4.2. Метод отрезков Tb и Tc

- •Идентификация по апериодической переходной функции с точкой перегиба звена первого порядка с запаздыванием

- •Метод кратных корней

- •Метод площадей

- •Основное уравнение идентификации

- •Решение основного уравнения идентификации

Рекуррентный метод наименьших квадратов

Пусть по N наблюдениям вычислен вектор коэффициентов

BN= (XTX)-1XTY=PNXTY

где PN= (XTX)-1, и пусть в момент tN+1получена еще одна серия отсчетов

yN+1, xN+1,1, xN+1,2, ..., xN+1,k.

Необходимо найти способ откорректировать вектор BNпо информации, полученной на (N+1)-ом шаге, т.е. найти способ вычисления по формуле

BN+1=BN+ f(yN+1, xN+1,j), j = 1, 2, ..., k.

В этом состоит рекуррентный МНК. Для коррекции вектора BNне требуется ни обращения матриц, ни повторного формирования и решения нормальных уравнений. Метод может использоваться как при оперативной, так и при ретроспективной идентификации.

Пусть

Сформируем клеточные (или блочные) матрицы

![]()

Тогда

![]()

Воспользуемся далее формулой из леммы об обращении матриц (см. Современные методы идентификации систем. Под ред. П. Эйкхоффа. М.: Мир, 1983, стр. 391).

Лемма. Если необходимые обратные матрицы существуют, тогда

(A + BCD)1 = A1 A1B(C1 + DA1B) 1DA1

Доказательство.

Если лемма справедлива, то по определению обратных матриц произведение исходной матрицы A+BCDна ее обратную должно дать единичную матрицуI:

(A + BCD)[ A1 A1B(C1 + DA1B) 1DA1] = AA1 + BCDA1

AA1B(C1 + DA1B) 1DA1 BCDA1B(C1 + DA1B) 1DA1 = I +

+ BCDA1 B(C1 + DA1B) 1DA1 BCDA1B(C1 + DA1B) 1DA1 =

= I+ BCDA1 BC[C1(C1 + DA1B) 1 + DA1B(C1 + DA1B) 1]DA1 =

= I + BCDA1 BC[(C1 + DA1B)(C1 + DA1B) 1]DA1 =

= I + BCDA1 BCDA1 = I, ч.т.д.

Пусть теперь C= 1,B=b– матрица-столбец,D=bT, тогда можно записать

![]()

Применяя последнее выражение, когда A=XTX;b=x, получим:

Отсюда:

Отсюда:

![]()

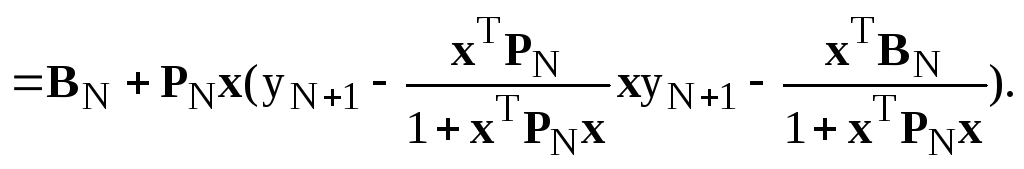

Т.о. для вычисления BN+1необходимо знатьBN;PNи новую информацию yN+1;x. Вычисления состоят только в умножении и сложении матриц, т.е. отсутствуют операции обращения или решения системы уравнений.

Обратим внимание на то, что произведение

![]()

равно значению выходного сигнала, предсказываемое моделью (построенной за N шагов) по вектору новых значений x. Если это предсказываемое значение равно измеренному значению выхода, т.е. если

xTBN= yN+1,

то BN+1=BNи никакого пересчета вектораBNне требуется.

Для применения формулы пересчета вектора BN+1на следующем (N+2)-ом шаге потребуется, очевидно, матрицаPN+1. Эту матрицу можно получить коррекцией матрицыPN.

Так как BN=PNXTY, то выражение

BN+1= (XTX+xxT)-1(XTY +xyN+1)

можно записать как

BN+1=PN+1(XTY+xyN+1),

где

Последнее выражение, полученное с помощью леммы об обращении матриц, позволяет получить откорректированную матрицу PN.

Взвешенный мнк и другие разновидности мнк

Взвешенный МНК применяется, когда различным ошибкам iпридается различный вес или за счет старения результатов измерения от t1к tNили за счет неодинаковой точности измерений.

Метод состоит в использовании критерия вида:

![]()

где  диагональная

матрица весов.

диагональная

матрица весов.

![]()

Возможные принципы назначения весов:

Первым измерениям (наблюдениям) назначаются меньшие веса, последним большие (учет старения информации) при условии 0 qi1.

Веса назначаются как величины пропорциональные обратной величине погрешности измерений:

![]() или

или![]()

где iинструментальная погрешность;iсреднеквадратичная погрешность измерений; kкоэффициент пропорциональности.

Существуют и другие разновидности МНК

Если в модели со многими входами

![]() (*)

(*)

вместо xj(ti) взять сигнал одного (например, первого) входа в разных степенях, то можно построить методом МНК одномерную нелинейную модель

![]()

Подставляя в модель (*) вместо xj(ti) различные комбинации

x1(ti)p x2(ti)q ... xj(ti)r ...,

можно строить МНК многомерные нелинейные модели.

В модели (*) вместо xj(ti) можно использовать различные функции от входных отсчетов xj(ti). Очень часто в этом случае используются системы ортогональных функций.