- •2. Классификация измерений и погрешностей измерений.

- •3. Формы представления погрешностей. Свойства случайных погрешностей.

- •4. Основные понятия теории вероятностей. Геометрическая вероятность.

- •5. Основные формулы комбинаторики. Примеры использования

- •6. Теорема сложения вероятностей и ее следствия

- •8.Формула полной вероятности. Формула Бейеса

- •9. Формула Бернулли. Примеры использования.

- •10.Дискретные и непрерывные случайные величины и их характеристики.

- •12. Свойства плотности и функции распределения вероятностей

- •13.Начальные и центральные моменты для дискретных и непрерывных случайных величин.

- •15. Закон больших чисел и центральная предельная теорема

- •17 Точечные и интервальные оценки.

- •18.Понятие доброкачественной оценки

- •19. Методы получения доброкачественных оценок. Метод максимального правдоподобия.

- •20. Равномерный закон распределения случайных величин

- •21. Биномиальный закон распределения

- •22. Локальная и интегральная теоремы Лапласа

- •23. Нормальный закон распределения случайных величин. M(X), d(X), σ.

- •24. Показательное (экспоненциальное) распределение. M(X), d(X), σ

- •26.Распределение Стьюдента

- •27. Распределение хи-квадрат. M(X), d(X), σ

- •28. Гамма распределение

- •29. Мешающие параметры, необходимость их выявления. Критерии Аббе и Граббса

- •30. Приближённые методы исследования ряда случайных величин на соответствие закону распределения.

- •31.Характеристики формы, их вычисление и суть

- •32. Графический критерий исследования ряда погрешностей на соответствие нормальному закону распределения

- •33. . Точные критерии исследования ряда случайных величин. Критерии Пирсона и Колмогорова.

- •34.Основные методы наименьших квадратов. Способы составления систем нормальных уравнений. Метод наименьших квадратов

- •35.Линейная и квадратичная аппроксимация. Построение линий тренда.

- •37.Полиномиальные преобразования при помощи функции нескольких переменных

- •38 . Оценка точности в методе наименьших квадратов.

- •39. Понятие веса. Классическая обработка неравноточных измерений

- •40.Классическая обработка равноточных измерений. Задача эталонирования

- •41.Выявление мешающих параметров непараметрическими методами. Критерий Хэмпэла

- •44.Адаптивная оценка Хогга. Два способа вычисления индикатора k

- •45.Выявление эффектов гетероскедастичности

- •46. Методы выявления систематического влияния. Критерии серий.

- •47. Методы выявления эффектов автокорреляции. Критерий Дарбина-Уотсона.

- •48. Второй центральный смешанный момент (ковариация).

- •49. Парные, частные и множественные коэффициенты корреляции

- •50. Выявление значимости связей.

- •51. Коэффициент достоверности аппроксимации. Оценка надёжности по критерию Фишера.

- •52. Понятие экстраполяции (прогнозирование результатов измерений)

- •53. Фундаментальная теорема переноса ошибок имеет вид:

- •54. Оценка точности функций зависимых результатов измерений.

48. Второй центральный смешанный момент (ковариация).

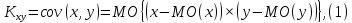

Основной величиной для получения характеристики тес ноты связи между векторами х и у является второй смешанный центральный момент Кxy, или ковариация cov(x, y)

или его вычисленный выборочный вариант

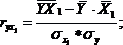

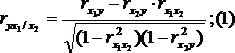

Здесь vx и vy – центрированные величины. Ковариация в качестве меры тесноты связи не удобна, так как изменяется от – до + и имеет разные масштабы векторов, равные их оценкам стандартного отклонения. Если привести масштабы векторов к одинаковым единичным значениям мы получим весьма удобную характеристику тесноты связи, названную парным коэффциентом корреляции rxy

Здесь

и

и – оценки стандартного отклонения для

векторов х и у. Коэффициент изменяется

в пределах от – 1 до + 1. При описании

процесса более чем двумя векторами

измерений, парные коэффициенты находятся

между всеми возможными парами векторов.

– оценки стандартного отклонения для

векторов х и у. Коэффициент изменяется

в пределах от – 1 до + 1. При описании

процесса более чем двумя векторами

измерений, парные коэффициенты находятся

между всеми возможными парами векторов.

49. Парные, частные и множественные коэффициенты корреляции

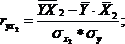

Парные коэффициенты корреляции. Для измерения тесноты связи между двумя из рассматриваемых переменных (без учета их взаимодействия с другими переменными) применяются парные коэффициенты корреляции. Методика расчета таких коэффициентов и их интерпретации аналогичны линейному коэффициенту корреляции в случае однофакторной связи.

где ![]() -

среднее квадратическое отклонение

факторного признака;

-

среднее квадратическое отклонение

факторного признака;

![]() -

среднее квадратическое отклонение

результативного признака.

-

среднее квадратическое отклонение

результативного признака.

Коэффициент частной корреляции измеряет тесноту линейной связи между отдельным фактором и результатом при устранении воздействия прочих факторов модели.

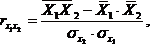

Для расчета частных коэффициентов корреляции могут быть использованы парные коэффициенты корреляции.

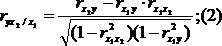

Для случая зависимости Y от двух факторов можно вычислить 2 коэффициента частной корреляции:

(2-ой

фактор ![]() фиксирован);

фиксирован);

(1-ый

фактор ![]() фиксирован).

фиксирован).

Это коэффициенты частной корреляции 1-ого порядка (порядок определяется числом факторов, влияние которых на результат устраняется).

Частные

коэффициенты корреляции, рассчитанные

по таким формулам изменяются от -1 до

+1. Они используются не только для

ранжирования факторов модели по степени

влияния на результат, но и также для

отсева факторов. При малых значениях ![]() нет

смысла вводить в уравнение m-ый

фактор, т.к. качество уравнения регрессии

при его введении возрастет незначительно

(т.е. теоретический коэффициент

детерминации увеличится незначительно).

нет

смысла вводить в уравнение m-ый

фактор, т.к. качество уравнения регрессии

при его введении возрастет незначительно

(т.е. теоретический коэффициент

детерминации увеличится незначительно).

Коэффициент множественной корреляции (R) характеризует тесноту связи между результативным показателем и набором факторных показателей:

где σ2 — общая дисперсия эмпирического ряда, характеризующая общую вариацию результативного показателя (у) за счет факторов;

σост2 — остаточная дисперсия в ряду у, отражающая влияния всех факторов, кроме х;

у — среднее значение результативного показателя, вычисленное по исходным наблюдениям;

s — среднее значение результативного показателя, вычисленное по уравнению регрессии.

Коэффициент множественной корреляции принимает только положительные значения в пределах от 0 до 1. Чем ближе значение коэффициента к 1, тем больше теснота связи.