- •Часть 1

- •Лекция 1

- •Виды статистического контроля

- •Виды выборок

- •Контрольный листок

- •Лекция 2

- •Графические методы представления статистического ряда

- •Численные методы представления статистического ряда

- •Лекция 3

- •Основные законы распределения случайной величины

- •Лекция 4

- •Лекция 5

- •Расслаивание статистических данных

- •Лекция 6

- •Лекция 7

- •14. Диаграмма Парето

- •Лекция 8

- •15. Причинно-следственная диаграмма

- •Лекция 9

- •Типы контрольных карт

- •Лекция 10

- •Чтение контрольных карт

- •Библиографический список

- •Оглавление

- •Часть 1

- •394026 Воронеж, Московский просп., 14

Основные законы распределения случайной величины

В общем случае для определения вероятности того, чтослучайная величинаX примет некоторое заранее заданное значение (или окажется меньше его), необходимо знать закон распределения случайной величины. Ввиду того что случайные величины могут быть как дискретными, так и непрерывными, распределения их вероятностей будут описываться соответст- венно законами распределения дискретных и непрерывных случайных величин [1].

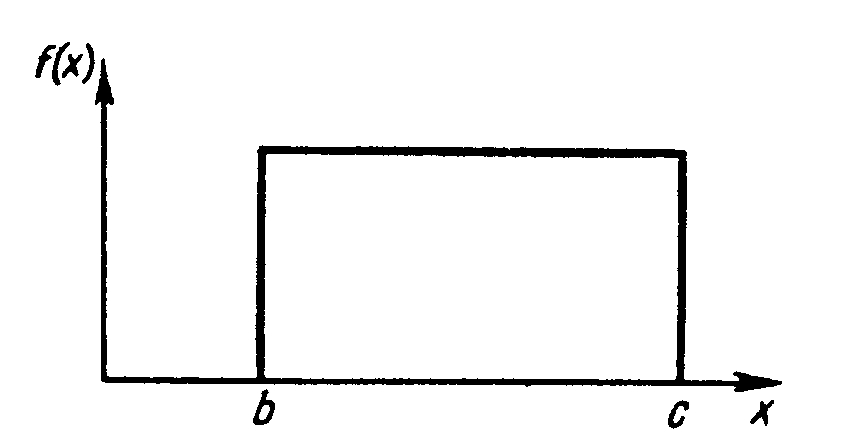

Рис. 9.1. Равновероятное (прямоугольное) распределение

Законы распределения для дискретных случайных величин, применяемые при контроле выпускаемой продукции, подробно рассмотрены в [2], поэтому в данном разделе рассмотрим законы распределения для непрерывных случайных величин, причем только те, которые необходимы для понимания последующего материала.

Равновероятный закон. Простейшим распределением для непрерывной случайной величины Х является равновероятный (равномерный, прямоугольный) закон распределения (рис. 9.1).

Случайная величина X распределена по равновероятному закону, если плотность вероятности

0 при x b

f (x) 1/(с b) приb x c

(9.1)

при x c

0

Плотность вероятности f(x) иногда называют дифференциальной функцией распределения. Ее физический смысл рассмотрим несколько позже. Нетрудно убедиться в том, что площадь под кривой распределения равна единице. Действительно,

c 1

f (x)dx c b dx 1

b

(9.2)

Кроме плотности вероятности для непрерывных распределений используется также интегральная функция распределенияF(x), которая в общем виде выглядит следующим образом:

X

F (x)

f (x)dx

(9.3)

Для равновероятного закона распределения интегральная функция

(9.4)

(9.4)

Физический смысл интегральной функции распределения состоит в том, что она представляет собой вероятность попадания случайной величиных в интервал от -∞ доX, гдеX — определенное, наперед заданное число.

Гауссовский закон распределения. На практике часто приходится иметь дело с распределениями, которые незначительно отличаются от гауссовского. Широкое распространение гауссовского закона распределения находит теоретическое объяснение вцентральной предельной теореме, смысл которой заключается в следующем. Предположим, что параметр качества Y исследуемого объекта зависит отк действующих на него независимых между собой (или слабо зависимых) факторов Х1, Х2, Х3, ..., Хк,образующих в каждый момент времени совокупность случайных независимых (или слабо зависимых) случайных величин х1, х2, х3, ...,хк, одновременно воздействующих на качество изделия. Если число этих независимых случайных величин велико (приближаясь в пределе к бесконечности) и среди них отсутствуют случайные величины с резко отличающимися от других случайных величин средними

квадратичными отклонениями (или, как говорят в этом случае, отсутствуют превалирующие факторы),то в соответствии с центральной предельной теоремой распределение значений параметра качества будет стремиться к гауссовскому закону. При этом каждая из воздействующих на качество объекта случайных величин может подчиняться каким угодно законам распределения. Существуют три условия центральной предельной теоремы: случайные величины должны быть независимыми (или слабо зависимыми), их число должно стремиться к бесконечности, среди случайных величин должны отсутствовать превалирующие.

Можно утверждать, что если технологический процесс такого сложного производства, как выпуск современных ЭС, отлажен и контролируем, то распределение значений параметра качества на каждой технологической операции будетблизко к гауссовскому. Это можно проверить, набрав достаточную статистику. Особенно часто встречается гауссовский закон при измерениях. Такие случайные величины, как ошибки измерений,могут быть представлены как сумма большого числа сравнительно малых слагаемых — элементарных ошибок, каждая из которых вызвана действием отдельной величины, не зависящей от остальных. Каким бы законам распределения ни были подчинены отдельные элементарные ошибки, особенности этих распределений в сумме большого числа слагаемых нивелируются и сумма оказывается подчиненной закону, близкому к гауссовскому. Основное ограничение, налагаемое на суммируемые ошибки, состоит в том, чтобы все они в общей сумме равномерно играли относительно малую роль, т. е. должно выполняться третье условие центральной предельной теоремы. Если этоусловие не выполняется и, например, одна из случайных ошибок окажется по своему влиянию на сумму слагаемых ошибок резко превалирующей над всеми другими,то закон распределения этой превалирующей ошибки наложит свое

влияние на сумму и определит в основных чертах ее закон распределения.

Гауссовский законраспределения характеризуетсяплотностью вероятности

2 2

f

(x)

1 e[xM (x)] /(2 )

(9.5)

Для определенного распределения М(х) и σ — величины постоянные. Они являются параметрами гауссовского

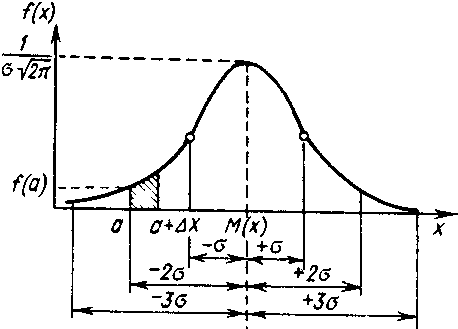

распределения. Графически функция (2.13) представлена на рис. 9.2. Поясним с помощьюэтого рисунка физический смысл плотности вероятностиf(x). Предположим, что случайная величинах представляет собой время работы изделия до отказа (время безотказной работы). Зададимся вполне определенным значением времени отказа изделия, равныма, и поставим вопрос следующим образом: какова вероятность того, что данное изделие откажет именно в момент времени x=a?

Рис. 9.2. Кривая распределения случайной величины, подчиняющаяся гауссовскому закону

Поставленный таким образом вопрос является некорректным в теории вероятностей. И поэтому ответ будетоднозначным: вероятность того,что отказ произойдет в определенный момент времених = а, равна нулю. Если же вблизиа взять малый интервал, то вероятность того, что случайная величинах попадет в этот интервал,уже не будет равнанулю, а будет равна:

P[a≤ x ≤ a + ΔX]=f(a) ΔХ (9.6)При малыхΔХ правая часть уравнения (2.14)представляет собой площадь прямоугольника со сторонами f( а) иΔХ. Если обе части уравнения (2.14) разделить наΔХ, то получим вероятность, приходящуюся на единицу длины, т. е.плотность вероятности (аналогично тому, что плотность

вещества — это масса на единицу объема)

f ( a )

P [ a

x a X ]

X

(9.7)

в этом изаключается физический смыслплотностивероятности.

Вернемся опять к кривой гауссовского

закона распределения, приведенной на

рис. 9.2. Как видно,

кривая распределения имеет

характерную колоколообразную

форму.

Максимальная ординатакривой, равная

1/

2 ,

соответствует точке х=М(х)—центру распределения. Точка перегиба кривой располагается на расстоянии±σ от центра распределения (как показано на рис. 9.2).По мере удаления от точкиМ(х) плотность распределения уменьшается, и прих→±∞ кривая асимптотически приближается к оси абсцисс.

Если при изменении центра группировки М(х) кривая распределения будет смещаться вдоль оси абсцисс, не изменяя своей формы,то при изменении σ кривая распределения меняет свою форму.

Максимальная ордината кривой распределения обратно пропорциональна σ. Так как площадь под кривой всегда должна оставаться равной единице,то при увеличении σ

кривая опускается вниз, одновременно растягиваясь вдоль оси абсцисс. Напротив, при уменьшении σ кривая вытягивается вверх, одновременно сжимаясь с боков.

Если рассмотреть частный случай, когда М(х) равно нулю, а σ равно единице, то, обозначив плотность вероятности черезf0(x), уравнение (2.13) можно записать в следующем виде:

x2

/2

f0 (x) (1/ )e

(9.8)

Функция (2.14) легко табулируется и для нее не представляет труда составить таблицы. С помощью таблицы для

f0 (х) нетрудно вычислитьf(x), когдаσ не равна единице, аМ(х) отлично от нуля. Действительно, из (9.3) и (9.6) имеем

(9.9)

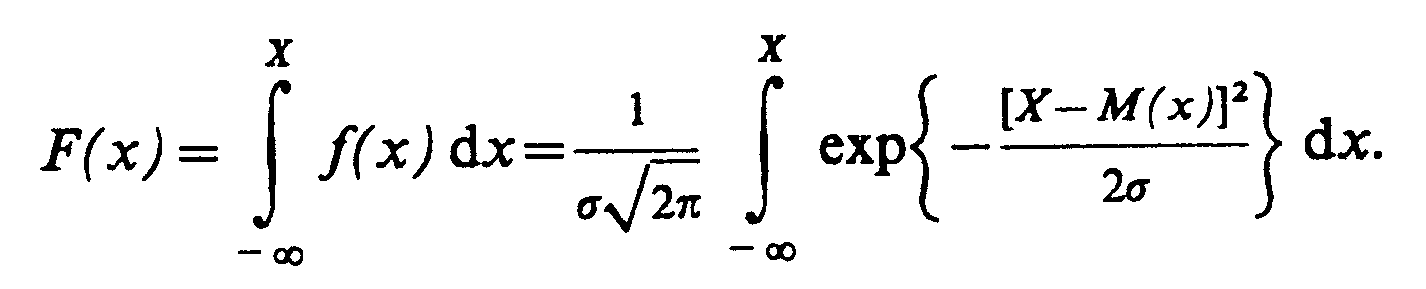

Интегральная функция распределения для случая гауссовского закона

(9.10)

С помощью формулы (2.18) определяется вероятность того, что случайная величинах будет меньше некоторого значенияX. Если же требуется найти вероятность того, что случайная величинах, имеющая гауссовский закон распределения, будет лежать в каких-либо пределах отх1 до х2, необходимо соответственно изменить пределы интегрирования в выражении (9.10),т. е.

1 x2

[X M(x)]2

Bep{x1

x

x2}

2 exp

2 2

dx

(9.11)

x

1

Произведя в (2.19) замену переменной интегрирования X на α=[X—M(x)]/σ, которую называют нормированием, и учитывая, что Х= ασ ± М(х), а dx = σdα, получаем

1 2

2

Bep{x1

x

x2} exp

d

(9.12)

2 2

1

Новые нормированные пределы интегрирования α1 иα2 заменили пределы х1 и х2. Представив правую часть выражения (2.20) в виде суммы двух интегралов, получим

1 0 2

Bep{x1 x x2 }

exp

d

2

1

1 2

2

exp

d

2 0

2

1 2

2

1 1

2

exp

d exp

d

2 0

2

2 0

2

где

x1 M (x) ;

1 2

x2 M ( x)

Знак перед первым слагаемым изменился вследствие изменения пределов интегрирования α1 - 0 на 0 – α2.

Функция

Ф ( )

1 2

exp{

}d

(9.13)

0 2

называется нормированной функцией Лапласа или интегралом вероятности. Для этой функции имеется в приложении. Таблица построена для положительных значений, но, учитывая, что функция Ф(α) нечетная, т. е. Ф(-α)= -Ф(α), для отрицательных значений α табличный результат следует брать со знаком минус. В некоторых случаях следует брать функцию

Ф1(α)=2Ф(α). (9.14)

Таким образом, для получения Ф1(α) достаточно удвоить значение Ф(α), взятое из приложения.

Площадь под кривой Гаусса равна 1, или 100% всех значений случайной величины в генеральной совокупности. Величина площади, заключенной между одно-, двух- и трехсигмовыми границами, найденными при подстановке в (9.14) значений Ф(а), взятых из приложения для σ, соответственно равного 1, 2 и3, приведена табл. 9.1.

Таблица 9.1

Величина площади под кривой Гаусса

при различных границах изменения случайной величины

|

Границы изменения случайной величины X |

Площадь под кривой Гаусса |

|

Односигмовые [М(х) — σ; М(х) + σ] Двухсигмовые [М(х) —2σ; М(х) +2σ] Трехсигмовые [М(х) - 3σ; М(х) + 3σ ] |

0,6827 0,9545 0,9973 |

Приведенные в табл. 9.1 данные можно истолковать следующим образом. Если 68,27%, т. е.2/3, наблюдаемых значений случайной величины лежит между границамиМ(х) — σ и М(х) + σ , то 31,73% всех наблюдений следует ожидать за этими границами (соответствующими точками перегиба кривой Гаусса), а именно: 15,865% — за границей М(х)— σ; 15,865% — за границейМ(х)+ σ в силу симметричности гауссовского распределения. Какуже отмечалось ранее, односигмовые границы соответствуют точкам перегиба кривой

Гаусса.

Между трехсигмовыми границами [М(х) - 3σ; М(х) + 3σ] находится 99,73% всех наблюдений, т. е. практически все значения. Только 0,27% значений лежит за этими границами, а именно 0,135% — за границейМ (х) -Зσ; 0,135% — за границейМ(х) + Зσ. Это означает, что при проведении 10 000 наблюдений в среднем 27 наблюдений будет лежать за трехсигмовыми границами или при 270 наблюдениях — одно. Поэтому, зная стандартное отклонение и математическое ожидание случайной величины, подчиняющейся гауссовскому закону распределения, можно ориентировочно указать интервал ее практически возможных минимальных и макси- мальных значений. И если какое-либо значение появляется за пределами трехсигмового участка, то его можно считать чистослучайным. Так как вероятность появления такого события очень мала, а именно 1/270, следует считать, что рассматриваемое событие является практически невозможным. Такой способ оценки диапазона возможных значений случайной величины известен в математической статистике под названиемправила трех сигм.

На практике участок, лежащий внутри трехсигмовых границ, называют областью статистического допуска параметра качества соответствующего изделия или процесса его изготовления.

Таким образом, следует отметить, что если распределение значений параметра качества близко к

гауссовскому, то это означает, что технологический процесс отлажен и контролируем. Поэтому часто приходится использовать различные критерии для проверки соответствия экспериментального (т.е. полученного при измерении параметра качества изделий в выборке) закона распределения случайной величины гауссовскому.