- •1.Понятие взаимной информации

- •3.Информация в непрерывных сигналах, дифференциальная энтропия

- •4.Понятие пропускной способности канала святи

- •5.Пропускная способность непрерывного канала связи

- •6.Информация в непрерывных сообщениях, эпсилон-ентропия

- •3. - Среднее значение квадрат.Отклонения (теор.Управл и связи)

- •7.Кодирование как представления информации в цифровом виде

- •8.Назначение кодирования в системах связи

- •9.Параметры кодовых последовательностей

- •10.Классификация кодов

- •11.Понятие эффективного кодирования.

- •1Часть Теоремы Шеннона о кодировании.

- •12.Кодирование по методу Шеннона-Фано.

- •13.Кодирование по методу Хаффмана

- •14.Теорема Шеннона о кодировании для канала с помехами

- •15.Принципы помехоустойчивости кодирования

- •16.Теоремы об обнаруживающих и исправляющих способностях кодов

- •17.Представление кодовых последовательностей, передаваемыхтелекоммуникационными каналами связи

- •18.Требования к кодовым последовательностям, передаваемых телекоммуникационными каналами связи

- •19.Представление кодовых последовательностей в nrz-коде.

- •20.Предоставление кодовых последовательностей в

- •21.Представление кодовых последовательностей в биполярном импульсном коде.

- •22.Представление кодовых последовательностей в манчестерском коде.

- •23.Понятие о скремблировании. Простейший алгоритм скремблирования

- •24.Прием дискретных сообщений как статистическая задача.

- •28.Понятие критерия принятия решений при приеме дискретных сигналов. Критерий идеального наблюдателя, критерий минимума среднего риска, Критерий Неймана-Пирсона

- •30.Оптимальные алгоритмы приема при полностью известных сигналах. Оптимальный приемник на «вычитателях».

- •31.Оптимальные алгоритмы приема при полностью известных сигналах. Оптимальный приемник на корреляторах

- •30-Б.Пот.Пом.При изв.Наб.Сиг.Пост.З-чи и получ.Выр-я для вер.Ош. Приема.

- •32.Потенциальная помехоустойчивость при известном наборе сигналов.

- •36. Понятие нелинейного звена и его структура.

- •37. Статические хар-ки нелинейных звеньев и их классификация: гладкие нелинейности.

- •38.Татические хар-ки нелинейных звеньев и их классификация: существенные нелинейности.

- •39. Преобразование гармонического сигнала гладкой нл-ю общего вида: умножитель частоты, детектор огибающей.

- •40. Преобразование нелинейности общего вида суммы двух гармонических сигналов: комбинационные компоненты второго порядка, смеситель на не линейность

- •41. Преобразование нелинейностью общего вида суммы двух гармонических сигналов: интермодуляционные составляющие третьего порядка.

- •42. Преобразование закона распределения случайного сигнала однозначной гладкой не линейностью

- •43. Преобразование закона распределения случайного сигнала неоднозначной гладкой нелинейностью.

- •44. Преобразование закона распределения случайного сигнала существенной нелинейностью: пример применения метода.

- •65. Помехи и шумы передатчиков

- •66. Шумы приемников: тепловые шумы элементов

- •70.Приведение шумов звена к его входу. Шумовая температура

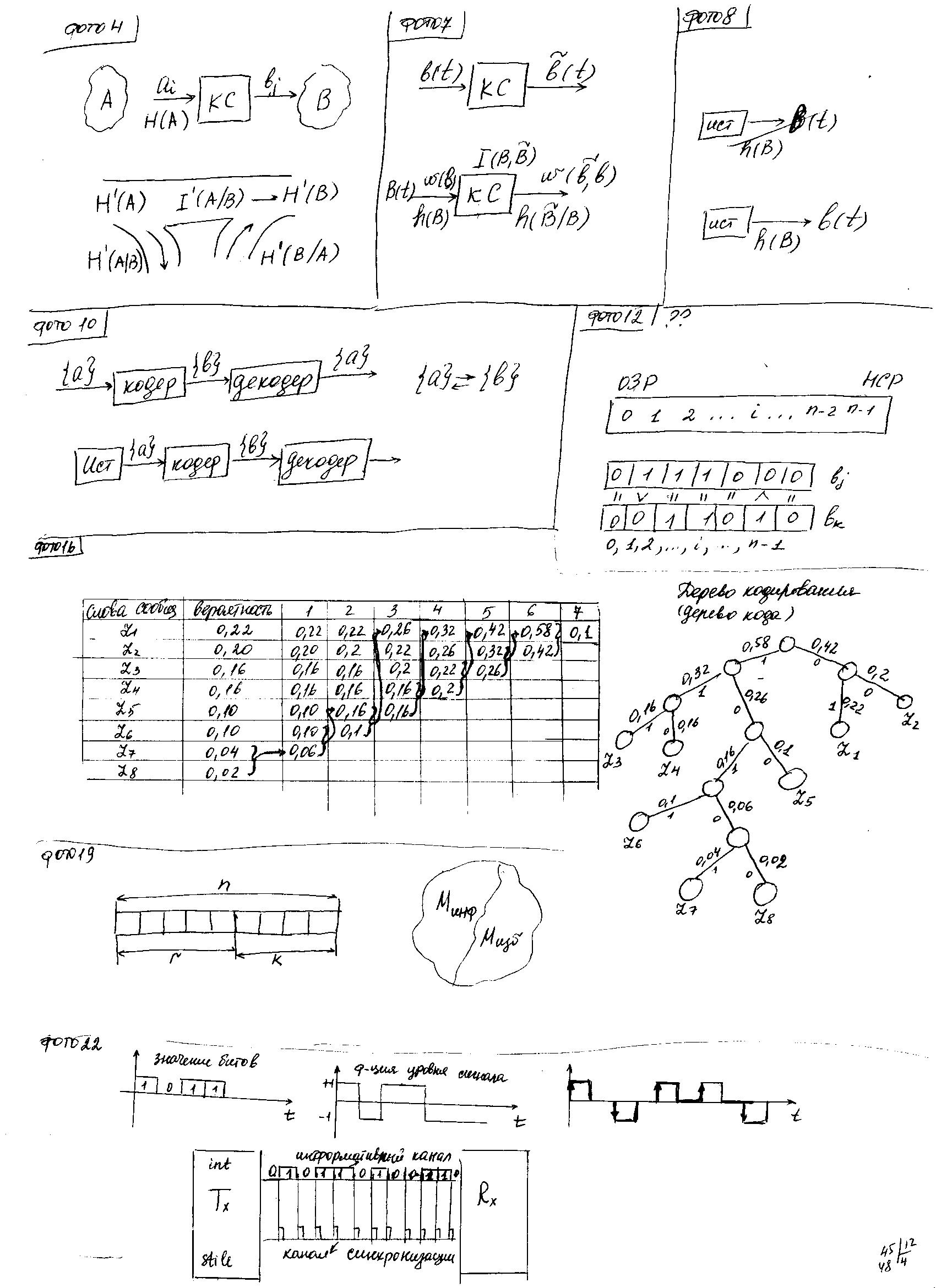

13.Кодирование по методу Хаффмана

Элемент.символы сообщений выстраиваются в порядке убывания вероятности. Достраиваем вспомогательные столбцы. Вероятности сворачивают (2слева у которых min вероятности) в одно, с суммарной вероятностью и выстраивают по убыванию вероятностей. Объединение заканчивается при достижении вероятности – 1. Завершение операции состоит в составлении дерева формирования кода с рершинами – словами. > вероятность слева – 1, < вер-ть справа – 0.

Запись кода – перемещаемся из главной вершины к концу.

0,42 -> 0.22 -> Z1, код –01

Экономность эфф.кодирования имеет недостаки: возникают проблемы с декодированием, если код большой. Решение – 1)поставить разделитель (пауза) -> снижает экономность; 2) поставить префиксные коды

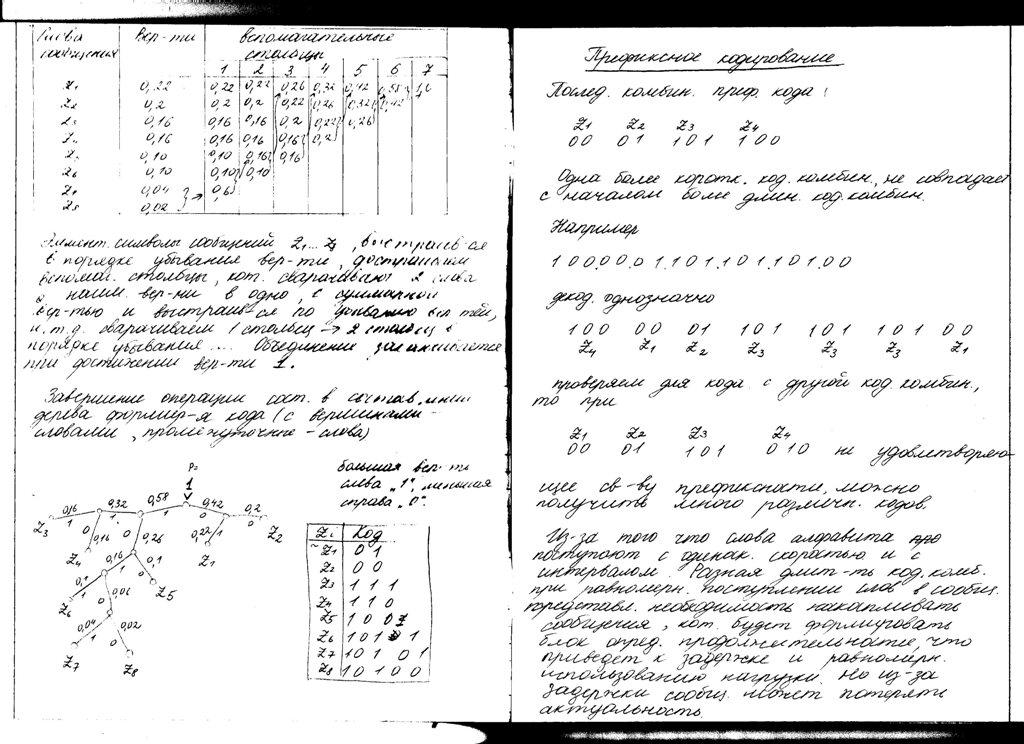

Префиксные коды

Кодированная комбинация, содержащих большое количество элементов не должна содержать элементов короткого кода

Z1 Z2 Z3 Z4

00 01 101 100

Ни одна короткая комбинация не совпадает с началом более длинной кодированной комбинации. Например, 1000000110110110100

Декодирование однозначно.

100 00 01 101 101 101 00

Z4 Z1 Z2 Z3 Z3 Z3 Z1

Проверяем для кода с другой кодированной комбинацией

Z1 Z2 Z3 Z4

00 01 101 010

не

выполняется префиксное правило

![]() м.получить

много различных кодов. .Из-за того, что

слова алфавита поступают с одинаковой

скоростью и интервалом, разная длительность

код.комбинаций при равномерном поступлении

слов в сообщении возникает необходимость

накапливать сообщения , которые

б.формировать блок определенной

продолжительности, что приведе к

задержке, следовательно к потери

актуальности информации.

м.получить

много различных кодов. .Из-за того, что

слова алфавита поступают с одинаковой

скоростью и интервалом, разная длительность

код.комбинаций при равномерном поступлении

слов в сообщении возникает необходимость

накапливать сообщения , которые

б.формировать блок определенной

продолжительности, что приведе к

задержке, следовательно к потери

актуальности информации.

Недостатки:

1.Снижение скорости отправки из-за неравномерного распределения и различной длительности посылки.

2.Теряется однозначность кодированной комбинации из-за представления двух кодов в одной посылке. Это требует дополнительные устройства выявления этих ошибок.

3. Технические средства сложнее, чем для блоков кодов длительности кодового блока.

14.Теорема Шеннона о кодировании для канала с помехами

Теорема кодирования для получения кода. При любой производительности источника сообщений, меньшей чем

пропускная способность канала, существует такой метод кодирования, который позволяет обеспечить передачу всей информации, создаваемой источником сообщений со сколь угодно малой вероятностью ошибки.

Производительность источника < пропускной способности.

За счет удлинения кодовой комбинации, за счет снижения скорости передачи сообщений, можно как угодно приблизить вероятность верного приема к 1, а вероятность ошибки - к 0.

II

часть теоремы:

Если производительность источника

сообщений![]() превышает

пропускную способность канала святи

С,

превышает

пропускную способность канала святи

С,

то не существует способа кодирования позволяющего вести передачу информации со сколь угодно малой вероятностью ошибок.

Производительность источника < пропускной способности.

Источник генерирует поток, мы можем передавать информацию, но большая ее часть будет потеряна в канале, т.е. вероятность ошибки никогда не м.б. 0 из-за недостатка пропускной способности сигнал не м. в полной мере передан. Если источник генерирует информационный поток > C канала, канал – причина возникновения ошибок. За счет этой ошибочности мы получаем ошибочность передачи сообщений сколь угодно малой.