- •1.Понятие взаимной информации

- •3.Информация в непрерывных сигналах, дифференциальная энтропия

- •4.Понятие пропускной способности канала святи

- •5.Пропускная способность непрерывного канала связи

- •6.Информация в непрерывных сообщениях, эпсилон-ентропия

- •3. - Среднее значение квадрат.Отклонения (теор.Управл и связи)

- •7.Кодирование как представления информации в цифровом виде

- •8.Назначение кодирования в системах связи

- •9.Параметры кодовых последовательностей

- •10.Классификация кодов

- •11.Понятие эффективного кодирования.

- •1Часть Теоремы Шеннона о кодировании.

- •12.Кодирование по методу Шеннона-Фано.

- •13.Кодирование по методу Хаффмана

- •14.Теорема Шеннона о кодировании для канала с помехами

- •15.Принципы помехоустойчивости кодирования

- •16.Теоремы об обнаруживающих и исправляющих способностях кодов

- •17.Представление кодовых последовательностей, передаваемыхтелекоммуникационными каналами связи

- •18.Требования к кодовым последовательностям, передаваемых телекоммуникационными каналами связи

- •19.Представление кодовых последовательностей в nrz-коде.

- •20.Предоставление кодовых последовательностей в

- •21.Представление кодовых последовательностей в биполярном импульсном коде.

- •22.Представление кодовых последовательностей в манчестерском коде.

- •23.Понятие о скремблировании. Простейший алгоритм скремблирования

- •24.Прием дискретных сообщений как статистическая задача.

- •28.Понятие критерия принятия решений при приеме дискретных сигналов. Критерий идеального наблюдателя, критерий минимума среднего риска, Критерий Неймана-Пирсона

- •30.Оптимальные алгоритмы приема при полностью известных сигналах. Оптимальный приемник на «вычитателях».

- •31.Оптимальные алгоритмы приема при полностью известных сигналах. Оптимальный приемник на корреляторах

- •30-Б.Пот.Пом.При изв.Наб.Сиг.Пост.З-чи и получ.Выр-я для вер.Ош. Приема.

- •32.Потенциальная помехоустойчивость при известном наборе сигналов.

- •36. Понятие нелинейного звена и его структура.

- •37. Статические хар-ки нелинейных звеньев и их классификация: гладкие нелинейности.

- •38.Татические хар-ки нелинейных звеньев и их классификация: существенные нелинейности.

- •39. Преобразование гармонического сигнала гладкой нл-ю общего вида: умножитель частоты, детектор огибающей.

- •40. Преобразование нелинейности общего вида суммы двух гармонических сигналов: комбинационные компоненты второго порядка, смеситель на не линейность

- •41. Преобразование нелинейностью общего вида суммы двух гармонических сигналов: интермодуляционные составляющие третьего порядка.

- •42. Преобразование закона распределения случайного сигнала однозначной гладкой не линейностью

- •43. Преобразование закона распределения случайного сигнала неоднозначной гладкой нелинейностью.

- •44. Преобразование закона распределения случайного сигнала существенной нелинейностью: пример применения метода.

- •65. Помехи и шумы передатчиков

- •66. Шумы приемников: тепловые шумы элементов

- •70.Приведение шумов звена к его входу. Шумовая температура

70.Приведение шумов звена к его входу. Шумовая температура

Вх.составл. шума определяется, как

![]()

![]()

![]()

![]()

Звено,

предположим, не шумит – шум дает входящее

сопротивление, а звено дает ![]() .

Для оценки сойств звена используют

шум.температуру входа (Т, при которой

рассматривается входящее сопротивление

4-х полюсника)

.

Для оценки сойств звена используют

шум.температуру входа (Т, при которой

рассматривается входящее сопротивление

4-х полюсника)

![]()

![]() ,

,![]() - эквивалентная шумовая температура.

- эквивалентная шумовая температура.

![]() - мощность на выходе с учетом Т.

- мощность на выходе с учетом Т.

![]() -позволяет

получить оценку минимального сигнала,

который можно выделить из шумов. Итак,

оценка

-позволяет

получить оценку минимального сигнала,

который можно выделить из шумов. Итак,

оценка ![]() удобна

при малых шумах, оценка

удобна

при малых шумах, оценка ![]() используется

при работе в больших шумах

используется

при работе в больших шумах

71.ШУМЫ ПАССИВНЫХ ЗВЕНЬЕВ

Здесь

![]() предполагается

> 1.

предполагается

> 1.

Линия

связи. Фидер (волновод, коаксиал, витая

пара, оптоволокно)

![]()

Наблюдаются явления:

-Рассеивание сигнала, сигнал на выходе меньше, чем на входе (сигнал – шум ухудшается)

-Чем

длинее фидер, тем больше ухудшается

сигнал-шум, если длина ![]() ,

а затухание

,

а затухание ![]() и

фидер

и

фидер ![]() ,

тогда

,

тогда ![]() -

формула для определения коэффициента

шума звена. Поэтому ВЧ системы помещают

так, чтобы

-

формула для определения коэффициента

шума звена. Поэтому ВЧ системы помещают

так, чтобы ![]() было

минимальным до источника сигнала, т.е.

так, чтобы фидер мог быть как можно

короче.

было

минимальным до источника сигнала, т.е.

так, чтобы фидер мог быть как можно

короче.

Устройство, которое не характеризуется протяженностью, не усиливающее:

Напр, фильтр.

Есть

затухание и шум определяется как ![]()

72. ШУМЫ ПОСЛЕДОВАТЕЛЬНОГО СОЕДИНЕНИЯ ЗВЕНЬЕВ

К-т шума всегда >1

![]()

![]() -коэффициент

шума, определяется как:

-коэффициент

шума, определяется как:

![]()

Шумы последующих каскадов будут влиять меньше чем первый каскад

Наиб. влияние иметь 1 каскад,затем 2й,3й…

Если

к-т шума к-т усиления большой – то

приемник будет перегружен,е сли маленький,

то он будет плохо настроенным Для

обеспечения наименьшего ![]() необходимо

минимизировать шумы 1 каскада,

максимизировать шумы др. каскадов.

необходимо

минимизировать шумы 1 каскада,

максимизировать шумы др. каскадов.

Для обеспечения высокого качества необходимо выбирать системы, которые мало шумят и обладают высоким усилением.

Итак,

![]() нужно

уменьшать, а

нужно

уменьшать, а ![]() -увеличивать.

-увеличивать.

72-б. ИЗМЕРЕНИЕ КОЭФФИЦИЕНТА ШУМА

На вход подаем шум от регулируемого генератора.

![]()

Генератор согласован со звеном должен быть прибор, показывающий мощность.

![]() -

шумы входящего сопротивления;

-

шумы входящего сопротивления; ![]()

Коэффициент шума описывает шумовые свойства звена. Указывает на сколько ухудшится соотношение сигнал-шум при прохождении через это звено сигнала

;

; ![]() -ухудшение

шумовых св-в из-за того,что Rвх

вносит доп. шумы.

-ухудшение

шумовых св-в из-за того,что Rвх

вносит доп. шумы.

![]()

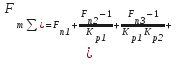

73. ПОНЯТИЕ ОБ ИНФОРМАЦИОННОЙ МЕРЕ. КОЛИЧЕСТВО ИНФОРМАЦИИ В ДИСКРЕТНОМ СООБЩЕНИИ.

Информация – это набор признаков позволяющих раскрыть неопределенное состояние объекта.

Объектом может быть любой процесс, характериз-ся какими-то физическими величинами.

Пусть

есть источник дискр. сообщ. А (клава, с

которой поступает набор символов).

![]()

а – сообщение из набора (ансамбля) сообщ.

{А}

формирует а {А} ![]() .

Случайный поток сообщений представляет

информационное сообщение.

.

Случайный поток сообщений представляет

информационное сообщение.

Мера информации должна удовлетворять требованиям:

инф. мера должна быть аддитивной

кол-во инф о достоверном событии должно быть =0

кол-во инф не должно зависеть от качественного содерж. сообщ.

Р(а) – вероятность появления события.

Пусть а1,а2 – независ. сообщения. Источник последовательно выдает а1… затем а2. Р(а1,а2)=Р(а1)*Р(а2)

i(a) – инф. в сообщении а

i(a1,а2)= i(a1)+i(a2)

i(a)= - log P(a)= log 1/p(a)

знак

“-” поставлен для того, чтобы инф. была

положительной, если события независимы.

В качестве инф. меры события а, берется

![]() 1/(P(a)

1/(P(a)

Для

зависимых

событий:

i(an/an-1,an-2,…)=log ![]()

Если

же события а1 и а2 имеют одинаковую

вероятность появления P(a1)=P(a2)=0.5

, то информация раскрывается в max

появлении i(a1)=i(a2)=

- ![]() 0.5

=1 бит.

0.5

=1 бит.

1 бит – max кол-во информации которое может быть передано дискретной СМО равновероятных событий.

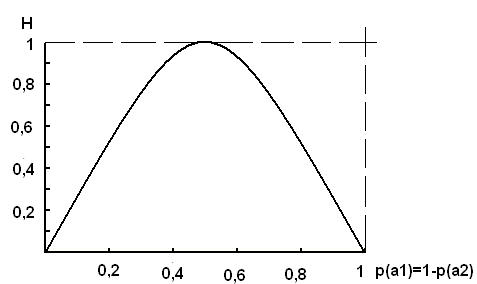

74. ЭНТРОПИЯ ИСТОЧНИКА ДИСКРЕТНЫХ СООБЩЕНИЙ И ЕЕ СВОЙСТВА

Энтропия – это усредн. хар-ка того кол-ва инф-ции, кот. выдаёт источник.

Пусть источник генер. сообщ. из ансамбля А: 1≤К<k, где k – объём алфавита источника; К – текущ. номер сообщения.

Р(ак) – вер-ть выдачи а. Т.к. кажд. сообщ. им. свою вер-ть, то можно говорить о распред. вер-ти.

Энтропия явл. инф. хар-ой, определяющей непредсказуемость (информативность) источника: Н(А)=М{log(1/P(a))}; М –МО на всём ансамбле А; log(1/P(a)) – инф., кот.

принадлежит кажд. из сообщений.

Если ист. явл. дискретным: Н(А)=∑Р(ак)log(1/P(a))

С в-ва

энтропии:1.Аддитивность.2.Энтропия

положительна: Н(А)≥0.3.Н(А)=0,если для

вер-ей сообщений верно: Р(ак=i)

≡1,0; Р(ак≠i)

≡0 4.H(A)≤logk

– наиб. энтропией обладает ист. с

равновероятными сообщ. 5.H(A)=logk

, если

Р(ак)=Р(аn)=1/k;

k≠n.

в-ва

энтропии:1.Аддитивность.2.Энтропия

положительна: Н(А)≥0.3.Н(А)=0,если для

вер-ей сообщений верно: Р(ак=i)

≡1,0; Р(ак≠i)

≡0 4.H(A)≤logk

– наиб. энтропией обладает ист. с

равновероятными сообщ. 5.H(A)=logk

, если

Р(ак)=Р(аn)=1/k;

k≠n.

Пусть ак, аn – равномерн. и независ. события. Н(А)=logk – max знач. энтропии источника с объёмом алфавита К.

График. связ. энтропию с вер-ю появл. события:

Х(хи)=(Нmax-H(A))/Hmax – избыточность источника. H’(A)=1/T*H(A) – производительность источника, где Т – ср. время передачи на 1 символ. 75. ВЗАИМНАЯ ИНФОРМАЦИЯ И ЕЕ СВОЙСТВА

Энтропия – среднее количество информации на одно сообщение, которое формируется источником.

![]()

![]()

Пусть имеется 2 источника – А и В, Допустим, что сообщения, которые они формируют, взаимосвязаны(например, вход и выход КС)

А

и В – источники формируемых сигналов

![]() и

и ![]() .

.

Поведение

системы можно описать: 1)совместной

вероятностью появления сообщения

![]() и

и ![]() –

– ![]()

![]() -

совместная энтропия

-

совместная энтропия

2)

условной вероятностью ак,

при условии bl

- Р(ак

/ bl)

![]() -

условная энтропия.

-

условная энтропия.

В

общем случае ![]() и значение «В» снижает первоначальную

постоянную «А». Тогда разность

и значение «В» снижает первоначальную

постоянную «А». Тогда разность ![]() есть количество информации содержащийся

в «В» по отношению к «А».

есть количество информации содержащийся

в «В» по отношению к «А». ![]()

![]() -потеря

информации

-потеря

информации

![]()

Если

воспользоваться теоремой умножения

вероятностей для взаимосвязанных

сообщений![]() ,

то

,

то