- •Теория электрической связи

- •Оглавление

- •I. Сообщения, сигналы и помехи, их математические модели

- •1. Общие сведения о системах электрической связи

- •1.1. Информация, сообщения, сигналы и помехи

- •1.2. Общие принципы построения систем связи

- •1.3. Классификация систем связи

- •2. Математическая модель сигналов

- •2.1. Математическое описание сигнала

- •2.2. Математическое представление сигналов

- •2.3. Геометрическое представление сигналов

- •2.4. Представление сигналов в виде рядов ортогональных функций

- •3. Спектральные характеристики сигналов

- •3.1. Спектральное представление периодических сигналов

- •3.2. Спектральное представление непериодических сигналов

- •3.3. Основные свойства преобразования Фурье:

- •1) Линейность.

- •4) Теорема запаздывания.

- •10) Спектры мощности.

- •4. Сигналы с ограниченным спектром. Теорема Котельникова

- •4.1. Разложение непрерывных сигналов в ряд Котельникова

- •Спектр периодической последовательности дельта-импульсов в соответствии с формулой для u(t) имеет следующий вид:

- •4.2. Спектр дискретизированного сигнала

- •4.3. Спектр дискретизированного сигнала при дискретизации импульсами конечной длительности (сигнал амплитудно-импульсной модуляции или аим сигнал)

- •4.4. Восстановление непрерывного сигнала из отсчётов

- •4.5. Погрешности дискретизации и восстановления непрерывных сигналов

- •5. Случайные процессы

- •5.1. Характеристики случайных процессов

- •Функция распределения вероятностей сп (фрв).

- •Двумерная фрв.

- •Функция плотности вероятностей случайного процесса (фпв)

- •Стационарность.

- •Эргодичность.

- •5.2. Нормальный случайный процесс (гауссов процесс)

- •5.3. Фпв и фрв для гармонического колебания со случайной начальной фазой

- •5.4. Фпв для суммы нормального случайного процесса и гармонического колебания со случайной начальной фазой

- •5.5. Огибающая и фаза узкополосного случайного процесса

- •5.6. Флуктуационный шум

- •6. Комплексное представление сигналов и помех

- •6.1. Понятие аналитического сигнала

- •6.2. Огибающая, мгновенная фаза и мгновенная частота узкополосного случайного процесса

- •7. Корреляционная функция детерминированных сигналов

- •7.1. Автокорреляция вещественного сигнала

- •Свойства автокорреляционной функции вещественного сигнала:

- •7.2. Автокорреляция дискретного сигнала

- •7.3. Связь корреляционной функции с энергетическим спектром

- •7.4. Практическое применение корреляционной функции

- •II. Методы формирования и преобразования сигналов

- •8. Модуляция сигналов

- •8.1. Общие положения

- •8.2. Амплитудная модуляция гармонического колебания

- •8.3. Балансная и однополосная модуляция гармонической несущей

- •9. Методы угловой модуляции

- •9.1. Принципы частотной и фазовой (угловой) модуляции

- •9.2. Спектр сигналов угловой модуляции

- •9.3. Формирование и детектирование сигналов амплитудной и однополосной амплитудной модуляции

- •9.4. Формирование и детектирование сигналов угловой модуляции

- •10. Манипуляция сигналов

- •10.1. Временные и спектральные характеристики амплитудно- манипулированных сигналов

- •10.2. Временные и спектральные характеристики частотно-манипулированных сигналов

- •10.3. Фазовая (относительно-фазовая) манипуляция сигналов

- •III. Алгоритмы цифровой обработки сигналов

- •11. Основы цифровой обработки сигналов

- •11.1. Общие понятия о цифровой обработке

- •11.2. Квантование сигнала

- •11.3. Кодирование сигнала

- •11.4. Декодирование сигнала

- •12. Обработка дискретных сигналов

- •12.1. Алгоритмы дискретного и быстрого преобразований Фурье

- •12.2. Стационарные линейные дискретные цепи

- •12.3. Цепи с конечной импульсной характеристикой (ких-цепи)

- •12.4. Рекурсивные цепи

- •12.5. Устойчивость лис-цепей

- •13. Цифровые фильтры

- •13.1. Методы синтеза ких-фильтров

- •13.2. Синтез бих-фильтров на основе аналого-цифровой трансформации

- •IV. Каналы связи

- •14. Каналы связи

- •14.1. Модели непрерывных каналов

- •14.2. Модели дискретных каналов

- •V. Теория передачи и кодирования сообщений

- •15. Теория передачи информации

- •15.1. Количество информации переданной по дискретному каналу

- •15.2. Пропускная способность дискретного канала

- •15.3. Пропускная способность симметричного дискретного канала без памяти

- •15.4. Методы сжатия дискретных сообщений

- •15.4.1. Условия существования оптимального неравномерного кода

- •15.4.2. Показатели эффективности сжатия

- •15.4.3. Кодирование источника дискретных сообщений методом Шеннона-Фано

- •15.4.4. Кодирование источника дискретных сообщений методом Хаффмена

- •15.5. Количество информации, переданной по непрерывному каналу

- •15.6. Пропускная способность непрерывного канала

- •16. Теория кодирования сообщений

- •Классификация помехоустойчивых кодов

- •16.1. Коды с обнаружением ошибок

- •16.1.1. Код с проверкой на четность.

- •16.1.2. Код с постоянным весом.

- •16.1.3. Корреляционный код (Код с удвоением).

- •16.1.4. Инверсный код.

- •16.2. Корректирующие коды

- •16.2.1. Код Хэмминга

- •16.2.2. Циклические коды

- •16.2.3. Коды Рида-Соломона

- •V. Помехоустойчивость

- •17. Помехоустойчивость систем передачи дискретных сообщений

- •17.1. Основные понятия и термины

- •17.2. Бинарная задача проверки простых гипотез

- •17.3. Приём полностью известного сигнала (когерентный приём)

- •17.4. Согласованная фильтрация

- •17.5. Потенциальная помехоустойчивость когерентного приёма

- •17.6. Некогерентный приём

- •17.7. Потенциальная помехоустойчивость некогерентного приёма

- •18. Помехоустойчивость систем передачи непрерывных сообщений

- •18.1. Оптимальное оценивание сигнала

- •18.2. Оптимальная фильтрация случайного сигнала

- •18.3. Потенциальной помехоустойчивости передачи непрерывных сообщений

- •19. Адаптивные устройства подавления помех

- •19.1. Основы адаптивного подавления помех

- •19.2. Подавление стационарных помех

- •19.3. Адаптивный режекторный фильтр

- •19.4. Адаптивный высокочастотный фильтр

- •19.5. Подавление периодической помехи с помощью адаптивного устройства предсказания

- •19.6. Адаптивный следящий фильтр

- •19.7. Адаптивный накопитель

- •VI. Многоканальная связь и распределение информации

- •20. Многоканальная связь и распределение информации

- •20.1. Частотное разделение каналов

- •20.2. Временное разделение каналов

- •20.3. Кодовое разделение каналов

- •20.4. Синхронизация в спи с многостанционным доступом

- •20.5. Коммутация в сетях связи

- •VII. Эффективность систем связи

- •21. Оценка эффективности и оптимизация параметров телекоммуникационных систем (ткс)

- •21.1. Критерии эффективности

- •21.2. Эффективность аналоговых и цифровых систем

- •21.3. Выбор сигналов и помехоустойчивых кодов

- •22. Оценка эффективности радиотехнической системы связи

- •22. 1. Тактико-технические параметры радиотехнической системы связи

- •22.2. Оценка отношения сигнал/помеха на входе радиоприемники радиотехнической системы связи

- •22.3. Оптимальная фильтрация непрерывных сигналов

- •22.4. Количество информации при приёме дискретных сигналов радиотехнической системы связи

- •22.5. Количество информации при оптимальном приёме непрерывных сигналов

- •22.6. Выигрыш в отношении сигнал/помеха

- •22.7. Пропускная способность каналов радиотехнической системы связи

- •VIII. Теоретико-информационная концепция криптозащиты сообщений в телекоммуникационных системах

- •23. Основы криптозащиты сообщений в системах связи

- •23.1. Основные понятия криптографии

- •23.2. Метод замены

- •23.3. Методы шифрования на основе датчика псевдослучайных чисел

- •23.4. Методы перемешивания

- •23.5. Криптосистемы с открытым ключом

- •13.6. Цифровая подпись

- •Заключение

- •Список сокращений

- •Основные обозначения

- •Литература

- •Теория электрической связи

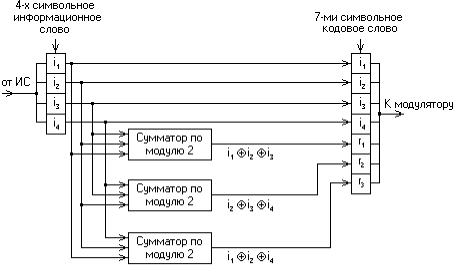

16.2.1. Код Хэмминга

Код Хэмминга, являющийся групповым (n,m) кодом, с минимальным расстоянием d=3 позволяет обнаруживать и исправлять однократные ошибки. Построение кодов Хемминга базируется на принципе проверки на чётность веса W (числа единичных символов) в информационной группе кодового блока.

Для каждого числа проверочных символов k = 3,4,5… существует классический код Хемминга с маркировкой (n,m) = (2k -1, 2k -1 - k), т.е. – (7,4), (15,11), (31,26) …

Для примера рассмотрим классический код Хемминга (7,4). В простейшем варианте при заданных четырёх (m = 4) информационных символах (i1, i2, i3, i4) будем полагать, что они сгруппированы в начале кодового слова, хотя это и не обязательно. Дополним эти информационные символы тремя проверочными символами (k = 3), задавая их следующими равенствами проверки на чётность, которые определяются соответствующими алгоритмами:

k1

= i1

![]() i2

i2

![]() i3;

i3;

k2

= i2

![]() i3

i3

![]() i4;

i4;

k3

= i1

![]() i2

i2

![]() i4,

где знак

i4,

где знак

![]() означает сложение по модулю 2.

означает сложение по модулю 2.

В соответствии с этим алгоритмом определения значений проверочных символов ki возможны 16 кодовых слов (7,4) – кода Хемминга.

|

m = 4 |

k = 3 | |||||

|

i1 |

i2 |

i3 |

i4 |

k1 |

k2 |

k3 |

|

0 |

0 |

0 |

0 |

0 |

0 |

0 |

|

0 |

0 |

0 |

1 |

0 |

1 |

1 |

|

0 |

0 |

1 |

0 |

1 |

1 |

0 |

|

0 |

0 |

1 |

1 |

1 |

0 |

1 |

|

0 |

1 |

0 |

0 |

1 |

1 |

1 |

|

0 |

1 |

0 |

1 |

1 |

0 |

0 |

|

0 |

1 |

1 |

0 |

0 |

0 |

1 |

|

0 |

1 |

1 |

1 |

0 |

1 |

0 |

|

1 |

0 |

0 |

0 |

1 |

0 |

1 |

|

1 |

0 |

0 |

1 |

1 |

1 |

0 |

|

1 |

0 |

1 |

0 |

0 |

1 |

1 |

|

1 |

0 |

1 |

1 |

0 |

0 |

0 |

|

1 |

1 |

0 |

0 |

0 |

1 |

0 |

|

1 |

1 |

0 |

1 |

0 |

0 |

1 |

|

1 |

1 |

1 |

0 |

1 |

0 |

0 |

|

1 |

1 |

1 |

1 |

1 |

1 |

1 |

На вход декодера поступает кодовое слово V = (i1', i2', i3', i4', k1', k2', k3'), апостроф означает, что любой символ слова может быть искажён помехой в канале передачи.

В декодере в режиме исправления ошибок строится последовательность:

s1

= k1'

![]() i1'

i1'

![]() i2'

i2'

![]() i3';

i3';

s2

= k2'

![]() i2'

i2'

![]() i3'

i3'

![]() i4';

i4';

s3

= k3'

![]() i1'

i1'

![]() i2'

i2'

![]() i4'.

i4'.

Трёхсимвольная последовательность (s1, s2, s3) называется синдромом S.

Синдром S = (s1, s2, s3) представляет собой сочетание результатов проверки на чётность соответствующих символов кодовой группы и характеризует определённую конфигурацию ошибок (шумовой вектор).

Число возможных синдромов определяется выражением: S = 2k.

Рис. 16.1. Кодер простого (7, 4) – кода Хемминга

Рис. 16.2. Декодер простого (7, 4) – кода Хемминга

При числе проверочных символов k = 3 имеется восемь возможных синдромов (23 = 8). Нулевой синдром (000) указывает на то, что ошибки при приёме отсутствуют или не обнаружены. Всякому ненулевому синдрому соответствует определённая конфигурация ошибок, которая и исправляется. Классические коды Хемминга имеют число синдромов, точно равное их необходимому числу, позволяют исправить все однократные ошибки в любом информативном и проверочном символах и включают один нулевой синдром. Такие коды называются плотноупакованными.

Усечённые коды являются неплотноупакованными, так как число синдромов у них превышает необходимое. Так, в коде (9,5) при четырёх проверочных символах число синдромов будет равно 24 =16, в то время как необходимо всего 10. Лишние 6 синдромов свидетельствуют о неполной упаковке кода (9,5). Для рассматриваемого кода (7,4) в таблице 16.1 представлены ненулевые синдромы и соответствующие конфигурации ошибок.

Таблица 16.1

|

Синдром |

001 |

010 |

011 |

100 |

101 |

110 |

111 |

|

Конфигурация ошибок |

0000001 |

0000010 |

0001000 |

0000100 |

1000000 |

0010000 |

0100000 |

|

Ошибка в символе |

k3 |

k2 |

i4 |

k1 |

i1 |

i3 |

i2 |

Таким образом, код (7,4) позволяет исправить все одиночные ошибки. Простая проверка показывает, что каждая из ошибок имеет свой единственный синдром. При этом возможно создание такого цифрового корректора ошибок (дешифратора синдрома), который по соответствующему синдрому исправляет соответствующий символ в принятой кодовой группе.