- •§1. Понятие эс, назначение, классификация

- •§2. Качество сложной системы

- •§3. Жизненный цикл сложной системы

- •§4. Структуры конструкции эс и их математические модели

- •§5. Параметры конструкции эс и отклонение параметров.

- •§6. Конструкция эс и ее характерные черты

- •§7. Воздействия на конструкцию эс

- •§8. Конструирование эс

- •§9. Модели и моделирование как основы оптимизации

- •§10. Математическая формулировка задачи оптимального проектирования

- •§11. Целевая функция

- •§12. Методы решения задач оптимального проектирования. Классификация

- •§13. Методы оптимизации, основанные на классической математике

- •Экстремум функции одной переменной

- •Экстремум функции многих переменных

- •Метод замены переменных

- •Метод неопределенных множителей Лагранжа.

- •§14. Нелинейное программирование

- •Метод релаксации.

- •Метод градиента.

- •Метод наискорейшего спуска (метод Коши).

- •Метод Ньютона.

- •Метод общего поиска

- •Метод дихотомии

- •Метод почти половинного деления.

- •Метод золотого сечения.

- •Метод чисел Фибоначчи

- •3. Метод случайных направлений

- •4. Комбинированный метод

- •§15. Надежность. Основные понятия

- •§16. Показатели надежности невосстанавливаемых элементов и систем

- •Вероятность безотказной работы

- •Частота отказов

- •Интенсивность отказов

- •§17. Основные законы надежности

- •§18. Классификация аппаратуры по требованиям к надежности

- •§19 Факторы, влияющие на надежность эс

- •§20. Обеспечение надежности резервированием эс

- •§21. Общие принципы обеспечения надежности эс

- •При проектировании.

- •При производстве:

- •При эксплуатации:

- •§22. Расчеты надежности эс

- •Оценочный

- •Ориентировочный

- •Уточненный

- •§23. Методы прогнозирования состояния и качества эс

- •Этап проектирования

- •Этап производства

- •Этап эксплуатации

- •§24. Показатели качества прогнозирования

§13. Методы оптимизации, основанные на классической математике

Экстремум функции одной переменной

![]() =>Находится

Xопт

=>Находится

Xопт

Экстремум функции многих переменных

=>

Находится Xопт

=>

Находится Xопт

-

матрица вторых

производных.

-

матрица вторых

производных.

Исследуем матрицу: если все элементы матрицы больше 0, то в точке наблюдается минимум.

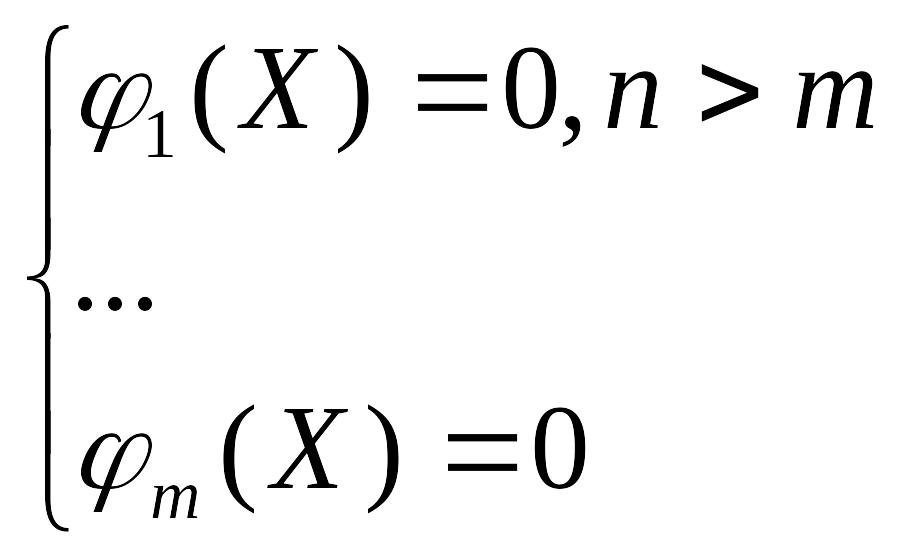

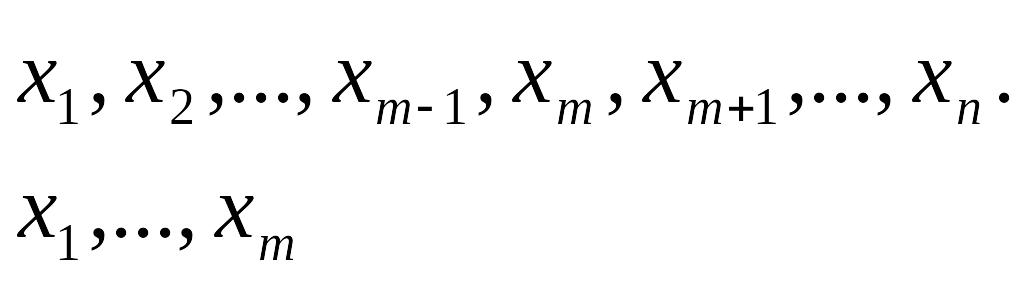

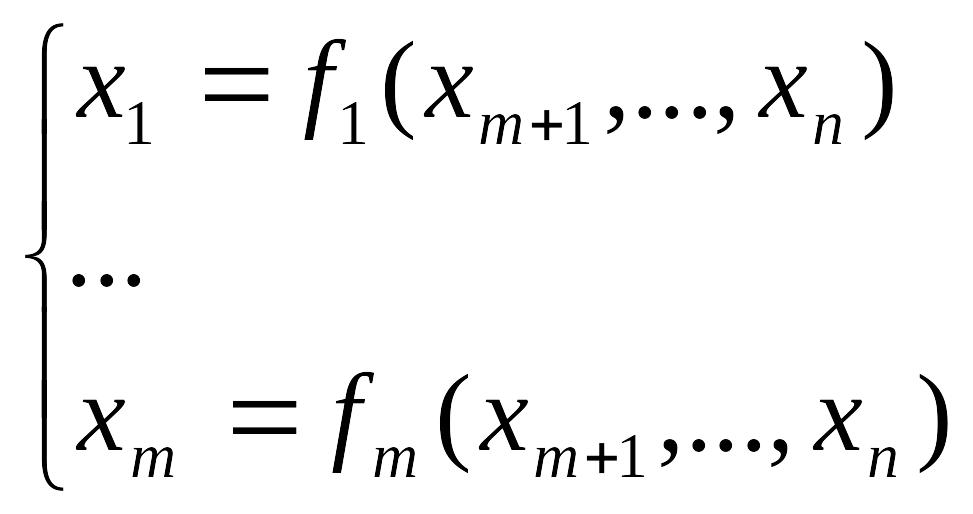

Метод замены переменных

Применим, когда ограничения имеют вид неравенств, и число ограничений меньше числа переменных (неизвестных).

Выражаем m первых переменных:

через остальные. Получаем систему уравнений.

Система решается,

находятся xm+1,…,xn

, тогда ЦФ зависит от меньшего числа

переменных :

![]() .

.

Затем уже находятся все остальные переменные подстановкой.

Достоинства:

позволяет избавиться от ограничений;

позволяет понизить размерность задачи.

Недостатки:

не всегда можно разрешить систему уравнений, относительно m - первых неизвестных (переменных).

Необходимо, чтобы функция была дифференцируема.

Метод неопределенных множителей Лагранжа.

Достоинства:

Нет ограничения на условие, что количество переменных

Задача с ограничениями сводится к задаче без ограничений.

m

L

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

где

![]() - неопределенные множители Лагранжа.

- неопределенные множители Лагранжа.

Находим производные:

![]() (1)

(1)

Находим производные

по каждой из

![]() :

:

![]() (2)

(2)

Решая системы уравнений (1) и (2) находим xi i.

т.о. избавляемся от ограничений.

Недостатки:

функция должна быть дифференцируема;

трудность решения систем уравнений;

повышена размерность задачи.

Пример: Спроектировать термостат цилиндрической формы, т.о., чтобы он имел минимальную поверхность при заданном объеме.

r, h - ?

![]()

§14. Нелинейное программирование

Особенности задач нелинейного программирования:

Многошаговые итерационные процессы, в которых производится постепенное приближение к оптимальному решению. Точки друг от друга различаются на шаг.

![]() ,

,

где

![]() шаг, k

- номер итерации, номер шага.

шаг, k

- номер итерации, номер шага.

Большую трудность вызывает выбор шага (если большой – рискуем проскочить оптимум, но с большой скоростью; если маленький – существует возможность «утонуть» в вычислениях).

Заранее определить число шагов нельзя.

Эффективность методов зависит от результата, полученного на предыдущем шаге.

В алгоритме поиска необходимо иметь правило окончания работы. Оно заключается в достижении требуемой точности.

Некоторые задачи могут не иметь решения, а иметь лишь особые точки.

Классификация методов нелинейного программирования:

Градиентные методы:

- метод градиента и его модификации;

- метод релаксации;

- метод наискорейшего спуска;

- метод «тяжелого шарика» и др.

Безградиентные методы:

- метод общего поиска;

- метод дихотомии;

- метод «золотого сечения»;

- метод чисел Фибоначчи;

- метод сканирования;

- симплексный метод и др.

Методы случайного поиска:

- метод «слепого» поиска;

- метод случайных направлений и др.

Градиентные методы нелинейного программирования.