- •1. Определение ии. Определение слабоформализуемых задач и их примеры. Определение сложных систем.[1/1]

- •2. История развития исследований в области ии.[1/1]

- •3. Основные свойства естественного интеллекта (еи).[1/1]

- •4. Основные направления исследований в области ии. Две точки зрения на развитие сии. [1/1]

- •5. Нечеткая логика. Краткие исторические сведения. Аспекты неполноты информации [1/1]

- •6. Определения четких и нечетких множеств. Определение нечеткого множества. Функция принадлежности. Примеры нечетких дискретных и непрерывных множеств. [1/2]

- •7. Основные свойства нечетких множеств. Нечеткое число и нечеткий интервал.[1/3]

- •*7. Основные свойства нечетких множеств. Нечеткое число и нечеткий интервал.[2/3]

- •*7. Основные свойства нечетких множеств. Нечеткое число и нечеткий интервал.[3/3]

- •8. Понятия фаззификации, дефаззификации, лингвистической переменной. Пример. [1/1]

- •9. Операции с нечеткими множествами (эквивалентность, включение, нечеткая операция «и», «или», «не»). [1/2]

- •10.Обобщение операций пересечения и объединения в классе т-норм и s-конорм[1/2].

- •11. Нечеткие отношения. Композиционные правила (max-min) и (max-prod). Примеры. [1/1]

- •12. Нечеткие алгоритмы. Обобщенная схема процедуры нечеткого логического вывода. [1/2]

- •13. Нечеткие алгоритмы. Метод максимума-минимума (метод Мамдани) как метод нечеткого логического вывода (изложение необходимо сопроводить примером). [1/2]

- •14. Нечеткие алгоритмы. Метод максимума-произведения (метод Ларсена) как метод нечеткого логического вывода (изложение необходимо сопроводить примером)[1/1].

- •15.Методы дефаззификации[1/1].

- •16.Процедура (схема) нечеткого логического вывода. Пример нечеткого логического вывода для выполнения нескольких правил. Достоинства и недостатки систем, основанных на нечеткой логике[1/2].

- •17.Искусственные нейронные сети. Особенности биологического нейрона. Модель искусственного нейрона [1/2].

- •18.Определение искусственной нейронной сети (инс). Однослойный и многослойный персептроны [1/1].

- •19. Классификация инс. Задачи, решаемые с помощью нейронных сетей [1/2].

- •20.Основные этапы нейросетевого анализа. Классификация известных нейросетевых структур по типу связей и типу обучения и их применение [1/1].

- •21. Алгоритм обучения с учителем для многослойного персептрона [1/1]

- •22. Алгоритмы обучения нейронных сетей. Алгоритм обратного распространения ошибки [1/1]

- •23. Проблемы обучения нс[1/1].

- •24. Сети Кохонена. Постановка задачи кластеризации. Алгоритм кластеризации[1/1].

- •25. Преобразование алгоритма кластеризации с целью реализации в нейросетевом базисе. Структура сети Кохонена [1/1]

- •26. Алгоритм обучения без учителя для сетей Кохонена. Обобщенная процедура [1/1]

- •27. Алгоритм обучения без учителя для сетей Кохонена. Метод выпуклой комбинации. Графическая интерпретация [1/1]

- •28. Самоорганизующиеся карты (сок) Кохонена. Особенности обучения сок. Построение карт [1/1]

- •29. Проблемы обучения инс [1/1]

- •30. Генетические алгоритмы. Определение. Назначение. Сущность естественного отбора в природе [1/1]

- •31. Основные понятия генетических алгоритмов [1/1]

- •32. Блок-схема классического генетического алгоритма. Особенности инициализации. Пример. [1/1]

- •33. Блок-схема классического генетического алгоритма. Селекция хромосом. Метод рулетки. Пример.[1/2]

- •33. Блок-схема классического генетического алгоритма. Селекция хромосом. Метод рулетки. Пример.[2/2]

- •34. Блок-схема классического генетического алгоритма. Применение генетических операторов. Пример.[1/1]

- •35. Блок-схема классического генетического алгоритма. Проверка условия остановки га.[1/1]

- •36. Достоинства генетических алгоритмов.[1/1]

- •37. Гибридные сии и их виды.[1/2]

- •38. Структура мягкой экспертной системы.[1/1]

- •39.Методология разработки интеллектуальных систем. Виды прототипов экспертных систем.[1/1]

- •40.Обобщенная структура основных этапов разработки экспертных систем.[1/2]

- •1. Идентификация.

- •2. Концептуализация.

- •3. Формализация

- •4. Программирование.

- •5. Тестирование на полноту и целостность

29. Проблемы обучения инс [1/1]

1) Медленная сходимость процесса обучения. Математическая сходимость доказана для бесконечно малого шага.

2) “Ловушки”. Наличие локальных минимумов. Решается путем изменения структуры нейронной сети, а именно - увеличением числа нейронов второго слоя.

3) “Паралич” сети. Возникает в двух случаях.

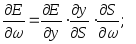

Для логистической функции:

a) Если , то обучение блокируется.

б) , если X=0, то обучение блокируется.

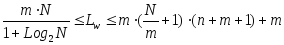

4) Перетренировка сети. Связана с неправильным выбором количества нейронов. Сеть теряет свою основную способность к обобщению. Эта ситуация возникает если выбрано слишком большое количество нейронов. Нейронная сеть просто запоминает входные образы. Для разрешения этой проблемы структуру нужно упростить.

а) Lw – количество нейронов в скрытых слоях;

m – количество выходов ;

n – количество входов ;

N – размер обучающей выбоки.

б) Создание кросс-проверки. Часть обучающего множества выделяют и создают контрольное множество кросс-проверки. Оно не участвует в обучении.

В процессе обучения ошибка на обучаемом множестве уменьшается и количество обращений к контрольному множеству тоже, что говорит о желаемой ситуации. Если обе ошибки не достигают малого значения, то сеть, наоборот, слишком простая. Существуют и другие способы.

30. Генетические алгоритмы. Определение. Назначение. Сущность естественного отбора в природе [1/1]

Генетические алгоритмы – достаточно простая модель эволюции в природе, реализованная в виде компьютерной программы, которая воспроизводит механизмы естественного отбора и генетического наследования. Основное назначение генетических алгоритмов заключается в решении поисковых задач (например, поиска оптимума), которые характеризуются большой размерностью пространства поиска решения.

Естественный отбор – это дифференциальное выживание и размножение особей, которые отличаются друг от друга генетически детерминированными признаками. Более приспособленные к условиям окружающей среды особи оставляют больше потомков, чем менее приспособленные, что в конечном счете влияет на приспособленность всей популяции.

31. Основные понятия генетических алгоритмов [1/1]

1) Хромосома – вектор (последовательность) из нулей и единиц.

2) Ген – одна позиция (бит) хромосомы.

3) Аллель - значение гена.

3) Особь (генотип, индивидуум, структура) – вариант решения задачи в закодированном виде. Иначе, это точка в многомерном пространстве для оптимизируемой функции f(x1,x2,….,xn)->max.

4) Популяция – множество особей, образованное на i-m шаге выполнения генетических алгоритмов.

5) Фенотип – множество декодированных значений, соответствующих генотипу.

6) Кроссовер – операция, при которой хромосомы обмениваются своими частями.

7) Локус – позиция (номер гена) в хромосоме

8) Мутация – случайное изменение одной или нескольких позиций в хромосоме.

9) Функция приспособленности (fitness function) – функция оценки, которая определяет меру приспособленности данной особи в популяции и позволяет выбрать из множества особей наиболее приспособленную. В соответствии с эволюционным принципом выживания сильнейших.

Виды функций приспособленности. Если решается задача оптимизации, то функция приспособленности – сама целевая функция. При этом если ищется максимум, то функция не модифицируется. Если же ищется минимум, то функция приспособления модифицируется так, чтобы опять свести задачу к максимизации.

Если задача теории управления, то функция приспособленности это функция ошибки ε. Если теория игр, то функция приспособленности – это стоимостная функция

10) Поколение – очередная популяция на i-м шаге.