- •1. Определение ии. Определение слабоформализуемых задач и их примеры. Определение сложных систем.[1/1]

- •2. История развития исследований в области ии.[1/1]

- •3. Основные свойства естественного интеллекта (еи).[1/1]

- •4. Основные направления исследований в области ии. Две точки зрения на развитие сии. [1/1]

- •5. Нечеткая логика. Краткие исторические сведения. Аспекты неполноты информации [1/1]

- •6. Определения четких и нечетких множеств. Определение нечеткого множества. Функция принадлежности. Примеры нечетких дискретных и непрерывных множеств. [1/2]

- •7. Основные свойства нечетких множеств. Нечеткое число и нечеткий интервал.[1/3]

- •*7. Основные свойства нечетких множеств. Нечеткое число и нечеткий интервал.[2/3]

- •*7. Основные свойства нечетких множеств. Нечеткое число и нечеткий интервал.[3/3]

- •8. Понятия фаззификации, дефаззификации, лингвистической переменной. Пример. [1/1]

- •9. Операции с нечеткими множествами (эквивалентность, включение, нечеткая операция «и», «или», «не»). [1/2]

- •10.Обобщение операций пересечения и объединения в классе т-норм и s-конорм[1/2].

- •11. Нечеткие отношения. Композиционные правила (max-min) и (max-prod). Примеры. [1/1]

- •12. Нечеткие алгоритмы. Обобщенная схема процедуры нечеткого логического вывода. [1/2]

- •13. Нечеткие алгоритмы. Метод максимума-минимума (метод Мамдани) как метод нечеткого логического вывода (изложение необходимо сопроводить примером). [1/2]

- •14. Нечеткие алгоритмы. Метод максимума-произведения (метод Ларсена) как метод нечеткого логического вывода (изложение необходимо сопроводить примером)[1/1].

- •15.Методы дефаззификации[1/1].

- •16.Процедура (схема) нечеткого логического вывода. Пример нечеткого логического вывода для выполнения нескольких правил. Достоинства и недостатки систем, основанных на нечеткой логике[1/2].

- •17.Искусственные нейронные сети. Особенности биологического нейрона. Модель искусственного нейрона [1/2].

- •18.Определение искусственной нейронной сети (инс). Однослойный и многослойный персептроны [1/1].

- •19. Классификация инс. Задачи, решаемые с помощью нейронных сетей [1/2].

- •20.Основные этапы нейросетевого анализа. Классификация известных нейросетевых структур по типу связей и типу обучения и их применение [1/1].

- •21. Алгоритм обучения с учителем для многослойного персептрона [1/1]

- •22. Алгоритмы обучения нейронных сетей. Алгоритм обратного распространения ошибки [1/1]

- •23. Проблемы обучения нс[1/1].

- •24. Сети Кохонена. Постановка задачи кластеризации. Алгоритм кластеризации[1/1].

- •25. Преобразование алгоритма кластеризации с целью реализации в нейросетевом базисе. Структура сети Кохонена [1/1]

- •26. Алгоритм обучения без учителя для сетей Кохонена. Обобщенная процедура [1/1]

- •27. Алгоритм обучения без учителя для сетей Кохонена. Метод выпуклой комбинации. Графическая интерпретация [1/1]

- •28. Самоорганизующиеся карты (сок) Кохонена. Особенности обучения сок. Построение карт [1/1]

- •29. Проблемы обучения инс [1/1]

- •30. Генетические алгоритмы. Определение. Назначение. Сущность естественного отбора в природе [1/1]

- •31. Основные понятия генетических алгоритмов [1/1]

- •32. Блок-схема классического генетического алгоритма. Особенности инициализации. Пример. [1/1]

- •33. Блок-схема классического генетического алгоритма. Селекция хромосом. Метод рулетки. Пример.[1/2]

- •33. Блок-схема классического генетического алгоритма. Селекция хромосом. Метод рулетки. Пример.[2/2]

- •34. Блок-схема классического генетического алгоритма. Применение генетических операторов. Пример.[1/1]

- •35. Блок-схема классического генетического алгоритма. Проверка условия остановки га.[1/1]

- •36. Достоинства генетических алгоритмов.[1/1]

- •37. Гибридные сии и их виды.[1/2]

- •38. Структура мягкой экспертной системы.[1/1]

- •39.Методология разработки интеллектуальных систем. Виды прототипов экспертных систем.[1/1]

- •40.Обобщенная структура основных этапов разработки экспертных систем.[1/2]

- •1. Идентификация.

- •2. Концептуализация.

- •3. Формализация

- •4. Программирование.

- •5. Тестирование на полноту и целостность

25. Преобразование алгоритма кластеризации с целью реализации в нейросетевом базисе. Структура сети Кохонена [1/1]

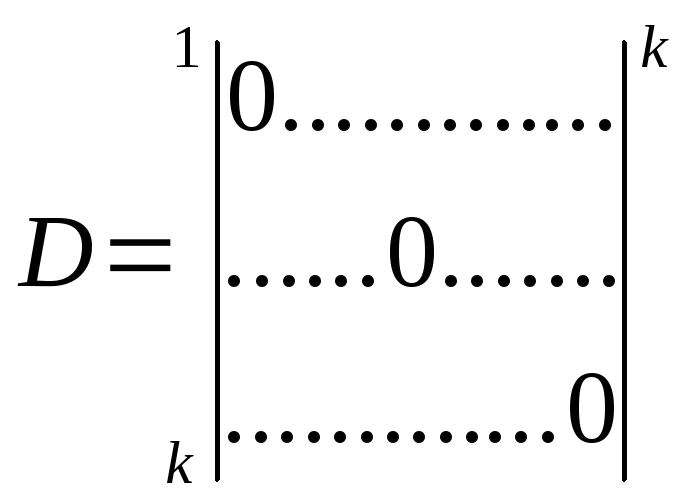

1. Количество входов – m, количество выходов – k. Выходы нейронной сети (НС) интерпретируется как вероятности принадлежности объектов к тому или иному классу. И ответом признается выход с максимальным значением.

2.

Преобразуем следующий критерий

![]() ,

в нашем случае:

,

в нашем случае:![]() .

.

![]() .

.

Объект будет относиться к тому кластеру, у которого критерий (*) будет максимальным.

3. Реализация в нейросетевом базисе. Псевдокод для вычисления критерия (*).

цикл для p=1,n

цикл для l=1,k

![]() (**)

(**)

конец цикла l

![]()

конец цикла p

При реализации в нейросетевом базисе: (**) – соответствует одному нейрону, цикл по l соответствует слою нейронов, для поиска l0 – используется блок-интерпретатор, а цикл по p реализуется в процедуре обучения.

П римечание:

римечание:

Каждый нейрон слоя

Коханена запоминает

с помощью своих

весовых коэф-тов

коэф-ты ядра кластера,

за который он отвечает

26. Алгоритм обучения без учителя для сетей Кохонена. Обобщенная процедура [1/1]

Инициализация весов

малые случайные числа;

равномерная инициализация;

Для случая n=k обучение не проводится. Для нормальной работы n>>k.

специальные методы инициализации.

Обучающая выборка:

Рассчитывается l0 – прямой проход по сети.

Корректировка весов сети Кохонена.

традиционный способ;

Корректируются веса только нейрона победителя:

![]() α

– скорость обучения (0<α<1) монотонно

убывает. Смысл корректировки весов

заключается в попытке приблизить

координаты нейрона – победителя к

входному образу вектора. Обучение

продолжается до тех пор пока координаты

весов не перестанут изменяться. По

окончанию обучения каждый нейрон

отвечает за определение кластера.

α

– скорость обучения (0<α<1) монотонно

убывает. Смысл корректировки весов

заключается в попытке приблизить

координаты нейрона – победителя к

входному образу вектора. Обучение

продолжается до тех пор пока координаты

весов не перестанут изменяться. По

окончанию обучения каждый нейрон

отвечает за определение кластера.

метод выпуклой комбинации;

модифицированные алгоритмы.

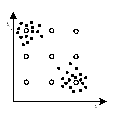

27. Алгоритм обучения без учителя для сетей Кохонена. Метод выпуклой комбинации. Графическая интерпретация [1/1]

Инициализация весов

малые случайные числа;

равномерная инициализация;

специальные методы инициализации.

Обучающая выборка:

Рассчитывается l0 – прямой проход по сети.

Корректировка весов сети Кохонена.

традиционный способ;

2) метод выпуклой комбинации;

3) модифицированные алгоритмы.

Метод выпуклой комбинации:

1. Инициализация ядер кластеров производиться по правилу: i-му весу l-го ядра присваивается одинаковое значение.

![]() ,

гдеn

– количество векторов (объектов)

,

гдеn

– количество векторов (объектов)

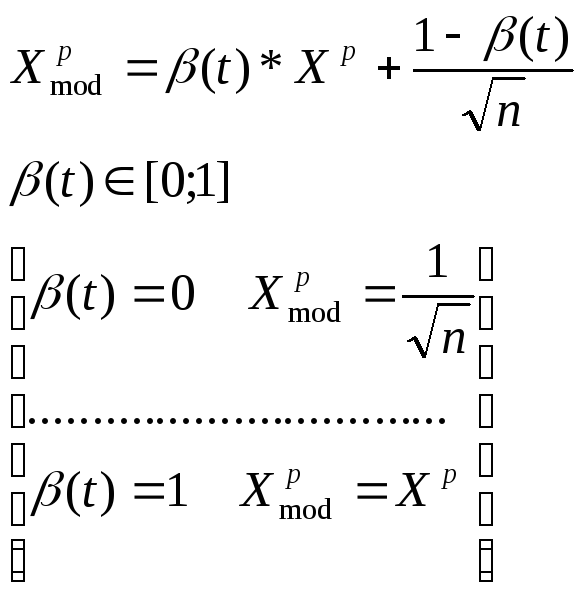

2. Множество X модифицируется в другое множество Xmod .

X→ Xmod

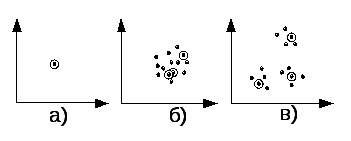

В

процессе обучения обучающие вектора

расходятся от значения ![]() к

своим истинным значениям. При этом

особенность обучения заключается в

следующем: в процессе движения к своим

истинным значениям обучающие вектора

захватывают ядра кластеров пропорционально

своей плотности распределения, а далее

каждое ядро кластеров отслеживает

движение обучающих векторов по мере

роста

к

своим истинным значениям. При этом

особенность обучения заключается в

следующем: в процессе движения к своим

истинным значениям обучающие вектора

захватывают ядра кластеров пропорционально

своей плотности распределения, а далее

каждое ядро кластеров отслеживает

движение обучающих векторов по мере

роста ![]() .Графическая

интерпретация:

.Графическая

интерпретация:

![]()

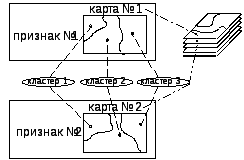

28. Самоорганизующиеся карты (сок) Кохонена. Особенности обучения сок. Построение карт [1/1]

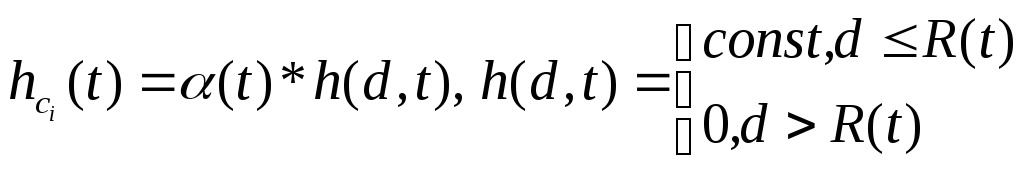

Построение карт введется по результатам работы сети Кохонена. СОК – это самоорганизующаяся структура, которая представлена в виде двухмерной сетки (т.е. решетки), в узлах которой находятся нейроны. Для построения СОК, обучение сети Кохонена ведется с учетом следующих особенностей:

Модификации подвергаются веса не только нейрона победителя, но его соседей.

m-мерное

пространство, R-радиус

m-мерное

пространство, R-радиус

На первых шагах R-большое, далее снижается до 0.

Обучение

производиться по следующей формуле: ![]() ,где

,где

![]() -

функция соседства нейронов,

-

функция соседства нейронов,

2. Построение карты ведется путем решения проблемы проецирования матрицы расстояний между нейронами на плоскость, при этом часто используется метод главных компонент.

Карта – это проекция матрицы расстояний между нейронами на плоскость с ее окраской по одному из признаков вектора X при этом интенсивность цвета окраски этой карты соответствует изменениям этого признака в заданном диапазоне. Этому диапазону ставиться весь спектр цветов (от синего до красного). Таких карт может быть построено столько, сколько признаков имеет входной вектор X (равно m). Положение объектов на каждой карте строго фиксировано.Анализ карт позволяет дать быструю качественную характеристику кластерам, т.е. выявить правила классификации.