- •Лекція №1

- •1.1 Опрацювання результатів прямих вимірювань

- •1.1.1 Принципові основи оцінювання похибок вимірювань

- •1.1.2 Оцінка результату і похибки прямих вимірювань

- •1.1.3 Оцінка похибки прямих одноразових вимірювань

- •1.1.4 Оцінка результату і похибки прямих багаторазових вимірювань

- •1.1.5 Опрацювання результатів прямих одноразових вимірювань

- •1.1.6 Опрацювання результатів багаторазових прямих вимірювань

- •1.1.7 Опрацювання результатів прямих нерівноточних вимірювань

- •1.2 Опрацювання результатів опосередкованих вимірювань

- •1.2.1 Оцінка результату і похибки опосередкованих вимірювань

- •1.2.2 Опрацювання результатів опосередкованих вимірювань з лінійною залежністю

- •1.2.3 Опосередковані вимірювання при нелінійній залежності

- •1.2.4 Систематична похибка опосередкованих вимірювань при нелінійній залежності

- •1.2.5 Результат і похибка опосередкованих вимірювань

- •1.3 Оцінка результатів і похибок сумісних та сукупних вимірювань

- •Питання для самоперевірки

- •Лекція №2

- •2 Статистична перевірка гіпотез

- •2.1 Поняття статистичної гіпотези. Припустима і критична області. Статистичний критерій

- •Питання для самоперевірки

- •2.2 Гіпотези про параметри розподілу. Виникнення помилок першого та другого роду. Визначення обсягу випробувань

- •Питання для самоперевірки

- •2.3 Параметричні критерії розбіжностей для двох сукупностей. Критерії Фішера і Кохрена

- •Питання для самоперевірки

- •2.4 Критерії згоди

- •Питання для самоперевірки

- •2.5 Непараметричні критерії

- •Питання для самоперевірки

- •2.6 Перевірка гіпотез відносно частки ознаки порівняння двох вибірок

- •Питання для самоперевірки

- •Завдання планування експерименту

- •Лукція №3

- •3. Регресійний аналіз

- •3.1 Кореляційна залежність

- •3.2 Два основних завдання вимірювання зв’язків

- •3.3 Емпірична лінія регресії

- •3.4 Метод найменших квадратів

- •3.5 Множинний регресійний аналіз

- •3.6 Нелінійна регресія

- •Лекція №4

- •4. Активний експеримент

- •4.1 Ортогональні плани першого порядку

- •4.2 Повний факторний експеримент

- •4.3 Дисперсія відтворюваності

- •4.4 Оцінка адекватності апроксимуючої залежності досліджуваного

- •4.5 Оцінка значущості коефіцієнтів апроксимуючої залежності, взятій у вигляді алгебраїчного полінома, в сенсі відмінності значень цих коефіцієнтів від нуля

- •4.6 Обробка результатів експерименту

- •4.7 Дрібний факторний експеримент

- •4.8 Складання планів другого порядку

- •4.9 Ортогональні центрально-композиційні плани

- •Лекція №5

- •5. Планування експерименту при відшуканні екстремальної області

- •5.1 Класичні методи визначення екстремуму

- •5.2 Факторні методи визначення екстремуму

- •Лекція №6

- •6. Дисперсійний аналіз при експериментальному дослідженні

- •6.1 Однофакторний дисперсійний аналіз

- •Лекція №7

- •7. Приклади та завдання

- •Список літератури

Питання для самоперевірки

-

Які критерії називаються параметричними?

-

Як перевіряється гіпотеза про середнє значення з відомим СКВ?

-

Як перевіряється гіпотеза про середнє значення з невідомим СКВ?

-

Як перевіряється гіпотеза про дисперсії?

-

Як перевіряється гіпотеза про наявність зсуву?

-

Як обчислюється ймовірність помилки першого роду?

-

Як обчислюється ймовірність помилки другого роду?

-

Що характеризує параметр А при визначенні необхідного обсягу випробувань?

-

Як обчислюється необхідний обсяг випробувань?

2.3 Параметричні критерії розбіжностей для двох сукупностей. Критерії Фішера і Кохрена

Параметричні критерії можна застосовувати при визначенні розбіжності параметрів розподілу сукупностей.

Порівняння двох середніх. Завдання такого плану трапляються тоді, коли необхідно переконатися в тому, чим викликана розбіжність середніх, отриманих на підставі наявних двох вибірок з однієї генеральної сукупності випадкових величин X і Y обсягами n1 і n2. Іншими словами, чи зумовлена ця розбіжність впливом випадкових величин і обмеженим обсягом вибірки або ж справді існує розбіжність між центрами розподілів (систематичними похибками приладів, продуктивністю праці, довговічністю, надійністю тощо).

Для випадку з відомим СКВ генеральних сукупностей.

Відомі

σx і

σy величин

X і Y. Висуваємо

гіпотезу H0:

vх=vy

при

альтернативній H1:

vх ≠

vy.

Необхідно визначити, чи істотна

розбіжність між середніми ![]() і

і

![]() ,

отриманими

відповідно з вибірки обсягом п1

для

випадкової величини Хі

обсягом

п2

для

випадкової величини Y.

,

отриманими

відповідно з вибірки обсягом п1

для

випадкової величини Хі

обсягом

п2

для

випадкової величини Y.

Позначимо

![]()

Розглянемо різницю и як параметр Z, тобто у вигляді нормованої різниці

![]()

де

![]() а

при висунутій гіпотезі

а

при висунутій гіпотезі

![]()

Величини

Хі

Y

— незалежні величини, для яких

![]() тому

можна записати

тому

можна записати

![]() (2.7)

(2.7)

Для перевірки правильності гіпотези використовують двобічну критичну область. З урахуванням виразу (16.1) значення статистичної характеристики

Значення

z

порівнюють

із критичним значенням ![]() Якщо

Якщо

![]() приймають

гіпотезу Н0.

приймають

гіпотезу Н0.

Для випадку з невідомими СКВ генеральних сукупностей. У цьому разі визначають емпіричне значення s і використовують статистичну характеристику

![]()

розподілену за законом Стьюдента.

Відомо, що для незалежних випадкових величин

![]()

За

умови, що вибірки взято з однієї

генеральної сукупності, тобто ![]() можна

записати

можна

записати

![]()

або

![]() (2.8)

(2.8)

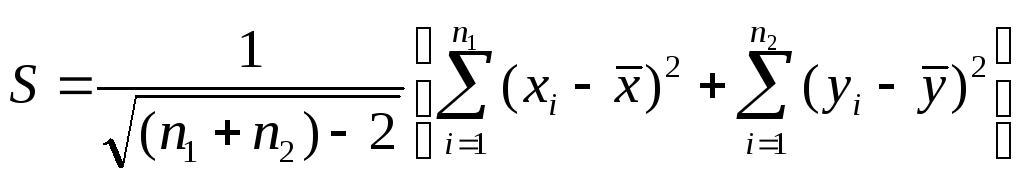

Зважаючи на те, що вибірки взято з однієї генеральної сукупності, доцільно скористатися всіма наявними експериментальними даними, тобто розглядати вибірку обсягом п1 + п2. Це дає змогу підвищити статистичну надійність знайденої оцінки СКВ генеральної сукупності. Тоді

(2.9)

(2.9)

Виходячи з виразу для дисперсії, можна записати:

![]()

Аналогічно маємо:

![]()

Підставляють отримані значення сум у вираз (2.9) і дістають:

![]() (2.10)

(2.10)

Підставляють вираз (2.10) у вираз (2.8) і отримують

(2.11)

(2.11)

З урахуванням виразу (2.11) розрахункове значення коефіцієнта Стьюдента буде

Для перевірки гіпотези необхідно знайти критичне значення коефіцієнта Стьюдента tкр Для заданого рівня статистичної значущості α і кількості ступенів свободи п1 + п2.- 2. Якщо розрахункове значення |tр| ≤ tкр, приймають нульову гіпотезу.

У

випадку, коли вибірки взято не з однієї

генеральної сукупності, тобто ![]() для

визначення суттєвості розбіжності

обчислених середніх

для

визначення суттєвості розбіжності

обчислених середніх ![]() і

і

![]() коефіцієнт

Стьюдента обчислюють за формулою:

коефіцієнт

Стьюдента обчислюють за формулою:

Обчислене

значення

![]() порівнюють

із критичним значенням коефіцієнта

Стьюдента, яке залежно від α

і кількості ступенів свободи обчислюють

за формулою

порівнюють

із критичним значенням коефіцієнта

Стьюдента, яке залежно від α

і кількості ступенів свободи обчислюють

за формулою

![]()

де

Порівняння двох дисперсій. Другою важливою ознакою, за якою можуть порівнюватися дві сукупності, є дисперсії в кожній із них. Гіпотези про дисперсії відіграють важливу роль у техніці, оскільки саме дисперсія характеризує такі важливі конструкторські й технологічні показники, як точність приладу, похибку результату, точність технологічного процесу тощо.

При спільній обробці результатів необхідно, насамперед, переконатися в тому, що умови проведення дослідів, при яких отримані результати, були однаковими. З цією метою можна використати оцінку розбіжності дисперсій.

F-критерій

(розподіл Фішера).

Припустимо,

що задано дві генеральні сукупності

X

та

Y

з нормальним розподілом X

![]() N

(µ1,

σ1)

і

Y

N

(µ1,

σ1)

і

Y

![]() N

(µ2,

σ2).

Із

цих генеральних сукупностей зроблено

незалежні вибірки з параметрами

відповідно п1,

N

(µ2,

σ2).

Із

цих генеральних сукупностей зроблено

незалежні вибірки з параметрами

відповідно п1,

![]() ,

п2,

,

п2,![]() .

Потрібно при рівні значущості α

перевірити гіпотезу

.

Потрібно при рівні значущості α

перевірити гіпотезу

![]() при

альтернативній гіпотезі.

при

альтернативній гіпотезі.![]()

Математик-статистик

Р. Фішер установив, що відношення

незсунених оцінок двох дисперсій

підпорядковується закономірності, що

залежить від кількості ступенів свободи

цих дисперсій. Припускаючи, що![]() ,

приймають як статистику величину F,

котра

задовольняє F-розподіл,

для

якого

,

приймають як статистику величину F,

котра

задовольняє F-розподіл,

для

якого  з

кількістю ступенів свободи, що дорівнює

п1

– 1 і п2

–

1 відповідно.

з

кількістю ступенів свободи, що дорівнює

п1

– 1 і п2

–

1 відповідно.

Критична

область буде тільки правобічна

і

визначається умовою .![]()

Значення

![]() знаходять

із таблиць F-розподілу,

яке залежить від трьох величин: рівня

значущості α

і двох чисел, якими виражаються ступені

свободи

знаходять

із таблиць F-розподілу,

яке залежить від трьох величин: рівня

значущості α

і двох чисел, якими виражаються ступені

свободи ![]() .

Таблиці

складені окремо для кожного значення

α

(тривимірні таблиці). Задаючись рівнем

статистичної значущості α,

вибравши

в таблиці колонку

.

Таблиці

складені окремо для кожного значення

α

(тривимірні таблиці). Задаючись рівнем

статистичної значущості α,

вибравши

в таблиці колонку ![]() і рядок

і рядок ![]() ,

на їх перетині знаходять критичне

значення коефіцієнта

,

на їх перетині знаходять критичне

значення коефіцієнта

![]() .

.

Якщо

![]() можна

стверджувати на підставі наявних

експериментальних даних, що при рівні

статистичної значущості а вибіркові

дисперсії будуть однорідні.

можна

стверджувати на підставі наявних

експериментальних даних, що при рівні

статистичної значущості а вибіркові

дисперсії будуть однорідні.

Іноді перед обробкою даних необхідно переконатися в однорідності дисперсій, отриманих на підставі даних двох експериментальних вибірок. У цьому випадку також використовується критерій Фішера.

Відмінністю

є те, що альтернативна гіпотеза

![]() .

Для

перевірки гіпотези використовують

двобічну критичну область (рис. 2.8), тобто

передбачається, що ймовірність того,

що розрахункове значення

.

Для

перевірки гіпотези використовують

двобічну критичну область (рис. 2.8), тобто

передбачається, що ймовірність того,

що розрахункове значення

![]() буде

меншим за критичне значення

буде

меншим за критичне значення

![]() або

більшим за

або

більшим за

![]() не

перевищує значення

не

перевищує значення

![]()

Оскільки

в таблиці є тільки значення

![]() ,

то

значення

,

то

значення

![]() можна

знайти безпосередньо з таблиць.

можна

знайти безпосередньо з таблиць.

Рис. 2.8

Для

визначення

![]() ,

яке

відповідає умові

,

яке

відповідає умові

![]() ,

вводять

коефіцієнт

,

вводять

коефіцієнт

![]()

Тоді

![]()

Останнє

співвідношення показує, що

![]() можна

знайти виходячи з умови

можна

знайти виходячи з умови

![]() .

Надалі перевірка залишається такою

самою, як і для однобічної критичної

області, тобто нуль-гіпотеза, приймається

в тому випадку, коли розрахункові

значення

.

Надалі перевірка залишається такою

самою, як і для однобічної критичної

області, тобто нуль-гіпотеза, приймається

в тому випадку, коли розрахункові

значення

![]() містяться

між критичними

містяться

між критичними

![]() й

й

![]() .

.

Перевірка гіпотези про однорідність ряду дисперсій. (G-критерій). Якщо потрібно побудувати аналітичну залежність (аналітичну модель) на основі експериментальних даних, то насамперед необхідно переконатися в однорідності вибіркових дисперсій. Для цього серед наявних вибіркових дисперсій вибирають максимальну, а потім розглядають відношення максимальної дисперсії до суми всіх вибіркових дисперсій. Для випадку, коли обсяги вибірок однакові, тобто в кожній вибірці дисперсія обчислювалася на підставі однакової кількості даних m, застосовують G-критерій (критерій Кохрена). Статистика G вказує, яку частку має максимальна дисперсія в загальній дисперсії, і обчислюється за формулою:

де

![]() —

дисперсія для кожної i-ї

вибірки, і=1,

—

дисперсія для кожної i-ї

вибірки, і=1,

![]()

Висувають

гіпотезу Н0:

дисперсії однорідні. Для перевірки

нульової гіпотези знайдене розрахункове

значення Gр

порівнюють

із критичним значенням коефіцієнта

Gкр,

яке знаходять із таблиць критичних

значень G-критерію

на перетині стовпця

![]() та

рядка

та

рядка

![]() для

заданого рівня статистичної значущості

α.

для

заданого рівня статистичної значущості

α.

Якщо

![]() на

підставі наявних даних можна стверджувати,

що вибіркові дисперсії будуть однорідні,

тобто гіпотеза Н0

приймається.

на

підставі наявних даних можна стверджувати,

що вибіркові дисперсії будуть однорідні,

тобто гіпотеза Н0

приймається.

Якщо гіпотеза про рівність дисперсій відхиляється, то збільшують обсяг вибірок і знову перевіряють гіпотезу. Якщо ж гіпотеза знову не підтверджується, такі вибіркові дані спільно обробляти не можна