- •Краткие сведения из математической статистики

- •Экспериментально-статистические модели

- •Порядок работы с программой numeri

- •Лабораторная работа №1 оценивание случайных параметров

- •Лабораторная работа №2 выявление скрытых периодичностей в случайном процессе

- •Лабораторная работа №3 регрессионные модели

- •Лабораторная работа №4 моделирование колебательных систем

- •Лабораторная работа №5 моделирование и оптимизация электромеханической системы привода прокатных валков

- •Лабораторная работа №6 моделирование и оптимизация дутьевого режима доменной печи

- •1, 2, 3, 4 - Однофакторные эксперименты,

- •5, 6, 7, 8 - Многофакторные эксперименты,

- •Лабораторная работа №7 модель-тренажер оператора прокатного стана

- •Лабораторная работа №8 стохастическая идентификация многомерного объекта

Краткие сведения из математической статистики

СЛУЧАЙНЫЕ ВЕЛИЧИНЫ

Случайной называют величину, которая в результате опыта может принять то или иное значение, заранее неизвестное. Случайная величина (СВ) может быть как дискретной так и непрерывной.

СВ полностью определена, если известно, с какой вероятностью pi возможно появление каждого из принимаемых случайной величиной значений xi.

В качестве меры вероятности pj принимают относительную частоту (частость) появления конкретного значения xi случайной величины

![]() , ( 1 )

, ( 1 )

где nj - количество появлений величины xi в N опытах.

Закон распределения дискретной случайной величины Х, которая в результате опыта примет одно из хj (j=1, 2, …, n) возможных значений, можно представить в виде таблицы.

|

x1 |

x2 |

x3 |

… |

xn |

|

p1 |

p2 |

p3 |

… |

pn |

Функция распределения дискретной случайной величины имеет вид

![]() . ( 2 )

. ( 2 )

Когда переменная Х проходит через возможное значение xj, функция F(х) меняется скачкообразно.

Для непрерывной случайной величины рассматривают вероятность, что ее значение не превысит Х<х, где х - некоторая текущая переменная. Ее функция распределения

![]() . ( 3 )

. ( 3 )

Функция распределения всегда удовлетворяет условию

![]() . ( 4 )

. ( 4 )

ПЛОТНОСТЬ ВЕРОЯТНОСТИ

Вероятность того, что случайная величина Х примет значение, находящееся внутри интервала (x, x+Dx) - это плотность вероятности.

![]() . ( 5 )

. ( 5 )

Связь между функцией распределения и плотностью вероятности

![]() . ( 6 )

. ( 6 )

ЧИСЛОВЫЕ ХАРАКТЕРИСТИКИ СЛУЧАЙНЫХ ВЕЛИЧИН

Точечные оценки.

Среднее арифметическое значение (математическое ожидание)

![]() , ( 7 )

, ( 7 )

где N - число испытаний,

xi- значения случайной величины, которые она принимала при этих испытаниях.

Характеристики разброса значений дискретной случайной величины

дисперсия

![]() ; ( 8 )

; ( 8 )

среднеквадратичное отклонение

![]() ; ( 9 )

; ( 9 )

коэффициент вариации

![]() . ( 10 )

. ( 10 )

Интервальные оценки.

При ограниченном

количестве опытов пользуются доверительными

интервалами

для оценок случайной величины X.

С доверительной вероятностью p

истинное среднее значение

![]() лежит в интервале

лежит в интервале

![]() . ( 11 )

. ( 11 )

Границы интервала определяются по критерию Пирсона (c2-тест) в зависимости от p и объема выборки N.

Для непрерывных случайных величин

математическое ожидание (1-й момент выборки)

![]() ; ( 12 )

; ( 12 )

дисперсия (2-й момент выборки)

![]() . ( 13 )

. ( 13 )

ЗАКОНЫ РАСПРЕДЕЛЕНИЯ ПЛОТНОСТИ ВЕРОЯТНОСТИ

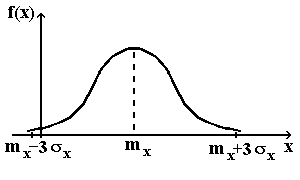

Нормальный закон распределения (закон Гаусса) (рис. 1) имеет плотность распределения

Рис. 1. Нормальный

закон распределения

,

( 14 )

,

( 14 )

является одним из наиболее распространенных и часто применяемых на практике, например, при анализе ошибок измерений, точности обработки и в других случаях, когда отклонения x вызваны действием большого количества факторов, которые складываются.

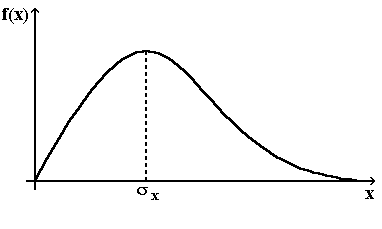

Закон распределения Релея.

Рис. 2. Закон

распределения Релея

Случайные величины, при-нимающие только положительные значения, часто подчиняются функции распределения Релея

( 15 )

( 15 )

Распределение Релея является однопараметрическим, т.е. зависит только от параметра sx.

Закон распределения Пуассона.

Дискретную случайную величину Х называют распределенной по закону Пуассона, если ее возможные значения равны 0, 1, 2, ..., n, а вероятность того, что Х=n, выражается зависимостью

![]() , ( 16 )

, ( 16 )

где а>0.

Математическое ожидание и дисперсия случайной величины Х, распределенной по закону Пуассона, mx=a и Dx=a2.

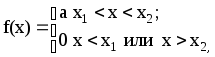

Закон равномерного распределения.

Рис. 3.

Закон равномерного распределения

В этом случае плотность распределения

![]() .

( 17 )

.

( 17 )

Математическое ожидание и дисперсия такой случайной величины Х,

![]() , ( 18 )

, ( 18 )

![]() . ( 19 )

. ( 19 )

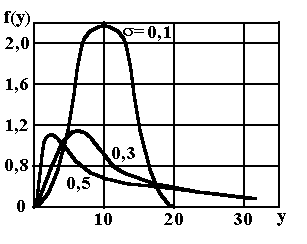

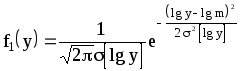

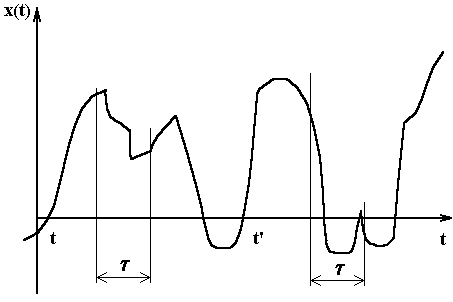

Закон логарифмически нормального распределения.

Рассмотрим случайные величины x и y, связанные соотношением х = lg y. Если случайная величина х распределена нормально, то плотность распределения y равна

Рис. 4. Закон

логарифмического распределения

.

( 20 )

.

( 20 )

Этот закон характерен для случайных величин, разброс которых вызван действием многих случайных факторов, которые перемножаются.

Характер поведения функции f(y) в зависимости от у для ряда значений s при lg m = 1 показан на рис. 4.

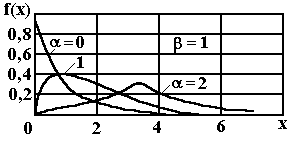

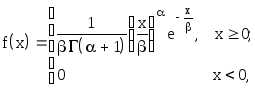

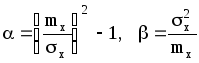

Закон гамма-распределения.

Рис. 5. Закон

гамма-распределения

(21)

(21)

где a

>

-1; b

>

0; Г (a+1)=![]() - гамма-функция .

- гамма-функция .

Характерен для случайных величин, ограниченных слева (по минимуму), например, для длительности выполнения технологических операций.

Параметры гамма-распределения

. ( 22 )

. ( 22 )

При больших значениях параметра a гамма-распределение переходит в нормальное распределение. Если положить в b=1/l и a=k, где k-целое положительное число, то получим закон распределения Эрланга

![]() ,

( 23 )

,

( 23 )

а при k =1 получим экспоненциальный закон распределения

![]() , ( 24 )

, ( 24 )

которые используют в теории надежности.

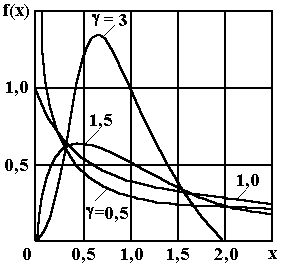

Закон распределения Вейбулла.

Рис. 6. Закон

распределения Вейбулла.

,

( 25 )

,

( 25 )

где xa, x0 и g - параметры распределения.

В частном случае, когда xa = 0 и x0 = 1,

![]() .

( 26 )

.

( 26 )

Характерен для случайных величин, ограниченных слева, например, для наработки системы на отказ, времени устранения отказа и других показателей теории надежности.

СВЯЗЬ МЕЖДУ СЛУЧАЙНЫМИ ВЕЛИЧИНАМИ

При изучении зависимости между двумя величинами, каждая из которых подвергается случайному рассеиванию (неконтролируемому разбросу), применяются методы корреляционного анализа. Корреляционный анализ изучает усредненный закон поведения каждой из величин в зависимости от значений другой величины, а также меру зависимости между рассматриваемыми величинами. Сопоставляя каждому значению одной величины x, среднее из соответствующих значений другой величины y, мы получаем функцию регрессии или просто регрессию y на x. Функция регрессии изображается графически линией регрессии.

Коэффициентом корреляции rxy между случайными величинами x и y называется математическое ожидание произведения их нормированных отклонений:

![]()

![]() ,

( 27 )

,

( 27 )

![]() . ( 28 )

. ( 28 )

Для независимых величин x и y коэффициент корреляции равен нулю. Но даже и для зависимых величин коэффициент корреляции может оказаться равным нулю (в этом случае величины x и y называются некоррелированными). Коэффициент корреляции характеризует меру линейной зависимости между величинами x и y.

rxy = 0 означает отсутствие линейной зависимости (но не исключает зависимости нелинейной). Чем ближе ïrxyï к 1, тем теснее линейная зависимость между величинами. Если rxy > 0, то при возрастании x величина y тоже (в среднем) возрастает.

Для экспериментального изучения зависимости между двумя величинами x и y производят некоторое количество n независимых испытаний. Результат i–го испытания дает пару значений xi, yi. По этим значениям определяется эмпирический коэффициент корреляции:

![]() .

( 29 )

.

( 29 )

Даже для независимых величин эмпирический коэффициент корреляции может оказаться отличным от нуля вследствие случайного рассеивания результатов измерения.

Значимость коэффициента корреляции проверяется путем сравнения его величины с ошибкой его оценки при заданной надежности вывода (доверительной вероятности) P.

С вероятностью p можно утверждать, что линейная корреляция значима, если |r*xy|>er, где er - ошибка оценки rxy

![]() , ( 30 )

, ( 30 )

где N - количество опытов,

tc(N, p) - квантили распределения Стьюдента приведены в табл. 1.

Табл. 1

|

|

0.9 |

0.95 |

0.99 |

|

5 |

1.48 |

2.02 |

3.37 |

|

10 |

1.37 |

1.81 |

2.76 |

|

20 |

1.33 |

1.73 |

2.53 |

|

40 |

1.30 |

1.68 |

2.42 |

|

120 |

1.29 |

1.66 |

2.36 |

Характер связи между случайными величинами x и y определяется уравнением регрессии. Уравнения линейной регрессии y на x (аналог функций y(x))

![]() ( 31 )

( 31 )

и регрессии x на y (аналог функций x(y))

![]() . ( 32 )

. ( 32 )

Коэффициенты регрессии (угловые коэффициенты прямых регрессии)

![]() . ( 33 )

. ( 33 )

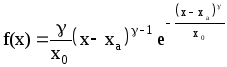

Рис. 7. Прямые

регрессии для обоих

уравнений регрессии

Коэффициенты уравнения регрессии удовлетворяют условию наименьших квадратов.

В случае нелинейной регрессии построение кривых регрессии проводится методом наименьших квадратов. Обычно ограничиваются параболическими зависимостями невысокого порядка, т.е. многочленами степеней 2 и 3.

Множественная корреляция описывает связь между тремя и более случайными величинами.

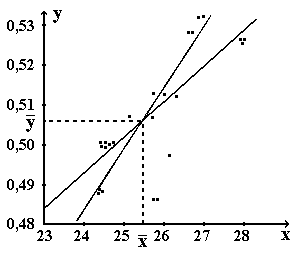

СЛУЧАЙНЫЕ ПРОЦЕССЫ

Случайной называют такую функцию, значение которой при каждом значении детерминированного аргумента является случайной величиной. Случайные функции X(t) времени называют случайными процессами (СП).

Для описания основных свойств случайного одномерного процесса используют неслучайные статистические характеристики:

математическое ожидание СП - характеризует поведение процесса по времени в среднем, определяется по формуле (3), если ni - последовательные отсчеты СП по времени;

дисперсия СП - характеризует рассеяние значений функции относительно среднего значения, определяется по формуле (4);

плотность распределения амплитуд СП;

корреляционная функция - характеризует степень близости соседних значений СП;

спектральная плотность - характеризует внутренние закономерности в СП.

Нестационарным СП называют такой процесс, статистические характеристики которого (хотя бы одна) изменяются во времени.

Рис. 8. Случайная

функция X (t)

![]() .

(34)

.

(34)

Значение при t = 0 равно дисперсии СП Kxx(0) = Dx.

Нормированная АКФ

![]() ,

поэтомуkxx(0) = 1.

,

поэтомуkxx(0) = 1.

СПЕКТРАЛЬНОЕ ПРЕДСТАВЛЕНИЕ СП

Периодическую функцию f(x) можно разложить в ряд Фурье (тригонометрический ряд)

![]() , ( 35 )

, ( 35 )

где a0 - среднее значение f(t) за период;

T - период функции f(t).

Коэффициенты ряда

![]() ,

,![]() ,

,

![]() . ( 36 )

. ( 36 )

Ряд Фурье в комплексной форме

![]() , ( 37 )

, ( 37 )

где

![]() ,

,![]() .

.

Набор частот wk называют спектром функции f(t). В данном случае спектр - дискретный. Приближенный метод разложения в ряд Фурье для непериодической функции состоит в применении предельного перехода при T ® ¥. Действительно, непериодическую функцию можно рассматривать как периодическую при неограниченно возрастающем периоде.

Устремляя T

к бесконечности и полагая, что

![]() ,

частотаDw1

есть частотный интервал между соседними

абсциссами - гармониками, частоты которых

равны

,

частотаDw1

есть частотный интервал между соседними

абсциссами - гармониками, частоты которых

равны

![]() и

и![]() .

При предельном переходе получим, что

приT ® ¥

Dw1 ® dw,

а

.

При предельном переходе получим, что

приT ® ¥

Dw1 ® dw,

а

![]() ®

w,

где w

- текущая частота, изменяющаяся непрерывно.

Сумма в уравнении ( 37 )

перейдет в интеграл, тогда

®

w,

где w

- текущая частота, изменяющаяся непрерывно.

Сумма в уравнении ( 37 )

перейдет в интеграл, тогда

![]() , ( 38 )

, ( 38 )

где спектральная плотность СП

![]() . ( 39 )

. ( 39 )

Формулы ( 38 ) и ( 39 ) - интегралы Фурье, являются основными формулами спектральной теории гармонического анализа СП.

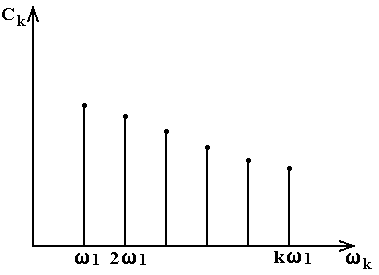

Функция f(t) в виде ( 38 ) имеет непрерывный спектр. Если ряд Фурье дает возможность представить периодическую функцию в виде суммы бесконечного числа синусоид с частотами, имеющими дискретные значения, то интеграл Фурье ( 39 ) представляет непериодическую функцию в виде суммы синусоид с непрерывной последовательностью частот. Спектр периодической функции можно изобразить графически (рис. 9). Каждому дискретному значению частоты (частоты wk гармоник ряда Фурье) соответствует определенное значение коэффициента ряда ck. Спектр, показанный на рис. 9, называют дискретным или линейчатым.

Рис. 9. Спектр

периодической функции

![]() . ( 40 )

. ( 40 )

Из ( 40 ) следует, что S(w) есть амплитуда для интервала частот (w, w+Dw). Значит, S(w) можно рассматривать как «плотность» амплитуд, приходящихся на интервал частот (w, w+Dw). Поэтому функцию S(w) называют спектральной плотностью. S(w) > 0 при любом w.

Спектральная плотность и автокорреляционная функция связаны следующим образом

![]() , ( 41 )

, ( 41 )

![]() . ( 42 )

. ( 42 )