- •Министерство образования и науки, молодёжи и спорта украины

- •Тема 1. Предмет теории информации и количественная мера информации

- •1.2 Этапы обращения информации

- •1.3 Система передачи информации

- •1.4 Задачи и постулаты прикладной теории информации

- •1.5. Количественная оценка информации дискретного источника. Энтропия.

- •1.6 Фундаментальные свойства энтропии

- •Тема 2. Основные виды энтропии дискретных источников. Условная и взаимная энтропии.

- •2.1 Условная энтропия.

- •2.2 Основные свойства условной энтропии.

- •2.3 Взаимная энтропия. Свойства энтропии объединения.

- •Тема 3. Эффективное кодирование источника дискретных сообщений в канале без помех.

- •3.1 Избыточность информации, причины ее появления.

- •3.2 Способы сокращения избыточности.

- •3.3 Теорема Шеннона для канала без помех.

- •4.1 Общие понятия и элементы теории кодирования

- •4.2 Цели кодирования

- •4.3 Оптимальные неравномерные коды

- •4.4 Коды Шеннона-Фэно

- •4.5 Коды Хаффмена

- •4.6 Особенности эффективных кодов.

- •Тема 4. Кодирование источника дискретных сообщений в канале с помехами. Общие принципы помехоустойчивого кодирования.

- •5.1 Кодирование информации для канала с помехами. Теорема Шеннона для канала с помехами.

- •5.2 Общие принципы использования избыточности

- •5.3 Связь корректирующей способности кода с кодовым расстоянием

- •6.1 Корректирующие свойства кодов с избыточностью.

- •6.2 Классификация корректирующих кодов

- •Тема 5. Регулярные методы построения двоичных помехоустойчивых кодов

- •7.1 Линейные коды. Общие медоды построения.

- •7.2 Определение числа добавочных разрядов r.

- •7.3 Построение образующей(порождающей) матрицы |om|.

- •7.4 Порядок кодирования

- •7.5 Порядок декодирования

- •7.6 Систематические коды. Код Хэмминга.

- •7.7 Обнаружение и исправление ошибок в коде Хэмминга

- •8.1 Двоичные циклические коды

- •8.2 Некоторые свойства циклических кодов

- •8.3 Матричное описание циклических кодов

- •8.4 Выбор образующего полинома

- •8.5 Декодирование циклических кодов

- •Тема 6. Построение кодов заданой помехоустойчивости. Применение недвоичных помехоустойчивых кодов.

- •9.1 Матричное описание циклических кодов.

- •9.2 Коды Боуза — Чоудхури — Хоквингема (бчх)

- •9.3 Систематический вид циклического кода.

- •9.4 Коды Рида–Соломона и их применение.

- •9.5 Циклический избыточный код crc

- •Тема 7. Информационные характеристики источников непрерывных сообщений. Источники с максимальной энтропией. Максимальная пропускающая способность канала связи с помехами.

- •10.1 Информационные характеристики источников непрерывных сообщений

- •10.2 Энтропия равномерного закона распределения

- •10.3 Энтропия гауссового закона распределения.

- •11.1 Пропускная способность канала связи с помехами для непрерывных сообщений

- •Тема 8. Методы кодирования информации со сжатием.

- •12.1 Подстановочные или словарно-ориентированные алгоритмы сжатия информации. Методы Лемпела-Зива.

- •13.1 Описание алгоритма сжатия lzw

- •Декодирование по lzw

- •Достоинства и недостатки lzw

- •13.2 Применение lz-алгоритмов упаковки данных

- •14.1 Кодирование длин повторений

- •14.2 Дифференциальное кодирование

- •Тема 9. Методы кодирования со сжатием и с потерями информации..

- •15.1 Методы сжатия с потерей информации

- •15.2 Точность. Помехи и искажения. Приближенное восстановление

- •15.5 Кодирование преобразований. Стандарт сжатия jpeg

- •Или же, в матричной форме,

- •Тема 10. Методы кодирования физических сигналов в компьютерных сетях.

- •16.1 Кодирование на физическом уровне.

- •16.2 Самонихронизирующиеся коды - коды rz и Манчестер-II

- •16.3 Несамосинхронизирующиеся коды. - код nrz

- •16.4 Высокоскоростные коды - код mlt-3 и pam 5

- •Еще более высокоскоростной код - код pam 5

- •16.5 Требуемая полоса частот для передачи данных и ширина спектра сигнала

- •Ширина спектра сигнала

9.5 Циклический избыточный код crc

Циклический избыточный код CRC ( Cyclic Redundancy Check — циклическая избыточная проверка) являются систематическими кодами, предназначенными не для исправления ошибок, а для их обнаружения. Они используют способ систематического кодирования, изложенный выше: «контрольная сумма» вычисляется путем деления xru(x) на g(x). Ввиду того, что исправление ошибок не требуется, проверка правильности передачи может производиться точно так же.

Таким образом, вид полинома g(x) задаёт конкретный код CRC. Эти полиномы стандартизированы и имеют следующий вид. :

-

название кода

степень

полином

CRC-12

12

x12 + x11 + x3 + x2 + x + 1

CRC-16

16

x16 + x15 + x2 + 1

CRC-CCITT

16

x16 + x12 + x5 + 1

CRC-32

32

x32 + x26 + x23 + x22 + x16 + x12 + x11 + x10 + x8 + x7 + x5 + x4 + x2 + x + 1

Тема 7. Информационные характеристики источников непрерывных сообщений. Источники с максимальной энтропией. Максимальная пропускающая способность канала связи с помехами.

Лекция 10

10.1 Информационные характеристики источников непрерывных сообщений

Рассмотрим вопросы, связанные с информативностью и соответствующими характеристиками при передаче непрерывных сообщений (непрерывных функций времени), и выясним, какие особенности имеются в этом случае.

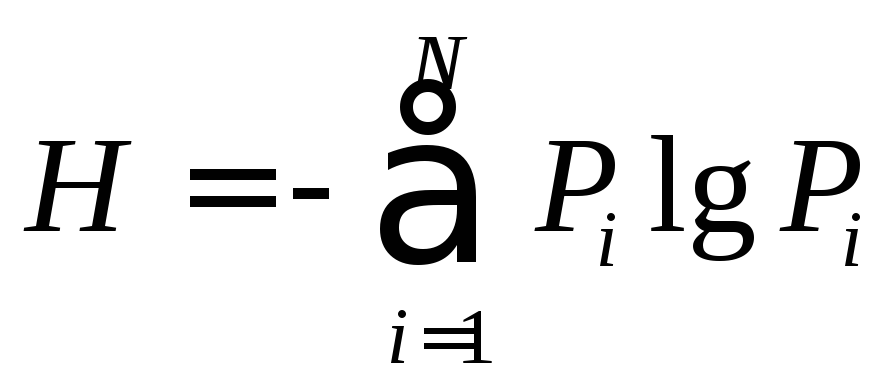

Основные информационные характеристики источников и каналов непрерывных сообщений определяются так же, как и для источников и каналов дискретных сообщений. Формулу для энтропии источника непрерывных сообщений получают путем предельного перехода из формулы для энтропии дискретного источника.

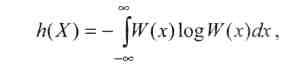

Пусть одномерная плотность распределения вероятностей случайного стационарного процесса X(t) равняется W(x), тогда вероятность того, что X(t) будет находиться в интервале [xi, xi +∆x], равняется pi=W(xi)*∆x. Если сигнал квантован на L уровней, то энтропия источника непрерывных сообщений на один отсчет

![]()

которую называют дифференциальной энтропией источника непрерывных сообщений. Дифференциальной- потому что в ней участвует дифференциальный закон распределения W(x).

Скорость передачи информации, пропускную способность и другие основные информационные характеристики источника сообщений и канала передачи определяют через разницу дифференциальных энтропий.

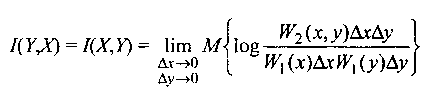

Действительно, найдем, например, взаимную информацию между двумя непрерывными случайными процессами X(t) и Y(t) в произвольный момент времени t.

Считая, что

![]()

где W2(xi, yj) - совместимая плотность вероятности X и Y;

p(xi)=W1(xi)*∆x; p(yj)=W1(yj)*∆y ,

получаем выражение для взаимной информации между X и Y.

Применив для этого выражения сокращения, а после этого предельный переход, получаем

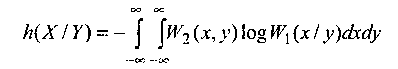

![]()

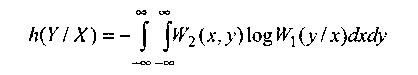

где h(X) и h(Y) - дифференциальные энтропии на отсчет случайных процессов X(t) и Y(t), а

И

Таким образом, взаимная информация является конечной величиной. Отметим, что дифференциальная энтропия не является абсолютной мерой собственной информации, она характеризует только ту часть энтропии непрерывного сообщения, которое определяется видом закона распределения вероятностей W(x). Найдем величину дифференциальной энтропии для конкретных законов распределений вероятностей.