- •Лекція №6

- •6.2. Інтерполяція.

- •6.3 Кореляційний аналіз даних

- •6.3.1 Матриця даних

- •6.3.2 Кореляційний аналіз

- •6.4 Регрессійний аналіз

- •6.4.1 Постановка задачі

- •6.4.2 Вибір виду рівняння регресії

- •1) Дослідник вносить гіпотезу про структуру скриньки

- •2) Визначення невідомих коефіцієнтів і моделі

- •3) Перевірка

6.3.2 Кореляційний аналіз

Величини, що характеризують різні властивості об'єктів, можуть бути незалежними або взаємопов'язаними. Розрізняють два види залежностей між величинами (факторами): функціональну та статистичну.

При функціональної залежності двох величин значенню однієї з них обов'язково відповідає одне або декілька точно визначених значень іншої величини. Функціональний зв'язок двох чинників можливий лише за умови, що друга величина залежить тільки від першої і не залежить ні від яких інших величин. Функціональний зв'язок однієї величини з множиною інших можливий в тому випадку, коли ця величина залежить тільки від цьієї множини факторів. У реальних ситуаціях існує нескінченно велика кількість властивостей самого об'єкта і зовнішнього середовища, що впливають один на одного, тому такого роду зв'язки не існують, інакше кажучи, функціональні зв'язки є математичними абстракціями. Їх застосування допустимо тоді, коли відповідна величина в основному залежить від відповідних факторів.

Під час дослідження деякого об’єкта за допомогою інформаційно-вимірювальної системи багато вимірюваних параметрів слід вважати випадковими, що виключає прояв однозначної відповідності значень. Вплив загальних факторів, наявність об'єктивних закономірностей у поведінці об'єктів призводять лише до прояву статистичної залежності. Статистичною називають залежність, при якій зміна однієї з величин спричиняє зміну розподілу іншої, і ці інші величини приймають деякі значення з певними ймовірностями. Функціональну залежність у такому випадку слід вважати окремим випадком статистичної: значенню одного фактора відповідають значення інших факторів з імовірністю, рівній одиниці. Однак на практиці такий розгляд функціонального зв'язку застосування не знайшло.

Більш важливим окремим випадком статистичної залежності є кореляційна залежність, що характеризує взаємозв'язок значень одних випадкових величин із середнім значенням інших, хоча в кожному окремому випадку будь-яка взаємопов'язана величина може приймати різні значення.

Якщо ж у взаємозалежних величин варіацію має тільки одна змінна, а інша є детермінованою, то такий зв'язок називають не кореляційним, а регресійним. Наприклад, при аналізі швидкості обміну з жорсткими дисками можна оцінювати регресію цієї характеристики на певні моделі, але не слід говорити про кореляцію між моделлю і швидкістю.

Під час дослідження залежності між однією величиною і такими характеристиками іншої, як, наприклад, моменти старших порядків (а не середнє значення), то цей зв'язок буде називатися статистичним, а не кореляційним.

Кореляційний аналіз - це сукупність методів виявлення залежності (кореляції) між двома або більше випадковими параметрами або процесами.

Під кореляцією будемо розуміти статистичну залежність між двома випадковими величинами, що не має, взагалі кажучи, строгого функціонального характеру.

Зауважимо, що кореляційний аналіз не дозволяє визначити вид функціонального зв'язку між випадковими величинами, а тільки наявність або відсутність передбачуваної залежності, наприклад, лінійної, параболічної, експоненціальної і т. д.

Визначення виду функціонального зв'язку між величинами розглядається в регресійному аналізі, елементи якого і практичне використання будуть розглянуті в наступному п. 5.10.

Назва "кореляційний аналіз" походить від латинського слова correlatio - узгодження, зв'язок, співвідношення, взаємозв'язок. Термін вперше введений Гальтоном (Гальтон) у 1888 р.

Зазвичай досліджують парну кореляцію, тобто залежність між двома випадковими величинами (процесами), хоча можливі і більш складні ситуації, коли необхідно виявити наявність або відсутність зв'язків між трьома або більше випадковими величинами.

Наведемо основні положення парної кореляції.

Як відомо, зв'язок між двома випадковими величинами можна описати за допомогою двовимірної функції розподілу. Однак такий опис часто дуже складно, а для практичних цілей можна задовольнитися визначенням залежностей середніх значень.

Отже,

метою імітаційного експерименту є

визначення характеристик двох випадкових

величин

![]() і

і![]() ,

наприклад:

,

наприклад:

|

|

|

|

Середній бал успішності навчальної групи з математики |

Середній бал виконання вправи з комп’ютерного моделювання |

|

Розсіювання точки падіння заряду по дальності |

Розсіювання точки падіння заряду за бічним відхиленням |

|

Вага студента. |

Успішність з фізвиховання. |

Необхідно перевірити:

чи є зв'язок між величинами

![]() і

і![]() ?

?

Перевірка наявності (або відсутності) зв'язку, - кореляції, між випадковими величинами виконується таким чином.

Проводиться два

експерименти, кожен - з відповідною

моделлю. У кожному експерименті -

![]() спостережень (нагадуємо, що комп'ютерний

експеримент складається з спостережень,

а спостереження - з реалізацій (прогонів)

моделі, число яких розраховується з

урахуванням необхідної точності та

достовірності одержуваних результатів

моделювання). В результаті експериментів

знаходять дві множини значень вимірюваних

параметрів

спостережень (нагадуємо, що комп'ютерний

експеримент складається з спостережень,

а спостереження - з реалізацій (прогонів)

моделі, число яких розраховується з

урахуванням необхідної точності та

достовірності одержуваних результатів

моделювання). В результаті експериментів

знаходять дві множини значень вимірюваних

параметрів![]() і

і![]() :

:![]() і

і![]() ,

,![]() .

.

З цих множин

формуються пари:

![]() .

.

Кожна пара

інтерпретується як координати випадкової

точки в системі координат

![]() ,

,![]() .

.

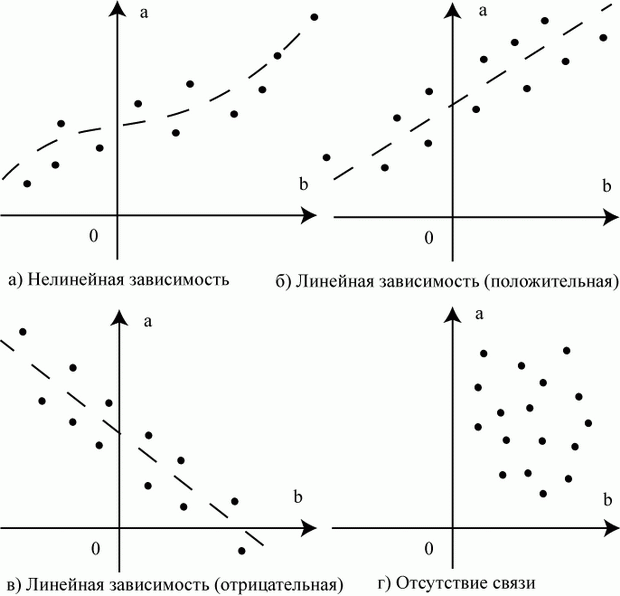

Первинне дослідження можна провести графічно. Можливі наступні варіанти розміщення точок на графіках (рис. 6.4).

З графіків можна візуально визначати по розташуванню даних, наскільки тісно вони корельовані.

Кажуть, що дві змінні позитивно корельовані, якщо при збільшенні значень однієї змінної збільшуються значення іншої змінної (рис. 6.1, б).

Нелінійна залежність

Лінійна

залежність (позитивна)

Лінійна

залежність (негативна)

Відсутність

звязку

Рисунок 6.4 - Графічне дослідження кореляції

Дві змінні негативно корельовані, якщо при збільшенні однієї змінної інша змінна зменшується (рис. 6.4, в).

Відсутність кореляції - спільної поведінки змінних - виявляється хаотичним нагромадженням точок, що виключає проведення якої-небудь апроксимуючої лінії (див. рис 6.4, г.).

Але таке якісне

дослідження недостатньо. Необхідно

мати кількісну оцінку ступеня кореляції

між величинами

![]() і

і![]() .

.

Зазвичай вихідною для кореляційного аналізу є матриця ЕД (6.1).

Кореляційний зв'язок описує наступні види залежностей:

-причинну залежність між значеннями параметрів. Прикладом такої залежності є взаємозв'язок пропускної здатності каналу передачі даних і співвідношення сигнал / шум (на пропускну спроможність впливають і інші фактори - характер перешкод, амплітудно-частотні характеристики каналу, спосіб кодування повідомлень та ін.) Встановити однозначний зв'язок між конкретними значеннями вказаних параметрів не вдається. Але очевидно, що пропускна здатність залежить від співвідношення рівнів сигналу і перешкод в каналі. Іноді при цьому причину і наслідок особливо не виділяють. У деяких випадках така кореляція є безглуздою, наприклад: якщо в якості вихідного фактора взяти доходи розробників антивірусних програм, а за результат - кількість нових вірусів, то можна зробити висновок, що розробники антивірусів "стимулюють" створення вірусів;

-"залежність" між наслідками загальної причини. Подібна залежність характерна, зокрема, для швидкості і безпомилковості набору тексту оператором (зазначені фактори залежать від кваліфікації оператора).

Кореляційна залежність визначається різними параметрами, серед яких найбільшого поширення набули показники, що характеризують взаємозв'язок двох випадкових величин (парні показники): кореляційний момент, коефіцієнт кореляції.

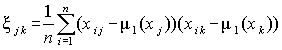

Оцінка кореляційного

моменту (коефіцієнта коваріації) двох

варіант

![]() та

та![]() обчислюється за вихідній матриці

обчислюється за вихідній матриці![]()

(6.10

(6.10

Цей показник незручний для практичного застосування, так як має розмірність, що дорівнює добутку розмірностей варіант, і за його величиною важко судити про залежність параметрів.

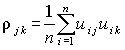

Коефіцієнт

коваріації

![]() нормованих випадкових величин називають

коефіцієнтом кореляції, його оцінка

нормованих випадкових величин називають

коефіцієнтом кореляції, його оцінка

.

(6.11)

.

(6.11)

Значення коефіцієнта

кореляції лежить в межах від -1 до 1. Якщо

випадкові величини

![]() і

і![]() незалежні, то коефіцієнт rjk обов'язково

дорівнює нулю, зворотне твердження

невірне. Коефіцієнт

незалежні, то коефіцієнт rjk обов'язково

дорівнює нулю, зворотне твердження

невірне. Коефіцієнт![]() характеризує значимість лінійного

зв'язку між параметрами:

характеризує значимість лінійного

зв'язку між параметрами:

при

![]() значення

значення![]() і

і![]() повністю збігаються, тобто значення

параметрів приймають однакові значення.

Інакше кажучи, має місце функціональна

залежність: знаючи значення одного

параметра, можна однозначно вказати

значення іншого параметра;

повністю збігаються, тобто значення

параметрів приймають однакові значення.

Інакше кажучи, має місце функціональна

залежність: знаючи значення одного

параметра, можна однозначно вказати

значення іншого параметра;

при

![]() величини

величини![]() і

і![]() приймають протилежні значення. І в цьому

випадку має місце функціональна

залежність;

приймають протилежні значення. І в цьому

випадку має місце функціональна

залежність;

при

![]() величини

величини![]() і

і![]() практично не пов'язані один з одним

лінійним співвідношенням. Це не означає

відсутності якихось інших (наприклад,

нелінійних) зв'язків між параметрами;

практично не пов'язані один з одним

лінійним співвідношенням. Це не означає

відсутності якихось інших (наприклад,

нелінійних) зв'язків між параметрами;

при

![]() однозначною лінійного зв'язку величин

однозначною лінійного зв'язку величин![]() і

і![]() немає. І чим менше абсолютна величина

коефіцієнта кореляції, тим меншою мірою

за значеннями одного параметра можна

передбачити значення іншого.

немає. І чим менше абсолютна величина

коефіцієнта кореляції, тим меншою мірою

за значеннями одного параметра можна

передбачити значення іншого.

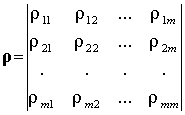

Використовуючи поняття коефіцієнта кореляції, матриці ЕД можна поставити у відповідність квадратну матрицю оцінок коефіцієнтів кореляції (кореляційну матрицю)

(6.12)

(6.12)