- •А.В. Михайлов

- •Утверждено

- •Москва 2009

- •1.1. Основные понятия и определения.

- •1.2 Основные этапы формулировки задачи.

- •1.3 Классификация оптимизационных задач.

- •1.4 Критерий оптимальности.

- •1.5. Условия оптимальности решения.

- •2.1. Постановка задачи. Методы решения оптимизационных задач.

- •2.3. Численные методы решения задачи (методы одномерного поиска).

- •2.3.1. Метод равномерного поиска

- •2.3.2. Метод последовательного равномерного поиска.

- •2.3.3. Метод дихотомии (Метод деления интервала неопределенности пополам)

- •2.3.4 Метод золотого сечения

- •3. Определение безусловного максимума функции нескольких переменных.

- •3.1. Постановка задачи и ее геометрическая интерпретация. Линии равного уровня.

- •Аналитический метод решения задачи. Аналитический метод использует необходимое условие max функции нескольких переменных:

- •Численные методы решения задачи (методы многомерного поиска).

- •Метод направленного перебора.

- •3.3.2. Методы нулевого порядка.

- •3.3.2.1. Метод Гауса-Зайделя (покоординатного поиска).

- •Пример: Выполнить первый цикл поиска максимума функции:

- •3.3.2.2. Симплекс-метод

- •3.3.3. Численные методы первого порядка (градиентные)

- •3.3.3.2. Метод градиента.

- •3.3.3.3. Метод крутого восхождения.

- •4.1 Постановка задачи и ее геометрическая интерпретация

- •4.2. Аналитические методы решения задачи

- •4.2.1. Метод неопределенных множителей Лагранжа

- •Теорема Куна-Таккера.

- •4.3. Численные методы решения задачи

- •4.3.1. Метод штрафных функций

- •5. Оптимизация многостадийных процессов

- •5.1. Постановка задачи на примере и ее формализация.

- •5.3. Метод динамического программирования. Принцип оптимальности Беллмана.

- •5.4. Задача определения оптимального пути на сетевом графике (графе).

- •6. Линейное программирование.

- •6.1. Постановка задачи линейного программирования и особенности ее решения.

- •7.Определение максимума функционала. (Вариационная задача оптимизации).

- •7.1. Пример постановки вариационной задачи.

- •7.2. Определение безусловного максимума функционала. (Классическая вариационная задача), (задача Эйлера).

- •7.3. Определение условного максимума функционала (неклассическое вариационное исчисление)

- •7.4. Определение условного максимума функционала с ограничениями типа дифференциальных уравнений. Принцип максимума Понтрягина.

- •8.1. Формирование критериев оптимальности.

- •8.2. Способы формирования сводного критерия оптимальности.

- •8.2.1. Свертка частных критериев с весовыми коэффициентами.

- •8.2.2. Использование нормативных критериев.

- •8.2.3. Приближение к идеалу.

- •8.2.4. Справедливый компромисс.

- •8.3. Оптимальность по Парето.

- •9. Типовые постановки задач оптимального управления технологическими процессами

- •9.1. Пуск и остановка единичного агрегата.

- •9.2. Пуск системы взаимосвязанных агрегатов.

- •9.3. Оптимизация статического установившегося режима.

- •9.4. Оптимизация циклического установившегося режима.

- •9.5. Оптимизация режима в аппарате периодического действия.

- •9.6. Календарное планирование работы аппарата

- •9.7 Оптимальный режим работы параллельно включенных агрегатов: распределение нагрузок.

- •9.7.1. Минимизация затрат.

- •9.7.2. Учет вероятностного характера нагрузки.

- •9.7.3. Учёт динамических факторов.

- •9.8. Оптимальный режим работы последовательно включенных агрегатов.

- •9.9. Согласование работы периодически или циклически действующих аппаратов.

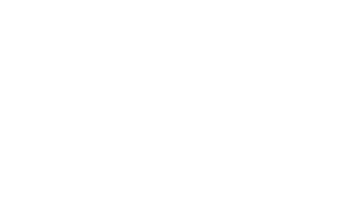

2.3.3. Метод дихотомии (Метод деления интервала неопределенности пополам)

Идея

метода заключается в том, чтобы делить

интервал неопределенности

![]() пополам и по результатам каждой итерации

отбрасывать ту половину, где максимума

быть не может.

пополам и по результатам каждой итерации

отбрасывать ту половину, где максимума

быть не может.

Для

этого достаточно вычислить значения

f0(x)

в точках

![]() и

и![]() ,

где

,

где![]() ,

,![]() ,

,![]() - допустимая погрешность определения

максимума. И сравнить их между собой.

- допустимая погрешность определения

максимума. И сравнить их между собой.

Проиллюстрируем порядок расчета с помощью рис. 2.7

Рис. 2.7

Для функции, показанной на рис. 2.7, на первой итерации расчета

![]()

![]() ,

поэтому отбрасываем правую часть

интервала неопределенности, делаем

переприсвоение X*

=

,

поэтому отбрасываем правую часть

интервала неопределенности, делаем

переприсвоение X*

=![]() ,

,

Рассчитываем

новые значения

![]() ,

,![]() ,

затем значения

,

затем значения![]() ,

,![]() и сравниваем их между собой. На второй

итерации расчета

и сравниваем их между собой. На второй

итерации расчета![]()

(рис.

2.7), поэтому отбрасываем левую часть

интервала неопределенности и делаем

переприсвоение Х*

=

![]() и т. д.

и т. д.

Вычисления

заканчиваются, когда интервал

неопределенности становится меньше

допустимой погрешности ,

и за решение принимается наибольшее из

двух последних вычисленных значений

![]() или

или![]() .

.

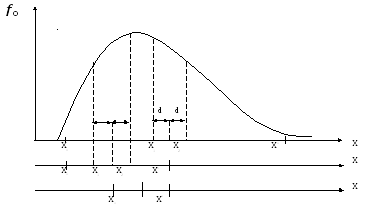

Определим

количество вычислений целевой функции,

необходимое для нахождения точки

максимума

![]() методом дихотомии с заданной точностью.

методом дихотомии с заданной точностью.

На

каждой итерации интервал неопределенности

уменьшиться в два раза, т.е.

![]()

За

n

итераций

имеем

![]()

Для обеспечения требуемой точности расчета должно быть

![]() ,

откуда

,

откуда

![]() .

.

Логарифмируя,

получаем выражение, определяющее число

итераций расчета, требуемое для решения

задачи с заданной погрешностью

![]() .

.

;

;

Общее количество расчетов целевой функции при этом ND=2n.

При

![]() получаем

получаем![]() ,

откудаn=10

и

,

откудаn=10

и

![]() .

.

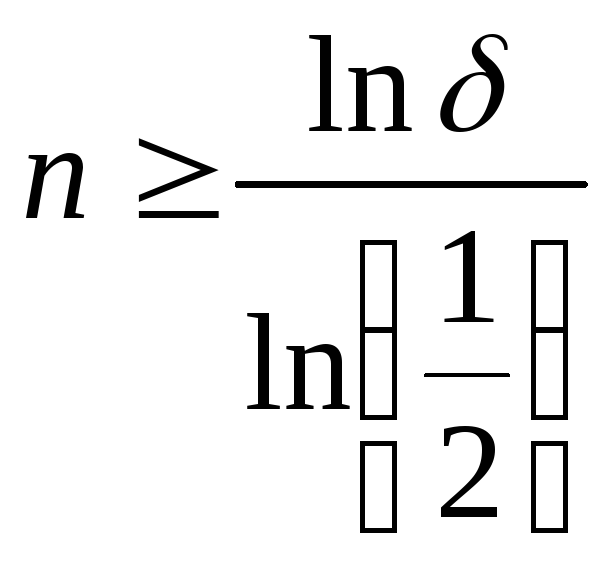

2.3.4 Метод золотого сечения

Интервал

неопределенности делится на три отрезка,

причем внутренние точки располагаются

симметрично по отношению к крайним

(рис. 2.8), таким образом, чтобы выполнялось

соотношение

![]() (2.10)

(2.10)

Р

Величина

![]() определяется следующим образом. Из

(2.10), с учетом того, что

определяется следующим образом. Из

(2.10), с учетом того, что![]() ,

получаем

,

получаем![]() ,

откуда

,

откуда![]() (2.11)

(2.11)

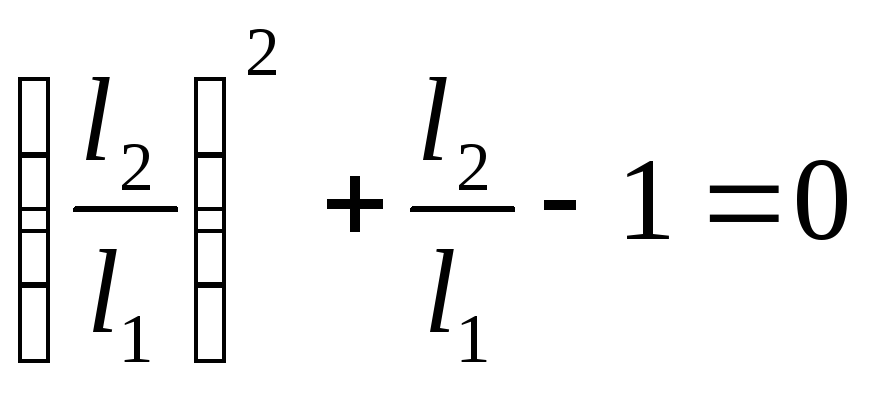

Разделив

обе части выражения (2.11) на

![]() ,

получим

,

получим

(2.12)

(2.12)

С

учетом (2.10) из (2.12) имеем

![]() ,

откуда

,

откуда

![]() -

золотое

сечение.

-

золотое

сечение.

Д

Рис. 2.8![]() и

и![]() .

Если

.

Если![]() >

>![]() ,

то интервал неопределенности сокращается

путем отбрасывания правого отрезка, а

если

,

то интервал неопределенности сокращается

путем отбрасывания правого отрезка, а

если![]() <

<![]() ,

то левого (см. рис. 2.8). Расчет повторяется

до тех пор, пока после очередного этапа

,

то левого (см. рис. 2.8). Расчет повторяется

до тех пор, пока после очередного этапа![]() ,

и за решение принимается наибольшее из

двух последних вычисленных значенийF1

или F2.

,

и за решение принимается наибольшее из

двух последних вычисленных значенийF1

или F2.

Т.к.

![]() ,

то

,

то![]() , гдеn

- число итераций расчета.

, гдеn

- число итераций расчета.

В

случае задания допустимой погрешности

как

![]() ,

имеем

,

имеем

![]() (2.13)

.

(2.13)

.

После

сокращения левой части (2.13) на L(0)

и логарифмирования, получаем

![]() ,Nзс=n+1

– общее число вычислений целевой

функции.

,Nзс=n+1

– общее число вычислений целевой

функции.

При

![]() ,

,![]() ,

,![]() .

.

Сравнивая

требуемое количество расчетов целевой

функции для решения задачи одномерной

оптимизации разными методами с одной

и той же допустимой погрешностью

![]() ,

получаем

,

получаем

![]() .

.

Заметим, что метод золотого сечения более эффективен, с точки зрения требуемого объема вычислений, по сравнению с методом дихотомии, в котором на каждой итерации необходимо два раза вычислять целевую функцию, а в методе золотого сечения на всех итерациях кроме первой целевая функция вычисляется только один раз, а второе сравниваемое значение целевой функции берется из предыдущей итерации.

Так, из рис. 2.8. имеем, f0 (X1) на первой итерации равно f0 (X2) на второй итерации равно f0 (X1) на третьей итерации и т.д.

Таким образом, можно сделать вывод, что развитие методов одномерного поиска было направлено исключительно на уменьшение объема вычислений, необходимых для решения оптимизационных задач.